论文分享

作者:-1-基

编辑整理:萝卜兔

规范化模块(Normalization)现在已经成为了深度学习不可缺少的模块,目前针对不同任务提出的主要的规范化技术包括批量规范化,层规范化,实例规范化,组规范化。但是这些规范化技术适用于不同的任务,并且在同一个结构中都采用同一种规范化形式,那么是否存在一个操作能够统一这些规范化技术呢,作者从这点出发,提出了Switchable Normalization(SN)来解决上述问题。

回顾

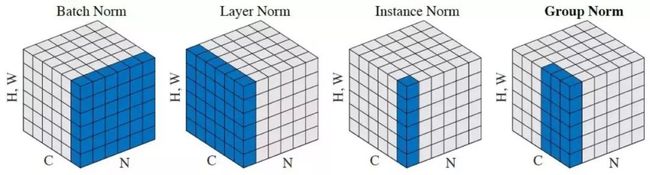

首先来回顾下目前为止出现的规范化技术。图中N为batch-size,C为特征图通道数,H,W为特征图大小。这些规范化唯一的区别在于计算统计量(均值和方差)的方式不同。其中BatchNorm是沿着所有样本的同一个通道计算,它首先应用在图像分类任务中,有助于提高收敛速度和泛化性; Layer Norm是对单个样本的特征进行计算,它首先应用在RNN中,使得RNN的优化更容易; Instance Norm是对每个样本的每个通道计算,首先应用在风格转换任务上,基于它可以解决任意风格的转换的问题; Group Norm与Layer Norm有些相似,只是在对通道进行了分组,它解决了Batch Norm对于批量大小的依赖问题。

可切换标准化

训练阶段

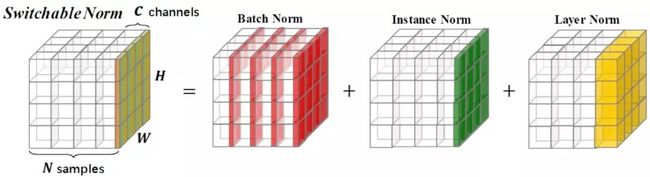

首先来看训练阶段,SN的计算公式与上述的几种归一化方式的计算公式相似,包括统计量的计算和缩放系数,偏置的学习,只是统计量的计算有所不同,SN的统计量计算了BN,LN,IN三种的统计量,然后引入6个权值参数(分别对应于均值和方差)计算加权的均值和加权的方差作为SN的均值和方差,加权系数使用了SOFTMAX进行归一化:

下图形象的说明了这个过程。在现有框架上也很容易实现,文章给出了TensorFlow上实现代码。

测试阶段

测试阶段,IN和LN都是正常计算,它们不依赖与其他样本。在BN时,以前的方式是在训练过程中的统计均值和方差的滑动平均值在测试时使用。文中抛弃了这种方式,提出了批量平均方式,具体过程是,冻结所有的参数,从训练集中随机抽取一定数量的样本,计算SN的均值和方差,然后使用他们的平均值作为BN的统计值。

优势

正如本文要解决的问题一样,SN相比其他正常化有着独特的优势。相比于BN对批量大小的依赖较大,特别在较小的批量大时,BN效果会显着下降,SN则对批量大小足够鲁棒,通过动态调节各种归一化的权值,减小BN的影响,使用IN和LN进行互补;另外针对不同任务,SN可以自适应不同的任务,通过学习选择与任务合适的权值,在不同层也可以使用不同的权值,拓展了单个结构使用同一种标准化的方式。

实验

ImageNet分类实验

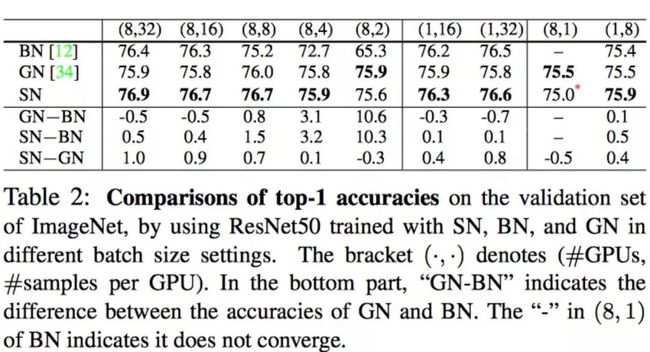

性能比较:使用不同GPU和批量大小训练ResNet 50。

在使用8GPU训练,每个GPU上的批量大小从32减小到2,可以看出GN的top1在75.9%左右,SN在四种配置下都超过了GN,另外可以看出BN随着批量大小的减小性能下降严重。

在使用单个GPU训练不同批量大小(16,32)训练时,BN超过了GN,但仍低于SN。

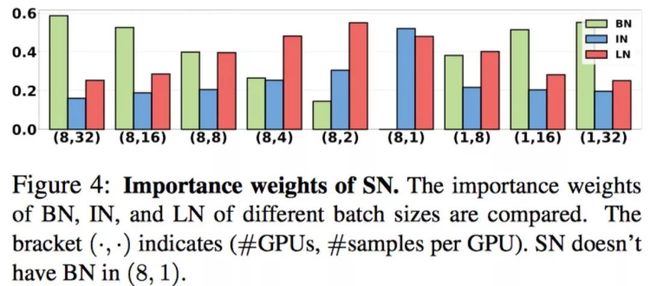

权值分布:在不同批量大小下SN各个权值之间的比较,可以看出SN能够自适应不同的场景。

作者还在物体目标检测和分割任务,风格转化上进行实验验证了SN的有效性,具体的实验结果参见论文,这里就不再详细描述了。另外作者还写了一篇文章对SN进行更深入的解读。

文章链接:

https://zhuanlan.zhihu.com/p/39296570,

同时开源了代码:

https://github.com/switchablenorms

参考文献:

罗普,任杰,彭..通过可切换归一化实现差分学习归一化。arXiv:1806.10779,2018。

S. Ioffe和C. Szegedy。批量标准化:通过减少内部协变量偏移来加速深度网络训练。在ICML,2015年。

JL Ba,JR Kiros和GE Hinton。图层规范化。arXiv:1607.06450,2016。

风格转移:J。Johnson,A。Alahi和L. Fei-Fei。实时样式传输和超分辨率的感知损失。arXiv:1603.08155,2016。

X. Huang和S. Belongie。具有自适应实例规范化的任意样式实时传输。arXiv:1703.06868,2017。

Y. Wu和K.他。组规范化。arXiv:1803.08494,2018。

Santurkar S,Tsipras D,Ilyas A,et al。批量标准化如何帮助优化?(不,它不是关于内部协变量转换)。arXiv:1805.11604,2018。

文章已于2018年7月17日修改