TensorBoard是Tensorflow的可视化工具,它通过对Tensoflow程序运行过程中输出的日志文件进行可视化Tensorflow程序的运行状态。

使用TensorBoard展示数据,需要在执行Tensorflow计算图的过程中,将各种类型的数据(summary protobuf)汇总并记录到日志文件中。然后使用TensorBoard读取这些日志文件,解析数据并生产数据可视化的Web页面,让我们可以在浏览器中观察各种汇总数据。

注:tensorflow --version 1.4.0

TensorBoard

当生成了日志文件后,在命令行中使用tensorboard --logdir=日志文件目录启动一个服务,在浏览器中使用http://DESKTOP-JGL4HV5:6006查看可视化结果。

这里有一点需要注意,日志文件目录要使用绝对路径,即从某个盘开始的路径(如果不行的话将

/变成//再试试)。同时使用360浏览器可能无法显示。

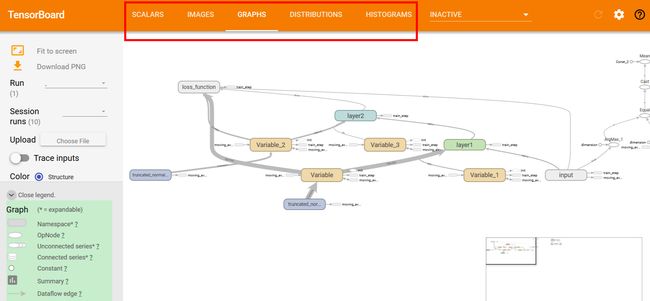

下面红框中是可视化的顶部:

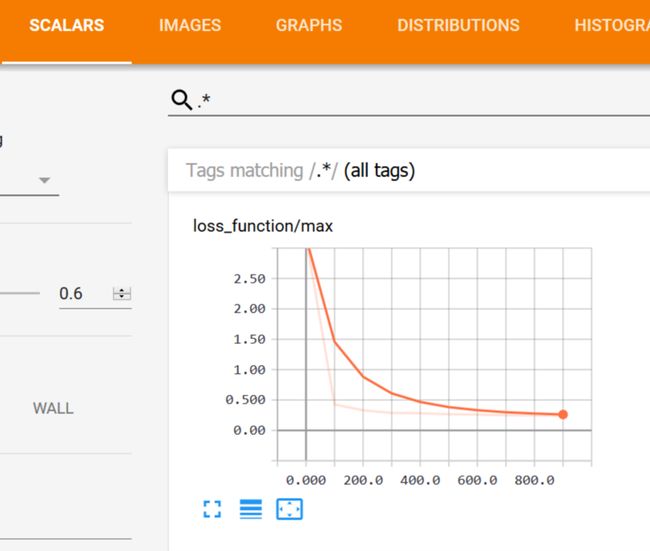

- SCALARS,对标量数据进行汇总和记录

使用方法:tf.summary.scalar(tags, values, collections=None, name=None)

一般在刻画loss和accuracy时会用到,可以计算标量的最大最小值或者标准差等

-

IMAGES, 汇总数据中的图像,例如MNIST中可以将输入的向量还原成图片的像素矩阵

使用方法:tf.summary.image(tag, tensor, max_images=3, collections=None, name=None)

GRAPHS, 可视化Tensorflow计算图的结构及计算图上的信息

使用方法:tf.summary.FileWriter(logdir, graph)

其实这个方法是将当前summary protobuf写近日志文件中,但是会自动生成计算图。-

HISTOGRAMS,记录变量的直方图(张量中元素的取值分布)

使用方法:tf.summary.histogram(tag, values, collections=None, name=None)

计算图

计算图可以很好展现整个神经网络的结构。下来将计算图中的图标进行总结:

- 边,计算图中的节点之间有两种不同的边:

实线:刻画了数据的传输,箭头代表方向

虚线:表达了计算之间的依赖关系

有些边上的箭头是双向的表示一个节点可能会修改另一个节点,同时边上还标注了张量的维度信息,边上的粗细表示了两个节点之间传输的标量维度的总大小(不是传输的标量个数)。 - 图, TensorBoard会智能的调整可视化效果图上的节点,将计算图分成了

主图(Main Graph)和辅助图(Auxiliary nodes)。也可以手动调整,对图中的节点进行移除(不会保存手工修改结果,刷新后还原)。 - 节点,当点击可视化图中的节点时,界面右上角会弹出该节点的基本信息(输入、输出、依赖关系以及消耗时间和内存信息等)。

空心小椭圆:对应计算图上一个计算节点

矩形:对应了计算图上的一个命名空间

节点信息

刚说节点的基本信息中包含消耗时间和内存信息,可以通过以下方法将其添加到日志文件并进行展示。

for i in range(TRAINING_STEPS):

# 每1000次就在验证集上测试训练的模型精度

if i % 100 == 0:

# 配置运行时要记录的信息

run_options = tf.RunOptions(trace_level=tf.RunOptions.FULL_TRACE)

# 运行时记录运行信息的proto

run_metadata = tf.RunMetadata()

# 将配置信息和运行记录信息的proto传入运行过程,从而进行记录

validate_acc, sum = sess.run([accuracy, summ], feed_dict=validate_feed, options=run_options, run_metadata=run_metadata)

# 将节点的运行信息写入日志文件

writer.add_run_metadata(run_metadata, 'step%03d' % i)

在TensorBoard可视化的Graphs页面中,左侧的Session runs会出现一个下拉菜单,记录了所有运行次数,选择一次运行后,Color栏中会出现Compute time和Memory,分别对应了计算节点的运行时间和消耗的内存。

merge_all()

和Tensorflow类似,tf.summaru.histograms()等函数不会立即执行,需要通过sess.run()来明确调用,当日志程序中定义写日志的操作比较多时,可以使用summ = tf.summary.merge_all()函数来整理所有的日志生成操作,最后只需要sess.run(summ)即可将定义中的所有日志生成操作一次执行。

TensorBoard的使用流程

- 添加记录节点:

tf.summary.scalar/image/histogram()等 - 汇总记录节点:

merged = tf.summary.merge_all() - 运行汇总节点:

summary = sess.run(merged),得到汇总结果 - 日志书写器实例化:

summary_writer = tf.summary.FileWriter(logdir, graph=sess.graph),实例化的同时传入 graph 将当前计算图写入日志 - 调用日志书写器实例对象

summary_writer的add_summary(summary, global_step=i)方法将所有汇总日志写入文件 - 调用日志书写器实例对象

summary_writer的close()方法写入内存,否则它每隔120s写入一次

下面是一个完整的使用TensorBoard的代码:

# _*_ coding:utf-8 _*_

import tensorflow as tf

from tensorflow.examples.tutorials.mnist import input_data

# 定义神经网络的神经元数目

INPUT_NODE = 784

LAYER1_NODE = 500

OUTPUT_NODE = 10

# 每次训练数据的个数

BATCH_SIZE = 100

# 衰减学习率的参数

LEARNING_RATE_BASE = 0.8

LEARNING_RATE_DECAY = 0.99

# 正则化项的系数

REGULARIATION_RATE = 0.0001

# 滑动平均的参数

TRAINING_STEPS = 1000

MOVING_AVERAGE_DECAY = 0.99

# 定义神经网络和前向传播算法

def inference(input_tensor, avg_class, weights1, biases1, weights2, biases2):

if avg_class == None:

with tf.name_scope('layer1'):

layer1 = tf.nn.relu(tf.matmul(input_tensor, weights1) + biases1)

with tf.name_scope('layer2'):

output = tf.matmul(layer1, weights2) + biases2

else:

with tf.name_scope('layer1'):

layer1 = tf.nn.relu(tf.matmul(input_tensor, avg_class.average(weights1)) + avg_class.average(biases1))

with tf.name_scope('layer2'):

output = tf.matmul(layer1, avg_class.average(weights2)) + avg_class.average(biases2)

tf.summary.histogram('weights1', weights1)

tf.summary.histogram('biases1', biases1)

tf.summary.histogram('weights2', weights2)

tf.summary.histogram('biases2', biases2)

return output

def train(mnist):

with tf.name_scope('input'):

x = tf.placeholder(tf.float32, [None, INPUT_NODE], name='x-input')

x_image = tf.reshape(x, [-1, 28, 28, 1])

tf.summary.image('input', x_image, 10)

y_ = tf.placeholder(tf.float32, [None, OUTPUT_NODE], name='y-input')

# 定义神经网络的参数

weights1 = tf.Variable(tf.truncated_normal([INPUT_NODE, LAYER1_NODE], stddev=0.1))

biases1 = tf.Variable(tf.constant(0.1, shape=[LAYER1_NODE]))

weights2 = tf.Variable(tf.truncated_normal([LAYER1_NODE, OUTPUT_NODE], stddev=0.1))

biases2 = tf.Variable(tf.constant(0.1, shape=[OUTPUT_NODE]))

# 计算前向传播结果

y = inference(x, None, weights1, biases1, weights2, biases2)

# 使用带有滑动平均的模型计算前行传播结果

with tf.name_scope('moving_average'):

global_step = tf.Variable(0, trainable=False)

variable_average = tf.train.ExponentialMovingAverage(MOVING_AVERAGE_DECAY, global_step)

variables_averages_op = variable_average.apply(tf.trainable_variables())

average_y = inference(x, variable_average, weights1, biases1, weights2, biases2)

# 计算交叉熵和损失函数

with tf.name_scope('loss_function'):

cross_entropy = tf.nn.sparse_softmax_cross_entropy_with_logits(logits=y, labels=tf.argmax(y_, 1))

cross_entropy_mean = tf.reduce_mean(cross_entropy)

regularizer = tf.contrib.layers.l2_regularizer(REGULARIATION_RATE)

regularization = regularizer(weights1) + regularizer(weights2)

loss = cross_entropy_mean + regularization

tf.summary.scalar('max', tf.reduce_max(loss))

# 使用衰减学习率

with tf.name_scope('train_step'):

learning_rate = tf.train.exponential_decay(

LEARNING_RATE_BASE,

global_step,

mnist.train.images.shape[0] / BATCH_SIZE,

LEARNING_RATE_DECAY

)

# 定义使用的优化方法

train_step = tf.train.GradientDescentOptimizer(learning_rate).minimize(loss, global_step=global_step)

# 定义同时更新滑动平均值和参数的方法

with tf.control_dependencies([train_step, variables_averages_op]):

train_op = tf.no_op('train')

# 定义精度的计算

correct_prediction = tf.equal(tf.argmax(average_y, 1), tf.argmax(y_, 1))

accuracy = tf.reduce_mean(tf.cast(correct_prediction, tf.float32))

tf.summary.histogram('accuracy', accuracy)

summ = tf.summary.merge_all()

# 初始化会话并开始训练

with tf.Session() as sess:

tf.global_variables_initializer().run()

validate_feed = {x: mnist.validation.images, y_: mnist.validation.labels}

test_feed = {x: mnist.test.images, y_: mnist.test.labels}

writer = tf.summary.FileWriter('log/')

writer.add_graph(sess.graph)

for i in range(TRAINING_STEPS):

# 每1000次就在验证集上测试训练的模型精度

if i % 100 == 0:

# 配置运行时要记录的信息

run_options = tf.RunOptions(trace_level=tf.RunOptions.FULL_TRACE)

# 运行时记录运行信息的proto

run_metadata = tf.RunMetadata()

# 将配置信息和运行记录信息的proto传入运行过程,从而进行记录

validate_acc, sum = sess.run([accuracy, summ], feed_dict=validate_feed, options=run_options, run_metadata=run_metadata)

# 将节点的运行信息写入日志文件

writer.add_run_metadata(run_metadata, 'step%03d' % i)

writer.add_summary(sum, i)

print('After %d training step(s), validation accuracy using average model is %g' % (i, validate_acc))

# 用于生成下一次迭代的训练数据

xs, ys = mnist.train.next_batch(BATCH_SIZE)

sess.run(train_op, feed_dict={x: xs, y_: ys})

# 验证在测试集上的准确度

test_acc = sess.run(accuracy, feed_dict=test_feed)

print('After %d training step(S), test accuracy using average model is %g' % (TRAINING_STEPS, test_acc))

def main(argv=None):

mnist = input_data.read_data_sets("MNIST_data/", one_hot=True)

train(mnist)

if __name__ == '__main__':

tf.app.run()