利用mahout的Bayes算法的文本情感分析

本文主要对酒店评论信息进行情感分析,根据提供的ChnSentiCorp_htl_unba_10000语料集,通过划分训练集建模,最后通过测试机测试模型处理精度。因为是一年半前写的,可能软件都比较老了。

朴素贝叶斯分类算法概述

朴素贝叶斯分类是一种十分简单的分类算法,叫它朴素贝叶斯分类是因为这种方法的思想真的很朴素,朴素贝叶斯的思想基础是这样的:对于给出的待分类项,求解在此项出现的条件下各个类别出现的概率,哪个最大,就认为此待分类项属于哪个类别。

朴素贝叶斯分类的正式定义如下:

1. 设 x={a1,a2,...,Am} 为一个待分类项,而每个a为x的一个特征属性。

2. 有类别集合 C={y1,y2,...,yn}

3. 计算 P(y1|x),P(y2|x),...,P(yn|x)

4. 如果 P(yk|x)=max{P(y1|x),P(y2|x,...,P(yn|x)} , 显然 x∈yk

那么现在的关键就是如何计算第三步中的条件概率。我们可以这样做:

1. 找到一个已知分类的待分类项集合,这个集合叫做训练样本集。

2. 统计得到在各类别下各个特征属性的条件概率估计。

3. 如果各个特征属性是条件独立的,则根据贝叶斯定理有如下推导:

因为分母对于所有类别为常数,因为我们只要将分子最大化皆可。又因为各特征属性是条件独立的,所以有:

根据上述分析,朴素贝叶斯分类的流程可以由下图表示:

第一阶段——准备工作阶段,这个阶段的任务是为朴素贝叶斯分类做必要的准备,主要工作是根据具体情况确定特征属性,并对每个特征属性进行适当划分,然后由人工对一部分待分类项进行分类,形成训练样本集合。这一阶段的输入是所有待分类数据,输出是特征属性和训练样本。这一阶段是整个朴素贝叶斯分类中唯一需要人工完成的阶段,其质量对整个过程将有重要影响,分类器的质量很大程度上由特征属性、特征属性划分及训练样本质量决定.

第二阶段——分类器训练阶段,这个阶段的任务就是生成分类器,主要工作是计算每个类别在训练样本中的出现频率及每个特征属性划分对每个类别的条件概率估计,并将结果记录。其输入是特征属性和训练样本,输出是分类器。这一阶段是机械性阶段,根据前面讨论的公式可以由程序自动计算完成。

第三阶段——应用阶段。这个阶段的任务是使用分类器对待分类项进行分类,其输入是分类器和待分类项,输出是待分类项与类别的映射关系。这一阶段也是机械性阶段,由程序完成。

分布式工具简介

为了满足对大数据处理的要求,采用以hadoop为核心的分布式工具。

Hadoop

Hadoop是一个由Apache基金会所开发的分布式系统基础架构。

用户可以在不了解分布式底层细节的情况下,开发分布式程序。充分利用集群的威力进行高速运算和存储。

Hadoop实现了一个分布式文件系统(Hadoop Distributed File System),简称HDFS。HDFS有高容错性的特点,并且设计用来部署在低廉的(low-cost)硬件上;而且它提供高吞吐量(high throughput)来访问应用程序的数据,适合那些有着超大数据集(large data set)的应用程序。HDFS放宽了(relax)POSIX的要求,可以以流的形式访问(streaming access)文件系统中的数据。

Hadoop的框架最核心的设计就是:HDFS和MapReduce。HDFS为海量的数据提供了存储,则MapReduce为海量的数据提供了计算。

mahout

Mahout 是 Apache Software Foundation(ASF) 旗下的一个开源项目,提供一些可扩展的机器学习领域经典算法的实现,旨在帮助开发人员更加方便快捷地创建智能应用程序。Apache Mahout项目已经发展到了它的第三个年头,目前已经有了三个公共发行版本。Mahout包含许多实现,包括聚类、分类、推荐过滤、频繁子项挖掘。此外,通过使用 Apache Hadoop 库,Mahout 可以有效地扩展到云中。

功能层面,Weka包含大量经过良好优化的机器学习和数据分析算法,可以处理与格式化、数据转换相关的各种任务,唯一的不足就是它对内存敏感的大数据处理的不好。而Mahout则为大数据而生,作为一个新生的数据挖掘工具,它所支持的算法与Weka相比依然很少,相关文档的质量也良莠不齐,但是它的优势在 于不仅支持单机环境,还支持MapReduce分布式计算,能够应对Weka无法处理的大数据。

Pig

Apache Pig 是一个高级过程语言,适合于使用 Hadoop 和 MapReduce 平台来查询大型半结构化数据集。通过允许对分布式数据集进行类似 SQL 的查询,Pig 可以简化 Hadoop 的使用。

本实验分布式集群环境采用实验室的HPCC集群,由4台双核4G机器组成。

中文分词

中文分词 (Chinese Word Segmentation) 指的是将一个汉字序列切分成一个一个单独的词。分词就是将连续的字序列按照一定的规范重新组合成词序列的过程。我们知道,在英文的行文中,单词之间是以空 格作为自然分界符的,而中文只是字、句和段能通过明显的分界符来简单划界,唯独词没有一个形式上的分界符,虽然英文也同样存在短语的划分问题,不过在词这 一层上,中文比之英文要复杂的多、困难的多。

这里采用的是复旦大学实现的开源分词软件,FudanNLP主要是为中文自然语言处理而开发的工具包,也包含为实现这些任务的机器学习算法和数据集。本文主要改写该软件提供的api,产生mahout能进行解析的数据。

数据格式: class0key1key2key3…keyn

其中class0为已知的类别名,keyi(i)为中文分词。

主要实现代码:

//生成mahout 能处理的文件

public static void makeFile() throws Exception{

long time = System.currentTimeMillis();

//使用数据字典和停词

tag = new CWSTagger("./models/seg.c7.110918.gz", "./models/dict.txt","./models/stopwords");

//源文件存放位置,编码gbk

readfile("./example-data/ChnSentiCorp_htl_unba_10000");

//将生成的文件存放到工作空间下

writeFile("./result1.txt",res.toString());

double t = (System.currentTimeMillis() - time) / 1000.0;

System.out.println(t);

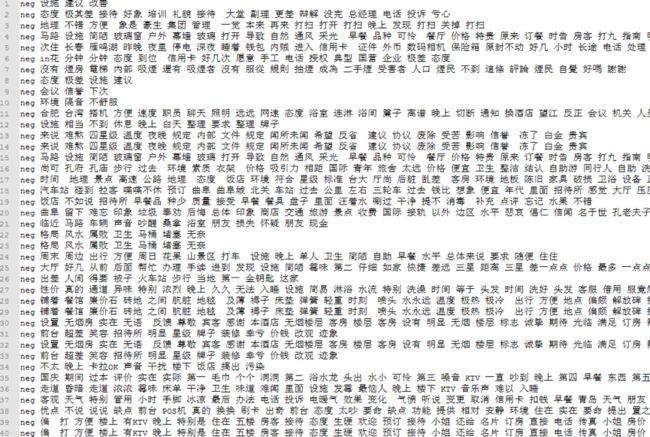

}其中数据词典保存了与酒店相关的词典,停词文档下面除了常规停词文本外还加入了关键词文本,目的是去噪。处理时间13s,共10000条记录,截取部分如下图:

划分训练集和测试集

由于文本中记录是顺序存放的,所以需要随机取一定数量的记录作为训练集,其余作为测试集。考虑时间关系,本文暂不考虑kcv或者loocv交叉,而采用较传统的holdout方法来验证,大约8000条记录划分成训练集,其余划分成测试集。这里用pig来实现划分。

首先将数据集上传到hdfs上:

[trucy@node1 bayes]$hdfs dfs –put result1 result1

然后开启pig,执行如下操作:

grunt> processed = LOAD '/user/trucy/result1' AS(category:chararray,doc:chararray);

grunt> test = sample processed 0.2;

grunt> jnt = join processed by (category,doc) left outer, test by (category,doc);

grunt> filt_test = filter jnt by test::category is null;

grunt> train = foreach filt_test generate processed::category as category,processed::doc as doc;

grunt> store test into 'test';

grunt> store test into 'train';由于pig中的sample 是近似取值,所以最终结果是2009条记录划分成了测试集,其余划分为训练集。

构建贝叶斯模型

Mahout 实现了Traditional Naive Bayes 和Complementary Naive Bayes,后者是在前者的基础上增加了结果分析功能(Result Analyzer).

主要相关的Mahout类:

org.apache.mahout.classifier.naivebayes.NaiveBayesModel

org.apache.mahout.classifier.naivebayes.StandardNaiveBayesClassifier

org.apache.mahout.classifier.naivebayes.ComplementaryNaiveBayesClassifier

执行命令:

mahout trainclassifier -i train -o bayes -type bayes -ng 1 -source hdfs显示关键信息:

INFO bayes.TrainClassifier: Training Bayes Classifier

INFO bayes.BayesDriver: Calculating Tf-Idf…

INFO common.BayesTfIdfDriver: Counts of documents in Each Label

INFO common.BayesTfIdfDriver: {pos=5069.0, neg=2185.0}

INFO common.BayesTfIdfDriver: {dataSource=hdfs, alpha_i=1.0, minDf=1, gramSize=1}

INFO driver.MahoutDriver: Program took 525498 ms (Minutes: 8.7583)

测试贝叶斯模型

执行命令:

mahout testclassifier -d test -m bayes -type bayes -ng 1 -source hdfs -method mapreduceINFO driver.MahoutDriver: Program took 47599 ms (Minutes: 0.7933166666666667)

实验结果

Mahout提供了2个评估推荐器的指标,查准率和召回率(查全率),这两个指标是搜索引擎中经典的度量方法。把上面测试结果数据整理为如下表:

| 预测 | neg | pos | total |

|---|---|---|---|

| 实际 | |||

| neg | 491 | 101 | 592 |

| pos | 65 | 1352 | 1417 |

| total | 556 | 1453 | 2009 |

算法评判标准是召回率(recall)与查准率(precision),而准确率(accuracy)用来评测这次测试的准确性,分别如下:

Recall=491592×100%=82.94%

Precision=491556×100%=88.3%

Accuray=491+13522009×100%=91.7%