Oracle EXPDP and IMPDP

一、特点

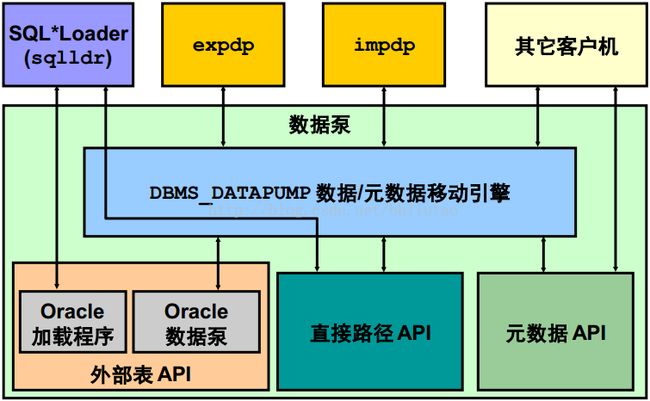

• 可通过 DBMS_DATAPUMP 调用

• 可提供以下工具:

– expdp

– impdp

– 基于 Web 的界面

• 提供四种数据移动方法:

– 数据文件复制

– 直接路径

– 外部表

– 网络链接支持e

• 可与长时间运行的作业分离后再重新挂接

• 可重新启动数据泵作业

DBMS_DATAPUMP 调用示例

declare

h1 NUMBER;

begin

h1 := dbms_datapump.open (operation => 'EXPORT', job_mode => 'SCHEMA', job_name => 'EXPORT000083', version => 'COMPATIBLE');

dbms_datapump.set_parallel(handle => h1, degree => 1);

dbms_datapump.add_file(handle => h1, filename => 'EXPDAT.LOG', directory => 'DUMP_DIR', filetype => 3);

dbms_datapump.set_parameter(handle => h1, name => 'KEEP_MASTER', value => 0);

dbms_datapump.metadata_filter(handle => h1, name => 'SCHEMA_EXPR', value => 'IN(''HR'')');

dbms_datapump.add_file(handle => h1, filename => 'EXPDAT_HR%U.DMP', directory => 'DUMP_DIR', filesize => '10M', filetype => 1);

dbms_datapump.set_parameter(handle => h1, name => 'INCLUDE_METADATA', value => 1);

dbms_datapump.set_parameter(handle => h1, name => 'DATA_ACCESS_METHOD', value => 'AUTOMATIC');

dbms_datapump.set_parameter(handle => h1, name => 'ESTIMATE', value => 'BLOCKS');

dbms_datapump.start_job(handle => h1, skip_current => 0, abort_step => 0);

dbms_datapump.detach(handle => h1);

end;

/

二、优点

与早期的数据移动工具相比,数据泵具有许多优点并提供了一些新的功能,如:

• 细粒度级的对象和数据选择(EXCLUDE/INCLUDE/CONTENT)

• 显式指定数据库版本(VERSION)

• 并行执行 (PARALLEL)

• 估计导出作业占用的空间(ESTIMATE_ONLY)

• 在分布式环境中支持网络模式(NETWORK_LINK)

• 重新映射功能(REMAP_TABLE/REMAP_SCHEMA)

• 在数据泵导出期间压缩数据 (COMPRESSION),大概是6分之一。

• 通过加密增强安全性(ENCRYPTION/ENCRYPTION_ALGORITHM)

• 能够将 XMLType 数据作为 CLOB 导出

• 在旧模式下支持旧的导入和导出文件

三、目录对象

1、什么目录

• 目录对象是一些代表服务器文件系统上的物理目录的逻辑结构

• 这些对象包含了特定操作系统目录的位置

• 目录对象由 SYS 用户拥有

• 目录名在数据库中是唯一的,因为所有目录都位于一个名称空间(即SYS)中

• 为数据泵指定文件位置时,需要用到目录对象。这是因为数据泵访问的文件在服务器上,而不是在客户机上。

2、创建目录

create directory dump_dir as '/home/oracle';

grant read on directory dump_dir to hr;

grant write on directory dump_dir to hr;

select * from dba_directories;

四、数据泵导出与导入界面:

– 命令行

– 参数文件

– 交互式命令行

– Enterprise Manager

• 数据泵导出与导入模式:

– 全部

– 方案

– 表

– 表空间

– 可移动表空间

数据泵导入的转换:

• 使用 REMAP_DATAFILE 重新映射数据文件

• 使用 REMAP_TABLESPACE 重新映射表空间

• 使用 REMAP_SCHEMA 重新映射方案

• 使用 REMAP_TABLE 重新映射表

• 使用 REMAP_DATA 重新映射数据

监视数据泵作业

SELECT * FROM V$DATAPUMP_JOB

出现以下情况时,为默认位置(与是否在旧模式下无关):

— 命令行中不包含 DIRECTORY 参数

— 用户不具备 EXP_FULL_DATABASE 权限

五、EXPDP、IMPDP与EXP、IMP的区别

1、EXPDP、IMPDP导出导入的文件只能放在服务端硬盘上,EXP、IMP可以服务端,也可以客户端。

2、EXPDP、IMPDP两者配对使用,EXP、IMP两者配对使用,无法交叉。

3、EXPDP、IMPDP支持导出表、导出方案、导出表空间、导出数据库4中模式,EXP、IMP只支持导出表、导出方案、导出数据库3种模式。

4、EXPD/IMPDP使用前需要建DIRECTORY用来存放dmp文件,而EXP/IMP不需要。

grant create any directory to system;

CREATE DIRECTORY dump_dir AS ‘c:\emp’;

GRANT READ, WRITE ON DIRECTORY dump_dir TO scott;

在备份期间,会自动的生成一张与Job_name 相同名称的表, 该表在备份期间保存metadata数据。 当备份技术后,自动删除该表。

我们可以使用SQL:

SQL>select * FROM dba_datapump_jobs

查看Job 的信息。 如果意外情况导致备份Job失败,那么对应保存metadata的表,还是会存在。

这个时候,如果查询dba_datapump_jobs,会显示该Job为not running。 这时候,我们只需要drop 掉对应的表,队友的表名就是job_name

在查询dba_datapump_jobs。 就没有记录了。 这个也是一种处理方法。

在开始我就说了,这里没有指定Job name。 所以系统自动给我们生成了一个:SYS_EXPORT_FULL_02。

默认是从SYS_EXPORT_FULL_01开始,因为我之前有一个没有运行的Job,所以这里从2开始了。

六、EXPDP和IMPDP的语法

1、EXPDP

expdp help=y

格式: expdp KEYWORD=value 或 KEYWORD=(value1,value2,...,valueN)

示例: expdp scott/tiger DUMPFILE=scott.dmp DIRECTORY=dmpdir SCHEMAS=scott

或 TABLES=(T1:P1,T1:P2)

关键字 说明 (默认)

------------------------------------------------------------------------------

ATTACH 连接到现有作业, 例如 ATTACH [=作业名]。

COMPRESSION 减小有效的转储文件内容的大小关键字值为: (METADATA_ONLY) 和 NONE。

CONTENT 指定要卸载的数据, 其中有效关键字为:(ALL), DATA_ONLY 和 METADATA_ONLY。

DIRECTORY 供转储文件和日志文件使用的目录对象。

DUMPFILE 目标转储文件 (expdat.dmp) 的列表,例如 DUMPFILE=scott1.dmp, scott2.dmp,dmpdir:scott3.dmp。

ENCRYPTION_PASSWORD 用于创建加密列数据的口令关键字。

ESTIMATE 计算作业估计值, 其中有效关键字为:(BLOCKS) 和 STATISTICS。

ESTIMATE_ONLY 在不执行导出的情况下计算作业估计值。

EXCLUDE 排除特定的对象类型, 例如EXCLUDE=TABLE:EMP。

FILESIZE 以字节为单位指定每个转储文件的大小。

FLASHBACK_SCN 用于将会话快照设置回以前状态的 SCN。

FLASHBACK_TIME 用于获取最接近指定时间的 SCN 的时间。

FULL 导出整个数据库 (N)。

HELP 显示帮助消息 (N)。

INCLUDE 包括特定的对象类型, 例如INCLUDE=TABLE_DATA。

JOB_NAME 要创建的导出作业的名称。

LOGFILE 日志文件名 (export.log)。

NETWORK_LINK 链接到源系统的远程数据库的名称。

NOLOGFILE 不写入日志文件 (N)。

PARALLEL 更改当前作业的活动 worker 的数目。

PARFILE 指定参数文件。

QUERY 用于导出表的子集的谓词子句。

SAMPLE 要导出的数据的百分比;

SCHEMAS 要导出的方案的列表 (登录方案)。

STATUS 在默认值 (0) 将显示可用时的新状态的情况下,要监视的频率 (以秒计) 作业状态。

TABLES 标识要导出的表的列表 - 只有一个方案。

TABLESPACES 标识要导出的表空间的列表。

TRANSPORT_FULL_CHECK 验证所有表的存储段 (N)。

TRANSPORT_TABLESPACES 要从中卸载元数据的表空间的列表。

VERSION 要导出的对象的版本, 其中有效关键字为:(COMPATIBLE), LATEST 或任何有效的数据库版本。

下列命令在交互模式下有效。

注: 允许使用缩写

命令 说明

------------------------------------------------------------------------------

ADD_FILE 向转储文件集中添加转储文件。

CONTINUE_CLIENT 返回到记录模式。如果处于空闲状态, 将重新启动作业。

EXIT_CLIENT 退出客户机会话并使作业处于运行状态。

FILESIZE 后续 ADD_FILE 命令的默认文件大小 (字节)。

HELP 总结交互命令。

KILL_JOB 分离和删除作业。

PARALLEL 更改当前作业的活动 worker 的数目。

PARALLEL=

START_JOB 启动/恢复当前作业。

STATUS 在默认值 (0) 将显示可用时的新状态的情况下,要监视的频率 (以秒计) 作业状态。

STATUS[=interval]

STOP_JOB 顺序关闭执行的作业并退出客户机。STOP_JOB=IMMEDIATE 将立即关闭数据泵作业。

2、IMPDP

IMPDP与EXPDP的不同参数:

1、REMAP_DATAFILE

该选项用于将源数据文件名转变为目标数据文件名,在不同平台之间搬移表空间时可能需要该选项.

REMAP_DATAFIEL=source_datafie:target_datafile

2、REMAP_SCHEMA

该选项用于将源方案的所有对象装载到目标方案中.

REMAP_SCHEMA=source_schema:target_schema

3、REMAP_TABLESPACE

将源表空间的所有对象导入到目标表空间中

REMAP_TABLESPACE=source_tablespace:target:tablespace

4、REUSE_DATAFILES

该选项指定建立表空间时是否覆盖已存在的数据文件.默认为N

REUSE_DATAFIELS={Y | N}

5、SKIP_UNUSABLE_INDEXES

指定导入是否跳过不可使用的索引,默认为N

6、SQLFILE

指定将导入要指定的索引DDL操作写入到SQL脚本中

SQLFILE=[directory_object:]file_name

Impdp scott/tiger DIRECTORY=dumpDUMPFILE=tab.dmp SQLFILE=a.sql

sqlfile 参数允许创建DDL 脚本文件

impdp scott/tiger directory=dump_scott dumpfile=a1.dmp sqlfile=c.sql

默认放在directory下,因此不要指定绝对路径

7、STREAMS_CONFIGURATION

指定是否导入流元数据(StreamMatadata),默认值为Y.

8、TABLE_EXISTS_ACTION

该选项用于指定当表已经存在时导入作业要执行的操作,默认为SKIP

TABBLE_EXISTS_ACTION={SKIP | APPEND |TRUNCATE | FRPLACE }

当设置该选项为SKIP时,导入作业会跳过已存在表处理下一个对象;

当设置为APPEND时,会追加数据,

为TRUNCATE时,导入作业会截断表,然后为其追加新数据;

当设置为REPLACE时,导入作业会删除已存在表,重建表并追加数据,

注意,TRUNCATE选项不适用与簇表和NETWORK_LINK选项

9、TRANSFORM

该选项用于指定是否修改建立对象的DDL语句

TRANSFORM=transform_name:value[:object_type]

Transform_name用于指定转换名,其中SEGMENT_ATTRIBUTES用于标识段属性(物理属性,存储属性,表空间,日志等信息),

STORAGE用于标识段存储性,VALUE用于指定是否包含段属性或段存储属性,object_type用于指定对象类型.

Impdp scott/tiger directory=dumpdumpfile=tab.dmp Transform=segment_attributes:n:table

10、TRANSPORT_DATAFILES

该选项用于指定搬移空间时要被导入到目标数据库的数据文件

TRANSPORT_DATAFILE=datafile_name

Datafile_name用于指定被复制到目标数据库的数据文件

Impdp system/manager DIRECTORY=dump DUMPFILE=tts.dmp

TRANSPORT_DATAFILES=’/user01/data/tbs1.f’

3、常用参数说明

1)ATTACH

该选项用于在客户会话与已存在导出作用之间建立关联.语法如下

ATTACH=[schema_name.]job_name

Schema_name用于指定方案名,job_name用于指定导出作业名.注意,如果使用ATTACH选项在命令行除了连接字符串和ATTACH选项外,不能指定任何其他选项,示例如下:

Expdp scott/tiger ATTACH=scott.export_job

2) CONTENT

该选项用于指定要导出的内容.默认值为ALL

CONTENT={ALL | DATA_ONLY | METADATA_ONLY}

当设置CONTENT为ALL 时,将导出对象定义及其所有数据.为DATA_ONLY时,只导出对象数据,为METADATA_ONLY时,只导出对象定义

Expdp scott/tiger DIRECTORY=dump DUMPFILE=a.dump CONTENT=METADATA_ONLY

3) DIRECTORY

指定转储文件和日志文件所在的目录

DIRECTORY=directory_object

Directory_object用于指定目录对象名称.需要注意,目录对象是使用CREATE DIRECTORY语句建立的对象,而不是OS 目录

Expdp scott/tiger DIRECTORY=dumpDUMPFILE=a.dump

建立目录:

SQL> createdirectory dump_dir as 'd:\dump';

目录已创建。

SQL> grantread,write on directory dump_dir to scott;

授权成功。

查询创建了那些子目录:

SELECT * FROM dba_directories;

4) DUMPFILE

用于指定转储文件的名称,默认名称为expdat.dmp

DUMPFILE=[directory_object:]file_name [,….]

Directory_object用于指定目录对象名,file_name用于指定转储文件名.需要注意,如果不指定directory_object,导出工具会自动使用DIRECTORY选项指定的目录对象

Expdp scott/tiger DIRECTORY=dump1DUMPFILE=dump2:a.dmp

5.)ESTIMATE

指定估算被导出表所占用磁盘空间分方法.默认值是BLOCKS

EXTIMATE={BLOCKS | STATISTICS}

设置为BLOCKS时,oracle会按照目标对象所占用的数据块个数乘以数据块尺寸估算对象占用的空间,设置为STATISTICS时,根据最近统计值估算对象占用空间

Expdp scott/tiger TABLES=empESTIMATE=STATISTICS

DIRECTORY=dump DUMPFILE=a.dump

6.)EXTIMATE_ONLY

指定是否只估算导出作业所占用的磁盘空间,默认值为N

EXTIMATE_ONLY={Y | N}

设置为Y时,导出作用只估算对象所占用的磁盘空间,而不会执行导出作业,为N时,不仅估算对象所占用的磁盘空间,还会执行导出操作.

Expdp scott/tiger ESTIMATE_ONLY=y NOLOGFILE=y

7.)EXCLUDE

该选项用于指定执行操作时释放要排除对象类型或相关对象

EXCLUDE=object_type[:name_clause] [,….]

Object_type用于指定要排除的对象类型,name_clause用于指定要排除的具体对象.EXCLUDE和INCLUDE不能同时使用

Expdp scott/tiger DIRECTORY=dump DUMPFILE=a.dup EXCLUDE=VIEW

8)FILESIZE

指定导出文件的最大尺寸,默认为0,(表示文件尺寸没有限制)

9)FLASHBACK_SCN

指定导出特定SCN时刻的表数据

FLASHBACK_SCN=scn_value

Scn_value用于标识SCN值.FLASHBACK_SCN和FLASHBACK_TIME不能同时使用

Expdp scott/tiger DIRECTORY=dumpDUMPFILE=a.dmp FLASHBACK_SCN=358523

10)FLASHBACK_TIME

指定导出特定时间点的表数据

FLASHBACK_TIME=”TO_TIMESTAMP(time_value)”

Expdp scott/tiger DIRECTORY=dumpDUMPFILE=a.dmp FLASHBACK_TIME=“TO_TIMESTAMP(’25-08-200414:35:00’,’DD-MM-YYYYHH24:MI:SS’)”

11)FULL

指定数据库模式导出,默认为N

FULL={Y | N}

为Y时,标识执行数据库导出.

12)HELP

指定是否显示EXPDP命令行选项的帮助信息,默认为N

当设置为Y时,会显示导出选项的帮助信息.

Expdp help=y

13)INCLUDE

指定导出时要包含的对象类型及相关对象

INCLUDE = object_type[:name_clause] [,… ]

14)JOB_NAME

指定要导出作用的名称,默认为SYS_XXX

JOB_NAME=jobname_string

15)LOGFILE

指定导出日志文件文件的名称,默认名称为export.log

LOGFILE=[directory_object:]file_name

Directory_object用于指定目录对象名称,file_name用于指定导出日志文件名.如果不指定directory_object.导出作用会自动使用DIRECTORY的相应选项值.

Expdp scott/tiger DIRECTORY=dumpDUMPFILE=a.dmp logfile=a.log

16)NETWORK_LINK

指定数据库链名,如果要将远程数据库对象导出到本地例程的转储文件中,必须设置该选项.

17)NOLOGFILE

该选项用于指定禁止生成导出日志文件,默认值为N.

18)PARALLEL

指定执行导出操作的并行进程个数,默认值为1

19)PARFILE

指定导出参数文件的名称

PARFILE=[directory_path] file_name

20)QUERY

用于指定过滤导出数据的where条件

QUERY=[schema.] [table_name:] query_clause

Schema用于指定方案名,table_name用于指定表名,query_clause用于指定条件限制子句.QUERY选项不能与CONNECT=METADATA_ONLY,EXTIMATE_ONLY,TRANSPORT_TABLESPACES等选项同时使用.

Expdp scott/tiger directory=dump dumpfiel=a.dmp Tables=emp query=’WHERE deptno=20’

21)SCHEMAS

该方案用于指定执行方案模式导出,默认为当前用户方案.

22)STATUS

指定显示导出作用进程的详细状态,默认值为0

23)TABLES

指定表模式导出

TABLES=[schema_name.]table_name[:partition_name][,…]

Schema_name用于指定方案名,table_name用于指定导出的表名,partition_name用于指定要导出的分区名.

24)TABLESPACES

指定要导出表空间列表

25)TRANSPORT_FULL_CHECK

该选项用于指定被搬移表空间和未搬移表空间关联关系的检查方式,默认为N.

当设置为Y时,导出作用会检查表空间直接的完整关联关系,如果表空间所在表空间或其索引所在的表空间只有一个表空间被搬移,将显示错误信息.当设置为N时,导出作用只检查单端依赖,如果搬移索引所在表空间,但未搬移表所在表空间,将显示出错信息,如果搬移表所在表空间,未搬移索引所在表空间,则不会显示错误信息.

26)TRANSPORT_TABLESPACES

指定执行表空间模式导出

27)VERSION

指定被导出对象的数据库版本,默认值为COMPATIBLE.

VERSION={COMPATIBLE | LATEST |version_string}

为COMPATIBLE时,会根据初始化参数COMPATIBLE生成对象元数据;为LATEST时,会根据数据库的实际版本生成对象元数据.version_string用于指定数据库版本字符串.

七、模式说明

1、用户模式

用户模式导入数据时,会自动创建用户。

不过在使用过程中,一定要注意dump文件中创建用户脚本的细节参数,防止带来不必要的麻烦。

虽然IMPDP工具具有自动创建用户的功能,不过尽量不要采用这种方法,

还是应该按部就班的手工完成用户的创建及用户授权,然后再完成数据的导入。

2、表空间模式

3.12 TRANSPORT_DATAFILES

该选项表示的是表空间的传输。用于指定搬移空间时要被导入到目标数据库的数据文件。

这种方法的操作步骤如下:

(1)将表空间改成read only 状态,然后copy 待传输的表空间的所有数据文件到目标库。 这里可以进行重命名。

SQL> alter tablespace dave read only;

(2)按transport 方式导出表空间。如:

expdp directory=backup dumpfile=tts.dmp transport_tablespaces=dave

注意:这步操作只把metadata,即元数据,只有定义,没有data导入了dump文件。 实际的data 我们在第一步已经copy 过去了。

(3)import 我们的数据。 如:

impdp hr directory=dpump_dir1 dumpfile=tts.dmp transport_datafiles='/user01/data/workers.dat'

(4)将表空间改成read write:

SQL>alter tablespace dave read write ;

SQL>select * from dba_tablespaces ;

SQL>select * from dba_data_files ;

元数据(metadata)从我们的dump文件导入,Data Pump将实际的data从我们指定的workers.dat 导入。 这里必须写绝对路劲。

我们看个实例:

(1)先对表空间Dave 添加一个数据文件:

SQL> alter tablespace dave add datafile '/u01/dave02.dbf' size 20m;

Tablespace altered.

(2)copy 到其他实例的对应位置

在移动之前先将表空间改成read only 状态:

SQL> alter tablespace dave read only;

将表空间下的所有数据文件移动到其他的实例上。可以进行重命令。 我这里是同一个实例。 因为我这里是一个实例。 我将我们刚才添加的数据文件dave02.dbf 移动到/u01/app/oracle/oradata/dave下。 待expdp 完成后,我们将表空间drop掉,在import进来。

$ cp /u01/dave02.dbf /u01/app/oracle/oradata/dave/bl02.dbf

将dave01.dbf 复制成bl03.dbf. 等会删除表空间,不然会被删除掉。

$ cp dave01.dbf bl03.dbf

(3)expdp 导出元数据

$expdp /'/ as sysdba /' directory=backup dumpfile=tts.dmp transport_tablespaces=dave

(4)import 数据

先把表空间drop掉在import:

SQL> drop tablespace dave including contents and datafiles;

Tablespace dropped.

$ impdp /'/ as sysdba /' directory=backup dumpfile=tts.dmp transport_datafiles='/u01/app/oracle/oradata/dave/bl02.dbf', '/u01/app/oracle/oradata/dave/bl03.dbf'

注意一点: 这里transport 的表空间,在另一个实例上是不可以存在的。 不然不能导入。

如果文件很多,也可以写入个配置文件里。 导入时通过PARFILE参数来指定。

(5)将表空间改成read write模式:

SQL> select tablespace_name,status from dba_tablespaces;

TABLESPACE_NAME STATUS

------------------------------ ---------

SYSTEM ONLINE

UNDOTBS1 ONLINE

SYSAUX ONLINE

TEMP ONLINE

USERS ONLINE

DAVE READ ONLY

BL ONLINE

7 rows selected.

SQL> alter tablespace dave read write;

Tablespace altered.

SQL> select tablespace_name,status from dba_tablespaces;

TABLESPACE_NAME STATUS

------------------------------ ---------

SYSTEM ONLINE

UNDOTBS1 ONLINE

SYSAUX ONLINE

TEMP ONLINE

USERS ONLINE

DAVE ONLINE

BL ONLINE

7 rows selected.

transport_datafiles 注意的几点:

(1)表空间所有的数据文件都要copy到目标库。

(2)copy 之间,将表空间改成read only 状态。

(3)copy之后可以对数据文件进行重命名。 所以,transport_datafiles 也可以用来对数据文件进行重命名和移动位置。

(4)transport_datafiles 完成之后,不要忘记将表空间改成读写模式。

3、全库模式

全库模式导出的是非SYS的用户。

把db从unix导入到win下,全库导出时里面有create tablespace的语法,这样就有datafile的语法,里面就有路径,

导入到win时创建tablespace时的路径就不能是unix下的路径了,此时可以通过该参数REMAP_DATAFILE一下路径:

remap_datafile=/oradata/orcl/dave01.dbf:e:/oradata/orcl/dave01.dbf

全库导出:

$expdp /'/ as sysdba/' directory=backup full=y dumpfile=fullexp3.dmp logfile=fullexp3.log parallel=2 job_name=daveJob;

全库导入:

$impdp /'/ as sysdba/' directory=backup dumpfile=fullexp3.dmp logfile=tbs.log full=y remap_datafile='/u01/app/oracle/oradata/dave/dave01.dbf':'/u01/app/oracle/oradata/dave/tianlesoftware01.dbf';

如果这里的remap 文件比较多,可以把这部分单独拿出来,放到一个文件里。

$impdp /'/ as sysdba/' directory=backup dumpfile=fullexp3.dmp logfile=tbs.log full=y parfile=payroll.par

payroll.par 内容:

remap_datafile='/oradata/orcl/system01.dbf':'/u01/oradata/orcl/system01.dbf'

remap_datafile='/oradata/orcl/sysaux01.dbf':'/u01/oradata/orcl/sysaux01.dbf'

remap_datafile='/oradata/orcl/undotbs4.dbf':'/u01/oradata/orcl/undotbs4.dbf'

remap_datafile='/oradata/orcl/test02.dbf':'/u01/oradata/orcl/test02.dbf'

如果是windows系统,需要加双引号:

remap_datafile="'d:/orcl/system01.dbf':'e:/orcl/system01.dbf'"

八、影响数据泵性能的相关参数

对下列参数建议如下设置

disk_asynch_io=true

db_block_checking=false

db_block_checksum=false

对下列参数建议设置更高的值来提高并发

processes

sessions

parallel_max_servers

对下列参数应尽可能的调大空间大小

shared_pool_size

undo_tablespace

九、实例讲解

1、导出导入表

Expdp mid_gis_0306/mid_gis DIRECTORY=DATA_PUMP_DIR DUMPFILE=GISMID_150820.dmp logfile=GISMID_150820.log TABLES=TRANSCIRCUITSUPPLY,LVCUSTOMERSUPPLY,LOCATION,TERMINAL

impdp drm_pfm/drm_pfm DIRECTORY=DATA_PUMP_DIR DUMPFILE=GISMID_150820.DMP logfile=GISMID_150820.log tables=mid_gis_0306.TRANSCIRCUITSUPPLY,mid_gis_0306.LVCUSTOMERSUPPLY REMAP_SCHEMA=mid_gis_0306:mid transform=segment_attributes:n table_exists_action=replace

2.导出导入方案

expdp scott/tiger directory=DATA_PUMP_DIR dumpfile=schema.dmp logfile=schema.log schemas=scott,system

--将dump_scott目录下的schema.dmp抽方案scott导入到scott方案中

impdp scott/tiger directory=DATA_PUMP_DIR dumpfile=schema.dmp schemas=scott

--将scott方案中的所有对象转移到system方案中

impdp system/redhat directory=DATA_PUMP_DIR dumpfile=schema.dmp schemas=scott remap_schema=scott:system

3.导出导入表空间

expdp scott/tiger directory=DATA_PUMP_DIR dumpfile=tablespace.dmp logfile=tb.log tablespaces=user01,user02

impdp system/redhat directory=DATA_PUMP_DIR dumpfile=tablespace.dmp tablespaces=user01

impdp \"/ as sysdba\" schemas=user1,user2 remap_schema=user1:user3,user2:user4 directory=EXPDUMP dumpfile=test.dump logfile=test_schemas_impdp.log PARALLEL=20

4.导出导入数据库

Expdp system/manager DIRECTORY=DATA_PUMP_DIR DUMPFILE=full.dmp FULL=Y

Expdp scott/tiger DIRECTORY=DATA_PUMP_DIR DUMPFILE=full.dmp FULL=Y --(grant exp_full_database to scott;--imp_full_database)

impdp system/redhat directory=DATA_PUMP_DIR dumpfile=full.dmp full=y

impdp \"/ as sysdba\" schemas=user1,user2 remap_tablespace=tp1:tp3,tp2:tp4 directory=EXPDUMP dumpfile=test.dump logfile=test_schemas_impdp.log PARALLEL=20

5.使用remap_datafile参数转移到不同的数据文件(用于不同平台之间存在不同命名方式时)

下面的示例首先创建了一个参数文件,参数文件名为payroll.par

directory=pump_scott

full=y

dumpfile=datafile.dmp

remap_datafile='db$:[hrdata.payroll]tbs2.f':'/db/hrdata/payroll/tbs2.f' --指明重新映射数据文件

impdp scott/tiger PARFILE=payroll.par

6.使用remap_tablespace参数转移到不同的表空间

impdp scott/scott remap_tablespace=users:tbs1 directory=dpump_scott dumpfile=users.dmp

7.并行导入导出:

expdp e/e directory=DATA_PUMP_DIR dumpfile=a_%u.dmp schemas=e parallel=3

impdp e/e directory=DATA_PUMP_DIR dumpfile=a_%u.dmp schemas=e parallel=3 table_exists_action=replace

参考文献:

http://blog.csdn.net/jojo52013145/article/details/7966047

http://blog.csdn.net/leshami/article/details/5926276

http://blog.csdn.net/tianlesoftware/article/details/6260138