python学习之爬虫(三)--获取数据:requests模块的应用、GET/POST请求、代理及应用、处理cookie、处理证书错误、超时、urllib介绍

获取数据

一、简单发送请求的方法:requests模块的使用

1.为什么要重点学习"request"模块,而不是urllib:

- requests的底层实现就是urllib

- requests在python2 和python3中通用,方法完全一样

- requests简单易用

- Requests能够自动帮助我们解压(gzip压缩的等)响应内容

2. requests的作用

作用:发送网络请求,返回响应数据

中文文档 : http://docs.python-requests.org/zh_CN/latest/index.html

3.需求:通过requests向百度首页发送请求,获取百度首页的数据

import requests

# 目标url

url = 'https://www.baidu.com'

# 向目标url发送get请求

response = requests.get(url)

# 打印响应内容

print(response.text)

4.response的常用属性:

- response.text 响应体 str类型

- respones.content 响应体 bytes类型

- response.status_code 响应状态码

- response.request.headers 响应对应的请求头

- response.headers 响应头

- response.request._cookies 响应对应请求的cookie

- response.cookies 响应的cookie(经过了set-cookie动作)

4.1 response.text 和response.content的区别:

- response.text:

- 类型:str

- 解码类型:requests模块自动根据HTTP 头部对响应的编码作出有根据的推测,推测的文本编码;

- 如何修改编码方式:

response.encoding=”gbk”

- response.content:

- 类型:bytes

- 解码类型:没有指定

- 如何修改编码方式:

response.content.deocde(“utf8”)

获取网页源码的通用方式:

1.response.content.decode()

2 response.content.decode(“GBK”)

3. response.text

5.解决中文乱码的问题:

response.text是requests模块基于chardet模块对应内容的编码格式做推测,进行转换并返回str类型

response.content.decode("参数")

# decode的参数要去尝试:ascii、gbk、gb2312、iso-8859-1、utf-8

去html的后部mate中查看content声明

6.练习:

将百度的图片下载到本地:

# -*-coding:utf-8-*-

import requests

def uploadBaidu():

url = "https://ss0.bdstatic.com/5aV1bjqh_Q23odCf/static/superman/img/logo/logo_redBlue_32fe2c69.png"

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/54.0.2840.99 Safari/537.36"

}

resp = requests.get(url=url,headers=headers)

# 打开图片

with open("baidu_log.png", "wb") as f:

f.write(resp.content)

print("OK")

if __name__ == '__main__':

uploadBaidu()

思路 :

- 1.找到图片的url

- 2.发送请求获取响应

- 3.保存图片 (流媒体必须以二进制方式写入)

7.发送带header的请求:

模仿浏览器发送请求就需要带上请求头(浏览器在发送请求过程中会携带的请求头)

resp = request.get(url, headers = {})

8.发送带参数的请求:

方法一:使用requests的方法携带构造的查询字典

import request

url = "https://www.baidu.com/s"

# 确定查询字符串参数字典

params = {

'wd':"python"

}

# 设置header信息

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/54.0.2840.99 Safari/537.36"

}

# 带上请求头和请求参数

resp = requests.get(url, params = params, headers=headers)

print(resp.content.decode())

方法二:url中直接携带查询字符串

import request

# 确定查询字符串参数字典

url = "https://www.baidu.com/s?wd=python"

# 设置header信息

headers = {

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/54.0.2840.99 Safari/537.36"

}

# 带上请求头和请求参数

resp = requests.get(url, headers=headers)

print(resp.content.decode())

9.小结:

- 1.requests模块的介绍:能够帮助我们发起请求获取响应

- 2.requests的基本使用:requests.get(url)

- 3.以及response常见的属性:

- response.text 响应体 str类型

- respones.content 响应体 bytes类型

- response.status_code 响应状态码

- response.request.headers 响应对应的请求头

- response.headers 响应头

- response.request._cookies 响应对应请求的cookie

- response.cookies 响应的cookie(经过了set-cookie动作)

- 4.掌握 requests.text和content的区别:text返回str类型,content返回bytes类型

- 5.掌握 解决网页的解码问题:

- response.content.decode()

- response.content.decode(“GBK”)

- response.text

- 6.掌握 requests模块发送带headers的请求:requests.get(url, headers={})

- 7.掌握 requests模块发送带参数的get请求:requests.get(url, params={})

二、requests模块的深入使用:

1.使用requests发送post请求:

post请求的场景:

- 登录注册(post比get更安全)

- 需要传输大文本内容的时候(post请求对数据长度没有要求)

1.1 request发送post请求语法:

- 语法:

response = requests.post("http://www.baidu.com/", \

data = data,headers=headers)

- data 的形式:字典

1.2 post请求练习:

# 百度翻译移动端

# -*-coding:utf-8-*-

import requests

import json

class BaiduTran(object):

"""百度翻译接口"""

def __init__(self, f="zh", to="en"):

self.url = "https://fanyi.baidu.com/basetrans"

self.f = f

self.to = to

self.headers = {

"User-Agent": "Mozilla / 5.0(Linux;Android 5.0;SM - G900P Build / LRX21T) AppleWebKit / 537.36(KHTML, like Gecko) Chrome / 69.0.3497.81 Mobile Safari / 537.36"

}

def get_resp(self, query):

"""

获取翻译响应

:param query:

:return:

"""

data = {

"query":query,

"from":self.f,

"to":self.to

}

self.resp = requests.post(url=self.url,headers=self.headers, data=data)

return self.resp

def get_result(self):

result = json.loads(self.resp.content.decode())["trans"][0]["dst"]

return result

if __name__ == '__main__':

tran = BaiduTran(f="zh", to="en")

resp = tran.get_resp("今天天气真不错")

# print(resp.content.decode())

print(tran.get_result())

2.使用代理

2.1 为什么使用代理

- 1.让服务器以为不是同一客户端在请求

- 2.防止我们的真是地址泄露,防止被追究

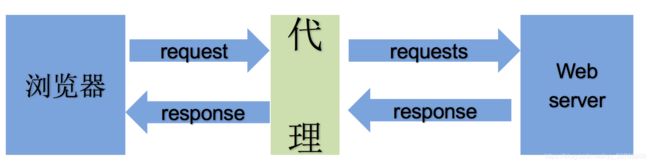

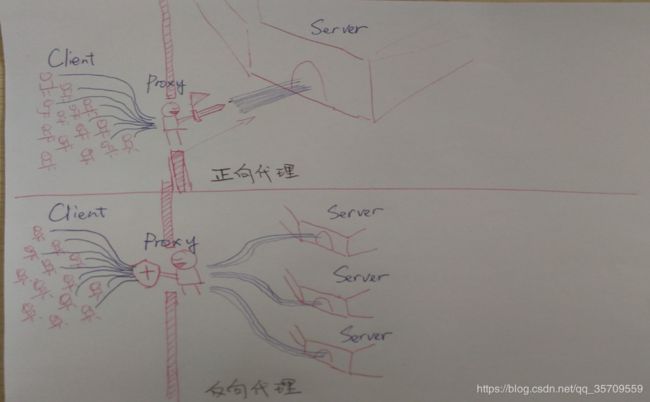

2.2 理解使用代理的过程:

2.3 理解正向代理和反向代理:

正向代理:为客户端服务

反向代理:站在客户端角度,不是为客户端服务的

2.4 代理的使用:

- 用法:

requests.get("http://www.baidu.com", proxies = {})

- proxies的形式:字典

- 例如:

proxies = {

"http": "http://12.34.56.79:9527",

"https": "https://12.34.56.79:9527",

}

2.5 代理ip的分类:

根据代理ip的匿名程度,代理IP可以分为下面四类:

- 透明代理(Transparent Proxy):透明代理虽然可以直接“隐藏”你的IP地址,但是还是可以查到你是谁。

- 匿名代理(Anonymous Proxy):使用匿名代理,别人只能知道你用了代理,无法知道你是谁。

- 高匿代理(Elite proxy或High Anonymity Proxy):高匿代理让别人根本无法发现你是在用代理,所以是最好的选择。

在使用的使用,毫无疑问使用高匿代理效果最好

从请求使用的协议可以分为:

- http代理

- https代理

- socket代理等

不同分类的代理,在使用的时候需要根据抓取网站的协议来选择

2.6 代理ip使用的注意点:

- 反反爬

使用代理ip是非常必要的一种反反爬的方式;

但是即使使用了代理ip,对方服务器任然会有很多的方式来检测我们是否是一个爬虫,比如:

-

- 一段时间内,检测IP访问的频率,访问太多频繁会屏蔽

-

- 检查Cookie,User-Agent,Referer等header参数,若没有则屏蔽

-

- 服务方购买所有代理提供商,加入到反爬虫数据库里,若检测是代理则屏蔽

所以更好的方式在使用代理ip的时候使用随机的方式进行选择使用,不要每次都用一个代理ip

- 代理ip池的更新

购买的代理ip很多时候大部分(超过60%)可能都没办法使用,这个时候就需要通过程序去检测哪些可用,把不能用的删除掉。

(拓展):

使用代理池的代理ip请求百度翻译

# -*-coding:utf-8-*-

import requests

import json

query = input("请输入要翻译的中文:")

url = "https://fanyi.baidu.com/basetrans"

headers = {

"User-Agent": "Mozilla / 5.0(Linux;Android 5.0;SM - G900P Build / LRX21T) AppleWebKit / 537.36(KHTML, like Gecko) Chrome / 69.0.3497.81 Mobile Safari / 537.36"

}

data = {

'query': query,

'from': 'zh',

'to': 'en'

}

# 循环获取代理ip

while True:

try:

proxy_str = requests.get("代理ip池的url", timeout=3).text # 获取代理ip

print("代理ip:%s" % proxy_str)

proxies = {"https":proxy_str}

resp = requests.post(url=url,data=data,headers=headers,proxies=proxies)

break

except:

print("更换代理ip...")

print(resp.content.decode())

# 处理响应

print(json.loads(resp.content.decode())["trans"][0]["dst"])

三、requests模块处理cookie

1.爬虫中使用cookie

为了能够通过爬虫获取到登录后的页面,或者是解决通过cookie的反扒,需要使用request来处理cookie相关的请求

1.1 爬虫中使用cookie的利弊

1.1.1 带上cookie的好处

- 能够访问登录后的页面

- 能够实现部分反反爬

1.1.2 带上cookie的坏处

- 一套cookie往往对应的是一个用户的信息,请求太频繁有更大的可能性被对方识别为爬虫

- 那么上面的问题如何解决 ?使用多个账号

1.2 requests处理cookie的方法

使用requests处理cookie有三种方法:

- 1.cookie字符串放在headers中

- 2.把cookie字典放传给请求方法的cookies参数接收

- 3.使用requests提供的session模块

2. cookie字符串放在headers中:

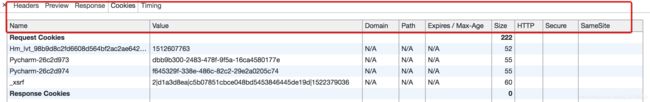

2.1 headers中cookie的位置:

- headers中的cookie:

- 使用分号(;)隔开

- 分号两边的类似a=b形式的表示一条cookie

- a=b中,a表示键(name),b表示值(value)

- 在headers中仅仅使用了cookie的name和value

2.2 cookie具体组成的字段:

由于headers中对cookie仅仅使用它的name和value,所以在代码中我们仅仅需要cookie的name和value即可

2.3 在headers中使用cookie

复制浏览器中的cookie到代码中使用

headers = {

"User-Agent":"Mozilla/5.0 (Macintosh; Intel Mac OS X 10_13_4) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/65.0.3325.181 Safari/537.36",

"Cookie":" Pycharm-26c2d973=dbb9b300-2483-478f-9f5a-16ca4580177e; Hm_lvt_98b9d8c2fd6608d564bf2ac2ae642948=1512607763; Pycharm-26c2d974=f645329f-338e-486c-82c2-29e2a0205c74; _xsrf=2|d1a3d8ea|c5b07851cbce048bd5453846445de19d|1522379036"}

requests.get(url,headers=headers)

注意:

cookie有过期时间 ,所以直接复制浏览器中的cookie可能意味着下一程序继续运行的时候需要替换代码中的cookie,对应的我们也可以通过一个程序专门来获取cookie供其他程序使用;当然也有很多网站的cookie过期时间很长,这种情况下,直接复制cookie来使用更加简单

3. 把cookie字典放传给请求方法的cookies参数接收:

- cookies的形式:字典

cookies = {"cookie的name":"cookie的value"}

使用方法:

requests.get(url,headers=headers,cookies=cookie_dict}

4.使用requests.session处理cookie(常用)

前面使用手动的方式使用cookie,那么有没有更好的方法在requets中处理cookie呢?

requests 提供了一个叫做session类,来实现客户端和服务端的会话保持(自动处理cookie)

会话保持有两个内涵:

- 保存cookie,下一次请求会带上前一次的cookie

- 实现和服务端的长连接,加快请求速度

4.1 使用方法

session = requests.session()

response = session.get(url,headers)

session实例在请求了一个网站后,对方服务器设置在本地的cookie会保存在session中,下一次再使用session请求对方服务器的时候,会带上前一次的cookie

4.2 动手练习:

动手尝试使用session来登录人人网: http://www.renren.com/PLogin.do (先不考虑这个url地址从何而来),请求体的格式:{“email”:“username”, “password”:“password”}

思路分析

- 1.准备url地址和请求参数

- 2.构造session发送post请求

- 3.使用session请求个人主页,观察是否请求成功

三、requests模块的其他方法

1 requests中cookirJar的处理方法

使用request获取的resposne对象,具有cookies属性,能够获取对方服务器设置在本地的cookie,但是如何使用这些cookie呢?

1.1 方法介绍

response.cookies是CookieJar类型

使用requests.utils.dict_from_cookiejar,能够实现把cookiejar对象转化为字典

1.2 方法展示

import requests

url = "http://www.baidu.com"

#发送请求,获取resposne

response = requests.get(url)

print(type(response.cookies))

#使用方法从cookiejar中提取数据

cookies = requests.utils.dict_from_cookiejar(response.cookies)

print(cookies)

输出为:

<class 'requests.cookies.RequestsCookieJar'>

{'BDORZ': '27315'}

注意:

在前面的requests的session类中,我们不需要处理cookie的任何细节,如果有需要,我们可以使用上述方法来解决

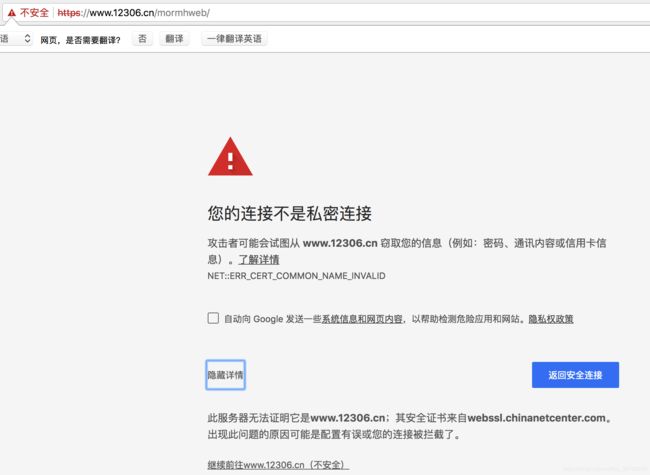

2. request处理证书错误:

2.1 代码中发起请求的效果

那么如果在代码中请求会怎么样呢?

import requests

url = "https://sam.huat.edu.cn:8443/selfservice/"

response = requests.get(url)

返回证书错误,如下:

ssl.CertificateError …

2.2 解决方案

为了在代码中能够正常的请求,我们修改添加一个参数

import requests

url = "https://www.12306.cn/mormhweb/"

# requests.packages.urllib3.disable_warnings() # 不显示安全提示

response = requests.get(url,verify=False)

3 超时参数的使用:

在平时网上冲浪的过程中,我们经常会遇到网络波动,这个时候,一个请求等了很久可能任然没有结果

在爬虫中,一个请求很久没有结果,就会让整个项目的效率变得非常低,这个时候我们就需要对请求进行强制要求,让他必须在特定的时间内返回结果,否则就报错

3.1 超时参数使用方法如下:

response = requests.get(url,timeout=3) # 发送请求之后,等待3秒

通过添加timeout参数,能够保证在3秒钟内返回响应,否则会报错

注意:

这个方法还能够拿来检测代理ip的质量,如果一个代理ip在很长时间没有响应,那么添加超时之后也会报错,对应的这个ip就可以从代理ip池中删除

4. retrying模块的使用:

使用超时参数能够加快我们整体的请求速度,但是在正常的网页浏览过成功,如果发生速度很慢的情况,我们会做的选择是刷新页面,那么在代码中,我们是否也可以刷新请求呢?

对应的,retrying模块就可以帮助我们解决

4.1 retrying模块的使用

retrying模块的地址:https://pypi.org/project/retrying/

retrying 模块的使用

- 1.使用retrying模块提供的retry模块

- 2.通过装饰器的方式使用,让被装饰的函数反复执行

- 3.retry中可以传入参数stop_max_attempt_number,让函数报错后继续重新执行,达到最大执行次数的上限,如果每次都报错,整个函数报错,如果中间有一个成功,程序继续往后执行

4.2 retrying和requests的简单封装

实现一个发送请求的函数,每次爬虫中直接调用该函数即可实现发送请求,在其中

- 使用timeout实现超时报错

- 使用retrying模块实现重试

代码参考:

# parse.py

import requests

from retrying import retry

headers = {}

#最大重试3次,3次全部报错,才会报错

@retry(stop_max_attempt_number=3)

def _parse_url(url)

#超时的时候回报错并重试

response = requests.get(url, headers=headers, timeout=3)

#状态码不是200,也会报错并重试

assert response.status_code == 200

return response

def parse_url(url)

try: #进行异常捕获

response = _parse_url(url)

except Exception as e:

print(e)

#报错返回None

response = None

return response

5.小结:

- 1.requests.utils.dict_from_cookiejar能够实现cookiejar转化为字典

- 2.请求方法中添加verify=False能够实现请求过程中不验证证书

- 3.请求方法中添加timeout能够实现强制程序返回结果的能够,否则会报错

- 4.retrying模块能够实现捕获函数的异常,反复执行函数的效果,和timeout配合使用,能够解决网络波动带来的请求不成功的问题

五、urllib的学习:

1.urllib介绍:

除了requests模块可以发送请求之外, urllib模块也可以实现请求的发送,只是操作方法略有不同!

urllib在python中分为urllib和urllib2,在python3中为urllib

2 urllib的基本方法介绍

2.1 urllib.urlopoen

传入URL地址

import urllib.request

response = urllib.request.urlopen("http://www.baidu.com")

print(resp.read())

2.2 urllib.Request

2.2.1 构造简单请求

import urllib.request

#构造请求

request = urllib.request.Request("http://www.baidu.com")

#发送请求获取响应

response = urllib.request.urlopen(request)

print(resp.read())

2.2.2 传入headers参数

import urllib.request

#构造headers

headers = {"User-Agent" : "Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; Trident/5.0)"}

#构造请求

request = urllib.request.Request(url, headers = headers)

#发送请求

response = urllib.request.urlopen(request)

print(resp.read())

2.2.3传入data参数 实现发送post请求

import urllib.request

import urllib.parse

headers = {"User-Agent": "Mozilla/5.0 (compatible; MSIE 9.0; Windows NT 6.1; Trident/5.0)"}

# 构造请求数据字典

data = {"email":"[email protected]", "password":"alarmchime"}

# 对请求数据字典编码为bytes类型

data = urllib.parse.urlencode(data).encode('utf-8')

# 构造请求

request = urllib.request.Request('http://www.renren.com/PLogin.do', data=data, headers=headers)

# 发送请求获取响应

resp = urllib.request.urlopen(request)

# 获取响应的文本内容

print(resp.read())

2.3 response.read()

获取响应的html字符串,bytes类型

import urllib.request

#构造请求

request = urllib.request.Request("http://www.baidu.com")

#发送请求获取响应

response = urllib.request.urlopen(request)

# 打印响应的文本内容 bytes类型

print(resp.read())

# 打印响应的文本内容 str类型

print(resp.read().decode())

2.4 小结

- 1.urllib.request中实现了构造请求和发送请求的方法

- 2.urllib.request.Request(url,headers,data)能够构造请求

- 3.urllib.request.urlopen能够接受request请求或者url地址发送请求,获取响应

- 4.urllib.parse.urlencode(data_dict).encode(‘utf-8’)之后才能传入data参数

- 5.response.read()能够实现获取响应中的bytes字符串

六、总结:

requests模块:

- 发送请求获取响应

1. 发送请求的方法

requests.get(url)

requests.post(url)

requests.session().get(url)

requests.session().post(url)

2. 发送请求方法的参数

headers={请求头}

cookies={cookies}

params={查询字符串}

data={post请求独有的请求体}

timeout=3 # 最大超时时间3秒

verify=False # 忽略ssl安全认证

3. response响应对象常用属性

response.url

response.status_code

response.headers # {}

response.request.headers # {}

response.cookies # cookieJar

response.request._cookies # cookieJar

response.text # str

response.content # bytes

4. 解决中文乱码

response.content.decode(utf8)

# ascii gbk gb2312 iso-8859-1

5. requests.session()的作用

- 能够自动处理cookies,达到状态保持的目的

- 发送请求时,会自动带上前次的cookies

- 获得响应时,会自动保存被set的cookie

6. cookieJar和cookies_dict互相转换

cookies_dict = requests.utils.dict_from_cookiejar(response.cookies)

cookies_jar = requests.utils.cookiejar_from_dict(cookies_dict)

7. 关闭warning级别的提示信息

requests.packages.urllib3.disable_warnings()

8. retry的是使用

retrying.retry装饰器能够让被装饰的函数在发生异常时,按规定的次数行重试:

from retrying import retry

@retry(stop_max_attempt_number=3)

def func():pass

# stop_max_attempt_number=3表示重试最多3次