前言

这里只记录BP神经网络

1.人工神经网络基本理论

1.1人工神经网络模型拓扑结构

人工神经网络是由大量简单的基本原件-神经元构成。通过模拟人的大脑神经处理信息的方式,进行信息并行处理和非线性转换的复杂网络系统。

其优点是多输入多输出实现了数据的并行处理以及自我学习能力。常用的神经网络由BP网络和RBF网络。BP网络的结构如下:

1.2 常用的激励函数

激励函数成为激活函数或者传递函数。常用的形态有三种:

阈值型(一般只用于简单分类的MP模型中):

f(x) = 0(x<0)或1(x>=0)线性型(一般用在输入神经元和输出神经元)

f(x) = xS型(常用语隐含层神经元)

f(x) = 1/(1+e^(-x))

通常还会在激励函数的变量中耦合一个常数以便于调整激励网络的输出幅度。

如f(x) = 1/(1+e^(-cx)),c为常量

1.3常用神经网络理论

- BP网络基本数学原理

常见的BP神经网络拓扑结构。BP网络是一种具有三层或者三层以上神经元的神经网络,包括输入层,中间层(隐含层)和输出层。上下层之间完全连接,而同一层之间无连接,输入层神经元语隐含层神经元之减得网络的权值,即两个神经元之间的连接强度。当一对学习样本提供输入神经元后,神经元的激活值(该层神经元的输出值)从输入层经过隐含层想输出层传输,在输出层反向经过各隐含层回到输入层,从而修正各连接权值,这种算法称为“误差反向传播算法”,即BP算法。BP算法的核心是数学中的“负梯度下降理论”

2.BP神经网络的结构设计

神经网络的学习步骤

1准备训练网络的样本

也即是确定输入样本和输出样本

2确定网络的初始参数

包括最大训练次数,隐含层神经元个数,网络学习速率,训练的目标误差,是否添加动量因子。

3初始化网络权值和阈值

- 训练步骤是按照数据批量形式进行的

- 阈值携程语犬只相似的形式,也就是阈值看做样本输入为1的随机数。

- 数据输入时按照每一行为一个维度进行输入的

4计算第一层神经元的输入和输出

因为输入和输出样本的量纲和量级都是不同,所以输入进行归一化处理。

5计算第二层神经元的输入和输出

6计算第三层神经元的输入和输出

7计算能量函数E

8计算第二层和第三层之间的权值和阈值的调整量

9计算第二层和第一层之间的权值和阈值的调整量

10计算调整之后的权值和阈值

3应用实例

3.1BP网络求解过程模块化

- 原始数据的输入

- 数据归一化

- 网络训练

- 对原始数据进行仿真

- 将原始数据仿真的结果和已知的样本进行对比

- 对新数据进行仿真

3.2非神经网络工具箱的求解代码

function main()

clc % 清屏

clear all; %清除内存以便加快运算速度

close all; %关闭当前所有figure图像

SamNum=20; %输入样本数量为20

TestSamNum=20; %测试样本数量也是20

ForcastSamNum=2; %预测样本数量为2

HiddenUnitNum=8; %中间层隐节点数量取8,比工具箱程序多了1个

InDim=3; %网络输入维度为3

OutDim=2; %网络输出维度为2

%原始数据

%人数(单位:万人)

sqrs=[20.55 22.44 25.37 27.13 29.45 30.10 30.96 34.06 36.42 38.09 39.13 39.99 ...

41.93 44.59 47.30 52.89 55.73 56.76 59.17 60.63];

%机动车数(单位:万辆)

sqjdcs=[0.6 0.75 0.85 0.9 1.05 1.35 1.45 1.6 1.7 1.85 2.15 2.2 2.25 2.35 2.5 2.6...

2.7 2.85 2.95 3.1];

%公路面积(单位:万平方公里)

sqglmj=[0.09 0.11 0.11 0.14 0.20 0.23 0.23 0.32 0.32 0.34 0.36 0.36 0.38 0.49 ...

0.56 0.59 0.59 0.67 0.69 0.79];

%公路客运量(单位:万人)

glkyl=[5126 6217 7730 9145 10460 11387 12353 15750 18304 19836 21024 19490 20433 ...

22598 25107 33442 36836 40548 42927 43462];

%公路货运量(单位:万吨)

glhyl=[1237 1379 1385 1399 1663 1714 1834 4322 8132 8936 11099 11203 10524 11115 ...

13320 16762 18673 20724 20803 21804];

p=[sqrs;sqjdcs;sqglmj]; %输入数据矩阵

t=[glkyl;glhyl]; %目标数据矩阵

[SamIn,minp,maxp,tn,mint,maxt]=premnmx(p,t); %原始样本对(输入和输出)初始化,进行了数据的归一化

rand('state',sum(100*clock)) %依据系统时钟种子产生随机数

NoiseVar=0.01; %噪声强度为0.01(添加噪声的目的是为了防止网络过度拟合)

Noise=NoiseVar*randn(2,SamNum); %生成噪声

SamOut=tn + Noise; %将噪声添加到输出样本上

TestSamIn=SamIn; %这里取输入样本与测试样本相同因为样本容量偏少

TestSamOut=SamOut; %也取输出样本与测试样本相同

MaxEpochs=50000; %最多训练次数为50000

lr=0.035; %学习速率为0.035

E0=0.65*10^(-3); %目标误差为0.65*10^(-3)

W1=0.5*rand(HiddenUnitNum,InDim)-0.1; %初始化输入层与隐含层之间的权值

B1=0.5*rand(HiddenUnitNum,1)-0.1; %初始化输入层与隐含层之间的阈值

W2=0.5*rand(OutDim,HiddenUnitNum)-0.1; %初始化输出层与隐含层之间的权值

B2=0.5*rand(OutDim,1)-0.1; %初始化输出层与隐含层之间的阈值

ErrHistory=[]; %给中间变量预先占据内存

for i=1:MaxEpochs

HiddenOut=logsig(W1*SamIn+repmat(B1,1,SamNum)); % 隐含层网络输出

NetworkOut=W2*HiddenOut+repmat(B2,1,SamNum); % 输出层网络输出

Error=SamOut-NetworkOut; % 实际输出与网络输出之差

SSE=sumsqr(Error) %能量函数(误差平方和)

ErrHistory=[ErrHistory SSE];

if SSE程序结果:

anew =

1.0e+004 *

4.2761 4.2615

2.0732 2.0593

3.3神经网络工具箱的求解代码

clc;

close all;

clear all;

% 原始数据

% 人数(单位:万人)

sqrs=[20.55 22.44 25.37 27.13 29.45 30.10 30.96 34.06 36.42 38.09 39.13 39.99 ...

41.93 44.59 47.30 52.89 55.73 56.76 59.17 60.63];

%机动车数(单位:万辆)

sqjdcs=[0.6 0.75 0.85 0.9 1.05 1.35 1.45 1.6 1.7 1.85 2.15 2.2 2.25 2.35 2.5 2.6...

2.7 2.85 2.95 3.1];

%公路面积(单位:万平方公里)

sqglmj=[0.09 0.11 0.11 0.14 0.20 0.23 0.23 0.32 0.32 0.34 0.36 0.36 0.38 0.49 ...

0.56 0.59 0.59 0.67 0.69 0.79];

%公路客运量(单位:万人)

glkyl=[5126 6217 7730 9145 10460 11387 12353 15750 18304 19836 21024 19490 20433 ...

22598 25107 33442 36836 40548 42927 43462];

%公路货运量(单位:万吨)

glhyl=[1237 1379 1385 1399 1663 1714 1834 4322 8132 8936 11099 11203 10524 11115 ...

13320 16762 18673 20724 20803 21804];

% 输入数据矩阵

p=[sqrs;sqjdcs;sqglmj];

% 目标数据矩阵

t=[glkyl;glhyl];

% 利用mapminmax函数对数据进行归一化

[pn,input_str] = mapminmax(p) ;

[tn,output_str] = mapminmax(t) ;

% 建立BP神经网络,相对旧一点的MATLAB版本,新版本 newff 函数使用更简洁一些

% 但是本质和性能没有区别

net=newff(pn,tn,[3 7 2],{'purelin','logsig','purelin'});

% 10轮回显示一次结果

net.trainParam.show=10;

% 学习速度为0.05

net.trainParam.lr=0.05;

% 最大训练次数为5000次

net.trainParam.epochs=5000;

% 均方误差

net.trainParam.goal=0.65*10^(-3);

% 网络误差如果连续6次迭代都没有变化,训练将会自动终止(系统默认的)

% 为了让程序继续运行,用以下命令取消这条设置

net.divideFcn = '';

% 开始训练,其中pn,tn分别为输入输出样本

net=train(net,pn,tn);

% 利用训练好的网络,基于原始数据对BP网络仿真

an=sim(net,pn);

% 利用函数mapminmax把仿真得到的数据还原为原始的数量级

% 新版本推荐训练样本归一化和反归一化都使用 mapminmax 函数

a = mapminmax('reverse',an,output_str);

% 本例因样本容量有限使用训练数据进行测试,通常必须用新鲜数据进行测试

x=1990:2009;

newk=a(1,:);

newh=a(2,:);

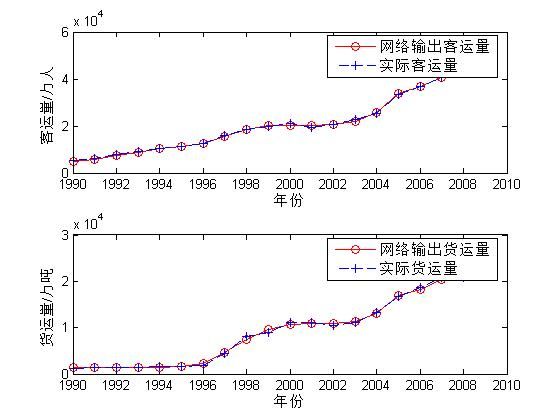

figure (2);

% 绘值公路客运量对比图

subplot(2,1,1);plot(x,newk,'r-o',x,glkyl,'b--+')

legend('网络输出客运量','实际客运量');

xlabel('年份');ylabel('客运量/万人');

title('运用工具箱客运量学习和测试对比图');

% 绘制公路货运量对比图

subplot(2,1,2);plot(x,newh,'r-o',x,glhyl,'b--+')

legend('网络输出货运量','实际货运量');

xlabel('年份');ylabel('货运量/万吨');

title('运用工具箱货运量学习和测试对比图');

% 利用训练好的网络进行预测

% 2010年和2011年的相关数据

% 当用训练好的网络对新数据mapminmax进行预测时,也应作相应的处理:

pnew=[73.39 75.55

3.9635 4.0975

0.9880 1.0268];

% 利用原始输入数据的归一化参数对新数据进行归一化

pnewn = mapminmax('apply',pnew,input_str);

% 利用归一化后的数据进行仿真

anewn=sim(net,pnewn);

% 把仿真得到的数据还原为原始的数量级

anew = mapminmax('reverse',anewn,output_str)

从程序的结果对比来看,使用工具箱速度明显快于不使用工具箱的时候(for循环的效率真是低。。。)。

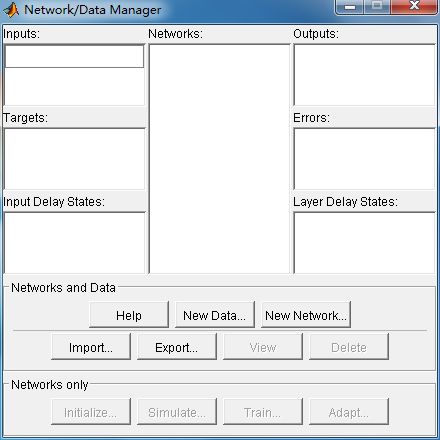

额外补充-使用神经网路工具箱GUI操作

-

在命令行中输入nntool,得到如下图

将数据进行归一化处理

导入数据到GUI中

新建网络,并进行一定参数的设置

双击上一步建立的网络,点击“Train”,在Traning Info中进行输入和目标的选择,在“Train Parmeters”中进行训练的参数设置。点击“Train Network”进行训练。

双击已经进行训练过的网络,选择“Simulate”进行仿真(注意仿真的数据也是归一化后的数据),预测。

将得到的相关数据进行导出

GUI具体操作:https://wenku.baidu.com/view/bcbc372f52d380eb63946d16.html