1. 环境:

- windows10

- python3

- mysql 5.7

2.Python爬虫抓取网页数据并保存到本地数据文件中

开启mysql数据库

首先导入需要的数据模块,定义函数:

# -*- coding: utf-8 -*-

"""

Created on Fri Dec 29 15:54:40 2017

@author: JayMo

"""

import urllib

import re

import pandas as pd

import pymysql

import os

#爬虫抓取网页函数

def getHtml(url):

html = urllib.request.urlopen(url).read()

html = html.decode('gbk')

return html

#抓取网页股票代码函数

def getStackCode(html):

s = r''

pat = re.compile(s)

print(pat)

code = pat.findall(html)

print(code)

return code

真正干活的代码块:

Url = 'http://quote.eastmoney.com/stocklist.html'#东方财富网股票数据连接地址

filepath = 'F:\\data\\'#定义数据文件保存路径

#实施抓取

code = getStackCode(getHtml(Url))

#获取所有股票代码(以6开头的,应该是沪市数据)集合

CodeList = []

for item in code:

if item[0]=='6':

CodeList.append(item)

#抓取数据并保存到本地csv文件

for code in CodeList:

print('正在获取股票%s数据'%code)

url = 'http://quotes.money.163.com/service/chddata.html?code=0'+code+\

'&end=20171228&fields=TCLOSE;HIGH;LOW;TOPEN;LCLOSE;CHG;PCHG;TURNOVER;VOTURNOVER;VATURNOVER;TCAP;MCAP'

urllib.request.urlretrieve(url, filepath+code+'.csv')

修改url中的end的值,可爬取截止日期不同的股票数据。先看下抓取的结果。CodeList是抓取到的所有股票代码的集合,我们看到它共包含1416条元素,即1416支股票数据。因为股票太多,所以只抓取以6开头的。

抓取到的股票数据会分别存储到csv文件中,一只股票数据一个文件。理论上会有1416个csv文件,和股票代码数一致。

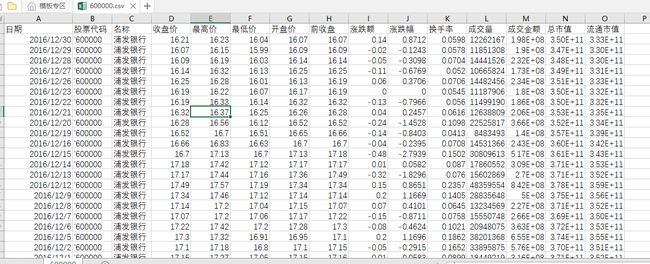

打开一个本地数据文件看一下抓取的数据长什么样子:

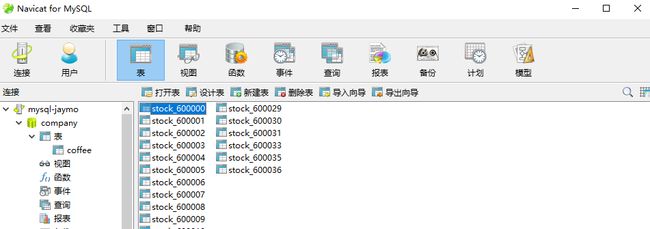

3. 将数据存储到MySQL数据库

首先建立本地数据库连接:

#数据库名称和密码

name = 'xxxx'

password = 'xxxx' #替换为自己的用户名和密码

#建立本地数据库连接(需要先开启数据库服务)

db = pymysql.connect('localhost', name, password, charset='utf8')

cursor = db.cursor()

其中,数据库名称(name)和密码(password)是安装MySQL时设置的。

创建数据库,专门用来存储本次股票数据:

#创建数据库stockDataBase,如果存在则跳过

sqlSentence1 = "create database if not exists stockDataBase"

cursor.execute(sqlSentence1)#选择使用当前数据库

sqlSentence2 = "use stockDataBase;"

cursor.execute(sqlSentence2)

在首次运行的时候一般都会正常创建数据库,但如果再次运行,因数据库已经存在,那么跳过创建,继续往下执行。创建好数据库后,选择使用刚刚创建的数据库,在该数据库中存储数据表。

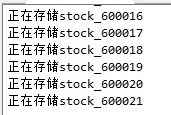

下面看具体的存储代码:

#获取本地文件列

fileList = os.listdir(filepath)

#依次对每个数据文件进行存储

for fileName in fileList:

data = pd.read_csv(filepath+fileName, encoding="gbk")

#创建数据表,如果数据表已经存在,会跳过继续执行下面的步骤print('创建数据表stock_%s'% fileName[0:6])

sqlSentence3 = "create table if not exists stock_%s" % fileName[0:6] + "(日期 date, 股票代码 VARCHAR(10), 名称 VARCHAR(10), 收盘价 float,\

最高价 float, 最低价 float, 开盘价 float, 前收盘 float, 涨跌额 float, 涨跌幅 float, 换手率 float,\

成交量 bigint, 成交金额 bigint, 总市值 bigint, 流通市值 bigint)"

cursor.execute(sqlSentence3)#迭代读取表中每行数据,依次存储(整表存储还没尝试过)

print('正在存储stock_%s'% fileName[0:6])

length = len(data)

for i in range(0, length):

record = tuple(data.loc[i])

#插入数据语句

try:

sqlSentence4 = "insert into stock_%s" % fileName[0:6] + "(日期, 股票代码, 名称, 收盘价, 最高价, 最低价, 开盘价,\

前收盘, 涨跌额, 涨跌幅, 换手率, 成交量, 成交金额, 总市值, 流通市值) \

values ('%s',%s','%s',%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s)" % record

#获取的表中数据很乱,包含缺失值、Nnone、none等,插入数据库需要处理成空值

sqlSentence4 = sqlSentence4.replace('nan','null').replace('None','null').replace('none','null')

cursor.execute(sqlSentence4)

except:#如果以上插入过程出错,跳过这条数据记录,继续往下进行

break

结果:

代码并不复杂,只要注意其中几个点就好了。

1.逻辑层次:

包含两层循环,外层循环是对股票代码的循环,内层循环是对当前股票的每一条记录的循环。说白了就是按照股票一支一支的存储,对于每一支股票,按照它每日的记录一条一条的存储。是不是很简单很暴力?是的!完全没有考虑更加优化的方式。

2.读取本地数据文件的编码方式:

使用'gbk'编码,默认应该是'utf8',但好像不支持中文。

3.创建数据表:

同样的,如果数据表已经存在(判断是否存在if not exists),则跳过创建,继续执行下面的步骤(会继续存储)。有个问题是,有可能数据重复存储,可以选择跳过存储或者只存储最新数据。我在这里没有考虑太多额外的处理。其次,指定字段格式,后边几个字段成交量、成交金额、总市值、流通市值,因为数据较大,选择使用bigint类型。

4.没有指定数据表的主键:

最初是打算使用日期作为主键的,后来发现获取到的数据中竟然包含重复日期的数据,这就打破了主键的唯一性,会出bug的,然后我也没有多去思考数据文件的内容,也不会进一步使用这些个数据,也就图省事直接不设置主键了。

5.构造sql语句sqlSentence4:

该过程实现中,直接把股票数据记录tuple了,然后使用字符串格式化(%操作符)。造成的精度问题没有多考虑,不知道会不会产生什么样的影响。%s有的上边带着' ',是为了在sql语句中表示字符串。其中有一个%s',只有右边有单引号,匹配的是股票代码,只有一边单引号,这是因为从数据文件中读取到的字符串已经包含了左边的单引号,左边不需要再添加了。这是数据文件格式的问题,为了表示文本形式预先使用了单引号。

6.异常值处理:

文本文件中,包含有空值、None、none等不标准化数据,这里全部替换为null了,即数据库的空值。

完成MySQL数据库数据存储后,需要关闭数据库连接:

#关闭游标,提交,关闭数据库连接

cursor.close()

db.commit()

db.close()

不关闭数据库连接,就无法在MySQL端进行数据库的查询等操作,相当于数据库被占用。

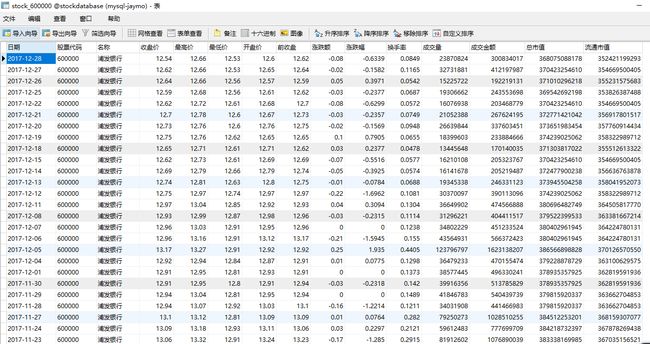

4.MySQL数据库查询

db = pymysql.connect('localhost', name, password, 'stockDataBase', charset='utf8')

cursor = db.cursor()

#查询数据库并打印内容

cursor.execute('select * from stock_600000')

results = cursor.fetchall()

for row in results:

print(row)

#关闭

cursor.close()

db.commit()

db.close()

以上逐条打印,会凌乱到死的。也可以在MySQL端查看,先选中数据库:use stockDatabase;,然后查询:select * from stock_600000;

5.完整代码

实际上,整个事情完成了两个相对独立的过程:1.爬虫获取网页股票数据并保存到本地文件;2.将本地文件数据储存到MySQL数据库。并没有直接的考虑把从网页上抓取到的数据实时(或者通过一个临时文件)扔进数据库,跳过本地数据文件这个过程。这里只是尝试着去实现了一下这件事情,代码没有做任何的优化考虑。本身不实际去使用,只是乐趣而已,差不多先这样。哈哈~~

#导入需要使用到的模块

import urllib

import re

import pandas as pd

import pymysql

import os

#爬虫抓取网页函数

def getHtml(url):

html = urllib.request.urlopen(url).read()

html = html.decode('gbk')

return html

#抓取网页股票代码函数

def getStackCode(html):

s = r''

pat = re.compile(s)

code = pat.findall(html)

return code

#########################开始干活############################

Url = 'http://quote.eastmoney.com/stocklist.html'#东方财富网股票数据连接地址

filepath = 'F:\\data\\'#定义数据文件保存路径

#实施抓取

code = getStackCode(getHtml(Url))

#获取所有股票代码(以6开头的,应该是沪市数据)集合

CodeList = []

for item in code:

if item[0]=='6':

CodeList.append(item)

#抓取数据并保存到本地csv文件

for code in CodeList:

print('正在获取股票%s数据'%code)

url = 'http://quotes.money.163.com/service/chddata.html?code=0'+code+\

'&end=20171228&fields=TCLOSE;HIGH;LOW;TOPEN;LCLOSE;CHG;PCHG;TURNOVER;VOTURNOVER;VATURNOVER;TCAP;MCAP'

urllib.request.urlretrieve(url, filepath+code+'.csv')

##########################将股票数据存入数据库###########################

#数据库名称和密码

name = 'xxxx'

password = 'xxxx' #替换为自己的账户名和密码

#建立本地数据库连接(需要先开启数据库服务)

db = pymysql.connect('localhost', name, password, charset='utf8')

cursor = db.cursor()

#创建数据库stockDataBase

sqlSentence1 = "create database stockDataBase"

cursor.execute(sqlSentence1)#选择使用当前数据库

sqlSentence2 = "use stockDataBase;"

cursor.execute(sqlSentence2)

#获取本地文件列表

fileList = os.listdir(filepath)

#依次对每个数据文件进行存储

for fileName in fileList:

data = pd.read_csv(filepath+fileName, encoding="gbk")

#创建数据表,如果数据表已经存在,会跳过继续执行下面的步骤print('创建数据表stock_%s'% fileName[0:6])

sqlSentence3 = "create table stock_%s" % fileName[0:6] + "(日期 date, 股票代码 VARCHAR(10), 名称 VARCHAR(10),\

收盘价 float, 最高价 float, 最低价 float, 开盘价 float, 前收盘 float, 涨跌额 float, \

涨跌幅 float, 换手率 float, 成交量 bigint, 成交金额 bigint, 总市值 bigint, 流通市值 bigint)"

cursor.execute(sqlSentence3)

except:

print('数据表已存在!')

#迭代读取表中每行数据,依次存储(整表存储还没尝试过)

print('正在存储stock_%s'% fileName[0:6])

length = len(data)

for i in range(0, length):

record = tuple(data.loc[i])

#插入数据语句

try:

sqlSentence4 = "insert into stock_%s" % fileName[0:6] + "(日期, 股票代码, 名称, 收盘价, 最高价, 最低价, 开盘价, 前收盘, 涨跌额, 涨跌幅, 换手率, \

成交量, 成交金额, 总市值, 流通市值) values ('%s',%s','%s',%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s,%s)" % record

#获取的表中数据很乱,包含缺失值、Nnone、none等,插入数据库需要处理成空值

sqlSentence4 = sqlSentence4.replace('nan','null').replace('None','null').replace('none','null')

cursor.execute(sqlSentence4)

except:

#如果以上插入过程出错,跳过这条数据记录,继续往下进行

break

#关闭游标,提交,关闭数据库连接

cursor.close()

db.commit()

db.close()

###########################查询刚才操作的成果##################################

#重新建立数据库连接

db = pymysql.connect('localhost', name, password, 'stockDataBase', charset='utf8)

cursor = db.cursor()

#查询数据库并打印内容

cursor.execute('select * from stock_600000')

results = cursor.fetchall()

for row in results:

print(row)

#关闭

cursor.close()

db.commit()

db.close()