年后回来上班的第一天,同事突然神秘兮兮的对我说:你未来肯定会秃顶!

我摸了摸满头浓密的秀发,一脸懵比的看着他。

同事诡异一笑,掏出手机打开了一篇文章,只见标题写着「人工智能看脸识病」:“咱是用 AI 看出了你有秃顶的遗传病,除了看脸识病,AI 还能看出你的性取向,以及你是否会成为犯罪分子,想不到吧!”

哈!还有这种操作?这不是抢看相大师的饭碗吗?

- 1 - AI看脸识病

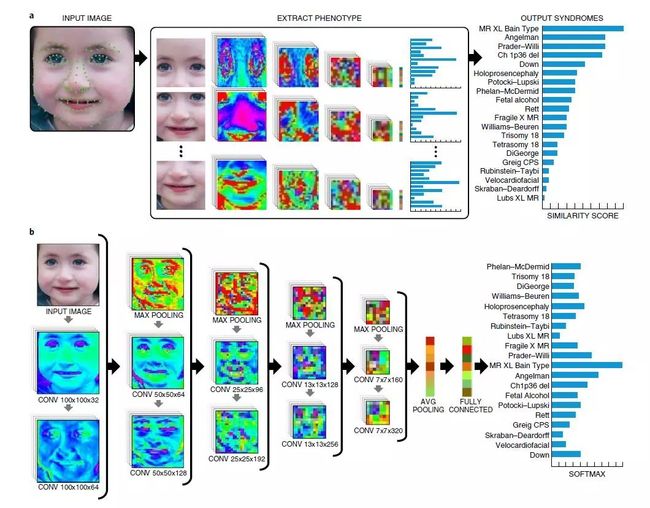

前些天,英国《自然·医学》杂志发表了一篇论文,称一款人工智能在接受上万张真实患者面部图像训练后,能够以高准确率识别罕见的遗传综合征。

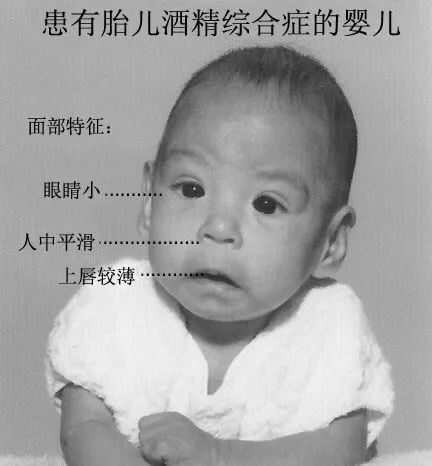

据悉,全球约有 8% 的人患有遗传疾病(照这个比例算,中国有一亿多人),其中许多可以通过面部特征识别。像患有胎儿酒精综合征的婴儿,面部特征就体现在眼睛小、人中平滑、上唇较薄。

这眼睛真的小么.......

这不就和中医「望闻问切」中的「望」是一个道理么~

因此,美国 FDNA 分析技术公司研究人员亚龙-古罗维奇及其同事,使用了包含 200 多种遗传综合征数据库中的 1.7 万张患者面部图像,训练出了一种名为 DeepGestalt 的深度学习算法,它能够分辨出数百种遗传综合征的面部表征。

之后的测试中,该算法在 502 张不同的图像上,识别出正确综合征的准确率达到了 91%,远远超出临床专家在另外三个实验中的表现。

亚龙-古罗维奇认为,他们的工作提高了标准化描述遗传疾病特征的能力,为未来的研究和应用打开了大门,也有助于新型遗传疾病的鉴定。

嗯,他扫我一眼就知道我有穷病......

然而,该算法也有一个很严重的问题,FDNA 最新研究的作者指出,由于人脸图像是敏感且容易获取的数据,若使用不慎,看脸识病技术将引发歧视等伦理问题。

打个比方,有人拿着你的照片,用这个算法测出你可能患有XX遗传病,同时这个人是个大嘴巴,喜欢到处乱传,那你身边的同事、朋友会怎么想?会不会有人用别样的眼光看待你?

如果该遗传病还具有一定的传染性,那就更可怕了,恐怕你马上就会被所有人疏远,正常的工作、生活都将无法进行下去。

就算咱去医院检查后,发现根本没有这个病,可造谣一张嘴,辟谣跑断腿,想完全澄清是不可能的。

- 2 - 「AI看脸」引发的争议

其实,这不是「AI看脸」第一次引起争议了,之前就有过「AI看脸识性取向」和「AI看脸识罪犯」等前车之鉴。

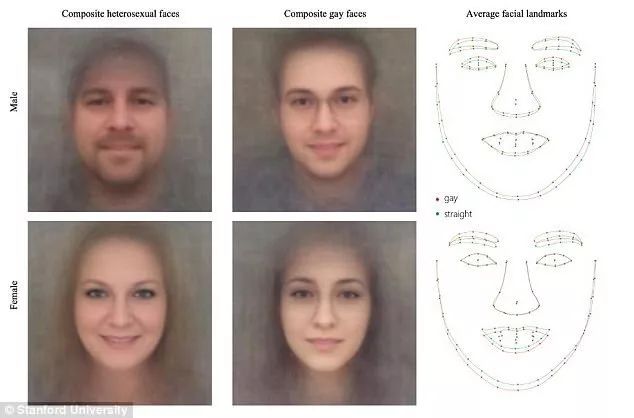

去年,斯坦福大学心理学家 Michal Kosinski,通过 AI 研究从交友网站的公开信息中收集到的 35326 张照片,找到了同性恋人群与异性恋人群之间的面部差异:

上排左侧为直男,右侧为gay

下排左侧为直女,右侧为les

之后的测试中,在没有穿搭风格、人物动作等因素影响的情况下,就单一面部信息而言,AI 识别男女性取向的准确率分别达到了 81% 和 71%......如果识别的是泰国人妖呢~

但是,这项研究却遭到了来自学界同行和大众的各种质疑。首先,性取向是一个人的隐私,AI 强行根据你的脸算出你的性取向,本质上冒犯了当事人对自己身份的保有权。

其次,对一些反同国家(如中东某些国家)的人来说,这种技术甚至会直接威胁到当事人的生命安全。再说了,一个人性取向并非固定的,一生中会发生很多浮动变化。

所以,有部分媒体指责,这项研究显示了数据时代的黑暗面:除了将一个已经很脆弱的人群暴露在新型的系统化虐待之下,还直接打击了我们的平等观念:不能以貌取人、也不能通过一两张照片这么简单的东西来判断性取向这样的隐私。

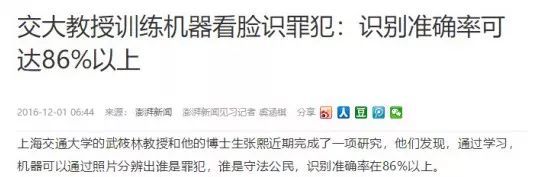

至于「AI看脸识罪犯」,这是在2016年,由上海交通大学教授武筱林提出,他训练出了可以看脸识罪犯的人工智能系统,准确率达到 86% 以上。

显然,这项研究引起的争议要远远大于前两者,因为对于「审判」这种人命关天的事情来说,86% 的准确率根本无法让人信服,更别提这项技术一旦实施,可能造成极其严重的潜在后果。

很多业内专家都表示,建议武教授撤稿,并且上传一封公告,为不恰当的研究方法致歉。

- 3 - 被滥用的可怕后果

为什么「AI看脸」会引起如此大的争议?借用一位网友的评论:它是用一种「科学」的方式,简单粗暴的给人们贴上了标签。

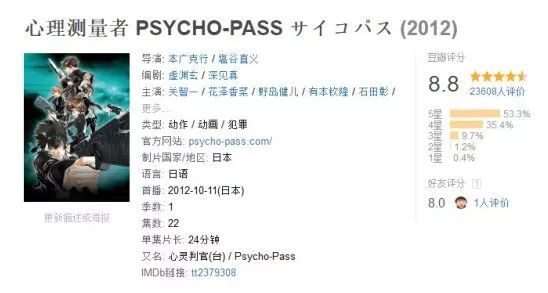

2012年,岛国出了一部叫《心理测量者 PSYCHO-PASS》的动漫,它在豆瓣上的评分很高:

这部动漫描述了一个名为「西比拉」的系统所主宰的世界,西比拉系统融合了人脑与人工智能的优势,智能已经发展到常人无法理解的地步;

它能量化人类的心理活动,根据所收集到的数据,「西比拉」能够判断一个人最理想的工作、最适合的恋人甚至是犯罪意图。

被系统圈养的人类,渐渐失去自己的判断力。

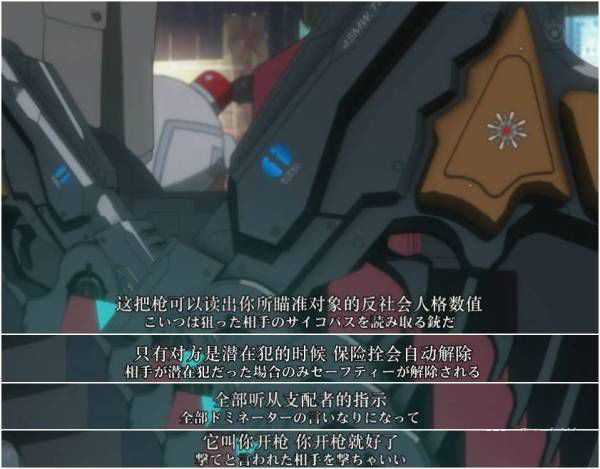

武教授研究出的「AI看脸识罪犯」在这里被发展到了巅峰,《心理测量者 PSYCHO-PASS》中,系统监测每个人的「犯罪指数」,判断一个人有罪,不需要进行司法流程,只凭系统判断,警察就能够击毙犯罪者!

听上去是不是很恐怖,其实,如果「AI看脸」技术被滥用的话,这样的社会离我们并不遥远。

如果扫一下脸,就能看出你的性取向、犯罪指数、遗传病,那么,是不是也可能扫一下脸,就能判断出你适不适合读清华北大?扫一下脸,是不是就能判断出你是不是渣男 / 女?扫一下脸,是不是就能判断出你未来会不会成功?

有没有感觉脊背发寒?这些还是「善」的应用,如果这种技术掌握在「不对」的人身上......骗子是不是扫一下脸,就能看出哪个人最容易上当受骗,而且还很有钱?商家是不是扫一下脸,就了解了每个人心理的承受价位,进而更精准的「大数据杀熟」?

想得更远一点:三岁的小孩是不是扫一下脸,就能估算出这个孩子是否具备「培养价值」?

最终,我们都要被机器所定义。

更可怕的是,实现这种技术并不难,而且背后还有巨大的操作空间。比如宗教极端主义者也可以搞一套系统,扫脸检测你是否虔诚,如果不是的话.......

细思极恐。

觉得AI看脸不靠谱的

请点赞

为了帮助大家让学习变得轻松、高效,给大家免费分享一大批资料,让AI越来越普及。在这里给大家推荐一个人工智能Python学习交流群:705673780欢迎大家进群交流讨论,学习交流,共同进步。

当真正开始学习的时候难免不知道从哪入手,导致效率低下影响继续学习的信心。

但最重要的是不知道哪些技术需要重点掌握,学习时频繁踩坑,最终浪费大量时间,所以拥有有效资源还是很有必要的。