图神经网络的基本结构及演变过程

图神经网络的基本结构及演变过程

引言

2019年伊始,一篇年度十大科技展望吸引了广泛的关注,其中一个趋势与本章的主题相关:“超大规模图神经网络系统将赋予机器常识”。而这已经不是图神经网络第一次被放到深度学习技术的头条位置了。2018年,DeepMind、谷歌大脑、MIT和爱丁堡大学的27名作者,对图神经网络及其推理能力进行了全面阐述 [1]。随后,图卷积网络(Graph Convolutional Network)、图神经网络(Graph Neural Network)、关系网络(Relation Network)、几何深度学习技术(Geometric Deep Learning)等关键词频频出现在各大顶级机器学习、数据挖掘会议上。

图神经网络(GNN)引起广泛关注的原因可以暂归为两点。首先,图作为一种更为常见的数据结构,目前却没有与之相对应的通用的神经网络模型。而GNN可以视作CNN在图(Graph)上的扩展,将卷积的思想从欧几里得域迁移到非欧几里得域 [2]。第二个原因是,图神经网络具备的“推理能力”,而这恰恰是基于传统神经网络的人工智能系统所欠缺的能力。从一定程度上讲,图神经网络是符号主义(Symbolicism)和非符号主义(Non-symbolicism)相结合的产物(Neural-symbolic System),将规则、知识引入神经网络,使得神经网络具备了可解释性和推理能力。

事实上,图神经网络并不是近一年新诞生的概念和技术。早在2005年这一概念即被提出 [3]。随后,计算机科学领域、理论物理复杂网络领域的研究者在图(Graph)的空间域(Spatial Domain)和频谱域(Spectural Domain)上分别提出了不同形式的图神经网络,并最终在2017年实现了空间域模型和频谱域模型的融合。自此,深度学习技术和图神经网络迎来了广泛关注。图神经网络的核心在于如何类比CNN在网格状数据上的卷积操作,而定义图上的卷积操作?在本讲中,我们将从图神经网络的基本结构出发,逐步认识GNN的独特之处。

问题

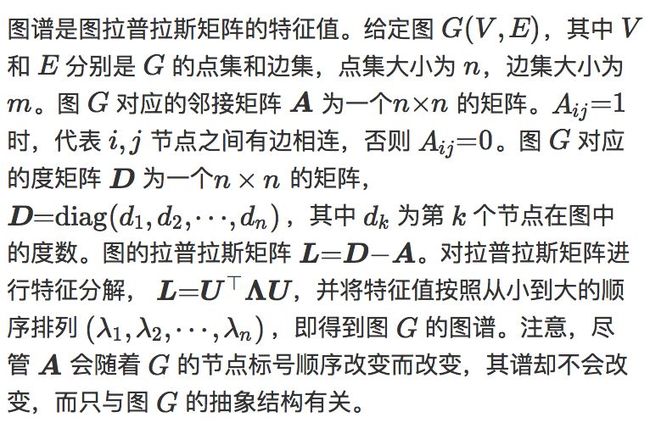

图谱(Graph Spectrum)是什么?

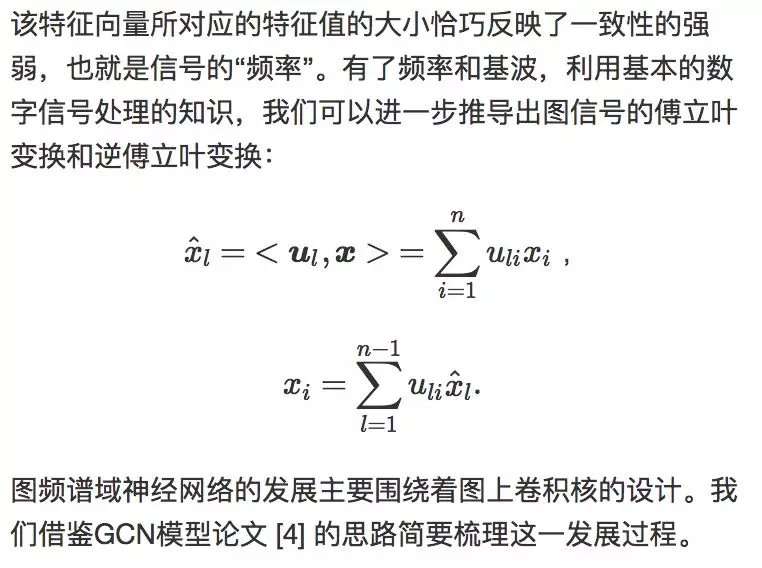

图傅立叶变换是什么?

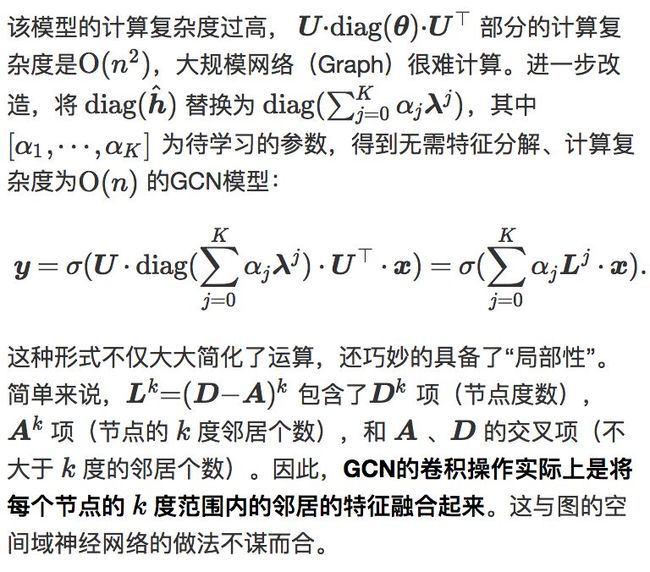

频谱域的图卷积网络是什么?

分析与解答

Figure 1: 特征向量的可视化

[1] BATTAGLIA P W, HAMRICK J B, BAPST V, 等. Relational inductive biases, deep learning, and graph networks[J]. arXiv preprint arXiv:1806.01261, 2018.

[2] BRONSTEIN M M, BRUNA J, LECUN Y, 等. Geometric deep learning: going beyond euclidean data[J]. IEEE Signal Processing Magazine, IEEE, 2017, 34(4): 18–42.

[3] GORI M, MONFARDINI G, SCARSELLI F. A new model for learning in graph domains[C]//Proceedings. 2005 IEEE International Joint Conference on Neural Networks, 2005. IEEE, 2005, 2: 729–734.

[4] DEFFERRARD M, BRESSON X, VANDERGHEYNST P. Convolutional neural networks on graphs with fast localized spectral filtering[C]//Advances in neural information processing systems. 2016: 3844–3852.

from:https://mp.weixin.qq.com/s/ME8OyJGNk0pF9dGQ0RYUFw