标签: 信息检索

一、采集任务

1.任务描述

采集四川大学公共管理学院128位教师信息(结合教师详情页信息)

整体思路:先抓取导航页教师信息,然后跳转到详情页,获取补充信息。

2.数据来源

http://ggglxy.scu.edu.cn/index.php?c=article&a=type&tid=18&page_1=&page_1_page=1

二、网页结构分析

1.导航页

可抓取教师姓名、教师职称、教师所在系、教师邮箱信息、教师url(指向详情页)

分页的实现可以通过两种方式实现:

1.观察网页url规律(http://ggglxy.scu.edu.cn/index.php?c=article&a=type&tid=18&page_1_page=)

2.直接获取下一页的链接(这里采用第二种方式)

2.详情页

根据导航页的教师url跳转到详情页,可进一步抓取教师简介、教师研究成果、教师获奖、教师人才培养、教师科研项目信息

三、数据采集

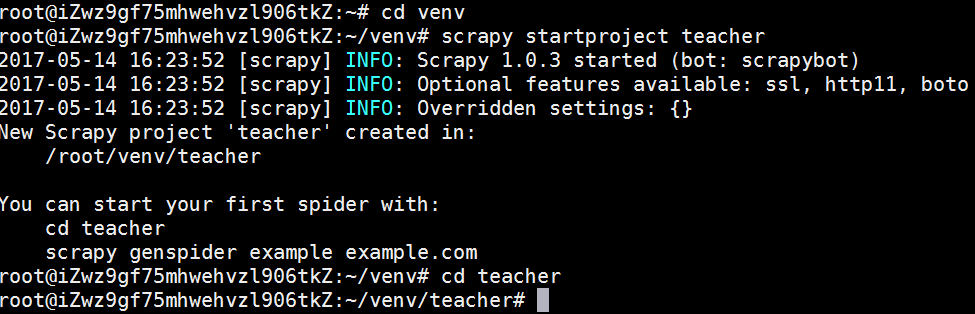

1. 创建一个Scrapy项目

scrapy startproject teacher

2.定义提取的Item

class TeacherItem(scrapy.Item):

# 教师名字

teacher_name = scrapy.Field()

# 教师职称

teacher_zhicheng = scrapy.Field()

# 教师院系

teacher_department = scrapy.Field()

# 教师邮箱

teacher_email = scrapy.Field()

# 教师简介

teacher_description = scrapy.Field()

# 教师研究成果

teacher_finding = scrapy.Field()

# 教师获奖

teacher_award = scrapy.Field()

# 教师科研项目

teacher_program = scrapy.Field()

# 教师人才培养

teacher_education = scrapy.Field()

# 教师详细信息地址

teacher_url = scrapy.Field()

pass

3. 编写爬取网站的 spider 并提取 Item

3.1编写初始spider

tips:分析网页结构,使用递归、循环,抓取一级网页128位教师信息

import scrapy

from teacher.items import TeacherItem

class TeacherSpider(scrapy.Spider):

name = "teacher"

start_urls = []

for pn in range(1,17):

url='http://ggglxy.scu.edu.cn/index.php?c=article&a=type&tid=18&page_1=&page_1_page='+ str(pn)

start_urls.append(url)

def parse(self, response):

for teacher in response.xpath('//div[@class="r fr"]'):

yield {

'teacher_name': teacher.xpath('h3[@class="mb10"]/text()').extract_first(),

'teacher_zhicheng': teacher.xpath('p[@class="color_main f14"]/text()').extract_first(),

'teacher_department': teacher.xpath('//div[@class="desc"]/p[1]/text()').extract_first(),

'teacher_email': teacher.xpath('//div[@class="desc"]/p[last()]/text()').extract_first(),

}

3.2爬取并存储教师信息

scrapy crawl teacher -o teacher1.json

4.修改spider

tips:将相对链接转换成绝对链接,使用urljoin方法;获取div标签下所用文本信息,使用//方式;传递参数,可采用meta。

import scrapy

import hashlib

from scrapy.selector import Selector

from teacher.items import TeacherItem

class TeacherSpider(scrapy.Spider):

name="teacher"

start_urls=[

'http://ggglxy.scu.edu.cn/index.php?c=article&a=type&tid=18&page_1_page=1',

]

def parse(self,response):

for teacher in response.xpath("//ul[@class='teachers_ul mt20 cf']/li"):

item=TeacherItem()

item['teacher_name']=teacher.xpath("div[@class='r fr']/h3/text()").extract_first()

item['teacher_zhicheng']=teacher.xpath("div[@class='r fr']/p/text()").extract_first()

item['teacher_email']=teacher.xpath("div[@class='r fr']/div[@class='desc']/p[2]/text()").extract_first()

item['teacher_department']=teacher.xpath("div[@class='r fr']/div[@class='desc']/p[1]/text()").extract_first()

href=teacher.xpath("div[@class='l fl']/a/@href").extract_first()

yield scrapy.Request(response.urljoin(href), meta={'item': item}, callback=self.parse_teacher_info)

next_page=response.xpath("//div[@class='pager cf tc pt10 pb10 mobile_dn']/li[last()-1]/a/@href").extract_first()

last_page=response.xpath("//div[@class='pager cf tc pt10 pb10 mobile_dn']/li[last()]/a/@href").extract_first()

if last_page:

next_page="http://ggglxy.scu.edu.cn/"+next_page

yield scrapy.http.Request(next_page,callback=self.parse)

def parse_teacher_info(self,response):

item=response.meta['item']

item['teacher_description'] = response.xpath("//div[@class='desc']/text()").extract()

item['teacher_finding'] = "".join(response.xpath('/html/body/div[3]/div[2]/div/div[2]//text()').extract())

item['teacher_award'] = "".join (response.xpath('/html/body/div[3]/div[2]/div/div[3]//text()').extract())

item['teacher_program'] ="".join (response.xpath('/html/body/div[3]/div[2]/div/div[4]//text()').extract())

item['teacher_education'] = "".join (response.xpath('/html/body/div[3]/div[2]/div/div[5]//text()').extract())

yield item```

###5.抓取并存储最终教师信息。

可保存为json,xml等格式,为阅读方便,这里采用csv格式。

scrapy crawl teacher2 -o teacher.json

scrapy crawl teacher2 -o teacher.xml

##问题小结

##1 meta的使用

为避免数据的重复爬取和保证数据一一对应,这里采用meta方法。首先:获取导航页的信息,并且通过保存到meta中,利用request将保存的值(整个实例)全部传到详情页,然后,在详情页中直接调用,并输出

##2 图片爬取

现阶段思考了爬取图片,需要import hashlib,思路大概是先获取所有图片地址,然后存储所有图片本地地址和图片名(暂未实现)

##3 选择器的使用

from scrapy.selector import Selector(在官方文档中出现,不确定是否默认支持,测试了发现应该是默认支持的,这句话可以不写)

##4 大文本多个段落的文字合并

直接用"".join(response.xpath('路径//text()').extract())方法

##5 csv导出

直接生成CSV文件后,先使用记事本打开,另存成ANSI编码,可解决Excel打开乱码的问题

阅读材料:

[scrapy官方文档](http://scrapy-chs.readthedocs.io/zh_CN/0.24/intro/tutorial.html)