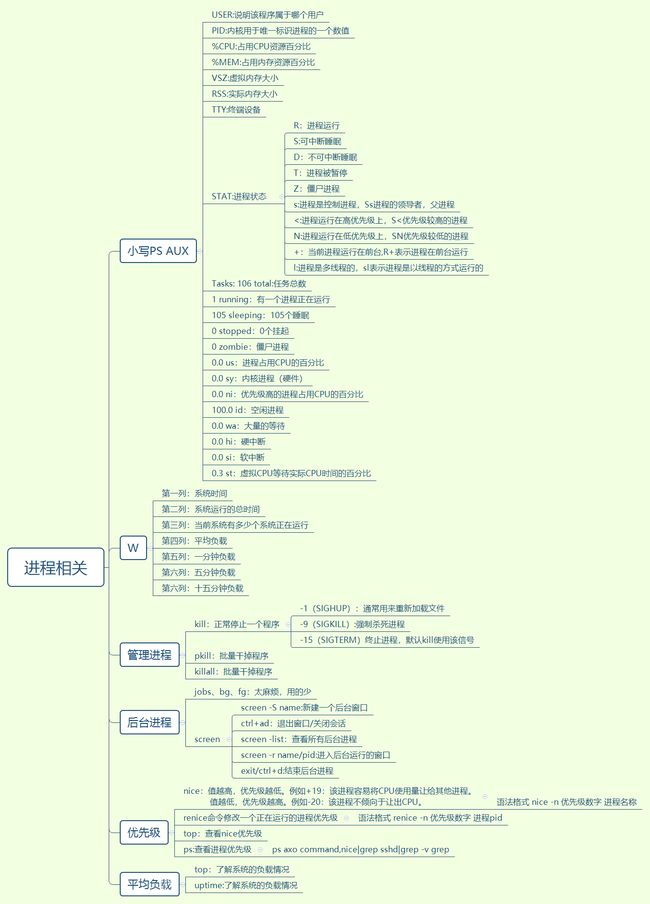

1.管理进程(kill、killall、pkill)

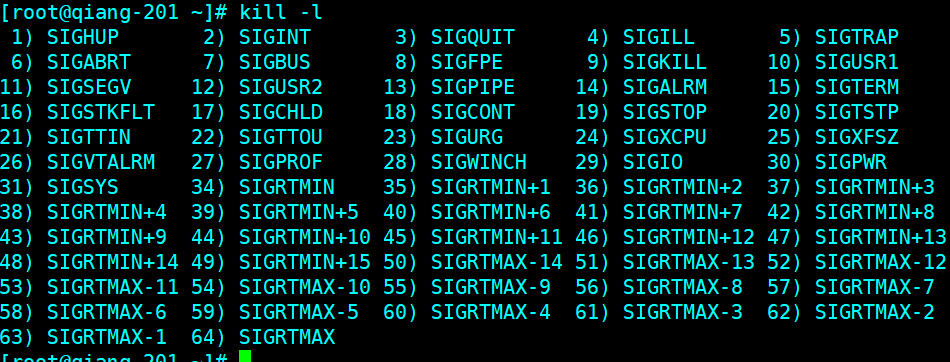

使用kill -l列出当前系统所支持的信号

虽然Linux支持信号很多,常用的只有三个

| 数字编号 | 信号含义 | 信号翻译 |

|---|---|---|

| 1 | SIGHUP | 通常用来重新加载配置文件 |

| 9 | SIGKILL | 强制杀死进程 |

| 15 | SIGTERM | 终止进程,默认kill使用该信号 |

1.我们使用kill命令杀死指定PID的进程。

例1.给 vsftpd 进程发送信号 1,15

[root@qiang-201 ~]# yum -y install vsftpd

[root@qiang-201 ~]# systemctl start vsftpd

[root@qiang-201 ~]# ps aux|grep vsftpd

例2.发送重载信号,例如 vsftpd 的配置文件发生改变,希望重新加载

[root@qiang-201 ~]# kill -1 9160

例3.发送停止信号,当然vsftpd 服务有停止的脚本 systemctl stop vsftpd

[root@qiang-201 ~]# kill 9160

例4.发送强制停止信号,当无法停止服务时,可强制终止信号

[root@qiang-201 ~]# kill -9 9160

2.Linux系统中的killall、pkill命令用于杀死指定名字的进程。我们可以使用kill命令杀死指定进程PID的进程,如果要找到我们需要杀死的进程,我们还需要在之前使用ps等命令再配合grep来查找进程,而killall、pkill把这两个过程合二为一,是一个很好用的命令。

例1、通过服务名称杀掉进程

[root@qiang-201 ~]# pkill nginx

[root@qiang-201 ~]# killall nginx

例2、使用pkill踢出从远程登录到本机的用户,终止pts/0上所有进程, 并且bash也结束(用户被强制退出)

[root@qiang-201 ~]# pkill -9 -t pts/0

| 命令 | 解释 |

|---|---|

| kill PID | 正常停止一个程序 |

| kill -1 PID | 强制杀死程序(对于MySQL这类;有状态的慎用) |

| pkill name | 批量干掉程序 |

| killall name | 批量干掉程序 |

2.管理后台进程

1.什么是后台进程

通常进程都会在终端前台运行,一旦关闭终端,进程也会随着结束,那么此时我们就希望进程能在后台运行,就是将在前台运行的进程放入后台运行,这样及时我们关闭了终端也不影响进程的正常运行。

2.我们为什么要将进程放入后台运行

比如:我们此前在国内服务器往国外服务器传输大文件时,由于网络的问题需要传输很久,如果在传输的过程中出现网络抖动或者不小心关闭了终端则会导致传输失败,如果能将传输的进程放入后台,是不是就能解决此类问题了。

3.使用什么工具将进程放入后台

早期的时候大家都选择使用&符号将进程放入后台,然后在使用jobs、bg、fg等方式查看进程状态,但太麻烦了。也不直观,所以我们推荐使用screen。

| 命令 | 解释 |

|---|---|

| screen -S name | 新建一个后台窗口 |

| Ctrl+ad | 退出窗口/关闭会话 |

| screen -list | 查看所有后台进程 |

| screen -r name/pid | 进入后台运行的窗口 |

| exit/ctrl+d | 结束后台进程 |

1.安装

[root@qiang-201 ~]# yum install screen -y

2.开启一个screen窗口,指定名称

[root@qiang-201 ~]# screen -S wget_mysql

3.在screen窗口中执行任务即可

4.平滑的退出screen,但不会终止screen中的任务。注意: 如果使用exit 才算真的关闭screen窗口

ctrl+a+d

5.查看当前正在运行的screen有哪些

[root@qiang-201 ~]# screen -list

There is a screen on:

22058.wget_mysql (Detached)

1 Socket in /var/run/screen/S-root.

6.进入正在运行的screen

[root@qiang-201 ~]# screen -r wget_mysql

[root@qiang-201 ~]# screen -r 22058

3.进程优先级设置(nice、renice)

什么是优先级

优先级是指优先享受资源,比如排队买票时:军人优先、老人优先。等等

系统中如何给进程配置优先级

- nice值越高:表示优先级越低,例如+19,该进程容易将CPU使用量让给其他进程。

- nice值越低:表示优先级越高,例如-20,该进程不倾向于让出CPU。

| 命令 | 解释 |

|---|---|

| nice -n number | 启动一个程序为其设定优先级 |

| renice | 调整已经启动过的进程优先级 |

1.nice指定程序的优先级。语法格式 nice -n 优先级数字 进程名称

[root@qiang-201 ~]# nice -n -5 vim &

[1] 98417

2.renice命令修改一个正在运行的进程优先级。语法格式 renice -n 优先级数字 进程pid

1.查看sshd进程当前的优先级状态

[root@qiang-201 ~]# ps axo pid,command,nice |grep 折叠shd

70840 sshd: root@pts/2 0

98002 /usr/sbin/sshd -D 0

2.调整sshd主进程的优先级

[root@qiang-201 ~]# renice -n -20 98002

98002 (process ID) old priority 0, new priority -20

3.调整之后记得退出终端

[root@qiang-201 ~]# ps axo pid,command,nice |grep 折叠shd

70840 sshd: root@pts/2 0

98002 /usr/sbin/sshd -D -20

[root@qiang-201 ~]# exit

4.当再次登陆sshd服务,会由主进程fork子进程(那么子进程会继承主进程的优先级)

[root@qiang-201 ~]# ps axo pid,command,nice |grep 折叠shd

98002 /usr/sbin/sshd -D -20

98122 sshd: root@pts/0 -20

3.使用top可以查看nice优先级

| NI的值 | PR的值 |

|---|---|

| 0 | 20 |

| -20 | 0 |

| 10 | 30 |

| 19 | 39 |

4.使用ps查看进程优先级

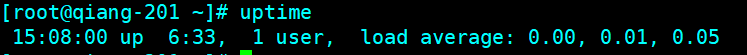

4.平均负载

可以简单的理解为:平均负载其实就是单位时间内的活跃进程数。(处于运行+处于等待运行+不可中断的进程)

1.如何查看平均负载:

执行 top 或者 uptime 命令,来了解系统的负载情况。

- 三个数值都需要关注,综合评估

- CPU使用率过高

- CPU的IO等待过多造成过高

- 大量使用CPU进程造成过高

2.平均负载为多少时合理

最理想的状态是每个 CPU 上都刚好运行着一个进程,这样每个 CPU 都得到了充分利用。所以在评判平均负载时,首先你要知道系统有几个 CPU,这可以通过 top 命令获取,或grep 'model name' /proc/cpuinfo

例:假设现在在 4、2、1核的CPU上,如果平均负载为 2 时,意味着什么呢?

1.在4 个 CPU 的系统上,意味着 CPU 有 50% 的空闲。

2.在2 个 CPU 的系统上,意味着所有的 CPU 都刚好被完全占用。

3.而1 个 CPU 的系统上,则意味着有一半的进程竞争不到 CPU。

3.那么在实际生产环境中,平均负载多高时,需要我们重点关注呢?

当平均负载高于 CPU 数量 70% 的时候,你就应该分析排查负载高的问题了。一旦负载过高,就可能导致进程响应变慢,进而影响服务的正常功能。

但 70% 这个数字并不是绝对的,最推荐的方法,还是把系统的平均负载监控起来,然后根据更多的历史数据,判断负载的变化趋势。当发现负载有明显升高趋势时,比如说负载翻倍了,你再去做分析和调查。

4.平均负载与 CPU 使用率有什么关系

在实际工作中,我们经常容易把平均负载和 CPU 使用率混淆,所以在这里,我也做一个区分。可能你会疑惑,既然平均负载代表的是活跃进程数,那平均负载高了,不就意味着 CPU 使用率高吗?我们还是要回到平均负载的含义上来,平均负载是指单位时间内,处于可运行状态和不可中断状态的进程数。所以,它不仅包括了正在使用 CPU 的进程,还包括等待 CPU 和等待 I/O 的进程。

*而 CPU 使用率,是单位时间内 CPU 繁忙情况的统计,跟平均负载并不一定完全对应。比如:

- CPU 密集型进程,使用大量 CPU 会导致平均负载升高,此时这两者是一致的;

- I/O 密集型进程,等待 I/O 也会导致平均负载升高,但 CPU 使用率不一定很高;

- 大量等待 CPU 的进程调度也会导致平均负载升高,此时的 CPU 使用率也会比较高。*

5.平均负载案例分析实战

下面,我们以三个示例分别来看这三种情况,并用 stress、mpstat、pidstat 等工具,找出平均负载升高的根源。

stress 是 Linux 系统压力测试工具,这里我们用作异常进程模拟平均负载升高的场景。

mpstat 是多核 CPU 性能分析工具,用来实时查看每个 CPU 的性能指标,以及所有 CPU 的平均指标。

pidstat 是一个常用的进程性能分析工具,用来实时查看进程的 CPU、内存、I/O 以及上下文切换等性能指标。

如果出现无法使用mpstat、pidstat命令查看%wait指标建议更新下软件包

wget http://pagesperso-orange.fr/sebastien.godard/sysstat-11.7.3-1.x86_64.rpm

rpm -Uvh sysstat-11.7.3-1.x86_64.rpm

场景一:CPU 密集型进程

1.首先,我们在第一个终端运行 stress 命令,模拟一个 CPU 使用率 100% 的场景:

[root@qiang-201 ~]# stress --cpu 1 --timeout 600

2.接着,在第二个终端运行 uptime 查看平均负载的变化情况

使用watch -d 参数表示高亮显示变化的区域(注意负载会持续升高)

[root@qiang-201 ~]# watch -d uptime

17:27:44 up 2 days, 3:11, 3 users, load average: 1.10, 0.30, 0.17

3.最后,在第三个终端运行 mpstat 查看 CPU 使用率的变化情况

-P ALL 表示监控所有 CPU,后面数字 5 表示间隔 5 秒后输出一组数据

[root@qiang-201 ~]# mpstat -P ALL 5

Linux 3.10.0-957.1.3.el7.x86_64 (m01) 2019年04月29日 _x86_64_ (1 CPU)

17时32分03秒 CPU %usr %nice %sys %iowait %irq %soft %steal %guest %gnice %idle

17时32分08秒 all 99.80 0.00 0.20 0.00 0.00 0.00 0.00 0.00 0.00 0.00

17时32分08秒 0 99.80 0.00 0.20 0.00 0.00 0.00 0.00 0.00 0.00 0.00

单核CPU所以只有一个all和0

4.从终端二中可以看到,1 分钟的平均负载会慢慢增加到 1.00,而从终端三中还可以看到,正好有一个 CPU 的使用率为 100%,但它

的 iowait 只有 0。这说明,平均负载的升高正是由于 CPU 使用率为 100% 。那么,到底是哪个进程导致了 CPU 使用率为 100%

呢?可以使用 pidstat 来查询

间隔 5 秒后输出一组数据

[root@qiang-201 ~]# pidstat -u 5 1

Linux 3.10.0-957.1.3.el7.x86_64 (m01) 2019年04月29日 _x86_64_(1 CPU)

17时33分21秒 UID PID %usr %system %guest %CPU CPU Command

17时33分26秒 0 110019 98.80 0.00 0.00 98.80 0 stress

从这里可以明显看到,stress 进程的 CPU 使用率为 100%。

场景二:I/O 密集型进程

1.首先还是运行 stress 命令,但这次模拟 I/O 压力,即不停地执行 sync

[root@qiang-201 ~]# stress --io 1 --timeout 600s

2.然后在第二个终端运行 uptime 查看平均负载的变化情况:

[root@qiang-201 ~]# watch -d uptime

18:43:51 up 2 days, 4:27, 3 users, load average: 1.12, 0.65, 0.00

3.最后第三个终端运行 mpstat 查看 CPU 使用率的变化情况:

显示所有 CPU 的指标,并在间隔 5 秒输出一组数据

[root@qiang-201 ~]# mpstat -P ALL 5

Linux 3.10.0-693.2.2.el7.x86_64 (bgx.com) 2019年05月07日 _x86_64_ (1 CPU)

14时20分07秒 CPU %usr %nice %sys %iowait %irq %soft %steal %guest %gnice %idle

14时20分12秒 all 0.20 0.00 82.45 17.35 0.00 0.00 0.00 0.00 0.00 0.00

14时20分12秒 0 0.20 0.00 82.45 17.35 0.00 0.00 0.00 0.00 0.00 0.00

会发现cpu的与内核打交道的sys占用非常高

4.那么到底是哪个进程,导致 iowait 这么高呢?我们还是用 pidstat 来查询

间隔 5 秒后输出一组数据,-u 表示 CPU 指标

[root@qiang-201 ~]# pidstat -u 5 1

Linux 3.10.0-957.1.3.el7.x86_64 (m01) 2019年04月29日 _x86_64_(1 CPU)

18时29分37秒 UID PID %usr %system %guest %wait %CPU CPU Command

18时29分42秒 0 127259 32.60 0.20 0.00 67.20 32.80 0 stress

18时29分42秒 0 127261 4.60 28.20 0.00 67.20 32.80 0 stress

18时29分42秒 0 127262 4.20 28.60 0.00 67.20 32.80 0 stress

可以发现,还是 stress 进程导致的。

场景三:大量进程的场景

当系统中运行进程超出 CPU 运行能力时,就会出现等待 CPU 的进程。

1.首先,我们还是使用 stress,但这次模拟的是 4 个进程

[root@qiang-201 ~]# stress -c 4 --timeout 600

2.由于系统只有 1 个 CPU,明显比 4 个进程要少得多,因而,系统的 CPU 处于严重过载状态

[root@qiang-201 ~]# watch -d uptime

19:11:07 up 2 days, 4:45, 3 users, load average: 4.65, 2.65, 4.65

3.然后,再运行 pidstat 来看一下进程的情况:

间隔 5 秒后输出一组数据

[root@qiang-201 ~]# pidstat -u 5 1

平均时间: UID PID %usr %system %guest %wait %CPU CPU Command

平均时间: 0 130290 24.55 0.00 0.00 75.25 24.55 - stress

平均时间: 0 130291 24.95 0.00 0.00 75.25 24.95 - stress

平均时间: 0 130292 24.95 0.00 0.00 75.25 24.95 - stress

平均时间: 0 130293 24.75 0.00 0.00 74.65 24.75 - stress

可以看出,4 个进程在争抢 1 个 CPU,每个进程等待 CPU 的时间(也就是代码块中的 %wait 列)高达 75%。这些超出 CPU 计算能力

的进程,最终导致 CPU 过载。

分析完这三个案例,我再来归纳一下平均负载与CPU

平均负载提供了一个快速查看系统整体性能的手段,反映了整体的负载情况。但只看平均负载本身,我们并不能直接发现,到底是哪里出现了瓶颈。所以,在理解平均负载时,也要注意:

- 平均负载高有可能是 CPU 密集型进程导致的;

- 平均负载高并不一定代表 CPU 使用率高,还有可能是 I/O 更繁忙了;

- 当发现负载高的时候,你可以使用 mpstat、pidstat 等工具,辅助分析负载的来源