常识库与常识推理

常识库整理

Cyc

概述

始于1984年,由Douglas Lenat推动,旨在收集生活中常识知识并将其编码集成到一个全面的本体知识库。该知识库中包含了320万条人类定义的断言,涉及30万个概念,15000个谓词。这些资源都采取CycL语言来进行描述,该语言采取谓词代数描述,语法上与Lisp程序设计语言类似。

Cyc知识库中表示的知识一般形如“每棵树都是植物”,“植物最终都会死亡”。当提出“树是否会死亡”的问题时,推理引擎可以得到正确的结论,并回答该问题。

发布版本:2009年7月发布的OpenCyc 2.0版,包含了47000个概念、306000个事实,主要是分类断言,并不包含Cyc中的复杂规则。

评价:“人工智能历史上最有争议的项目”之一。该系统在深度和广度上都有待完善,且不便于初学者学习使用该系统。

资料

论文

详细介绍

ConceptNet

概述

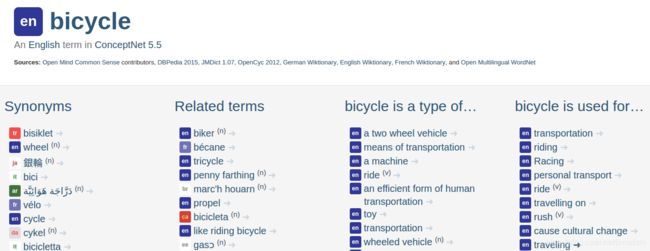

常识知识库。最早源于MIT媒体实验室的Open Mind Common Sense(OMCS)项目。OMCS项目是由著名AI专家Marvin Minsky于1999年创立。ConceptNet还有其他来源:Wiktionary、WordNet、OpenCyc、DBPedia、JMDict。以三元组形式的关系型知识构成。ConceptNet5版本已经包含有2800万关系描述。

与Cyc相比,ConceptNet采用了非形式化、更加接近自然语言的描述;与链接数据和谷歌知识图谱相比,ConceptNet比较侧重于词与词之间的关系。与WordNet相比,包含的关系类型多。ConceptNet完全免费开放,并支持多种语言。

以bicycle为例如下:

资料

论文全文

demo

论文代码

中文数据

Commonsense QA

基于ConceptNet开发的常识比赛

举例:Q:哪个最大? A1:山, A2:人, A3:老鼠。

特点:完全基于常识,几乎不考虑上下文的阅读理解。

ATOMIC

概述

原子因果常识图谱,包含870k条推理常识,专注于“if…then"关系的知识。

比如:事件“x防御了y的攻击”,我们能够马上推理出 x的动机是“保护自己”、 x这么做的先决条件是接受了一定的防身技巧、 x可能的特点是强壮勇敢。事件的结果可能是: x会感觉生气并报警、 y可能会觉得害怕并想要逃走。

ATOMIC:An Atlas of Machine Commonsense for If-Then Reasoning

Social IQA

第一个面向社会情况常识推理的大规模基准,包含38000个覆盖日常情形中社交情感和智慧的多选题。(涵盖了关于在情境中描述人们的行为的各种类型的推断)

比如:Q:乔丹想告诉特雷西一个秘密,所以乔丹向特雷西靠近,为什么乔丹这么做?

A:为了保证别人听不到。B:乔丹喜欢特雷西。 C:乔丹想打特雷西。

Social IQA:Commonsense Reasoning about Social Interactions

SQuAD

该数据集包含 100k个(问题,原文,答案)三元组,原文来自于 536 篇维基百科文章,而问题和答案的构建主要是通过众包的方式,让标注人员提出最多 5 个基于文章内容的问题并提供正确答案,且答案出现在原文中。

特点: 仅需要阅读材料的上下文,不需要常识

SQuAD阅读理解模型总结

Cosmos QA

Cosmos QA是一个35.6K问题的大规模数据集,需要基于常识的阅读理解,被表述为多项选择题。 它着重于阅读人们日常叙事的不同线条之间的界限,询问有关事件的可能原因或影响的问题,这些事件需要推理超出上下文的确切范围。

特点:既需要上下文,同时需要常识的阅读理解数据集。

Cosmos QA:Machine reading comprehension with contextual commonsense reasoning

COMET

基于 ConceptNet 和 ATOMIC 自动常识知识构建模型

COMET:Commonsense Transformers for Automatic Knowledge Graph Construction

WIQA

第一个大规模测试程序文本推理的大型数据集。 WIQA包含为379个段落准备的40.7k问题。为了有效的创建问题,人们为这379个段落创建了2107个影响图(IGs),描述一个扰动如何正面或负面影响另一个。

举例:

事件:海洋侵蚀

过程:1)风在海洋中产生波浪

2)海浪冲刷到海滩上

3)海浪袭击了海滩上的岩石

4)岩石的微小部分折断了

5)岩石变小了

举例:给出一个关于海滩侵蚀的段落,暴风雨的天气会导致或多或少的侵蚀(或没有影响)吗?

WIQA:A dataset for ‘what if…’ reasoning over procedural text

PIQA

物理常识推理的任务以及相应的基准数据集。

举例:Q:如何用一个瓶子将蛋清和蛋白分开?A1:…。A2:…。

PIQA:Reasoning about physical commonsense in natural language

AI2

在常识库的构建上,艾伦人工智能研究所(Allen Institute for AI)作出了不同寻常的贡献。

关于常识推理的一点想法

查阅了几天相关的资料,感觉有一句话我深为认同:

我们能期待具有常识的软件能做什么?这是很难去定义的,因为它包含着许许多多的小片段,而所有的一切都很容易单独进行编程。例如,如果你躺在地上大喊“我受伤了”,常识会让我们呼叫急救服务……但有可能,苹果的Siri已经能够做到这一点。

但是,也正因为如此,机器若想真正具备认知智能,常识又是如此的重要。

衷心希望前赴后继的勇士们一点一点啃下这个硬骨头。奥利给!