图(Graph)上的傅里叶变换

图上的傅里叶变换

- 图上的傅里叶变换

- 为什么拉普拉斯矩阵的特征向量可以作为傅里叶变换的基

图上的傅里叶变换

定义Laplacian算子的目的是为了找到Fourier变换的基

传统的傅里叶变换FT:

F ( w ) = ∫ − ∞ + ∞ f ( t ) e − i w t d t F(w)=\int_{-\infty}^{+\infty} f(t) e^{-iwt}dt F(w)=∫−∞+∞f(t)e−iwtdt

从数学上看, e − i w t e^{-iwt} e−iwt 是拉普拉斯算子的特征函数, w w w 与特征值相关

A v = λ v Av=\lambda v Av=λv \quad 其中 A A A是一种变换, v v v是特征向量或特征函数(无穷维的向量), λ \lambda λ 是特征值

Δ e − i w t = ∂ 2 ∂ t 2 e − i w t = − w 2 e − i w t \Delta e^{-iwt} = \frac{\partial ^2}{\partial t^2} e^{-iwt}=-w^2e^{-iwt} Δe−iwt=∂t2∂2e−iwt=−w2e−iwt

当然 e − i w t e^{-iwt} e−iwt 就是变换 Δ \Delta Δ的特征函数, w w w和特征值密切相关。

处理Graph问题的时候,用到拉普拉斯矩阵(拉普拉斯矩阵就是离散拉普拉斯算子),自然就去找拉普拉斯矩阵的特征向量了。

- 拉普拉斯矩阵 == 离散拉普拉斯算子

- 拉普拉斯矩阵的特征向量 v v v == 拉普拉斯算子的 特征函数 e − i w t e^{-iwt} e−iwt

L L L 是拉普拉斯矩阵, v v v 是其特征向量,满足下式

L v = λ v Lv=\lambda v Lv=λv

离散积分是一种内积形式,定义Graph上的傅里叶变换为:

F ( λ l ) = f ^ ( λ l ) = ∑ i = 1 N f ( i ) u l ∗ ( i ) F(\lambda_l)= \hat{f}(\lambda_l) = \sum_{i=1}^N f(i) u_l^{*}(i) F(λl)=f^(λl)=i=1∑Nf(i)ul∗(i)

f f f 是Graph上的 N N N 维向量, f ( i ) f(i) f(i) 与Graph的顶点一一对应, u l ( i ) u_l(i) ul(i) 表示第 l l l 个特征向量的第 i i i 个分量。那么特征值(频率) λ l \lambda_l λl 下的, f f f 的Graph 傅里叶变换就是与 λ l \lambda_l λl 对应的特征向量 u l u_l ul 进行内积运算。

上述的内积运算是在复数空间中定义的,所以采用了 u l ∗ ( i ) u_l^*(i) ul∗(i) ,也就是特征向量 u l u_l ul 的共轭。

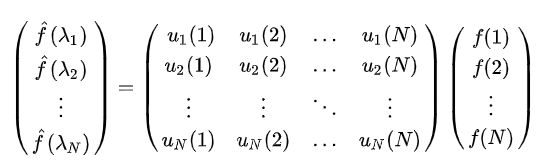

利用矩阵乘法将Graph上的傅里叶变换推广到矩阵形式:

即 f f f 在 Graph 上的傅里叶变换的矩阵形式为: f ^ = U T f \hat{f} = U^Tf f^=UTf

传统的傅里叶变换逆变换:

f ( t ) = 1 2 π ∫ − ∞ + ∞ F ( w ) e i w t d w f(t)=\frac{1}{2\pi} \int_{-\infty}^{+\infty} F(w) e^{iwt}dw f(t)=2π1∫−∞+∞F(w)eiwtdw

迁移到Graph上变为对特征值 λ l \lambda_l λl 求和:

f ( i ) = ∑ l = 1 N f ^ ( λ l ) u l ( i ) f(i) = \sum_{l=1}^N \hat{f} (\lambda_l) u_l(i) f(i)=l=1∑Nf^(λl)ul(i)

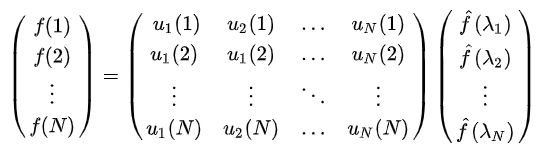

利用矩阵乘法将Graph上的傅里叶逆变换推广到矩阵形式:

即 f f f 在Graph上傅里叶逆变换的矩阵形式为: f = U f ^ f=U \hat{f} f=Uf^

为什么拉普拉斯矩阵的特征向量可以作为傅里叶变换的基

傅里叶变换一个本质理解就是:把任意一个函数表示成了若干个正交函数(由sin,cos 构成)的线性组合。

graph傅里叶变换也把graph上定义的任意向量 f f f,表示成了拉普拉斯矩阵特征向量的线性组合,即:

f = f ^ ( 1 ) u 1 + f ^ ( 2 ) u 2 + . . . + f ^ ( n ) u n f = \hat{f}(1)u_1+\hat{f}(2)u_2+...+\hat{f}(n)u_n f=f^(1)u1+f^(2)u2+...+f^(n)un

原因在于 ( u 1 ⃗ , u 2 ⃗ , ⋯ , u n ⃗ ) (\vec{u_1},\vec{u_2},\cdots,\vec{u_n}) (u1,u2,⋯,un)是 graph上 n维空间中的 n n n 个线性无关的正交向量,由线性代数的知识可以知道: n n n 维空间中 n n n 个线性无关的向量可以构成空间的一组基,而且拉普拉斯矩阵的特征向量还是一组正交基。

参考:

https://zhuanlan.zhihu.com/p/54505069

https://blog.csdn.net/weixin_40013463/article/details/81089223

https://blog.csdn.net/qq_41727666/article/details/84622965#CNN_3

https://www.bilibili.com/video/av51204684?p=8