kaggle中关于图像的比赛整理

传送门:https://www.kaggle.com/competitions点击打开链接

world文档下载地址:https://download.csdn.net/download/qq_33614902/10482467点击打开链接

一、图像

图像分割

1、CVPR 2018 WAD VideoSegmentation Challenge

将车辆拍摄的图像帧中的每个物体进行分割。

2、Carvana ImageMasking Challenge

自动识别图像中汽车的边界。

要求:开发一种自动删除照相馆背景的算法。

图像分类

1、iNaturalistChallenge at FGVC5

长尾物种分类。

iNat Challenge 2018数据集包含8,000多种物种,450k张图像。

评估:每张图片可以预测3个类别标签。击中误差为0,否则误差为1。

2、iMaterialistChallenge (Fashion) at FGVC5

根据图片识别出时尚产品所属类别。

评估:使用Mean F1 得分。

3、iMaterialistChallenge (Furniture) at FGVC5

家具和家居用品的图像分类。

每张图片只能预测一个类别。

4、Plant Seedlings Classification

从图像中确定植物幼苗的种类。

5、Dog BreedIdentification

确定狗的品种。

要求:对于每个图像,必须预测每个不同品种的概率。

6、Cdiscount’s ImageClassification Challenge

根据图像预测产品的类别。

7、NIPS 2017:Non-targeted Adversarial Attack

非针对性攻击的目标是稍微修改源图像,使得图像将被一般未知的机器学习分类器错误地分类。

8、NIPS 2017: TargetedAdversarial Attack

目标攻击的目标是稍微修改源图像,使得图像将被一般未知的机器学习分类器分类为指定的目标类别。

9、NIPS 2017: DefenseAgainst Adversarial Attack

防御的目标是构建机器学习分类器,该分类器对抗例子是强健的,即可以正确分类敌对图像。

10、iNaturalistChallenge at FGVC 2017

动植物分类。

iNat Challenge 2017数据集包含5,089个物种,数据集包含675,000张图像。

对于测试集中的每个图像,您必须预测5个类别标签。

11、iMaterialistChallenge at FGVC 2017

根据图片对服装产品进行分类。

对于每个图像i和任务t,可能存在多个标签g,只要产生的标签与一个基本事实标签相同,那么预测就被认为是正确的。

12、Intel &MobileODT Cervical Cancer Screening

基于图像准确识别女性子宫颈类型的算法。

要求:对于每张图片,提交每个类型的概率。

13、Data Science Bowl2017

竞赛的任务是创建一个自动化的方法,能够确定患者是否会在扫描日期的一年内被诊断为肺癌。ground truth标签通过病理诊断得到确认。

要求:对于每张图片,要提交1年内被诊断为肺癌的概率。

14、Dogs vs. Cats Redux:Kernels Edition

简单的图像分类问题。

训练集包含25,000个狗和猫的图像。测试集包含12,500个图像。要求:预测每张图像是狗的概率(1 =狗,0 =猫)。

15、Leaf Classification

使用二值叶图像和提取的特征,包括形状,边缘和纹理,以准确识别99种植物。

要求:对于每张叶子图片,分别给出属于每种物种的概率。

16、First Steps WithJulia

使用Julia从Google街景图像中识别字符。

要求:对每张图片,给出其类别标签(如:A,b,c)。

17、Yelp RestaurantPhoto Classification

分类问题:根据照片预测餐馆的属性标签。

每张照片可能对应多个标签。

18、Identify signs ofdiabetic retinopathy in eye images

可能是分类问题,有难度。

识别眼部图像中糖尿病视网膜病变的迹象。

该竞赛的主要目标是开发可在噪声和变化情况下运行的强大算法。

目标检测

1、Google LandmarkRecognition Challenge

预测图像中包含的地标,并给出置信度。

要求:最多只能预测一个地标,图像中可能无地标。

2、Statoil/C-COREIceberg Classifier Challenge

预测图像包含一个冰山的概率(介于0和1之间的数字)。

3、Invasive SpeciesMonitoring

开发算法来更准确地识别森林和树叶的图像是否含有侵入性绣球。

要求:预测图像是否包含入侵物种的目标变量的概率

4、Planet:Understanding the Amazon from Space

使用卫星数据追踪亚马逊热带雨林的人类足迹。

对于测试集中列出的每个图像,预测您认为与图像关联的标签的空格分隔列表。有17种可能的标签:农业,artisinal_mine,bare_ground,开花,吹,明确,阴天,常规,种植,居住,阴霾,partially_cloudy,小学,道路,selective_logging,slash_burn,水。

5、NOAA FisheriesSteller Sea Lion Population Count

准确计算航拍照片中海狮的数量。

6、The NatureConservancy Fisheries Monitoring

自动检测和分类渔船捕获的金枪鱼,鲨鱼等物种。

数据集:视频。

要求:8个类别,并给出8个类别的概率

7、Facial KeypointsDetection

该任务的目标是检测脸部图像上的关键点位置。

什么是关键点:共15个,如左右眼、鼻子、嘴巴等。

8、Ultrasound NerveSegmentation

建立一个模型,可以识别颈部超声图像数据集中的神经结构。

9、Right WhaleRecognition

目标检测:在航拍照片中识别濒危的右鲸。

要求:对每张图像给出预测到的可能的鲸鱼和对应的概率。

目标检索

1、Google LandmarkRetrieval Challenge

给定一幅图像,你能找到数据集中所有相同的地标吗?

一个图像检索问题

评估:MAP@100

2、Avito Duplicate AdsDetection

检测出重复的广告。

数据:各种广告图片。

要求:对每个广告给出其重复的概率(0,1之间)。

图像理解

1、State FarmDistracted Driver Detection

通过图片检测司机是否发生了上述行为。

要求:给出10个行为的概率。

行为:

c0:正常驾驶

c1:发短信 - 右转

c2:通过电话通话 - 右转

c3:发短信 - 左转

c4:通过电话交谈 - 左转

c5:操作收音机

c6:喝酒

c7:伸手

c8:头发和化妆

c9:说话乘客

数据关联

1、Draper SatelliteImage Chronology

预测每个位置拍摄照片的时间顺序。类似于图像间的数据关联。

数据:卫星地图。每组5张图片

要求:按照拍摄图片的时间顺序,对图片排序。

二、视频

视频分类

1、Google Cloud &YouTube-8M Video Understanding Challenge

视频理解,制作视频标签。

使用新的和改进的YT-8M V2数据集精确分配视频级标签。该数据集由超过700万YouTube视频(450,000小时的视频)创建,包含来自4716个class(平均3.4个标签/视频)的词汇视频标签。它还具有每秒钟视频中预先提取的音频和视频功能(总共3.2B个特征向量)。

要求:对于每个视频,预测标签列表及其相应的置信度分数。

三、正在进行的比赛

1、The 2nd YouTube-8MVideo Understanding Challenge

视频分类。

创建一个约束大小的模型来预测视频标签。

对于每个视频,您将提交预测标签列表及其相应的置信度分数。

2、Digit Recognizer

图像分类。

识别手写数字。数据:MNIST数据集。

分类方法:简单的神经网络,SVM,K-nearest neighbors

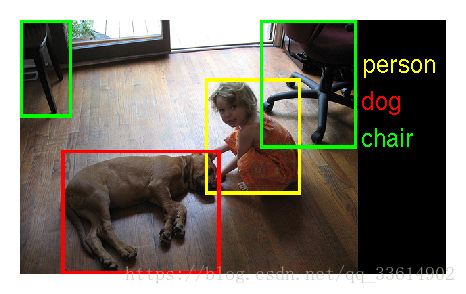

3、mageNet ObjectDetection Challenge

识别并标记图像中的日常物体。

目标:构建一个算法,能够识别和标记超过200个类别的图像的目标。

比赛概述:

图像中所有类别的边界框已被标记。“数据”选项卡上提供了200种类别的对象。这些类别是从各种因素中选择的,包括对象实例的平均数量,图像混乱以及其他几种。

训练集包含超过475k的对象,用于从超过450k的图像中进行分类。测试集包括40k图像。

已经使用场景级查询从Flickr和其他搜索引擎收集图像。平均图像尺寸是482x415像素。

4、ImageNet ObjectLocalization Challenge。

目标:要识别图像中的所有对象,然后可以对这些图像进行分类和注释。进一步提高准确度

技术背景:2010年至2014年间,图像分类误差(从28.2%降至6.7%)降低了4.2倍,定位误差降低了1.7倍(从42.5%降至25.3%)。

概述:

验证和测试数据包含150k张图片,有1000个对象类别。1000个对象类别包含ImageNet的内部节点和叶节点,但不相互重叠。

评估标准:

每张图片的误差可定义为:e=〖min〗_i (〖min〗_j (max(d_ij,f_ij ) ))

每张图片的最小误差为0或者1。总误差是计算测试集中所有图片最小误差的平均值。

5、Humpback WhaleIdentification Challenge

识别图像中的鲸鱼种类。

数据集包含25k张图像

评估标准:

MAP@5,每张图片最多预测5个标签。

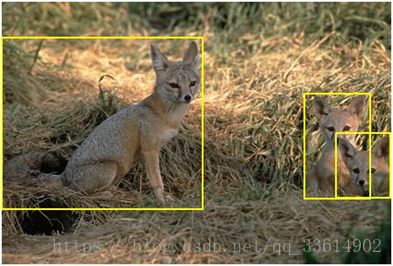

6、ImageNet ObjectDetection from Video Challenge

要求在30类物体的各种视频剪辑中识别和标记静态图像。