Nature:Deep Learning 深度学习综述

翻译:https://artificial-intelligence.net.cn/2019/06/05/1559711811/?from=singlemessage&isappinstalled=0

作者:Yann LeCun, Yoshua Bengio ,Geoffrey Hinton

发表及时间:Nature,2015

概念:深度学习允许由多个处理层的计算模型来学习具有多个抽象级别的数据表示。这些方法极大的改善了语音识别、视觉对象识别、物体检测以及药物发现和基因组学等许多其他领域的最新技术。

原理:深度学习通过反向传播算法来指示机器应如何更改其内部参数(用于从前一层中的表示计算每个层中的表示)来发现大数据集中的复杂结构。

应用:深度卷积网络CNN在处理图像、视频、语音和音频方面带来了突破。而循环审计网络在处理序列数据,比如文本和语音方面表现出了闪亮的一面。

目录

一、引言

二、监督学习

三、反向传播算法

四、卷积神经网络

五、基于深度卷积神经网络的图片理解

六、分布表示和语言模型

七、循环神经网络(RNN)

八、深度学习的未来

一、引言

深度学习就是一种特征学习方法,把原始数据通过一些简单的但是非线性的模型转变成为更高层次的、更加抽象的表达。通过足够多的转换的组合,学可以习非常复杂的功能。(用深度学习的方法、多层的神经网络来找到一个函数,这个函数可以被学习,这个函数最后可以表示非常复杂的功能,比如说语音识别、图像识别。我们的过程就是要找到这个复杂的函数,然后通过学习更精确)

多层神经网络:

特点:多层神经元的组成,每个神经元的输入是前一层权重的输入

深度学习正在取得重大进展,它擅长发现高维数据中的复杂结构,被应用于科学、商业和政府等领域。除了在图像识别、语音识别等领域打破了纪录,它还在另外的领域击败了其他机器学习技术,包括预测潜在的药物分子的活性、分析粒子加速器数据、重建大脑回路、预测在非编码DNA突变对基因表达和疾病的影响。也许更令人惊讶的是,深度学习在自然语言理解的各项任务中产生了非常可喜的成果,特别是主题分类、情感分析、自动问答和语言翻译。我们认为,在不久的将来,深度学习将会取得更多的成功,因为它需要很少的手工工程,它受益于可用计算能力和数据量的增加。

深度学习的应用领域:

1.计算机视觉

图像识别,人脸识别,自动驾驶

2.自然语言处理

智能搜索、机器翻译,文本摘要,人机对话

...

医学图像分析,制药,游戏助理....

二、监督学习

通过计算一个目标函数来测量出输出分数和期望模式分数之间的误差(或距离)。然后机器会修改其内部可调参数,以减少这种误差(就是反反向传播的过程)。这些可调节的参数,通常被称为权值,它们是一些实数,可以被看作是一些“旋钮”,定义了机器的输入输出功能。在典型的深学习系统中,可能有数以百万计的样本和权值和带有标签的样本,用来训练机器。

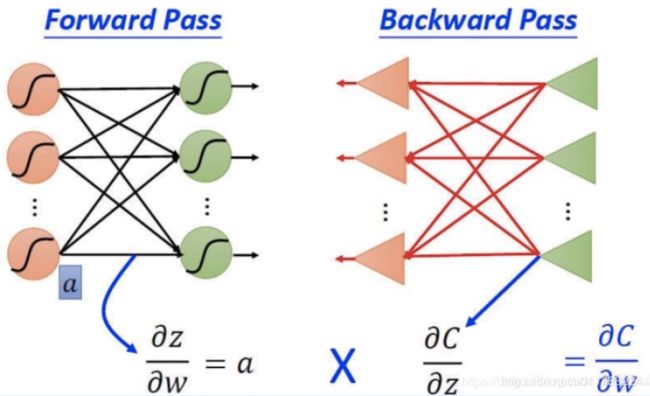

为了正确地调整权值向量,该学习算法计算每个权值的梯度向量,表示了如果权值增加了一个很小的量,那么误差会增加或减少的量。权值向量然后在梯度矢量的相反方向上进行调整。我们的目标函数,所有训练样本的平均,可以被看作是一种在权值的高维空间上的多变地形。负的梯度矢量表示在该地形中下降方向最快,使其更接近于最小值,也就是平均输出误差低最低的地方。

梯度下降:不断用梯度对参数进行微调,直到找到相应的位置。

多层神经网络和BP算法

a.多层神经网络的示例,(用连接点表示)可以对输入空间进行整合,使得数据(红色和蓝色线表示的样本)线性可分

b.链式法则告诉我们如何组织两个小的影响,即x对y的变化和y对z的变化之间的联系

c.用于计算两个隐藏层的神经网络中正向传播的公式

d.计算反向传播的公式,在每个隐藏层我们计算每个单元的输出的误差导数

三、反向传播算法

1、链式法则

x的微小变化影响了y的微小变化,y的微小变化影响了z的微小变化。

2、反向传递

从前到后是一个计算的过程,从后到前是一个误差传递的过程,误差传递的过程就是学习的过程。

四、卷积神经网络(CNN)

CNN的过程:

1)预处理的数据用于卷积的计算,加上偏置得到feature map

2)将前面卷积的结果进行非线性激活函数的处理,目前常用的Relu

3)池化(取区域的最大值或者是平均值),保留其显著的特征

4)全链接层,对结果的输出和确认

CNN能够减少参数,提高效率,降低计算复杂度。

五、基于深度卷积神经网络的图片理解

CNN提取图像的特征,然后输入到RNN中生成一句话。

六、分布表示和语言模型

1、Word Embedding 词向量

现有的机器学习方法往往无法直接处理文本数据,因此需要找到一个合适的方法将文本数据转换成数值数据。 Word Embedding 的过程是将文本空间的某个word通过一定的方法映射或嵌入到另一个数值的向量空间。

传统的词的表示是one-hot Embedding,在词典中词的位置表示一个词的含义,仅仅表示词的一个特殊的位置,并不表示词的含义。Word Embedding可以进行词的向量空间的映射,在向量空间中离的比较近的词意思是比较接近的。

机器能够通过大量的阅读文档获取文字的意思,这就是Word Embedding的过程。

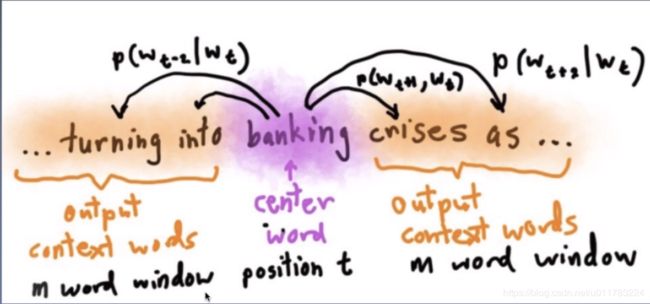

2、Word2Vec算法

给定input word来预测上下文。

七、循环神经网络(RNN)

RNN的特点:

- RNN在每个时间点链接参数值,参数只有一份

- 神经网络除了输入以外,还会建立在以前的“记忆”的基础上

- 内存的要求与输入的规模有关

时间序列,输入根据不同的时间点变换。

RNN是带有存储功能的神经网络。

LSTM(长短记忆网络)

八、深度学习的未来

1、非监督学习

2、监督学习

3、强化学习

4、GAN 对抗生成网络

博弈论

5、自监督学习

现在预测未来,部分预测整体,未来预测现在