语义分割--(PAN)Pyramid Attention Network for Semantic Segmentation

Pyramid Attention Network for Semantic Segmentation

Pyramid Attention Network for Semantic Segmentation

原文地址:PAN

备注: 这篇文章和DFN类似。

Introduction

Abstract

论文提出了Pyramid Attention Network(PAN)网络用于探究全局上下文信息在语义分割中的影响。论文结合了注意力机制和空间金字塔结构用于提取精准密集的特征。具体来讲,论文引入了Feature Pyramid Attention module应用于high-level的特征上,通过空间金字塔注意力结构并结合全局上下文信息,用于学习更好的特征表示。 引入Global Attention Upsample module在每个decoder层上引导low-level的特征选择空间信息。论文提出的PAN在PASCAL VOC 2012 and Cityscapes上获得了优异的表现。

Motivation

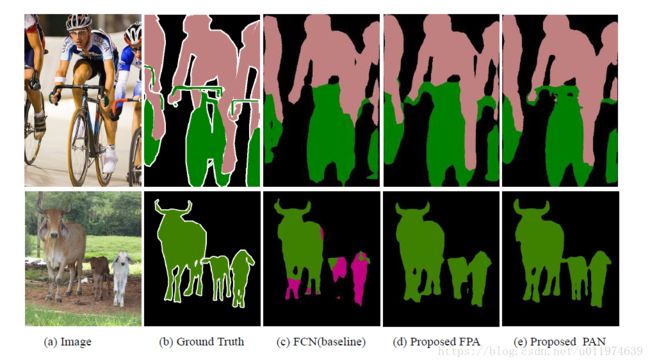

现存的语义分割结构在编码高维信息时,会受到空间分辨率的损失的影响。如图:

FCN作为backbone的结构对小型目标预测不佳,论文认为这存在两个挑战。

- 物体因为多尺度的原因,造成难以分类。针对这个问题,PSPNet和DeepLab引入了PSP和ASPP模块引入多尺度信息。论文引入了像素级注意力用于帮助提取精准的high-level 特征。

- high-level的特征偏向于对类别分类,缺乏空间信息。针对这个问题,常见的操作是采用U-shape结构网络,例如SegNet、Refinenet等。使用low-level帮助high-level恢复图片细节。然后这些都是很耗时的,论文提出了有效的decoder结构,称之为Global Attention Upsample(GAU),可以提取high-level的全局上下文用于对low-level信息加权。

Contributions

论文的主要贡献在于:

- 提出了Feature Pyramid Attention module(FPA)将不同尺度上下文特征嵌入到现存的FCN结构上

- 提出了Global Attention Upsample(GAU),一个有效的decoder模块

- 基于FPA和GAU,提出了Pyramid Attention Network(PAN)网络,在VOC2012 and cityscapes上获得了先进表现

Architecture

论文提出的PAN网络是基于Feature Pyramid Attention module(FPA)和Global Attention Upsample(GAU),这里分步一个一个介绍。

Feature Pyramid Attention

PSPNet和DeepLab使用的PSP或ASPP结构结构如下:

PSPNet使用池化操作会有空间信息上的损失。DeepLab使用扩张卷积会存在缺少局部信息和”griding”(卷积核退化)现象。

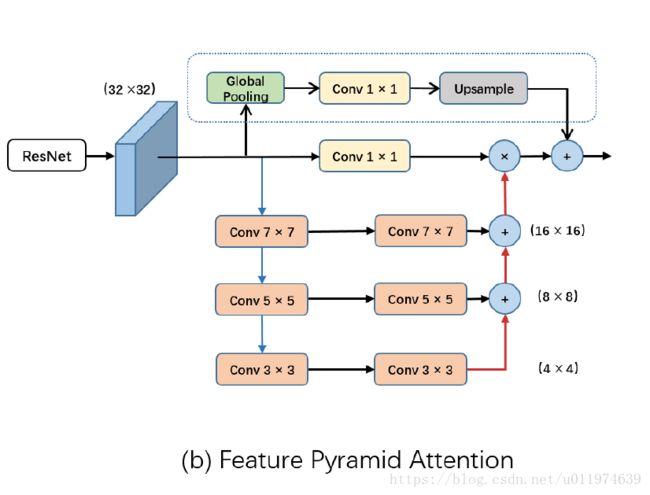

受到注意力机制的启发,论文认为可使用注意力机制,将全局上下文信息作为先验知识引入到通道选择。但是仅仅有通道注意力机制是不够的,这依旧缺乏逐像素信息。论文提出了FPA模块,该模块融合了多尺度信息,以 3×3 3 × 3 , 5×5 5 × 5 , 7×7 7 × 7 三个卷积做金字塔结构,因为high-level的特征分辨率较小,故使用大的卷积核带来的计算负担不会太多。同时论文引入了全局池化分支用于进一步提升性能。如图所示:

得益于金字塔结构,FPA可以融合多尺度信息,产生更佳的像素级注意力应用于high-level特征。不同于PSPNet或ASPP需要做通道降维,论文的做法是上下文信息与原始的特征做逐像素乘。

Global Attention Upsample

现存的decoder结构上,如PSPNet和Deeplab都是直接双线性差值上采样得到预测结果,这可以看成是一个naive decoder。

DUC使用了多通道做reshape操作得到预测结果。这两类都缺乏多尺度信息,难以恢复空间信息。常见的encoder-decoder架构主要考虑使用使用多尺度信息逐步恢复边界,但是这些结构都较为复杂,带了较大的计算消耗。

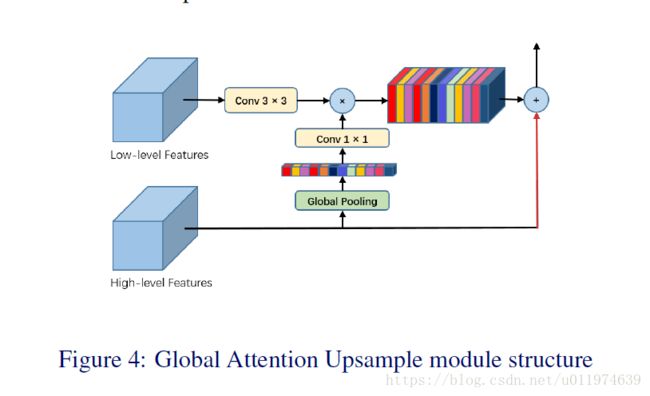

因为high-level中有着丰富的语义信息,这可以帮助引导low-level的选择,从而达到选择更为精准的分辨率信息。论文提出了GAU结构,通过全局池化提供的全局信息作为指引选择low-level特征。其结构如下:

具体来讲,使用 3×3 3 × 3 卷积用于对低级特征做通道处理,然后使用全局池化后的信息做加权,得到加权后的low-level特征,再上采样,然后再与high-level信息相加。

Network Architecture

基于PFA和GAU,论文提出了完整的PAN架构,如下图:

使用带有扩张卷积策略的Resnet101作为backbone,res5b使用dialted rate=2,最初的 7×7 7 × 7 卷积换成了3个 3×3 3 × 3 卷积。使用FPA模块去获取密集的像素级注意力信息,结合全局上下文,通过GAU模块最终产生了预测图。

论文认为FPA模块是一个立足于encoder和decoder结构之间的中间单元。

Experiment

论文在PASCAL VOC 2012和Cityscapes上实验,论文使用了“poly”学习策略,SGD优化器,batch=16。随机的左右翻转和0.5到2之间的缩放。

FPA

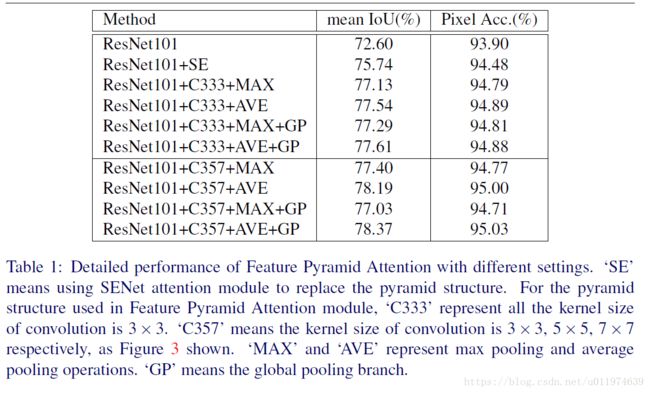

对于FPA,先不使用GAU,直接上采样得到结果,论文做了大量的albation experiment。

可以看到使用全局池化“AVE”比全局最大值”MAX”效果要更佳。最终采用了”AVE”。

可以看到使用”C333”和MAX的模型效果相比于只使用SE结构的有很大的提升。使用大的卷积核也有部分的提升。同时添加全局池化也有提升。

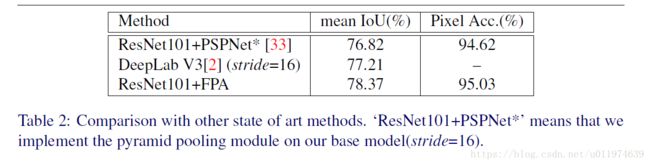

在使用直接的上采样结构上,与PSPNet和DeepLab的结果对比:

GAU

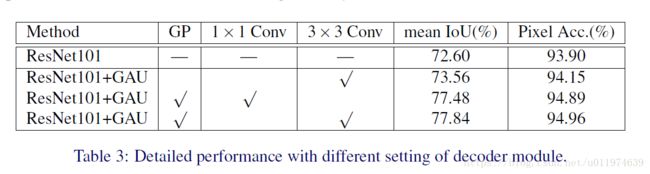

GAU的目的是从low-level特征上恢复像素信息,使用 1×1 1 × 1 配合全局池化, 3×3 3 × 3 用于做通道降维。没有添加全局上下文注意力分支:

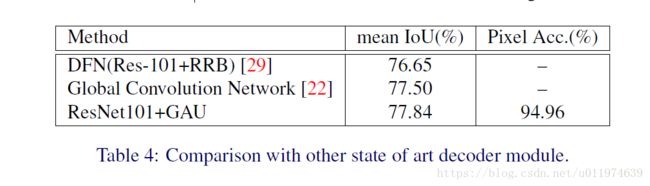

与先进的DFN,GCN对比如下:

PASCAL

多尺度和翻转的影响:

性能很强!

CITYSCAPES

模型没有使用coarse标准图片,cropsize=768.结果如下:

Conclusion

论文面向语义分割设计了FPA和GAU结构,并基于两个模块提出了PAN网络。FPA提供了像素级注意力信息,通过金字塔结构增加了感受野。GAU使用high-level特征指导选择low-level。实验证明了设计模块的有效性。