重点

存在线程安全问题必须满足三个条件:

1.有共享变量, 有共享变量, 有共享变量(重要的事情说三边)

2.处在多线程环境下

3.共享变量有直接修改(读和写)操作或者每次修改结果都不一样。

并发的风险和优势

Java与线程

线程的实现

线程是比进程更轻量级的调度执行单位,线程的引入,可以把一个进程的资源分配和执行调度分开,各个线程既可以共享进程资源(内存地址、文件I/O等),又可以独立调度。目前线程是Java里面进行处理器资源调度的最基本单位

实现线程主要有三种方式:使用内核线程实现(1:1实现),使用用户线程实现(1:N实现),使用用户线程加轻量级进程混合实现(N:M实现)

内核线程实现

内核线程实现的方式也被称为1:1实现。内核线程(Kernel-Level Thread,KLT)就是直接由操作系统内核(Kernel,下称内核)支持的线程,这种线程由内核来完成线程切换,内核通过操纵调度器(Scheduler)对线程进行调度,并负责将线程的任务映射到各个处理器上。每个内核线程可以视为内核的一个分身,这样操作系统就有能力同时处理多件事情,支持多线程的内核就称为多线程内核(Multi-Threads Kernel)

轻量级进程 --- java使用的方式

程序一般不会直接使用内核线程,而是使用内核线程的一种高级接口——轻量级进程(LightWeight Process,LWP),轻量级进程就是我们通常意义上所讲的线程,由于每个轻量级进程都由一个内核线程支持,因此只有先支持内核线程,才能有轻量级进程。这种轻量级进程与内核线程之间1:1的关系称为一对一的线程模型, 对应了下图轻量级线程和内核线程的关系

![]()

由于内核线程的支持,每个轻量级进程都成为一个独立的调度单元,即使其中某一个轻量级进程在系统调用中被阻塞了,也不会影响整个进程继续工作。轻量级进程也具有它的局限性:首先,由于是基于内核线程实现的,所以各种线程操作,如创建、析构及同步,都需要进行系统调用。而系统调用的代价相对较高,需要在用户态(User Mode)和内核态(Kernel Mode)中来回切换。其次,每个轻量级进程都需要有一个内核线程的支持,因此轻量级进程要消耗一定的内核资源(如内核线程的栈空间),因此一个系统支持轻量级进程的数量是有限的

但是轻量级进程也是有缺点的, 它是用户层的函数, 实现于内核线程, 所以他的每次函数调用, 都是系统调用, 需要在用户态和内核态之间来回切换, 这代码是非常大的, 并且因为轻量级线程需要和内核线程1 1配对, 需要消耗一定量的内核资源, 所以是有数量的限制的, 还有它的调度代价也相当的大, 这也是当前java存在的一个问题

用户线程实现

用户线程实现的方式被称为1:N实现。广义上来讲,一个线程只要不是内核线程,都可以认为是用户线程(User Thread,UT)的一种,因此从这个定义上看,轻量级进程也属于用户线程,但轻量级进程的实现始终是建立在内核之上的,许多操作都要进行系统调用,因此效率会受到限制,并不具备通常意义上的用户线程的优点

而狭义上的用户线程指的是完全建立在用户空间的线程库上,系统内核不能感知到用户线程的存在及如何实现的。用户线程的建立、同步、销毁和调度完全在用户态中完成,不需要内核的帮助。如果程序实现得当,这种线程不需要切换到内核态,因此操作可以是非常快速且低消耗的,也能够支持规模更大的线程数量,部分高性能数据库中的多线程就是由用户线程实现的。这种进程与用户线程之间1:N的关系称为一对多的线程模型,下图是进程和用户线程 1:N 的关系

![]()

用户线程的优势在于不需要系统内核支援,劣势也在于没有系统内核的支援,所有的线程操作都需要由用户程序自己去处理。线程的创建、销毁、切换和调度都是用户必须考虑的问题,而且由于操作系统只把处理器资源分配到进程,那诸如“阻塞如何处理”“多处理器系统中如何将线程映射到其他处理器上”这类问题解决起来将会异常困难,甚至有些是不可能实现的。因为使用用户线程实现的程序通常都比较复杂,除了有明确的需求外(譬如以前在不支持多线程的操作系统中的多线程程序、需要支持大规模线程数量的应用),一般的应用程序都不倾向使用用户线程。Java、Ruby等语言都曾经使用过用户线程,最终又都放弃了使用它。但是近年来许多新的、以高并发为卖点的编程语言又普遍支持了用户线程,譬如Golang、Erlang等,使得用户线程的使用率有所回升

混合实现

线程除了依赖内核线程实现和完全由用户程序自己实现之外,还有一种将内核线程与用户线程一起使用的实现方式,被称为N:M实现。在这种混合实现下,既存在用户线程,也存在轻量级进程。用户线程还是完全建立在用户空间中,因此用户线程的创建、切换、析构等操作依然廉价,并且可以支持大规模的用户线程并发。而操作系统支持的轻量级进程则作为用户线程和内核线程之间的桥梁,这样可以使用内核提供的线程调度功能及处理器映射,并且用户线程的系统调用要通过轻量级进程来完成,这大大降低了整个进程被完全阻塞的风险。在这种混合模式中,用户线程与轻量级进程的数量

比是不定的,是N:M的关系, 下图就是用户线程与轻量级进程之间M:N的关系

![]()

许多UNIX系列的操作系统,如Solaris、HP-UX等都提供了M:N的线程模型实现。在这些操作系统上的应用也相对更容易应用M:N的线程模型

Java线程的实现

java 1.2之前使用的是绿色线程(说白了就是用户线程)实现, 但是到了jdk1.3后改成了使用基于系统线程实现的java线程

以hotspot为例, 它的每个线程都是直接映射到系统原生线程的, 中间没有额外的间接结构, 这样做的好处就是jvm不需要去管理线程的调度, 全权交给底下的操作系统去处理, 所以何时冻结或唤醒线程、该给线程分配多少处理器执行时间、该把线程安排给哪个处理器核心去执行等,都是由操作系统完成的,也都是由操作系统全权决定的

说白了就是操作系统是怎样的线程, 一定程度上影响了jvm使用了什么线程

Java线程调度

分为两种, 一种是协同式调度(线程运行多久由线程自己决定, 当线程运行完毕, 会告诉系统让它切换到另一个线程)另一种是抢占式调度(线程调度由系统决定)

协同式调度会出现cpu一直卡在线程这里一直运行的情况, 可能导致系统崩溃

抢占式调度线程只能让出自己的执行权限, 想要抢占cpu时间片确是不可能了, 但是可以另辟蹊径, 使用线程优先级来做, 但是说到线程优先级却无法完全保证线程优先运行, 比如: window 就存在"优先级推进器(Priority Boosting)"的功能, 即使线程优先级最高也没用, 这个功能的大致作用是一个线程被执行的特别频繁时, window可能会放弃正在运行的高优先级线程,转而去运行这个频繁被执行的线程

并且java的线程优先级也存在一个问题, 那就是如果系统的优先级等级数量比较多, 那么java的优先级不会出现很多问题, 但是如果系统的优先级只有1个(极端一点), 那么java的所有优先级就一点用都没有了

状态转换

线程的五种状态

系统层面分为五种状态

![]()

初始状态: 线程刚刚创建, 这个时候它只是对象, 没有执行start函数

可运行状态: 线程执行了start函数, 但是还未获得时间片

运行状态: 线程获得了时间片

阻塞状态: 线程读取文件或者IO操作, 该线程不会实际使用到cpu, 会导致上下文切换, 进入阻塞状态

终止状态: 线程结束, 生命周期已经结束

线程六种状态

根据Thread.State枚举分为六种状态(java层面分析线程状态)

new(新建): 新建状态, 线程创建, 但是未调用 start() 方法

runnable(运行): 运行状态, 线程正在执行也有可能线程正在等待系统为它分配执行时间

waiting(无限期等待) : 处于这种状态的线程不会被分配处理器执行时间,它们要等待被其他线程显式唤醒。以下方法会让线程陷入无限期的等待状态:

- 没有设置Timeout参数的Object::wait()方法;

- 没有设置Timeout参数的Thread::join()方法;

- LockSupport::park()方法

Time Waiting(限期等待): 处于这种状态的线程也不会被分配处理器执行时间,不过无须等待被其他线程显式唤醒,在一定时间之后它们会由系统自动唤醒。以下方法会让线程进入限期等待状态:

■Thread::sleep()方法;

■设置了Timeout参数的Object::wait()方法;

■设置了Timeout参数的Thread::join()方法;

■LockSupport::parkNanos()方法;

■LockSupport::parkUntil()方法。

Blocked(阻塞): 线程被阻塞了,“阻塞状态”与“等待状态”的区别是“阻塞状态”在等待着获取到一个排它锁,这个事件将在另外一个线程放弃这个锁的时候发生;而“等待状态”则是在等待一段时间,或者唤醒动作的发生。在程序等待进入同步区域的时候,线程将进入这种状态

Terminated(结束):已终止线程的线程状态,线程已经结束执行。

下图是线程状态相互转化的方法

![]()

下图是RUNNABLE状态当前可能存在的状态

![]()

这六种状态的方式, 主要用于调试线程查看线程状态错误

@Slf4j

public class TestState {

public static void main(String[] args) throws InterruptedException {

Thread t1 = new Thread("t1") { // NEW

@Override

public void run() {

log.debug("running ... ");

}

};

Thread t2 = new Thread("t2") { // RUNNABLE

@Override

public void run() {

while (true) {

}

}

};

t2.start();

Thread t3 = new Thread("t3") { // TERMINATED

@Override

public void run() {

log.debug("running ... ");

}

};

t3.start();

Thread t4 = new Thread("t4") { // TIMED_WAITING

@Override

public void run() {

synchronized (TestState.class) {

try {

TimeUnit.MILLISECONDS.sleep(1000000);

} catch (Exception e) {

e.printStackTrace();

}

}

}

};

t4.start();

Thread t5 = new Thread("t5") { // WAITING

@Override

public void run() {

try {

t2.join();

} catch (Exception e) {

e.printStackTrace();

}

}

};

t5.start();

Thread t6 = new Thread("t6") { // BLOCKED

@Override

public void run() {

synchronized (TestState.class) {

try {

TimeUnit.MILLISECONDS.sleep(1000000);

} catch (Exception e) {

e.printStackTrace();

}

}

}

};

t6.start();

TimeUnit.MILLISECONDS.sleep(500);

log.debug("{} state {}", t1.getName(), t1.getState()); // NEW

log.debug("{} state {}", t2.getName(), t2.getState()); // RUNNABLE

log.debug("{} state {}", t3.getName(), t3.getState()); // TERMINATED

log.debug("{} state {}", t4.getName(), t4.getState()); // TIMED_WAITING

log.debug("{} state {}", t5.getName(), t5.getState()); // WAITING

log.debug("{} state {}", t6.getName(), t6.getState()); // BLOCKED

}

}

Java与协程

内核线程的局限

通过一个具体场景来解释目前Java线程面临的困境。今天对Web应用的服务要求,不论是在请求数量上还是在复杂度上,与十多年前相比已不可同日而语,这一方面是源于业务量的增长,另一方面来自于为了应对业务复杂化而不断进行的服务细分。现代B/S系统中一次对外部业务请求的响应,往往需要分布在不同机器上的大量服务共同协作来实现,这种服务细分的架构在减少单个服务复杂度、增加复用性的同时,也不可避免地增加了服务的数量,缩短了留给每个服务的响应时间。这要求每一个服务都必须在极短的时间内完成计算,这样组合多个服务的总耗时才不会太长;也要求每一个服务提供者都要能同时处理数量更庞大的请求,这样才不会出现请求由于某个服务被阻塞而出现等待。

Java目前的并发编程机制就与上述架构趋势产生了一些矛盾,1:1的内核线程模型是如今Java虚拟机线程实现的主流选择,但是这种映射到操作系统上的线程天然的缺陷是切换、调度成本高昂,系统能容纳的线程数量也很有限。以前处理一个请求可以允许花费很长时间在单体应用中,具有这种线程切换的成本也是无伤大雅的,但现在在每个请求本身的执行时间变得很短、数量变得很多的前提下,用户线程切换的开销甚至可能会接近用于计算本身的开销,这就会造成严重的浪费。

传统的Java Web服务器的线程池的容量通常在几十个到两百之间,当程序员把数以百万计的请求往线程池里面灌时,系统即使能处理得过来,但其中的切换损耗也是相当可观的。现实的需求在迫使Java去研究新的解决方案,同大家又开始怀念以前绿色线程的种种好处,绿色线程已随着Classic虚拟机的消失而被尘封到历史之中,它还会有重现天日的一天吗?

总结:

下来就是 java线程使用的是轻量级进程(使用的是系统原生线程, 后面都叫LWP吧), 这种LWP对于系统来说开销很大, 比如: 用户态到内核态的切换代价大; 线程的调度代价大; 系统可容纳的LWP也是有限的, 而现在我们追求的是微服务拆分, 通常一次客户请求需要用到多个微服务的服务组合到一起完成一次请求, 这样就要求我们的每个服务效率要很快, 但是LWP无法做到这点, 这这样的话, 只能找回绿色线程(用户线程)了吗?(绿色线程 jdk1.2 版本使用的线程实现方式)

协程的复苏

不要以为系统调用(切换, 或者叫中断)的不太影响效率, 用户线程切换到内核线程的过程中, 用户线程需要保存用户线程切换的上下文数据, 然后还需要把寄存器, 内存分页等恢复到内核线程中, 这样内核线程才能够获取到充足的资料, 这样内核线程才能够重新激活, 这种保护和恢复现场的操作免不了涉及各种寄存器, 缓存的来回拷贝, 这可不是什么轻量级操作

但是如果使用用户线程就能避免掉这些么??? 其实不然, 但是如果使用了用户线程, 上面这些过程不就由我们控制了么???这样我们就能够使用我们的方法来减少这些开销

从dos时代开始用户就自发的模拟出多线程, 自己保护和恢复场景的工作模式, 大致就是在内存中找出一个栈结构, 模仿调用栈, 只要线程压栈和出栈的过程遵循规则, 并且这块内存不被破坏, 这样就成功模拟出了多线程, 到后来操作系统出现了多线程了, 这种模拟多线程的方式变少了, 但是还未消失, 以用户线程的形式继续存在, 由于最初多数的用户线程是被设计成协同式调度(Cooperative Scheduling)的,所以它有了一个别名——“协程”(Coroutine)。又由于这时候的协程会完整地做调用栈的保护、恢复工作,所以今天也被称为“有栈协程”(Stackfull Coroutine),起这样的名字是为了便于跟后来的“无栈协程”(Stackless Coroutine)区分开(无栈协程本质上是一种有限状态机,状态保存在闭包里,自然比有栈协程恢复调用栈要轻量得多,但功能也相对更有限)。

协程的优势

协程的优势主要在于它比LWP要轻的多, 在64位Linux上HotSpot的线程栈容量默认是1MB,此外内核数据结构(Kernel Data Structures)还会额外消耗16KB内存, 而一个协程的栈通常在几百个字节到几KB之间,所以Java虚拟机里线程池容量达到两百就已经不算小了,而很多支持协程的应用中,同时并存的协程数量可数以十万计

协程当然也有它的局限,需要在应用层面实现的内容(调用栈、调度器这些)特别多, 除此之外,协程在最初,甚至在今天很多语言和框架中会被设计成协同式调度,这样在语言运行平台或者框架上的调度器就可以做得非常简单, 但是这种方法存在很严重的问题, 详解前面的协同式调度

并且具体到Java语言,还会有一些别的限制,譬如HotSpot这样的虚拟机,Java调用栈跟本地调用栈是做在一起的。如果在协程中调用了本地方法,还能否正常切换协程而不影响整个线程?另外,如果协程中遇传统的线程同步措施会怎样?譬如Kotlin提供的协程实现,一旦遭遇synchronize关键字,那挂起来的仍将是整个线程

Java的解决方案

对于有栈协程,有一种特例实现名为纤程(Fiber),这个词最早是来自微软公司,后来微软还推出过系统层面的纤程包来方便应用做现场保存、恢复和纤程调度。OpenJDK在2018年创建了Loom项目,这是Java用来应对本节开篇所列场景的官方解决方案,根据目前公开的信息,如无意外,日后该项目为Java语言引入的、与现在线程模型平行的新并发编程机制中应该也会采用“纤程”这个名字,不过这显然跟微软是没有任何关系的。从Oracle官方对“什么是纤程”的解释里可以看出,它就是一种典型的有栈协程

![]()

Loom项目背后的意图是重新提供对用户线程的支持,但与过去的绿色线程不同,这些新功能不是为了取代当前基于操作系统的线程实现,而是会有两个并发编程模型在Java虚拟机中并存,可以在程序中同时使用。新模型有意地保持了与目前线程模型相似的API设计,它们甚至可以拥有一个共同的基类,这样现有的代码就不需要为了使用纤程而进行过多改动,甚至不需要知道背后采用了哪个并发编程模型。Loom团队在JVMLS 2018大会上公布了他们对Jetty基于纤程改造后的测试结果,同样在5000QPS的压力下,以容量为400的线程池的传统模式和每个请求配以一个纤程的新并发处理模式进行对比,前者的请求响应延迟在10000至20000毫秒之间,而后者的延迟普遍在200毫秒以下,具体结果如图

![]()

在新并发模型下,一段使用纤程并发的代码会被分为两部分——执行过程(Continuation)和调度器(Scheduler)。执行过程主要用于维护执行现场,保护、恢复上下文状态,而调度器则负责编排所有要执行的代码的顺序。将调度程序与执行过程分离的好处是,用户可以选择自行控制其中的一个或者多个,而且Java中现有的调度器也可以被直接重用。事实上,Loom中默认的调度器就是原来已存在的用于任务分解的Fork/Join池(JDK 7中加入的ForkJoinPool)。

Loom项目目前仍然在进行当中,还没有明确的发布日期,上面笔者介绍的内容日后都有被改动的可能。如果读者现在就想尝试协程,那可以在项目中使用Quasar协程库[1],这是一个不依赖Java虚拟机的独立实现的协程库。不依赖虚拟机来实现协程是完全可能的,Kotlin语言的协程就已经证明了这一点。Quasar的实现原理是字节码注入,在字节码层面对当前被调用函数中的所有局部变量进行保存和恢复。这种不依赖Java虚拟机的现场保护虽然能够工作,但很影响性能,对即时编译器的干扰也非常大,而且必须要求用户手动标注每一个函数是否会在协程上下文被调用,这些都是未来Loom项目要

解决的问题。

如同JDK 5把Doug Lea的dl.util.concurrent项目引入,成为java.util.concurrent包,JDK 9时把Attila Szegedi的dynalink项目引入,成为jdk.dynalink模块。Loom项目的领导者Ron Pressler就是Quasar的作者

线程安全

当多个线程同时访问一个对象时,如果不用考虑这些线程在运行时环境下的调度和交替执行,也不需要进行额外的同步,或者在调用方进行任何其他的协调操作,调用这个对象的行为都可以获得正确的结果,那就称这个对象是线程安全的 --- Brian Goetz

不可变

不可变(Immutable)的对象一定是线程安全的, 使用 final 修饰的基础类型数据就是绝对安全的, 还有很多如 List.of() Map.of(), Set.of产生的集合都是线程安全的

绝对线程安全

当多个线程同时访问一个对象时,如果不用考虑这些线程在运行时环境下的调度和交替执行,也不需要进行额外的同步,或者在调用方进行任何其他的协调操作,调用这个对象的行为都可以获得正确的结果,那就称这个对象是线程安全的。

上面这种线程安全是很难实现的, 所以java绝对线程安全是没有的

例如Vector, 说是线程安全的, 但是Vector存在add和remove还有get一起使用的情况下是线程不安全的

相对线程安全

对象单次的操作是线程安全的, 就是相对线程安全

java语言中存在很多这样的集合比如 Vector, Hashtable还有使用上Collections的synchronizedCollection方法的包装集合都是相对线程安全的

线程兼容

线程兼容是指对象本身并不是线程安全的,但是可以通过在调用端正确地使用同步手段来保证对象在并发环境中可以安全地使用。我们平常说一个类不是线程安全的,通常就是指这种情况。Java类库API中大部分的类都是线程兼容的,如与前面的Vector和HashTable相对应的集合类ArrayList和HashMap等

线程对立

线程对立是指不管调用端是否采取了同步措施,都无法在多线程环境中并发使用代码。由于Java语言天生就支持多线程的特性,线程对立这种排斥多线程的代码是很少出现的,而且通常都是有害的,应当尽量避免。

一个线程对立的例子是Thread类的suspend()和resume()方法。如果有两个线程同时持有一个线程对象,一个尝试去中断线程,一个尝试去恢复线程,在并发进行的情况下,无论调用时是否进行了同步,目标线程都存在死锁风险——假如suspend()中断的线程就是即将要执行resume()的那个线程,那就肯定要产生死锁了。也正是这个原因,suspend()和resume()方法都已经被声明废弃了。常见的线程对立的操作还有System.setIn()、Sytem.setOut()和System.runFinalizersOnExit()等。

线程安全的实现方法

互斥同步

互斥同步(Mutual Exclusion & Synchronization)是一种最常见也是最主要的并发正确性保障手段。同步是指在多个线程并发访问共享数据时,保证共享数据在同一个时刻只被一条(或者是一些,当使用信号量的时候)线程使用。而互斥是实现同步的一种手段,临界区(Critical Section)、互斥量(Mutex)和信号量(Semaphore)都是常见的互斥实现方式。因此在“互斥同步”这四个字里面,互斥是因,同步是果;互斥是方法,同步是目的

在Java里面,最基本的互斥同步手段就是synchronized关键字,这是一种块结构(BlockStructured)的同步语法。synchronized关键字经过Javac编译之后,会在同步块的前后分别形成monitorenter和monitorexit这两个字节码指令。这两个字节码指令都需要一个reference类型的参数来指明要锁定和解锁的对象。如果Java源码中的synchronized明确指定了对象参数,那就以这个对象的引用作为reference;如果没有明确指定,那将根据synchronized修饰的方法类型(如实例方法或类方法),来决定是取代码所在的对象实例还是取类型对应的Class对象来作为线程要持有的锁。

在jdk1.5之前synchronized关键字效率是非常慢的, 所以引入了可重入锁ReentrantLock, 这种方法和synchronized 相似, 但是在那个时候Lock的方法效率比synchronized效率要高的高, 单核处理器下两种锁的吞吐量对比如下图

![]()

多核下比较:

![]()

并且ReentrantLock还提供了很多功能

等待可中断:是指当持有锁的线程长期不释放锁的时候,正在等待的线程可以选择放弃等待,改为处理其他事情。可中断特性对处理执行时间非常长的同步块很有帮助

公平锁:是指多个线程在等待同一个锁时,必须按照申请锁的时间顺序来依次获得锁;而非公平锁则不保证这一点,在锁被释放时,任何一个等待锁的线程都有机会获得锁。synchronized中的锁是非公平的,ReentrantLock在默认情况下也是非公平的,但可以通过带布尔值的构造函数要求使用公平锁。不过一旦使用了公平锁,将会导致ReentrantLock的性能急剧下降,会明显影响吞吐量

锁绑定多个条件:是指一个ReentrantLock对象可以同时绑定多个Condition对象。在synchronized中,锁对象的wait()跟它的notify()或者notifyAll()方法配合可以实现一个隐含的条件,如果要和多于一个的条件关联的时候,就不得不额外添加一个锁;而ReentrantLock则无须这样做,多次调用newCondition()方法即可

但是它也是有问题的, lock需要记得在finally中调用unlock方法

在jdk1.6甚至到jdk8+后Lock和synchronized的效率是差不多的, 所以前面的此时在现在来看是无所谓的

前面说了这么多的区别, 现在考虑下到底用那种方法?

lock的方法比较灵活, 还提供了公平锁, 锁绑定多个条件, 等待可中断等方法, 所以在复杂的情况下推荐使用这种方式, 但是要记得在finally中调用unlock方法

使用synchronized的话, 代码比较简洁清晰, 合适在比较简单的环境下使用

非阻塞同步

互斥同步使线程阻塞和唤醒, 也叫阻塞同步, 是悲观锁, 这种方案需要控制线程阻塞和唤醒都需要用到中断也就是系统调用, 而且共享变量不论是否安全, 都会上锁, 这种方法其实还是有比较不好的地方, 随着硬件指令集的发展,我们已经有了另外一个选择:基于冲突检测的乐观并发策略,通俗地说就是不管风险,先进行操作,如果没有其他线程争用共享数据,那操作就直接成功了;如果共享的数据的确被争用,产生了冲突,那再进行其他的补偿措施,最常用的补偿措施是不断地重试,直到出现没有竞争的共享数据为止。这种乐观并发策略的实现不再需要把线程阻塞挂起,因此这种同步操作被称为非阻塞同步(Non-Blocking Synchronization),使用这种措施的代码也常被称为无锁(Lock-Free)编程

为什么笔者说使用乐观并发策略需要“硬件指令集的发展”?因为我们必须要求操作和冲突检测这两个步骤具备原子性。靠什么来保证原子性?如果这里再使用互斥同步来保证就完全失去意义了,所以我们只能靠硬件来实现这件事情,硬件保证某些从语义上看起来需要多次操作的行为可以只通过一条处理器指令就能完成,这类指令常用的有:

测试并设置(Test-and-Set);

获取并增加(Fetch-and-Increment);

交换(Swap);

比较并交换(Compare-and-Swap,下文称CAS);

加载链接/条件储存(Load-Linked/Store-Conditional,下文称LL/SC;

其中,前面的三条是20世纪就已经存在于大多数指令集之中的处理器指令,后面的两条是现代处理器新增的,而且这两条指令的目的和功能也是类似的。在IA64、x86指令集中有用cmpxchg指令完成的CAS功能,在SPARC-TSO中也有用casa指令实现的,而在ARM和PowerPC架构下,则需要使用一对ldrex/strex指令来完成LL/SC的功能。因为Java里最终暴露出来的是CAS操作,所以我们以CAS指令为例进行讲解

CAS指令需要有三个操作数,分别是内存位置(在Java中可以简单地理解为变量的内存地址,用V表示)、旧的预期值(用A表示)和准备设置的新值(用B表示)。CAS指令执行时,当且仅当V符合A时,处理器才会用B更新V的值,否则它就不执行更新。但是,不管是否更新了V的值,都会返回V的旧值,上述的处理过程是一个原子操作,执行期间不会被其他线程中断

上面可能不太懂, 我总结下

cas指令有三个操作数, 其一线程工作内存; 其二主内存; 其三新值

判断工作内存的变量是否等于主存? 是 更新, 否 补偿(一般补偿方法是循环, 获取工作主存的值作为工作内存再次判断直到成功位置)

它存在一个逻辑漏洞:如果一个变量V初次读取的时候是A值,并且在准备赋值的时候检查到它仍然为A值,那就能说明它的值没有被其他线程改变过了吗?这是不能的,因为如果在这段期间它的值曾经被改成B,后来又被改回为A,那CAS操作就会误认为它从来没有被改变过。这个漏洞称为CAS操作的“ABA问题”, 虽然java提供了个类AtomicStampedReference解决这个问题, 不过这个ABA问题其实不影响程序的正确性, 所以AtomicStampedReference很鸡肋

线程上下文切换

cpu不可能一直都在一个线程上运行程序, 而是会切换到另一个进程上的线程上运行, 所以这中间需要保存当前线程的场景, 等到下次回到这个线程中执行的时候, 恢复场景使用

而每次切换都需要备份和重新载入这是需要消耗性能资源的

程序计数器+栈帧+局部变量+操作数栈+返回地址等信息需要恢复和备份

![]()

线程启动

一般调用start方法后, 线程不一定执行了, 也不一定没执行, 它是不确定的, 可能线程正处于就绪状态, 而且一个线程的start方法只能被调用一次, 多次调用会抛出异常IllegalThreadStateException

判断线程是否启动需要由程序调度器进行判断

线程新建默认状态是 NEW

线程start() 之后状态是 RUNNABLE

线程sleep() 后是 TIME_WAITING

线程阻塞之后是 BLOCKED

线程结束后是 TERMINATED

线程调用join() 方法后是WAITING

sleep方法和yield方法还有wait方法

sleep方法调用之后未必马上sleep, 如果sleep完毕之后线程状态为 TIME_WAIT 状态

sleep后的线程可以被唤醒, 但是会抛出异常

sleep和wait的区别在于, sleep不会释放锁和管程, wait会

![]()

线程中断Interrupt

注意Interrupt中的两个方法区别

isInterrupted 和 Interrupted 这两个方法都是判断是否终止了

但是前者不会消除中断标记, 后者会

这种消除中断标记和不消除中断标记的方式主要用在park的时候使用

如果标记没被消除, 该线程下次还是会被park住, 如果被消除, 则下次调用park无效

@Slf4j

public class ParkDemo {

@Test

public void test() throws Exception {

Thread thread = new Thread(() -> {

log.debug("park...");

// park

LockSupport.park();

log.debug("unpark ...");

// 显示打断标记

// log.debug("打断不清除标记: {}", Thread.currentThread().isInterrupted());

log.debug("打断清除标记: {}", Thread.interrupted());

LockSupport.park(); // Thread.interrupted() 清除标记后, 线程会在这里阻塞

log.debug("unpark ...");

});

thread.start();

// 打断线程

thread.interrupt();

thread.join();

}

}

两阶段终止模式

线程结束以前使用 stop() 但这是存在问题的, 比如线程A被stop掉了, 但是它的锁还在没被解除掉, 这样另一个等待这个锁的线程就永远阻塞了, 但是如果使用的是interrupt方法, 不仅仅线程被终止, 而且该线程的锁资源会被释放, 并且使用interrupt方法结束的线程还能够监控到自己被终止( isInterrupted 和 interrupted)而做出相对应的反应

利用 isInterrupted

interrupt 可以打断正在执行的线程,无论这个线程是在 sleep,wait,还是正常运行

class TPTInterrupt {

private Thread thread;

public void start() {

thread = new Thread(() -> {

while (true) {

Thread current = Thread.currentThread();

if (current.isInterrupted()) {

log.debug("料理后事");

break;

}

try {

Thread.sleep(1000);

log.debug("将结果保存");

} catch (InterruptedException e) {

current.interrupt();

}

// 执行监控操作

}

}, "监控线程");

thread.start();

}

public void stop() {

thread.interrupt();

}

}

调用

TPTInterrupt t = new TPTInterrupt();

t.start();

Thread.sleep(3500);

log.debug("stop");

t.stop();

结果

11:49:42.915 c.TwoPhaseTermination [监控线程] - 将结果保存

11:49:43.919 c.TwoPhaseTermination [监控线程] - 将结果保存

11:49:44.919 c.TwoPhaseTermination [监控线程] - 将结果保存

11:49:45.413 c.TestTwoPhaseTermination [main] - stop

11:49:45.413 c.TwoPhaseTermination [监控线程] - 料理后事

利用停止标记

// 停止标记用 volatile 是为了保证该变量在多个线程之间的可见性

// 我们的例子中,即主线程把它修改为 true 对 t1 线程可见

class TPTVolatile {

private Thread thread;

private volatile boolean stop = false;

public void start() {

thread = new Thread(() -> {

while (true) {

Thread current = Thread.currentThread();

if (stop) {

log.debug("料理后事");

break;

}

try {

Thread.sleep(1000);

log.debug("将结果保存");

} catch (InterruptedException e) {

}

// 执行监控操作

}

}, "监控线程");

thread.start();

}

public void stop() {

stop = true;

thread.interrupt();

}

}

调用

TPTVolatile t = new TPTVolatile();

t.start();

Thread.sleep(3500);

log.debug("stop");

t.stop();

结果

11:54:52.003 c.TPTVolatile [监控线程] - 将结果保存

11:54:53.006 c.TPTVolatile [监控线程] - 将结果保存

11:54:54.007 c.TPTVolatile [监控线程] - 将结果保存

11:54:54.502 c.TestTwoPhaseTermination [main] - stop

11:54:54.502 c.TPTVolatile [监控线程] - 料理后事

主线程和守护线程

一般情况下, 进程需要等待所有的线程退出后才会退出, 但是守护线程不会, 进程不会等待守护线程, 直接强制退出

我们jvm的垃圾回收gc就是守护线程

管程 --- 悲观锁(阻塞)

临界区

一段代码块对共享资源存在多个线程的读写操作, 我们就叫它临界区

临界区存在多个线程竞争共享资源的问题, 由于分时系统, 我们的cpu不能一直负责一条线程的执行, 所以在cpu切换的时候需要保存当时的场景, 之后cpu回来后需要恢复场景再次执行代码, 我们简称这个过程为线程上下文切换

而线程竞争共享资源的这个过程中, 由于执行序列不同而导致的结果无法预测, 我们称之为竞态条件

synchronized(重量级锁)

synchronized重量级锁我们称之为[对象锁]方案, 意味着这个方案的时候需要一个对象, 使用这个方案我们就再也不需要担心线程上下文切换导致的问题了, 在这个代码块中永远只会有一个线程执行, 直到线程释放了这个对象锁

官方版: 对象锁保证了临界区的原子性

注意: 同时我发现锁方案不能规避代码重排的问题, 前文懒汉模式对象的volatile关键字就是因为这个原因

synchronized修饰方式:

修饰在普通方法或者使用this作为对象锁的对象 ----- 都表示把this类对象当作对象锁的对象

修饰在静态方法或者类.class方法进行修饰 ----- 表示将类名作为对象锁的对象

@Slf4j

public class Demo01 {

private static int counter = 0;

private static Object lock = new Object();

@Test

public void test04() throws Exception {

Thread t1 = new Thread(() -> {

for (int i = 0; i < 5000; i++) {

synchronized (lock) {

counter++;

}

}

}, "t1");

Thread t2 = new Thread(() -> {

for (int i = 0; i < 5000; i++) {

synchronized (lock) {

counter--;

}

}

}, "t2");

t1.start();

t2.start();

t1.join();

t2.join();

log.debug("res counter = {}", counter);

}

}

注意: 对象锁的对象是非常重要的, 对象就是一把钥匙, 被线程1拿走了, 线程2只能等线程1用完了还回来继续用

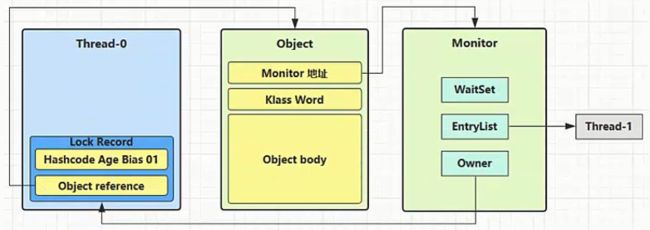

其底层使用的是monitor锁的概念

Monitor概念

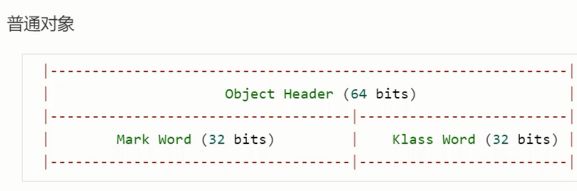

对象头结构

以32位虚拟机为例

Klass World(代表类型) 指针指向了Class对象的地址; age: 幸存区年龄, 一次自增一次, 直到15次, 直接送到老年区

对象头只对象才会有, 如果是基本类型的话, 则没有

比如 int 是4 Integer 则是12

Monitor(锁) --- synchronized底层原理

是什么???

monitor被翻译成监视器或者管程

每个Java对象都可以关联一个Monitor对象,如果使用synchronized给对象上锁(重量级锁)之后, 该对象头的Mark Monitor 中被设置指向Monitor对象的指针

Monitor结构如下:

![]()

java源码:

@Slf4j

public class SynchronizedDemo {

final Object lock = new Object();

int counter = 0;

@Test

public void test() {

synchronized (lock) {

counter++;

}

}

}

字节码:

public void test();

Code:

0: aload_0

1: getfield #3 // lock 引用(synchronized开始)

4: dup

5: astore_1 // lock引用 -> slot 1

6: monitorenter // 将lock对象MarkWord置为Monitor指针

7: aload_0

8: dup

9: getfield #4 // i

12: iconst_1 // 准备常数 1

13: iadd // +1

14: putfield #4 // i

17: aload_1 // lock 引用

18: monitorexit // 将 lock 对象 MarkWord 重置, 唤醒 EntryList

19: goto 27

22: astore_2 // e -> slot2, 将异常放入 slot2

23: aload_1 // lock 引用

24: monitorexit // 将 lock 对象 MarkWord 重置, 唤醒 EntryList

25: aload_2 // slot2 (e)

26: athrow // throw e

27: return

Exception table:

from to target type

7 19 22 any // 监控异常 7~19行只要发生错误跳转到 22 行处理

22 25 22 any

Synchronized底层原理进阶

可重入代码(Reentrant Code):这种代码又称纯代码(Pure Code),是指可以在代码执行的任何时刻中断它, 转而去执行另一段代码, 而在控制权限返回之后, 重新回到这个方法后不会有任何的影响, 这种代码就是可重入代码

可重入代码有一些共同的特征,例如,不依赖全局变量、存储在堆上的数据和公用的系统资源,用到的状态量都由参数中传入,不调用非可重入的方法等。我们可以通过一个比较简单的原则来判断代码是否具备可重入性:如果一个方法的返回结果是可以预测的,只要输入了相同的数据,就都能返回相同的结果,那它就满足可重入性的要求,当然也就是线程安全的。

线程本地存储(Thread Local Storage):如果一段代码中所需要的数据必须与其他代码共享,那就看看这些共享数据的代码是否能保证在同一个线程中执行。如果能保证,我们就可以把共享数据的可见范围限制在同一个线程之内,这样,无须同步也能保证线程之间不出现数据争用的问题

案例: ThreadLocal web服务器, 一个请求一个线程

小故事

故事角色

老王 - JVM

小南 - 线程

小女 - 线程

房间 - 对象

房间门上 - 防盗锁 - Monitor

房间门上 - 小南书包 - 轻量级锁

房间门上 - 刻上小南大名 - 偏向锁

批量重刻名 - 一个类的偏向锁撤销到达 20 阈值

不能刻名字 - 批量撤销该类对象的偏向锁,设置该类不可偏向

小南要使用房间保证计算不被其它人干扰(原子性),最初,他用的是防盗锁,当上下文切换时,锁住门。这样,即使他离开了,别人也进不了门,他的工作就是安全的。

但是,很多情况下没人跟他来竞争房间的使用权。小女是要用房间,但使用的时间上是错开的,小南白天用,小女晚上用。每次上锁太麻烦了,有没有更简单的办法呢?

小南和小女商量了一下,约定不锁门了,而是谁用房间,谁把自己的书包挂在门口,但他们的书包样式都一样,因此每次进门前得翻翻书包,看课本是谁的,如果是自己的,那么就可以进门,这样省的上锁解锁了。万一书包不是自己的,那么就在门外等,并通知对方下次用锁门的方式。

后来,小女回老家了,很长一段时间都不会用这个房间。小南每次还是挂书包,翻书包,虽然比锁门省事了,但仍然觉得麻烦。

于是,小南干脆在门上刻上了自己的名字:【小南专属房间,其它人勿用】,下次来用房间时,只要名字还在,那么说明没人打扰,还是可以安全地使用房间。如果这期间有其它人要用这个房间,那么由使用者将小南刻的名字擦掉,升级为挂书包的方式。

同学们都放假回老家了,小南就膨胀了,在 20 个房间刻上了自己的名字,想进哪个进哪个。后来他自己放假回老家了,这时小女回来了(她也要用这些房间),结果就是得一个个地擦掉小南刻的名字,升级为挂书包的方式。老王觉得这成本有点高,提出了一种批量重刻名的方法,他让小女不用挂书包了,可以直接在门上刻上自己的名字后来,刻名的现象越来越频繁,老王受不了了:算了,这些房间都不能刻名了,只能挂书包。

java对象头

在32位虚拟机前提下:

首先要了解 JVM 对象结构, hotspot 虚拟机的对象头结构分成两个部分

第一部分用于存储对象运行时数据, 如hashcode, gc 分代年龄等等, 另一部分主要存储这部分数据的长度在32位和64位的Java虚拟机中分别会占用32个或64个比特,官方称它为“Mark Word”。这部分是实现轻量级锁和偏向锁的关键, 另外一部分用于存储指向方法区对象类型数据的指针

如果是数组对象,还会有一个额外的部分用于存储数组长度

由于对象头信息是与对象自身定义的数据无关的额外存储成本,考虑到Java虚拟机的空间使用效率,Mark Word被设计成一个非固定的动态数据结构,以便在极小的空间内存储尽量多的信息。它会根据对象的状态复用自己的存储空间。

![]()

![]()

64 位虚拟机 Mark Word:

![]()

轻量级锁

是什么???

顾名思义,轻量级锁是相对于重量级锁而言的。使用轻量级锁时,不需要申请互斥量,仅仅_将Mark Word中的部分字节CAS更新指向线程栈中的Lock Record,如果更新成功,则轻量级锁获取成功_,记录锁状态为轻量级锁;否则,说明已经有线程获得了轻量级锁,目前发生了锁竞争(不适合继续使用轻量级锁),接下来膨胀为重量级锁。

为什么要用轻量级锁???

为了防止某个时间段内不存在多线程竞争的环境使用上重量级锁浪费资源, 所以java引入了轻量级锁这个概念

什么时候使用轻量级锁?

如果一个对象虽然有多线程访问, 但是多线程的访问时间是错开的(也就是没有竞争关系), 那么就能够使用轻量级锁来优化, 轻量级锁对使用者是透明的, 关键字就是synchronized

怎么使用的轻量级锁?

假设存在两个同步块, 利用同一个对象加锁

@Slf4j

public class LightweightLockDemo {

private static final Object obj = new Object();

private static void method01() {

synchronized (obj) {

method02();

}

}

private static void method02() {

synchronized (obj) {

System.out.println("method02");

}

}

@Test

public void test() throws Exception {

method01();

}

}

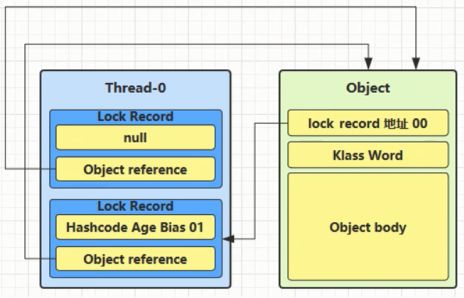

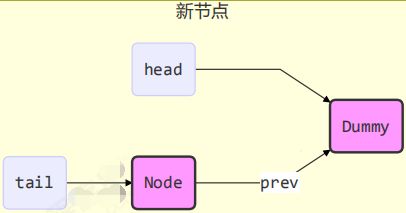

加锁过程

(1) 在线程栈里面创建一个锁记录(Lock Record)对象, 每个线程的栈帧都会存在一个锁记录(Lock Record)的结构, 内部可以存储对象的Mark Word

![]()

(2) 让锁记录中的Object reference指向锁对象的Object引用, 并尝试使用cas替换掉Object锁对象的Mark Word, 并将Mark Word 的值存入锁记录(交换)

![]()

(3) 如果cas替换成功, 对象头中存储了锁记录地址和状态00, 表示由该线程对象加锁, 这时图示如下:

![]()

![]()

(4) 如果cas失败, 有两种情况:

-

如果是其他线程已经持有了该Object的轻量级锁, 这时表明有竞争, 进入说膨胀过程

-

如果时自己执行了 synchronized 锁重入, 那么再添加一条 Lock Record 作为重入的计数

解锁过程

(1) 当退出 synchronized 代码块(解锁时)如果有取值为null的锁记录, 表示有重入, 这时重置锁记录, 表示重入计数减一

![]()

(2) 当退出 synchronized 代码块(解锁时)锁记录的值不为null, 这时使用 cas 将 Mark Word 的值恢复给对象头

- 成功, 则解锁成功

- 失败, 说明轻量级锁进行了锁膨胀或已经升级为重量级锁, 进入重量级锁解锁流程

锁膨胀

如果在尝试加轻量级锁的过程中, cas操作无法成功, 这时一种清凉就是有其他线程为此对象加上了轻量级锁(有竞争), 这时需要进行锁膨胀, 将轻量级锁变为重量级锁

private static final Object obj = new Object();

private static void method01() {

synchronized (obj) {

// 同步代码块

}

}

(1) 当线程1进行轻量级锁加锁时, 发现线程0已经对该对象加上了轻量级锁

![]()

![]()

(2) 这时线程1加轻量级锁失败, 进入锁膨胀流程

-

即为Object对象申请Monitor锁, 让Object指向重量级锁地址

-

然后自己进入Monitor的EntryList BLOCKED

当线程0退出同步块解锁时, 使用cas将Mark Word 的值恢复给对象头, 失败. 这时会进入重量级解锁流程, 即按照Monitor地址找到Monitor对象, 设置Owner为null, 唤醒EntryList中BOCKED线程

优缺点

如果不存在竞争的话, 那么cas操作避免了互斥锁的重量级操作, 如果存在竞争的话, 那么这个操作不仅仅需要使用互斥量本身的开销之外, 还需要cas操作的开销, 比直接使用互斥量的开销还大

自旋锁与自适应自旋(适合多核CPU)

是什么???

重量级锁竞争的时候, 还可以使用自旋来进行优化, 如果当前线程自旋成功(即这时候持锁线程已经退出了同步块, 释放了锁), 这时当前线程就可以避免阻塞

线程阻塞之前做一个忙循环(自旋), 默认是10次循环, 可以使用参数-XX:PreBlockSpin来自行更改, 有前提, 要是多核cpu

下面是自旋重试成功的情况:

![]()

下面是自旋重试失败的情况:

![]()

jdk6自动开启自旋锁, jdk7后不再默认开启

为什么要使用自旋锁?

线程的阻塞是需要挂起和恢复线程的, 两个操作需要转入内核态来完成, 所以效率比较低, 所以引入了一个忙循环的过程, 在这个过程中也许前面获得锁的线程已经结束释放了锁, 这时忙循环的线程就能够直接获得这个锁, 不需要转入内核态了

有什么优缺点?

优点

是减少了线程转入内核态所需要的时间

缺点

如果前一个获得锁的线程没有在十次循环的时间内结束, 则这个循环所需要的cpu资源却耗费了

如果使用的系统是单核系统, 不论如何自旋都是浪费时间的

什么是自适应自旋???

自适应代表了自旋的次数不再是固定的10次, 而是可变的

为什么使用自适应自旋???

自适应自旋是为了减少'不可能或者相对较少'进入自旋的锁, 用更多的时间放在经常成功进入自旋的锁上, 这样加快了性能

缺点:

自适应自旋锁的时间过高或者过低, 那么自适应自旋锁就无法适应到合适的范围了

锁消除

是什么?

锁消除就是消除那些根本不存在共享对象竞争却用到锁的代码块上的锁

什么时候使用锁消除?

通过逃逸分析判断来确认一段代码是否需要锁消除

逃逸分析: 一个对象在方法中产生, 如果被当作其他方法的参数, 这种叫方法逃逸, 如果被其他线程访问到, 则叫线程逃逸

有些时候程序员并没有主动调用到互斥同步方法, 它还是被动被调用了, 例如:

public String concatString(String s1, String s2, String s3) {

return s1 + s2 + s3;

}

上面这段代码在jdk1.5之前会被翻译成StringBuffer来完成字符串对象连接, 在jdk1.5之后会被优化为StringBuilder

public String concatString(String s1, String s2, String s3) {

StringBuffer sb = new StringBuffer();

sb.append(s1);

sb.append(s2);

sb.append(s3);

return sb.toString();

}

假设上面的方法就是jdk1.5之前的反汇编代码, 这个代码已经用到了同步互斥的功能了, 但是程序员看到的却是 s1 + s2 + s3 , 根本无法被判断, 但是逃逸分析分析出来了这里的代码并未发生逃逸现象, 这里的锁是 sb 对象, 但是 sb 是线程单独的对象(不是共享资源), 不会被多线程影响到, 还有 s1 s2 s3 都是不变对象, sb在连接字符串时sb的返回结果是不变的, 所以这也是一个可重入方法, 也是线程安全的(当然这一切都建立在 sb 不是共享资源的前提下, 如果sb是共享资源, 则这个方法是不安全的, append方法将被多次执行, 那就不是 s1 + s2+ s3这么简单了)

锁粗化

是什么? 为什么?

加锁的范围尽量小, 只在共享变量的修改操作范围上加锁就好, 但是如果锁的外面就是循环的话, 锁最好放在循环外面, 即使修改的只有循环内的共享资源, 这样便会减少锁过多的进行加锁释放阻塞恢复等操作, 如果虚拟机检测到一直出现对同一个对象进行多次加锁操作的代码块, 虚拟机便会把锁粗化到这些操作的范围上, 只需要一把锁就好, 这便是锁粗化

偏向锁

是什么???

轻量级锁在没有竞争时(就自己这个线程), 每次重入仍然需要执行cas操作

jdk6中引入了偏向锁来做进一步优化: 只有第一次使用cas将线程ID设置到对象的Mark Work头, 之后发现这个线程ID是自己的就表示没有竞争, 不用重新cas, 以后只要不发生竞争, 这个对象就归该线程所有

作比较:

![]()

![]()

细心的读者看到这里可能会发现一个问题:当对象进入偏向状态的时候,Mark Word大部分的空间(23个比特)都用于存储持有锁的线程ID了,这部分空间占用了原有存储对象哈希码的位置,那原来对象的哈希码怎么办呢?

![]()

在Java语言里面一个对象如果计算过哈希码,就应该一直保持该值不变(强烈推荐但不强制,因为用户可以重载hashCode()方法按自己的意愿返回哈希码),否则很多依赖对象哈希码的API都可能存在出错风险。而作为绝大多数对象哈希码来源的Object::hashCode()方法,返回的是对象的一致性哈希码(Identity Hash Code),这个值是能强制保证不变的,它通过在对象头中存储计算结果来保证第一次计算之后,再次调用该方法取到的哈希码值永远不会再发生改变。因此,当一个对象已经计算过一致性哈希码后,它就再也无法进入偏向锁状态了;而当一个对象当前正处于偏向锁状态,又收到需要计算其一致性哈希码请求时,它的偏向状态会被立即撤销,并且锁会膨胀为重量级锁。在重量级锁的实现中,对象头指向了重量级锁的位置,代表重量级锁的ObjectMonitor类里有字段可以记录非加锁状态(标志位为“01”)下的Mark Word,其中自然可以存储原来的哈希码

偏向状态

![]()

一个对象创建时:

- 如果开启了偏向锁(默认开启),那么对象创建后,markword值为0x05即最后3位为101,这时它的thread、epoch、 age 都为0

- 偏向锁是默认是延迟的,不会在程序启动时立即生效,如果想避免延迟,可以加VM参数-XX:BiasedLockingStartupDelay=e来禁用延迟

- 如果没有开启偏向锁,那么对象创建后,markword 值为0x01即最后3位为001,这时它的hashcode、age

都为0,第一次用到hashcode时才会赋值

测试禁用

在上面测试代码运行时在添加VM参数-XX:-UseBiasedLocking禁用偏向锁

OFFSET SIZE TYPE DESCRIPTION VALUE

0 4 (object header) 01 00 00 00 (00000001 00000000 00000000 00000000) (1)

4 4 (object header) 00 00 00 00 (00000000 00000000 00000000 00000000) (0)

8 4 (object header) 40 80 10 00 (01000000 10000000 00010000 00000000) (1081408)

12 4 (loss due to the next object alignment)

Instance size: 16 bytes

Space losses: 0 bytes internal + 4 bytes external = 4 bytes total

com.zhazha.sync.Dog object internals:

OFFSET SIZE TYPE DESCRIPTION VALUE

0 4 (object header) 30 e1 8f 52 (00110000 11100001 10001111 01010010) (1385161008)

4 4 (object header) 21 00 00 00 (00100001 00000000 00000000 00000000) (33)

8 4 (object header) 40 80 10 00 (01000000 10000000 00010000 00000000) (1081408)

12 4 (loss due to the next object alignment)

Instance size: 16 bytes

Space losses: 0 bytes internal + 4 bytes external = 4 bytes total

com.zhazha.sync.Dog object internals:

OFFSET SIZE TYPE DESCRIPTION VALUE

0 4 (object header) 01 00 00 00 (00000001 00000000 00000000 00000000) (1)

4 4 (object header) 00 00 00 00 (00000000 00000000 00000000 00000000) (0)

8 4 (object header) 40 80 10 00 (01000000 10000000 00010000 00000000) (1081408)

12 4 (loss due to the next object alignment)

Instance size: 16 bytes

Space losses: 0 bytes internal + 4 bytes external = 4 bytes total

为什么???

偏向锁就是在无竞争环境下, 消除同步使用互斥量, 把整个临界区的同步都消除掉, 甚至连cas都不需要

有什么优点和缺点???

偏向锁可以提高带有同步但无竞争的程序性能,但它同样是一个带有效益权衡(Trade Off)性质的优化,也就是说它并非总是对程序运行有利。如果程序中大多数的锁都总是被多个不同的线程访问,那偏向模式就是多余的。在具体问题具体分析的前提下,有时候使用参数-XX:-UseBiasedLocking来禁止偏向锁优化反而可以提升性能。

撤销 - 调用对象 hashCode

调用了对象的hashCode,但偏向锁的对象MarkWord中存储的是线程id,如果调用hashCode会导致偏向锁

被撤销

■轻量级锁会在锁记录中记录hashCode

■重量级锁会在Monitor中记录hashCode

在调用hashCode后使用偏向锁,记得去掉-XX: -UseBiasedLocking

撤销-其它线程使用对象

当有其它线程使用偏向锁对象时,会将偏向锁升级为轻量级锁

撤销-调用wait/notify

批量重偏向

如果对象虽然被多个线程访问,但没有竞争,这时偏向了线程T1的对象仍有机会重新偏向T2,重偏向会重置对象的Thread ID

当撤销偏向锁阈值超过20次后,jvm 会这样觉得,我是不是偏向错了呢,于是会在给这些对象加锁时重新偏向至加锁线程

@Slf4j(topic = "c.TestBiased")

public class TestBiased {

static Thread t1,t2,t3;

public static void main(String[] args) throws InterruptedException {

test4();

}

private static void test4() throws InterruptedException {

Vector list = new Vector<>();

int loopNumber = 38;

t1 = new Thread(() -> {

for (int i = 0; i < loopNumber; i++) {

Dog d = new Dog();

list.add(d);

synchronized (d) {

log.debug(i + "\t" + ClassLayout.parseInstance(d).toPrintableSimple(true));

}

}

LockSupport.unpark(t2);

}, "t1");

t1.start();

t2 = new Thread(() -> {

LockSupport.park();

log.debug("===============> ");

for (int i = 0; i < loopNumber; i++) {

Dog d = list.get(i);

log.debug(i + "\t" + ClassLayout.parseInstance(d).toPrintableSimple(true));

synchronized (d) {

log.debug(i + "\t" + ClassLayout.parseInstance(d).toPrintableSimple(true));

}

log.debug(i + "\t" + ClassLayout.parseInstance(d).toPrintableSimple(true));

}

LockSupport.unpark(t3);

}, "t2");

t2.start();

t3 = new Thread(() -> {

LockSupport.park();

log.debug("===============> ");

for (int i = 0; i < loopNumber; i++) {

Dog d = list.get(i);

log.debug(i + "\t" + ClassLayout.parseInstance(d).toPrintableSimple(true));

synchronized (d) {

log.debug(i + "\t" + ClassLayout.parseInstance(d).toPrintableSimple(true));

}

log.debug(i + "\t" + ClassLayout.parseInstance(d).toPrintableSimple(true));

}

}, "t3");

t3.start();

t3.join();

log.debug(ClassLayout.parseInstance(new Dog()).toPrintableSimple(true));

}

}

class Dog {}

如果切换过多(可能是39次), jvm可能会觉得这个临界区不适合使用偏向锁, 转而膨胀成轻量级锁

wait/notify

小故事-为什么需要wait

●由于条件不满足,小南不能继续进行计算

●但小南如果一直占用着锁,其它人就得一直阻塞,效率太低

![]()

●于是老王单开了一间休息室(调用wait方法) ,让小南到休息室( WaitSet )等着去了,但这时锁释放开,

其它人可以由老王随机安排进屋

●直到小M将烟送来,大叫--声你的烟到了(调用notify方法)

![]()

●小南于是可以离开休息室,重新进入竞争锁的

![]()

●此时小南要和其他线程重新抢夺进门的权限了(时间片)

wait和notify底层实现

![]()

■Owner 线程发现条件不满足,调用wait方法,即可进入WaitSet变为WAITING状态

■BLOCKED和WAITING的线程都处于阻塞状态,不占用CPU时间片

■BLOCKED线程会在Owner线程释放锁时唤醒

■WAITING 线程会在Owner线程调用notify或notifyAll时唤醒,但唤醒后并不意味者立刻获得锁,仍需进入EntryList重新竞争

API介绍

■obj.wait() 让进入 object 监视器的线程到 waitSet 等待

■obj.notify() 在 object 上正在 waitSet 等待的线程中挑一个唤醒

■obj.notifyAll() 让 object 上正在 waitSet 等待的线程全部唤醒

它们都是线程之间进行协作的手段,都属于 Object 对象的方法。必须获得此对象的锁,才能调用这几个方法

final static Object obj = new Object();

public static void main(String[] args) {

new Thread(() -> {

synchronized (obj) {

log.debug("执行....");

try {

obj.wait(); // 让线程在obj上一直等待下去

} catch (InterruptedException e) {

e.printStackTrace();

}

log.debug("其它代码....");

}

}).start();

new Thread(() -> {

synchronized (obj) {

log.debug("执行....");

try {

obj.wait(); // 让线程在obj上一直等待下去

} catch (InterruptedException e) {

e.printStackTrace();

}

log.debug("其它代码....");

}

}).start();

// 主线程两秒后执行

sleep(2);

log.debug("唤醒 obj 上其它线程");

synchronized (obj) {

obj.notify(); // 唤醒obj上一个线程

// obj.notifyAll(); // 唤醒obj上所有等待线程

}

}

wait() 方法会释放对象的锁,进入 WaitSet 等待区,从而让其他线程就机会获取对象的锁。无限制等待,直到notify 为止

wait(long n) 有时限的等待, 到 n 毫秒后结束等待,或是被 notify

虚假唤醒

obj.notify(); // 随机唤醒obj上一个线程

// obj.notifyAll(); // 唤醒obj上所有等待线程

上面的情况需要考虑到虚假唤醒的情况, 不管是上面的notify唤醒还是下面的notifyAll唤醒, 都存在错误唤醒的问题, 比如: notify随机唤醒了相同锁上面的另一个锁, 虽然这个锁被唤醒了, 但是不是notify想要唤醒的那个线程, 所以它被虚假唤醒了

再比如: 使用notifyAll, 全部线程都被唤醒了, 这样子不需要唤醒的线程也被唤醒了, 这里也存在虚假唤醒

wait notify 的正确姿势

sleep(long n) 和 wait(long n) 的区别

- sleep是Thread方法,而wait是Object的方法

- sleep不需要强制和synchronized配合使用,但wait需要和synchronized 一起用

- sleep在睡眠的同时,不会释放对象锁的,但wait在等待的时候会释放对象锁。

- 它们状态TIMED_ WAITING

模式之保护性暂停

同步模式之保护性暂停

是什么?

即Guarded Suspension,用在一个线程等待另一个线程的执行结果

要点

■有一个结果需要从一个线程传递到另一个线程, 让他们关联同一个GuardedObject

■如果有结果不断从一个线程到另一个线程那么可以使用消息队列(见生产者消费者)

■JDK中,join的实现、Future的实现,采用的就是此模式

■因为要等待另一方的结果, 因此归类到同步模式

![]()

@Slf4j

public class GuardedObjectDemo {

@Test

public void test() throws Exception {

CountDownLatch latch = new CountDownLatch(2);

GuardedObject guardedObject = new GuardedObject();

new Thread(() -> {

try {

log.debug("等待结果...");

Optional> optional = Optional.ofNullable((List) guardedObject.getWaitTime(10000));

List list = optional.orElse(new ArrayList<>());

log.debug("结果大小: {}", list.size());

latch.countDown();

} catch (InterruptedException e) {

e.printStackTrace();

}

}, "t1").start();

new Thread(() -> {

log.debug("开始下载... ");

try {

List list = Downloader.download();

guardedObject.complete(list);

} catch (IOException e) {

e.printStackTrace();

}

latch.countDown();

}, "t2").start();

latch.await();

}

class GuardedObject {

// 结果

private Object response;

/**

* 获取结果

*

* @return

*

* @throws InterruptedException

*/

public Object get() throws InterruptedException {

synchronized (this) {

while (null == response) {

this.wait();

}

}

return response;

}

/**

* 获取结果, 设置最长超时时间

*

* @param timeOutTime

* 最长超时时间

*

* @return

*

* @throws InterruptedException

*/

public Object getWaitTime(long timeOutTime) throws InterruptedException {

synchronized (this) {

LocalDateTime start = LocalDateTime.now();

long passTime;

long waitTime = 0;

while (response == null) {

passTime = timeOutTime - waitTime;

if (passTime <= 0) {

break;

}

this.wait(passTime);

Duration duration = Duration.between(start, LocalDateTime.now());

waitTime = duration.toMillis();

}

}

return response;

}

/**

* 产生结果

*

* @param response

*/

public void complete(Object response) {

synchronized (this) {

this.response = response;

this.notifyAll();

}

}

}

}

异步模式之生产者和消费者

要点

■与前面的保护性暂停中的GuardObject不同,不需要产生结果和消费结果的线程一- 对应

■消费队列可以用来平衡生产和消费的线程资源

■生产者仅负责产生结果数据,不关心数据该如何处理,而消费者专心处理结果数据

■消息队列是有容量限制的,满时不会再加入数据,空时不会再消耗数据

■JDK中各种阻塞队列,采用的就是这种模式

![]()

@Slf4j

public class MessageQueueDemo {

public static void main(String[] args) {

MessageQueue queue = new MessageQueue(2);

for (int i = 0; i < 3; i++) {

int tmp = i;

new Thread(() -> queue.put(new Message(tmp, "message " + tmp)), "生成者" + i).start();

}

new Thread(() -> {

while (true) {

try {

TimeUnit.SECONDS.sleep(1);

} catch (InterruptedException e) {

e.printStackTrace();

}

queue.task();

}

}, "消费者").start();

}

}

@Slf4j(topic = "c.MessageQueue")

class MessageQueue {

private final LinkedList messageList = new LinkedList<>();

private Integer capcity;

public MessageQueue(Integer capcity) {

this.capcity = capcity;

}

/**

* 获取消息

*

* @return

*/

public Message task() {

synchronized (messageList) {

Message message;

try {

while (messageList.isEmpty()) {

try {

log.debug("队列为空, 消费者线程等待");

messageList.wait();

} catch (InterruptedException e) {

e.printStackTrace();

}

}

message = messageList.removeFirst();

log.debug("消费了消息message = {}", message);

} finally {

messageList.notifyAll();

}

return message;

}

}

/**

* 存入消息

*

* @param message

*/

public void put(Message message) {

synchronized (messageList) {

try {

while (capcity == messageList.size()) {

try {

log.debug("消息队列满了, 线程等待消息被消费后再次存入消息");

messageList.wait();

} catch (InterruptedException e) {

e.printStackTrace();

}

}

messageList.add(message);

log.debug("生产了消息 message = {}", message);

} finally {

messageList.notifyAll();

}

}

}

}

@Slf4j(topic = "c.Message")

class Message {

private Integer id;

private String message;

@Override

public String toString() {

return "Message{" + "id=" + id + ", message='" + message + '\'' + '}';

}

public Integer getId() {

return id;

}

public void setId(Integer id) {

this.id = id;

}

public String getMessage() {

return message;

}

public void setMessage(String message) {

this.message = message;

}

public Message(Integer id, String message) {

this.id = id;

this.message = message;

}

}

Park && Unpark

它们是LockSupport类中的方法

public static void main(String[] args) throws InterruptedException {

Thread t1 = new Thread(() -> {

log.debug("线程{}运行了, 并且即将调用park", Thread.currentThread().getName());

LockSupport.park();

log.debug("线程{} unpark成功", Thread.currentThread().getName());

}, "t1");

t1.start();

TimeUnit.SECONDS.sleep(1);

LockSupport.unpark(t1);

log.debug("解锁了");

}

特点

与Object的wait & notify相比

■wait, notify 和notifyAll必须配合Object Monitdr一起使用,而unpark不必

■park & unpark是以线程为单位来[阻塞]和[唤醒]线程,而notify只能随机唤醒一个等待线程,notifyAll是唤醒所有等待线程,就不那么[精确]

■park & unpark可以先unpark,而wait & notify不能先notify

park/unpark原理

每个线程都有自己的一个Parker对象,由三部分组成 _counter, _cond 和 _mutex 打个比喻

■线程就像一个旅人,Parker 就像他随身携带的背包,条件变量就好比背包中的帐篷。_counter 就好比背包中的备用干粮(0 为耗尽,1 为充足)

■调用park就是要看需不需要停下来歇息

■如果备用干粮耗尽,那么钻进帐篷歇息

■如果备用干粮充足,那么不需停留,继续前进

■调用unpark, 就好比令干粮充足

■如果这时线程还在帐篷,就唤醒让他继续前进

■如果这时线程还在运行,那么下次他调用park时,仅是消耗掉备用干粮,不需停留继续前进

■因为背包空间有限,多次调用unpark仅会补充一 份备用干粮

![]()

![]()

![]()

![]()

如果先调用unpark再调用park呢?

![]()

![]()

重新理解线程状态转换

![]()

假设有线程 Thread t

情况 1 NEW --> RUNNABLE

- 当调用 t.start() 方法时,由 NEW --> RUNNABLE

情况 2 RUNNABLE <--> WAITING

t 线程用 synchronized(obj) 获取了对象锁后

-

调用 obj.wait() 方法时,t 线程从 RUNNABLE --> WAITING

-

调用 obj.notify() , obj.notifyAll() , t.interrupt() 时

竞争锁成功,t 线程从 WAITING --> RUNNABLE

竞争锁失败,t 线程从 WAITING --> BLOCKED

public class TestWaitNotify {

final static Object obj = new Object();

public static void main(String[] args) {

new Thread(() -> {

synchronized (obj) {

log.debug("执行....");

try {

obj.wait();

} catch (InterruptedException e) {

e.printStackTrace();

}

log.debug("其它代码...."); // 断点

}

},"t1").start();

new Thread(() -> {

synchronized (obj) {

log.debug("执行....");

try {

obj.wait();

} catch (InterruptedException e) {

e.printStackTrace();

}

log.debug("其它代码...."); // 断点

}

},"t2").start();

sleep(0.5);

log.debug("唤醒 obj 上其它线程");

synchronized (obj) {

obj.notifyAll(); // 唤醒obj上所有等待线程 断点

}

}

}

情况 3 RUNNABLE <--> WAITING

-

当前线程调用 t.join() 方法时,当前线程从 RUNNABLE --> WAITING

注意是当前线程在t 线程对象的监视器上等待

-

t 线程运行结束,或调用了当前线程的 interrupt() 时,当前线程从 WAITING --> RUNNABLE

情况 4 RUNNABLE <--> WAITING

- 当前线程调用 LockSupport.park() 方法会让当前线程从 RUNNABLE --> WAITING

- 调用 LockSupport.unpark(目标线程) 或调用了线程 的 interrupt() ,会让目标线程从 WAITING --> RUNNABLE

情况 5 RUNNABLE <--> TIMED_WAITING

t 线程用 synchronized(obj) 获取了对象锁后

-

调用 obj.wait(long n) 方法时,t 线程从 RUNNABLE --> TIMED_WAITING

-

t 线程等待时间超过了 n 毫秒,或调用 obj.notify() , obj.notifyAll() , t.interrupt() 时

竞争锁成功,t 线程从 TIMED_WAITING --> RUNNABLE

竞争锁失败,t 线程从 TIMED_WAITING --> BLOCKED

情况 6 RUNNABLE <--> TIMED_WAITING

- 当前线程调用 t.join(long n) 方法时,当前线程从 RUNNABLE --> TIMED_WAITING

注意是当前线程在t 线程对象的监视器上等待

- 当前线程等待时间超过了 n 毫秒,或t 线程运行结束,或调用了当前线程的 interrupt() 时,当前线程从

TIMED_WAITING --> RUNNABLE

情况 7 RUNNABLE <--> TIMED_WAITING

- 当前线程调用 Thread.sleep(long n) ,当前线程从 RUNNABLE --> TIMED_WAITING

- 当前线程等待时间超过了 n 毫秒,当前线程从 TIMED_WAITING --> RUNNABLE

情况 8 RUNNABLE <--> TIMED_WAITING

- 当前线程调用 LockSupport.parkNanos(long nanos) 或 LockSupport.parkUntil(long millis) 时,当前线程从 RUNNABLE --> TIMED_WAITING

- 调用 LockSupport.unpark(目标线程) 或调用了线程 的 interrupt() ,或是等待超时,会让目标线程从TIMED_WAITING--> RUNNABLE

情况 9 RUNNABLE <--> BLOCKED

- t 线程用 synchronized(obj) 获取了对象锁时如果竞争失败,从 RUNNABLE --> BLOCKED

- 持 obj 锁线程的同步代码块执行完毕,会唤醒该对象上所有 BLOCKED 的线程重新竞争,如果其中 t 线程竞争成功,从 BLOCKED --> RUNNABLE ,其它失败的线程仍然 BLOCKED

情况 10 RUNNABLE <--> TERMINATED

- 当前线程所有代码运行完毕,进入 TERMINATED

活跃性

死锁

有这样的情况:一个线程需要同时获取多把锁,这时就容易发生死锁

t1 线程 获得 A 对象锁,接下来想获取 B 对象的锁 t2 线程 获得 B 对象锁,接下来想获取 A 对象的锁

例如:

@Slf4j

public class DeadLockDemo {

private static final Object lock1 = new Object();

private static final Object lock2 = new Object();

public static void main(String[] args) {

new Thread(() -> {

// 先 lock1 后 lock2

synchronized (lock1) {

log.debug("{}上锁lock1", Thread.currentThread().getName());

synchronized (lock2) {

log.debug("{}上锁lock2", Thread.currentThread().getName());

}

}

}, "t1").start();

new Thread(() -> {

// 先 lock2 后 lock1 和上面的加锁方向相反, 很容易发生死锁问题

synchronized (lock2) {

log.debug("{}上锁lock2", Thread.currentThread().getName());

synchronized (lock1) {

log.debug("{}上锁lock1", Thread.currentThread().getName());

}

}

}, "t2").start();

}

}

定位死锁

(1) 检测死锁可以使用 jconsole工具,或者使用 jps 定位进程 id,再用 jstack 定位死锁

(2) 还可以使用jvisualvm检测死锁

哲学家就餐问题

有五位哲学家,围坐在圆桌旁。

- 他们只做两件事,思考和吃饭,思考一会吃口饭,吃完饭后接着思考。

- 吃饭时要用两根筷子吃,桌上共有 5 根筷子,每位哲学家左右手边各有一根筷子。

- 如果筷子被身边的人拿着,自己就得等待

@Slf4j

public class PhilosopherDemo {

public static void main(String[] args) {

Chopstick c1 = new Chopstick("筷子①");

Chopstick c2 = new Chopstick("筷子②");

Chopstick c3 = new Chopstick("筷子③");

Chopstick c4 = new Chopstick("筷子④");

Chopstick c5 = new Chopstick("筷子⑤");

new Philosopher("苏格拉底", c1, c2).start();

new Philosopher("柏拉图", c2, c3).start();

new Philosopher("亚里士多德", c3, c4).start();

new Philosopher("赫拉克利特", c4, c5).start();

new Philosopher("阿基米德", c5, c1).start();

}

}

/**

* 哲学家

*/

@Slf4j(topic = "c.Philosopher")

@EqualsAndHashCode(callSuper = false)

@Data

@NoArgsConstructor

class Philosopher extends Thread {

// 左手筷子

private Chopstick left;

// 右手筷子

private Chopstick right;

Philosopher(String name, Chopstick left, Chopstick right) {

super(name);

this.left = left;

this.right = right;

}

private void eat() {

log.debug("eating");

try {

TimeUnit.SECONDS.sleep(1);

} catch (InterruptedException e) {

e.printStackTrace();

}

}

@Override

public void run() {

while (true) {

synchronized (left) {

synchronized (right) {

eat();

}

}

}

}

}

/**

* 筷子类

*/

@Data

@NoArgsConstructor

@AllArgsConstructor

class Chopstick {

private String name;

@Override

public String toString() {

return "筷子{" + name + '}';

}

}

活锁

活锁就是两个线程相互谦让拿到了cpu时间片但是又把执行权限丢给对方, 一直互相谦让就成活锁了

还有一种情况就是出现在两个线程互相改变对方的结束条件,最后谁也无法结束

说白了, 对 i ++和对 i -- 线程无限停留都不满足自己的条件, 无限循环

饥饿

很多教程中把饥饿定义为,一个线程由于优先级太低,始终得不到 CPU 调度执行,也不能够结束,饥饿的情况不易演示,讲读写锁时会涉及饥饿问题

下面我讲一下我遇到的一个线程饥饿的例子,先来看看使用顺序加锁的方式解决之前的死锁问题

![]()

顺序加锁的解决方案

![]()

但是这种方式却导致了饥饿问题

// 这种方式是饥饿

// new Philosopher("阿基米德", c1, c5).start();

可打断

可打断锁

@Slf4j

public class LockInterruptorDemo {

public static final ReentrantLock lock = new ReentrantLock();

public static void main(String[] args) {

Thread t1 = new Thread(() -> {

log.debug("上锁了{}", Thread.currentThread().getName());

try {

lock.lockInterruptibly();

} catch (InterruptedException e) {

e.printStackTrace();

log.debug("等待锁过程中被打断...");

return;

}

try {

log.debug("上锁成功{}", Thread.currentThread().getName());

} finally {

lock.unlock();

}

}, "t1");

lock.lock();

log.debug("主线程上锁了");

t1.start();

t1.interrupt();

log.debug("主线程释放了 {} 线程", t1.getName());

}

}

锁超时

饥饿状态可以使用锁超时方式解决

立刻超时

@Slf4j

public class TryLockDemo {

public static void main(String[] args) {

ReentrantLock lock = new ReentrantLock();

Thread t1 = new Thread(() -> {

log.debug("子线程尝试上锁");

if (!lock.tryLock()) {

log.debug("获得锁失败");

return;

}

try {

log.debug("获得锁成功");

} finally {

lock.unlock();

}

}, "t1");

lock.lock();

log.debug("主线程上锁了");

t1.start();

}

}

公平锁

ReentrantLock 默认是不公平的

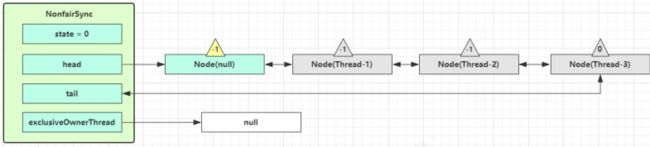

![]()

公平锁一般没有必要,会降低并发度,后面分析原理时会讲解

条件变量

synchronized 中也有条件变量,就是我们讲原理时那个 waitSet 休息室,当条件不满足时进入 waitSet 等待

ReentrantLock 的条件变量比 synchronized 强大之处在于,它是支持多个条件变量的,这就好比

- synchronized 是那些不满足条件的线程都在一间休息室等消息

- 而 ReentrantLock 支持多间休息室,有专门等烟的休息室、专门等早餐的休息室、唤醒时也是按休息室来唤

醒

使用要点:

- await 前需要获得锁

- await 执行后,会释放锁,进入 conditionObject 等待

- await 的线程被唤醒(或打断、或超时)取重新竞争 lock 锁

- 竞争 lock 锁成功后,从 await 后继续执行

@Slf4j(topic = "c.CorrectPostureDemo")

public class CorrectPostureDemo {

private static final ReentrantLock ROOM = new ReentrantLock();

private static Condition waitCigarette = ROOM.newCondition();

private static Condition waitTakeout = ROOM.newCondition();

// 是否抽烟

private static Boolean hasCigarette = false;

// 是否点外卖

private static Boolean hasTakeout = false;

public static void main(String[] args) {

new Thread(() -> {

ROOM.lock();

try {

log.debug("外卖到了没?[{}]", hasTakeout);

while (!hasTakeout) {

try {

log.debug("没到, 先休息会儿");

waitTakeout.await();

} catch (InterruptedException e) {

e.printStackTrace();

}

}

log.debug("外卖到了, 可以工作了");

} finally {

ROOM.unlock();

}

}, "小女").start();

new Thread(() -> {

ROOM.lock();

try {

log.debug("有烟没??[{}]", hasCigarette);

while (!hasCigarette) {

log.debug("没烟, 先休息会儿");

try {

waitCigarette.await();

} catch (InterruptedException e) {

e.printStackTrace();

}

}

log.debug("有烟, 可以干活了");

} finally {

ROOM.unlock();

}

}, "小南").start();

Sleeper.sleep(1);

new Thread(() -> {

ROOM.lock();

try {

hasTakeout = true;

log.debug("{} 外卖送到了[{}]", Thread.currentThread().getName(), hasTakeout);

waitTakeout.signal();

} finally {

ROOM.unlock();

}

}, "外卖小哥1").start();

new Thread(() -> {

ROOM.lock();

try {

hasCigarette = true;

log.debug("{} 烟送到了[{}]", Thread.currentThread().getName(), hasCigarette);

waitCigarette.signal();

} finally {

ROOM.unlock();

}

}, "外卖小哥2").start();

}

}

顺序控制

面试中经常会有的问题

@Slf4j

public class LockOrderControlDemo {

private final static ReentrantLock lock = new ReentrantLock();

private final static Condition cond = lock.newCondition();

private volatile static int flag = 0;

public static void main(String[] args) {

Thread a = new Thread(() -> {

while (true) {

try {

lock.lock();

if (0 == flag) {

System.err.print(Thread.currentThread().getName() + " -> ");

flag = 1;

cond.signalAll();

}

cond.await();

} catch (InterruptedException e) {

e.printStackTrace();

} finally {

lock.unlock();

}

}

}, "A");

Thread b = new Thread(() -> {

while (true) {

try {

lock.lock();

if (1 == flag) {

System.err.print(Thread.currentThread().getName() + " -> ");

flag = 2;

cond.signalAll();

}

cond.await();

} catch (InterruptedException e) {

e.printStackTrace();

} finally {

lock.unlock();

}

}

}, "B");

Thread c = new Thread(() -> {

while (true) {

try {

lock.lock();

if (2 == flag) {

System.err.print(Thread.currentThread().getName() + " -> ");

flag = 3;

cond.signalAll();

}

cond.await();

} catch (InterruptedException e) {

e.printStackTrace();

} finally {

lock.unlock();

}

}

}, "C");

Thread d = new Thread(() -> {

while (true) {

try {

lock.lock();

if (3 == flag) {

System.err.println(Thread.currentThread().getName());

flag = 0;

cond.signalAll();

}

cond.await();

} catch (InterruptedException e) {

e.printStackTrace();

} finally {

lock.unlock();

}

}

}, "D");

a.start();

b.start();

c.start();

d.start();

}

}

CPU 缓存结构原理

CPU 缓存结构

![]()

查看 cpu 缓存

![]()

速度比较

![]()

查看 cpu 缓存行

![]()

cpu 拿到的内存地址格式是这样的

![]()

![]()

CPU 缓存读

根据低位,计算在缓存中的索引

判断是否有效

-

0 去内存读取新数据更新缓存行

-

1 再对比高位组标记是否一致

一致,根据偏移量返回缓存数据

不一致,去内存读取新数据更新缓存行

CPU 缓存一致性

MESI 协议

- M(修改,Modified):本地处理器已经修改缓存行,即是脏行,它的内容与内存中的内容不一样,并且此 cache 只有本地一个拷贝(专有);

- E(专有,Exclusive):缓存行内容和内存中的一样,而且其它处理器都没有这行数据;

- S(共享,Shared):缓存行内容和内存中的一样, 有可能其它处理器也存在此缓存行的拷贝;

- I(无效,Invalid):缓存行失效, 不能使用。

| 状态 | 触发本地读取 | 触发本地写入 | 触发远端读取 | 触发远端写入 |

|---|---|---|---|---|

| M状态(修改) | 本地cache:M 触发cache:M 其他cache:I |

本地cache:M 触发cache:M 其他cache:I |

本地cache:M→E→S 触发cache:I→S 其他cache:I→S 同步主内存后修改为E独享,同步触发、其他cache后本地、触发、其他cache修改为S共 |

本地cache:M→E→S→I 触发cache:I→S→E→M 其他cache:I→S→I 同步和读取一样,同步完成后触发cache改为M,本地、其他cache改为I |

| E状态(独享) | 本地cache:E 触发cache:E 其他cache:I |

本地cache:E→M 触发cache:E→M 其他cache:I 本地cache变更为M,其他cache状态应当是I(无效) |

本地cache:E→S 触发cache:I→S 其他cache:I→S 当其他cache要读取该数据时,其他、触发、本地cache都被设置为S(共享) |

本地cache:E→S→I 触发cache:I→S→E→M 其他cache:I→S→I 当触发cache修改本地cache独享数据时时,将本地、触发、其他cache修改为S共享.然后触发cache修改为独享,其他、本地cache修改为I(无效),触发cache再修改为M |

| S状态(共享) | 本地cache:S 触发cache:S 其他cache:S |

本地cache:S→E→M 触发cache:S→E→M 其他cache:S→I 当本地cache修改时,将本地cache修改为E,其他cache修改为I,然后再将本地cache为M状态 |

本地cache:S 触发cache:S 其他cache:S |

本地cache:S→I 触发cache:S→E→M 其他cache:S→I 当触发cache要修改本地共享数据时,触发cache修改为E(独享),本地、其他cache修改为I(无效),触发cache再次修改为M(修改) |

| I状态(无效) | 本地cache:I→S或者I→E 触发cache:I→S或者I →E 其他cache:E、M、I→S、I本地、触发cache将从I无效修改为S共享或者E独享,其他cache将从E、M、I 变为S或者I |

本地cache:I→S→E→M 触发cache:I→S→E→M 其他cache:M、E、S→S→I |

既然是本cache是I,其他cache操作与它无关 | 既然是本cache是I,其他cache操作与它无关 |

下图示意了,当一个cache line的调整的状态的时候,另外一个cache line 需要调整的状态。

| M | E | S | I | |

|---|---|---|---|---|

| M | × | × | × | √ |

| E | × | × | × | √ |

| S | × | × | √ | √ |

| I | √ | √ | √ | √ |

举个栗子来说:

假设cache 1 中有一个变量x = 0的cache line 处于S状态(共享)。

那么其他拥有x变量的cache 2、cache 3等x的cache line调整为S状态(共享)或者调整为 I 状态(无效)。

-

初始:一开始时,缓存行没有加载任何数据,所以它处于 I 状态。

-

本地写(Local Write):如果本地处理器写数据至处于 I 状态的缓存行,则缓存行的状态变成 M。

-

本地读(Local Read):如果本地处理器读取处于 I 状态的缓存行,很明显此缓存没有数据给它。此时分两种情况:

- (1)其它处理器的缓存里也没有此行数据,则从内存加载数据到此缓存行后,再将它设成 E 状态,表示只有我一家有这条数据,其它处理器都没有;

- (2)其它处理器的缓存有此行数据,则将此缓存行的状态设为 S 状态。(备注:如果处于M状态的缓存行,再由本地处理器写入/读出,状态是不会改变的)

-

远程读(Remote Read):假设我们有两个处理器 c1 和 c2,如果 c2 需要读另外一个处理器 c1 的缓存行内容,c1 需要把它缓存行的内容通过内存控制器 (Memory Controller) 发送给 c2,c2 接到后将相应的缓存行状态设为 S。在设置之前,内存也得从总线上得到这份数据并保存。

-

远程写(Remote Write):其实确切地说不是远程写,而是 c2 得到 c1 的数据后,不是为了读,而是为了写。也算是本地写,只是 c1 也拥有这份数据的拷贝,这该怎么办呢?c2 将发出一个 RFO (Request For Owner) 请求,它需要拥有这行数据的权限,其它处理器的相应缓存行设为 I,除了它自已,谁不能动这行数据。这保证了数据的安全,同时处理 RFO 请求以及设置I的过程将给写操作带来很大的性能消耗。

RFO(Read Or Ownership)请求:cpu需要获取缓存行的所有权需要先发送 RFO 请求

什么情况下会发生RFO请求?

-

- 线程的工作从一个处理器移到另一个处理器, 它操作的所有缓存行都需要移到新的处理器上。此后如果再写缓存行,则此缓存行在不同核上有多个拷贝,需要发送 RFO 请求了。

-

- 两个不同的处理器确实都需要操作相同的缓存行

缓存行是什么?

请看:伪共享和缓存行

缓存系统中是以缓存行(cache line)为单位存储的。缓存行通常是 64 字节(译注:本文基于 64 字节,其他长度的如 32 字节等不适本文讨论的重点),并且它有效地引用主内存中的一块地址。一个 Java 的 long 类型是 8 字节,因此在一个缓存行中可以存 8 个 long 类型的变量。所以,如果你访问一个 long 数组,当数组中的一个值被加载到缓存中,它会额外加载另外 7 个,以致你能非常快地遍历这个数组。事实上,你可以非常快速的遍历在连续的内存块中分配的任意数据结构。而如果你在数据结构中的项在内存中不是彼此相邻的(如链表),你将得不到免费缓存加载所带来的优势,并且在这些数据结构中的每一个项都可能会出现缓存未命中。

如果存在这样的场景,有多个线程操作不同的成员变量,但是相同的缓存行,这个时候会发生什么?。没错,伪共享(False Sharing)问题就发生了!有张 Disruptor 项目的经典示例图,如下:

![]()

上图中,一个运行在处理器 core1上的线程想要更新变量 X 的值,同时另外一个运行在处理器 core2 上的线程想要更新变量 Y 的值。但是,这两个频繁改动的变量都处于同一条缓存行。两个线程就会轮番发送 RFO 消息,占得此缓存行的拥有权。当 core1 取得了拥有权开始更新 X,则 core2 对应的缓存行需要设为 I 状态。当 core2 取得了拥有权开始更新 Y,则 core1 对应的缓存行需要设为 I 状态(失效态)。轮番夺取拥有权不但带来大量的 RFO 消息,而且如果某个线程需要读此行数据时,L1 和 L2 缓存上都是失效数据,只有 L3 缓存上是同步好的数据。从前一篇我们知道,读 L3 的数据非常影响性能。更坏的情况是跨槽读取,L3 都要 miss,只能从内存上加载。

表面上 X 和 Y 都是被独立线程操作的,而且两操作之间也没有任何关系。只不过它们共享了一个缓存行,但所有竞争冲突都是来源于共享。

内存屏障 --- Memory Barrier(Memory Fence)

可见性

写屏障(sfence)保证在该屏障之前的,对共享变量的改动,都同步到主存当中

而读屏障(lfence)保证在该屏障之后,对共享变量的读取,加载的是主存中最新数据

有序性

写屏障会确保指令重排序时,不会将写屏障之前的代码排在写屏障之后

读屏障会确保指令重排序时,不会将读屏障之后的代码排在读屏障之前

![]()

java线程的内存模型

原子性、可见性与有序性

JMM 即 Java Memory Model,它定义了主存、工作内存抽象概念,底层对应着 CPU 寄存器、缓存、硬件内存、

CPU 指令优化等。

JMM 体现在以下几个方面

- 原子性 - 保证指令不会受到线程上下文切换的影响

- 可见性 - 保证指令不会受 cpu 缓存的影响

- 有序性 - 保证指令不会受 cpu 指令并行优化的影响

(1) 原子性(Atomicity)

由Java内存模型来直接保证的原子性变量操作包括read、load、assign、use、store和write这六个, 我们大致可以认为,基本数据类型的访问、读写都是具备原子性的(例外就是long和double的非原子性 协定,读者只要知道这件事情就可以了,无须太过在意这些几乎不会发生的例外情况)。

如果应用场景需要一个更大范围的原子性保证(经常会遇到),Java内存模型还提供了lock和unlock操作来满足这种需求,尽管虚拟机未把lock和unlock操作直接开放给用户使用,但是却提供了更高层次的字节码指令monitorenter和monitorexit来隐式地使用这两个操作。这两个字节码指令反映到Java代码中就是同步块——synchronized关键字,因此在synchronized块之间的操作也具备原子性。

(2) 可见性(Visibility)

可见性就是指当一个线程修改了共享变量的值时,其他线程能够立即得知这个修改。

除了volatile之外,Java还有两个关键字能实现可见性,它们是synchronized和final

在执行synchronized最后需要unlock掉, 但是unlock之前需要完成store, write操作, 所以是可见的

而final关键字的功能是修饰的字段在构造器中一旦被初始化完成,并且构造器没有把“this”的引用传递出去(this引用逃逸是一件很危险的事情,其他线程有可能通 过这个引用访问到“初始化了一半”的对象),那么在其他线程中就能看见final字段的值

导致共享变量在线程间不可见的原因

- 线程交叉执行

- 重排序结合线程交叉执行

- 共享变量更新后的值没有在工作内存与主存间及时更新

JMM关于synchronized的两条规定

- 线程解锁前,必须把共享变量的最新值刷新到主内存

- 线程加锁时,将清空工作内存中共享变量的值,从而使用共享变量时需要从主内存中重新读取最新的值(注意加锁与解锁是同- -把锁)

主存与工作内存

Java内存模型规定了所有的变量都存储在主内存(Main Memory)中(此处的主内存与介绍物理 硬件时提到的主内存名字一样,两者也可以类比,但物理上它仅是虚拟机内存的一部分)。每条线程 还有自己的工作内存(Working Memory,可与前面讲的处理器高速缓存类比),线程的工作内存中保 存了被该线程使用的变量的主内存副本,线程对变量的所有操作(读取、赋值等)都必须在工作内 存中进行,而不能直接读写主内存中的数据。不同的线程之间也无法直接访问对方工作内存中的变 量,线程间变量值的传递均需要通过主内存来完成,线程、主内存、工作内存三者的交互关系如图

![]()

![]()

关于主内存与工作内存之间具体的交互协议,即一个变量如何从主内存拷贝到工作内存、如何从 工作内存同步回主内存这一类的实现细节,Java内存模型中定义了以下8种操作来完成。Java虚拟机实 现时必须保证下面提及的每一种操作都是原子的、不可再分的

线程持有主存变量的副本, 在没有特殊处理的前提下线程的所有操作都是针对副本, 而后再由副本同步到主存中, 下面就是java主存和副本的操作过程图示:

![]()

下图是对每个操作的详细说明:

- lock(锁定):作用于主内存的变量,它把一个变量标识为一条线程独占的状态。

- unlock(解锁):作用于主内存的变量,它把一个处于锁定状态的变量释放出来,释放后的变量 才可以被其他线程锁定。

- read(读取):作用于主内存的变量,它把一个变量的值从主内存传输到线程的工作内存中,以 便随后的load动作使用。

- load(载入):作用于工作内存的变量,它把read操作从主内存中得到的变量值放入工作内存的 变量副本中。

- use(使用):作用于工作内存的变量,它把工作内存中一个变量的值传递给执行引擎,每当虚 拟机遇到一个需要使用变量的值的字节码指令时将会执行这个操作。

- assign(赋值):作用于工作内存的变量,它把一个从执行引擎接收的值赋给工作内存的变量, 每当虚拟机遇到一个给变量赋值的字节码指令时执行这个操作。

- store(存储):作用于工作内存的变量,它把工作内存中一个变量的值传送到主内存中,以便随 后的write操作使用。

- write(写入):作用于主内存的变量,它把store操作从工作内存中得到的变量的值放入主内存的 变量中。

如果要把一个变量从主内存拷贝到工作内存,那就要按顺序执行read和load操作,如果要把变量从 工作内存同步回主内存,就要按顺序执行store和write操作。注意,Java内存模型只要求上述两个操作 必须按顺序执行,但不要求是连续执行。也就是说read与load之间、store与write之间是可插入其他指令 的,如对主内存中的变量a、b进行访问时,一种可能出现的顺序是read a、read b、load b、load a。除此 之外,Java内存模型还规定了在执行上述8种基本操作时必须满足如下规则:

- 不允许read和load、store和write操作之一单独出现,即不允许一个变量从主内存读取了但工作内 存不接受,或者工 作内存发起回写了但主内存不接受的情况出现。

- 不允许一个线程丢弃它最近的assign操作,即变量在工作内存中改变了之后必须把该变化同步回 主内存。

- 不允许一个线程无原因地(没有发生过任何assign操作)把数据从线程的工作内存同步回主内存

中。 - 一个新的变量只能在主内存中“诞生”,不允许在工作内存中直接使用一个未被初始化(load或 assign)的变量,换句话说就是对一个变量实施use、store操作之前,必须先执行assign和load操作。

- 一个变量在同一个时刻只允许一条线程对其进行lock操作,但lock操作可以被同一条线程重复执 行多次,多次执行lock后,只有执行相同次数的unlock操作,变量才会被解锁。

- 如果对一个变量执行lock操作,那将会清空工作内存中此变量的值,在执行引擎使用这个变量 前,需要重新执行load或assign操作以初始化变量的值。

- 如果一个变量事先没有被lock操作锁定,那就不允许对它执行unlock操作,也不允许去unlock一个 被其他线程锁定的变量。

- 对一个变量执行unlock操作之前,必须先把此变量同步回主内存中(执行store、write操作)。

案例一: 利用 i++来分析内存间交互操作的详细过程

主体来说就是这么一个步骤:

// 多线程操作 a++;

① 将主存中的变量a锁定为一条线程独占状态 lock --- 不允许新变量直接在工作内存中产生, 只能在主存中产生读取和加载到工作内存

② 将主存读取的变量a读取出来 read

③将读取出来的变量加载到工作内存中 load --- ②③不允许独自执行, 必须按照顺序执行, 但不保证连续执行

④ 线程操作变量a自增 use; load操作可能同时给多个线程进行

⑤ 将线程执行完毕后的结果赋值给工作内存 assign --- 不允许线程的丢弃assign操作, 即工作变量变化了, 必须同步到主存, 同时如果没有assign操作也不允许工作内存私自同步到主存

⑥ 将工作内存中的变量存储到主存空间 store

⑦ 将store的变量写入到主存中 write --- ⑥⑦步骤不允许独自运行, 必须按照顺序执行, 但不保证连续执行

⑧ 解除独占模式, 释放变量, 之后该变量才可以被其他线程锁定 unlock

注意: 上面加粗的两句话, 这就是为啥要使用volatile修饰变量的原因了

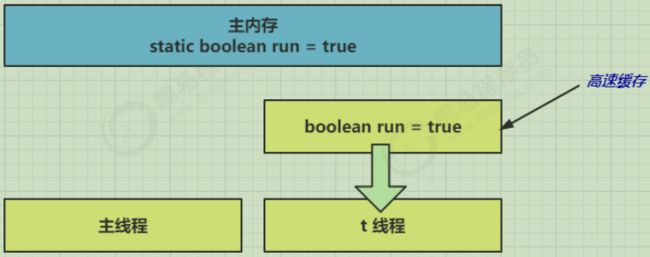

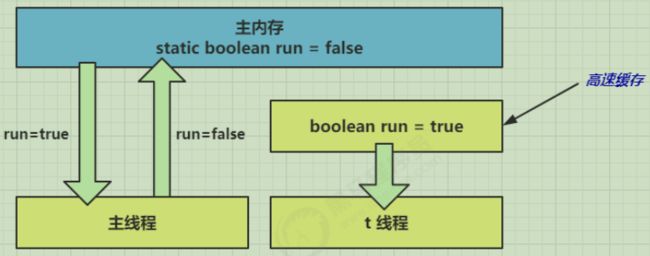

案例二: 退不出的循环

先来看一个现象,main 线程对 run 变量的修改对于 t 线程不可见,导致了 t 线程无法停止:

static boolean run = true;

public static void main(String[] args) throws InterruptedException {

Thread t = new Thread(()->{

while(run){

// ....

}

});

t.start();

sleep(1);

run = false; // 线程t不会如预想的停下来

}

为什么呢?分析一下:

- 初始状态, t 线程刚开始从主内存读取了 run 的值到工作内存。

![]()

-

因为 t 线程要频繁从主内存中读取 run 的值,JIT 编译器会将 run 的值缓存至自己工作内存中的高速缓存中,减少对主存中 run 的访问,提高效率

-

1 秒之后,main 线程修改了 run 的值,并同步至主存,而 t 是从自己工作内存中的高速缓存中读取这个变量

的值,结果永远是旧值

那如何解决呢???

volatile(易变关键字)

它可以用来修饰成员变量和静态成员变量,他可以避免线程从自己的工作缓存中查找变量的值,必须到主存中获取它的值,线程操作 volatile 变量都是直接操作主存

volatile关键字

volatile处理可见性问题

第一项是保证此变量对所有线程的可见性,这里的“可见性”是指当一条线程修改了这个变量的值,新值对于其他线程来说是可以立即得知的, 对于普通变量来说是需要重新读取变量才能够获取到最新线程改变的变量

注意: volatile变量依然有工作内存的拷贝,但是由于它特殊的操作顺序性规定,所以看起来如同直接在主内存中读写访问一般

如下图是下了线程断点的例子:

当前线程是

![]()

![]()

count 的大小是 2, 准备自增 count, 突然它失去了时间片

变成了线程 12, 直接执行到 count++ 的下面一行, 自增了值, 变成了 3

![]()

然后我们切换到线程 10 再看看这个 count 的值是多少

![]()

[Thread-10] DEBUG com.xxx.ExerciseTransfer - count = 3

发现打印出来的是 3, 说明了, 线程12的修改在其他线程是能够立即被反应出来的

这个就是volatile的第一个作用

而普通变量是不行的, 比如:

线程A修改一个普通变量的值,然后向主内存进行回写,另外一条线程B在线程A回写完成了之后再对 主内存进行读取操作,新变量值才会对线程B可见。

它需要其他线程重新读取时才会获取到新的值

Java里面的运算操作符并非原子操作, 这导致volatile变量的运算在并发下一样是不安全

如下分析i++和i--线程不安全问题

我们知道 i++ 或者 i-- 是线程不安全的, 但是为什么呢???

先上代码:

@Slf4j

public class Demo01 {

private int counter = 0;

@Test

public void test() throws Exception {

Thread t1 = new Thread(() -> {

for (int i = 0; i < 5000; i++) {

this.counter++;

}

log.debug("{} = {}", Thread.currentThread().getName(), counter);

}, "t1");

Thread t2 = new Thread(() -> {

for (int i = 0; i < 5000; i++) {

this.counter--;

}

log.debug("{} = {}", Thread.currentThread().getName(), counter);

}, "t2");

t1.start();

t2.start();

t1.join();

t2.join();

log.debug("res counter = {}", counter);

}

}

我们发现打印的结果并不是绝对正确的

注意: 上面这段代码确实是线程不安全的, 但是由于线程比较少, 所以可能需要多试几次才会出现问题, 当然你也可以把创建线程的代码放在for循环下面, 让for循环创建500+个线程自增, 500+线程自减, 让线程多做几次上下文切换, 就会表现出问题了(工作环境不要抱有侥幸心理, 不要因为没有看到问题而不去理会)

首先我们了解 counter++ 和 counter-- 在jvm字节码上是怎么运行的?

counter++

getfield #获取字段

iconst_1 #给定一个为1的常量

iadd # 相加

putfield # 赋值

counter--

getfield #获取字段

iconst_1 #给定一个为1的常量

isub # 相减

putfield # 赋值

实事求是地说,使用字节码来分析并发问题仍然是不严谨的,因为即使编译出来只有一条字节码指令,也并不意味执行这条指令就是一个原子操作。一条字节码指令在解释执行时,解释器要运 行许多行代码才能实现它的语义。如果是编译执行,一条字节码指令也可能转化成若干条本地机器码 指令。此处使用-XX:+PrintAssembly参数输出反汇编来分析才会更加严谨一些,但是考虑到阅读的方便性,并且字节码已经能很好地说明问题,所以此处使用字节码来解释。

下图就显示着这个过程存在的问题

![]()

volatile处理指令重排序优化的问题

volatile变量的第二个语义是禁止指令重排序优化,普通的变量仅会保证在该方法的执行过程中所有依赖赋值结果的地方都能获取到正确的结果,而不能保证变量赋值操作的顺序与程序代码中的执行顺序一致

volatile的使用场景

(1) 这个修饰符比较合适在修饰单个变量单纯的读取时的使用方法上, 举个例子比较简单

![]()

Map configOptions;

char[] configText;

// 此变量必须定义为volatile

volatile boolean initialized = false;

// 假设以下代码在线程A中执行

// 模拟读取配置信息,当读取完成后

// 将initialized设置为true,通知其他线程配置可用

configOptions = new HashMap();

configText = readConfigFile(fileName);

processConfigOptions(configText, configOptions);

initialized = true;

// 假设以下代码在线程B中执行

// 等待initialized为true,代表线程A已经把配置信息初始化完成

while (!initialized) {

sleep();

}

// 使用线程A中初始化好的配置信息

doSomethingWithConfig();

(2) volatile 还能使用在一个线程写, 其他线程读的情况下

总结: 记住这句话, volatile两个作用: 保持共享变量可见性和禁止指令重排序, synchronized关键字只能保证那一块代码只有一个线程运行, 不能禁止指令重排

volatile只能保证可见性不能保证原子性

volatile底层原理

如何保证可见性

volatile修饰了ready

写屏障(sfence) 保证在该屏障之前的,对共享变量的改动,都同步到主存当中

public void actor2(I_Result r) {

num = 2;

ready = true;

// 写屏障, 在这之前的代码所有变量都会被同步到主存

}

而读屏障(fence) 保证在该屏障之后,对共享变量的读取,加载的是主存中最新数据

public void actor1(I_Result r) {

// 读屏障

// 在读之后的变量都会被同步到主存

if (ready) {

r.r1 = num + num;

}

else {

r.r1 = 1;

}

}

![]()

如果保证有序性

写屏障会确保指令重排序时,不会将写屏障之前的代码排在写屏障之后

public void actor2(I_Result r) {

num = 2;

ready = true; // 写屏障, 在这之前的代码不会被jit重排到这行之后

}

读屏障会确保指令重排序时,不会将读屏障之后的代码排在读屏障之前

public void actor1(I_Result r) {

if (ready) { // 读屏障, 在这之后的代码都不会被jit重排到这行之前

r.r1 = num + num;

}

else {

r.r1 = 1;

}

}

![]()

volatile内存语义的实现

volatile重排序规则表

![]()

举例来说,第三行最后一个单元格的意思是:在程序中,当第一个操作为普通变量的读或

写时,如果第二个操作为volatile写,则编译器不能重排序这两个操作。

从表3-5我们可以看出。

当第二个操作是volatile写时,不管第一个操作是什么,都不能重排序。这个规则确保volatile写之前的操作不会被编译器重排序到volatile写之后。

当第一个操作是volatile读时,不管第二个操作是什么,都不能重排序。这个规则确保volatile读之后的操作不会被编译器重排序到volatile读之前。

当第一个操作是volatile写,第二个操作是volatile读时,不能重排序。

为了实现volatile的内存语义,编译器在生成字节码时,会在指令序列中插入内存屏障来

禁止特定类型的处理器重排序。对于编译器来说,发现一个最优布置来最小化插入屏障的总

数几乎不可能。为此,JMM采取保守策略。下面是基于保守策略的JMM内存屏障插入策略。

- 在每个volatile写操作的前面插入一个StoreStore屏障。

- 在每个volatile写操作的后面插入一个StoreLoad屏障。

- 在每个volatile读操作的后面插入一个LoadLoad屏障。

- 在每个volatile读操作的后面插入一个LoadStore屏障。

上述内存屏障插入策略非常保守,但它可以保证在任意处理器平台,任意的程序中都能得到正确的volatile内存语义。

下面是保守策略下,volatile写插入内存屏障后生成的指令序列示意图,如下图所示

![]()

上图中的StoreStore屏障可以保证在volatile写之前,其前面的所有普通写操作已经对任意处理器可见了。这是因为StoreStore屏障将保障上面所有的普通写在volatile写之前刷新到主内存。

这里比较有意思的是,volatile写后面的StoreLoad屏障。此屏障的作用是避免volatile写与后面可能有的volatile读/写操作重排序。因为编译器常常无法准确判断在一个volatile写的后面是否需要插入一个StoreLoad屏障(比如,一个volatile写之后方法立即return)。为了保证能正确实现volatile的内存语义,JMM在采取了保守策略:在每个volatile写的后面,或者在每个volatile读的前面插入一个StoreLoad屏障。从整体执行效率的角度考虑,JMM最终选择了在每个volatile写的后面插入一个StoreLoad屏障。因为volatile写-读内存语义的常见使用模式是:一个写线程写volatile变量,多个读线程读同一个volatile变量。当读线程的数量大大超过写线程时,选择在volatile写之后插入StoreLoad屏障将带来可观的执行效率的提升。从这里可以看到JMM在实现上的一个特点:首先确保正确性,然后再去追求执行效率。

下面是在保守策略下,volatile读插入内存屏障后生成的指令序列示意图,如下图所示

![]()

上图中的LoadLoad屏障用来禁止处理器把上面的volatile读与下面的普通读重排序。LoadStore屏障用来禁止处理器把上面的volatile读与下面的普通写重排序。

上述volatile写和volatile读的内存屏障插入策略非常保守。在实际执行时,只要不改变volatile写-读的内存语义,编译器可以根据具体情况省略不必要的屏障。下面通过具体的示例代码进行说明。

class VolatileBarrierExample {

int a;

volatile int v1 = 1;

volatile int v2 = 2;

void readAndWrite() {

int i = v1; // 第一个volatile读

int j = v2; // 第二个volatile读

a = i + j; // 普通写

v1 = i + 1; // 第一个volatile写

v2 = j * 2; // 第二个 volatile写

}

… // 其他方法

}

针对readAndWrite()方法,编译器在生成字节码时可以做如下的优化。

![]()

注意,最后的StoreLoad屏障不能省略。因为第二个volatile写之后,方法立即return。此时编译器可能无法准确断定后面是否会有volatile读或写,为了安全起见,编译器通常会在这里插入一个StoreLoad屏障

(3) 有序性(Ordering)

有序性: 线程的执行始终跟着代码的顺序运行

Java程序中天然的有序性可以总结为一句话:如果在本线程内观察,所有的操作都是有序的;如果在一个线程中观察另一个线程, 所有的操作都是无序的。前半句是指“线程内似表现为串行的语义”(Within-Thread As-If-Serial Semantics),后半句是指“指令重排序”现象和“工作内存与主内存同步延迟”现象

线程内似表现为串行的语义: 就是单线程看的话, 我们的指令表现的是一条一条的串行执行完毕的

工作内存与主内存同步延迟: 工作内存不能够即时的和主内存进行相互的更新

举个例子:

static int i;

static int j;

// 在某个线程内执行如下赋值操作

i = ...;

j = ...;

可以看到,至于是先执行 i 还是 先执行 j ,对最终的结果不会产生影响。所以,上面代码真正执行时,既可以是

i = ...;

j = ...;

也可以是

j = ...;

i = ...;

这种特性称之为『指令重排』,多线程下『指令重排』会影响正确性。为什么要有重排指令这项优化呢?从 CPU 执行指令的原理来理解一下吧

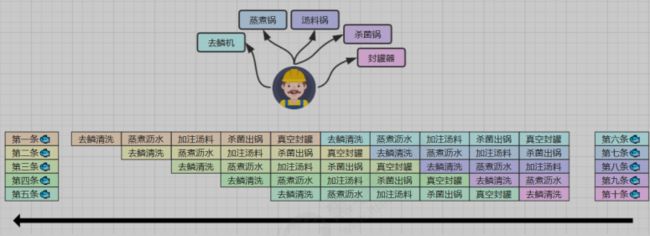

指令级并行原理

鱼罐头的故事

加工一条鱼需要 50 分钟,只能一条鱼、一条鱼顺序加工...

![]()

可以将每个鱼罐头的加工流程细分为 5 个步骤:

-

去鳞清洗 10分钟

-

蒸煮沥水 10分钟

-

加注汤料 10分钟

-

杀菌出锅 10分钟

-

真空封罐 10分钟

即使只有一个工人,最理想的情况是:他能够在 10 分钟内同时做好这 5 件事,因为对第一条鱼的真空装罐,不会影响对第二条鱼的杀菌出锅...

指令重排序优化

事实上,现代处理器会设计为一个时钟周期完成一条执行时间最长的 CPU 指令。为什么这么做呢?可以想到指令还可以再划分成一个个更小的阶段,例如,每条指令都可以分为: 取指令 - 指令译码 - 执行指令 - 内存访问 - 数据写回 这 5 个阶段

![]()

术语参考:

- instruction fetch (IF)

- instruction decode (ID)

- execute (EX)

- memory access (MEM)

- register write back (WB)

在不改变程序结果的前提下,这些指令的各个阶段可以通过重排序和组合来实现指令级并行

支持流水线的处理器

现代 CPU 支持多级指令流水线,例如支持同时执行 取指令 - 指令译码 - 执行指令 - 内存访问 - 数据写回 的处理器,就可以称之为五级指令流水线。这时 CPU 可以在一个时钟周期内,同时运行五条指令的不同阶段(相当于一条执行时间最长的复杂指令),IPC = 1,本质上,流水线技术并不能缩短单条指令的执行时间,但它变相地提高了指令地吞吐率

提示:

奔腾四(Pentium 4)支持高达 35 级流水线,但由于功耗太高被废弃

![]()

诡异的结果

创建maven项目

@JCStressTest

@Outcome(id = {"1", "4"}, expect = Expect.ACCEPTABLE, desc = "ok")

@Outcome(id = "0", expect = Expect.ACCEPTABLE_INTERESTING, desc = "!!!!")

@State

public class ConcurrencyTest {

int num = 0;

boolean ready = false;

@Actor

public void actor1(I_Result r) {

if (ready) {

r.r1 = num + num;

}

else {

r.r1 = 1;

}

}

@Actor

public void actor2(I_Result r) {

num = 2;

ready = true;

}

}

pom.xml

4.0.0

com.zhazha

ordering

1.0-SNAPSHOT

jar

3.0

org.openjdk.jcstress

jcstress-core

${jcstress.version}

UTF-8

0.5

1.8

jcstress

org.apache.maven.plugins

maven-compiler-plugin

3.1

${javac.target}

${javac.target}

${javac.target}

org.apache.maven.plugins

maven-shade-plugin

2.2

main

package

shade

${uberjar.name}

org.openjdk.jcstress.Main

META-INF/TestList

经过控制态测试

java -jar jcstress -v

*** INTERESTING tests

Some interesting behaviors observed. This is for the plain curiosity.

4 matching test results.

[OK] com.zhazha.ConcurrencyTest

(JVM args: [-XX:+UnlockDiagnosticVMOptions, -XX:+StressLCM, -XX:+StressGCM])

Observed state Occurrences Expectation Interpretation

0 276 ACCEPTABLE_INTERESTING !!!!

1 59,999,454 ACCEPTABLE ok

4 28,530,221 ACCEPTABLE ok

[OK] com.zhazha.ConcurrencyTest

(JVM args: [-XX:-TieredCompilation, -XX:+UnlockDiagnosticVMOptions, -XX:+StressLCM, -XX:+StressGCM])

Observed state Occurrences Expectation Interpretation

0 104 ACCEPTABLE_INTERESTING !!!!

1 67,885,202 ACCEPTABLE ok

4 29,954,445 ACCEPTABLE ok

[OK] com.zhazha.ConcurrencyTest

(JVM args: [-XX:-TieredCompilation])

Observed state Occurrences Expectation Interpretation

0 3,889 ACCEPTABLE_INTERESTING !!!!

1 67,195,281 ACCEPTABLE ok

4 32,530,071 ACCEPTABLE ok

[OK] com.zhazha.ConcurrencyTest

(JVM args: [])

Observed state Occurrences Expectation Interpretation

0 2,099 ACCEPTABLE_INTERESTING !!!!

1 85,847,970 ACCEPTABLE ok

4 26,918,422 ACCEPTABLE ok

*** All remaining tests

Tests that do not fall into any of the previous categories.

2 matching test results.

[OK] com.zhazha.ConcurrencyTest

(JVM args: [-XX:TieredStopAtLevel=1])

Observed state Occurrences Expectation Interpretation

0 0 ACCEPTABLE_INTERESTING !!!!

1 49,062,963 ACCEPTABLE ok

4 22,903,528 ACCEPTABLE ok

[OK] com.zhazha.ConcurrencyTest

(JVM args: [-Xint])

Observed state Occurrences Expectation Interpretation

0 0 ACCEPTABLE_INTERESTING !!!!

1 2,089,147 ACCEPTABLE ok

4 1,663,694 ACCEPTABLE ok

经过测试发现上面确实存在指令重排序

0 3,889 ACCEPTABLE_INTERESTING !!!!

0 2,099 ACCEPTABLE_INTERESTING !!!!

但是加上了 volatile 之后这种情况消失了

volatile boolean ready = false;

double-checked-locking双重检测原则

private volatile static SingletonLazy instance = null;

public static SingletonLazy getInstance() {

if (null == instance) {

synchronized (SingletonLazy.class) {

if (null == instance) {

instance = new SingletonLazy();

}

}

}

return instance;

}

0: getstatic #2 // Field INSTANCE:Lcom/zhazha/n5/Singleton;

3: ifnonnull 37

6: ldc #3 // class com/zhazha/n5/Singleton

8: dup

9: astore_0

10: monitorenter

11: getstatic #2 // Field INSTANCE:Lcom/zhazha/n5/Singleton;

14: ifnonnull 27

17: new #3 // class com/zhazha/n5/Singleton

20: dup

21: invokespecial #4 // Method "":()V

24: putstatic #2 // Field INSTANCE:Lcom/zhazha/n5/Singleton;

27: aload_0

28: monitorexit

29: goto 37

32: astore_1

33: aload_0

34: monitorexit

35: aload_1

36: athrow

37: getstatic #2 // Field INSTANCE:Lcom/zhazha/n5/Singleton;

40: areturn

其中

- 17 表示创建对象,将对象引用入栈 // new Singleton

- 20 表示复制一份对象引用 // 引用地址

- 21 表示利用一个对象引用,调用构造方法

- 24 表示利用一个对象引用,赋值给 static INSTANCE

也许 jvm 会优化为:先执行 24,再执行 21。如果两个线程 t1,t2 按如下时间序列执行:

![]()

关键在于 0: getstatic 这行代码在 monitor 控制之外,它就像之前举例中不守规则的人,可以越过 monitor 读取

INSTANCE 变量的值

这时 t1 还未完全将构造方法执行完毕,如果在构造方法中要执行很多初始化操作,那么 t2 拿到的是将是一个未初

始化完毕的单例

对 INSTANCE 使用 volatile 修饰即可,可以禁用指令重排,但要注意在 JDK 5 以上的版本的 volatile 才会真正有效

加上volatile之后的指令集虽然还是看不出问题, 但是在实际作用中还是体现出了效果

![]()

为什么synchronized能够保证有序性却无法保证指令重排序的顺序?

Java语言提供了volatile和synchronized两个关键字来保证线程之间操作的有序性,volatile关键字本身就包含了禁止指令重排序的语义,而synchronized则是由“一个变量在同一个时刻只允许一条线程对其进行lock操作”这条规则获得的,这个规则决定了持有同一个锁的两个同步块只能串行地进入

虽然说synchronized是有序的, 但不是真正的有序, 它只不过是保证了在临界区只有一个线程运行, 所以即使发生了指令重排, 对于这个块来说是不影响的, 但是不在这个块的呢???

借助双重验证方式的单例详解区别

// 如果这个字段没有volatile关键字则会出现指令重排序

private static volatile SingletonLazy instance = null;

public static SingletonLazy getInstance() {

if (null == instance) { // ①

synchronized (SingletonLazy.class) { // 线程2 阻塞

if (null == instance) {

instance = new SingletonLazy(); // 线程1 运行中 ...

}

}

}

return instance;

}

如果instance不添加volatile则会出现这样一个过程:

- jvm分配内存

- 初始化内存对象(引用内存, 对象的内存, 堆)

- 栈变量指向引用对象内存

但是这个过程如果重排序成这样对于一个线程来说结果也是一样的

- jvm分配内存

- 栈变量指向引用对象内存

- 初始化内存对象(引用内存, 对象的内存, 堆)

满足所谓的 as-if-serial(说白了就是不管怎么重排, 只要不影响这个线程运行的结果就行)

那么上面代码线程2阻塞的位置, 就会出现不同的效果了,

如果是第一种方式, 未经过指令重排序, 则结果是正常的, 返回有非null的instance,

但是如果是第二种方式, 先初始化了栈变量后, 线程2发现这个栈变量发生了变化, 直接返回这个栈变量, 但是此时栈变量对应的对象堆内存还未初始化, 此时将会发生错误(这种情况发生的比较少, 我在实测中没发现问题, 但是synchronized是不能处理指令重排序的, 可能jvm做了优化吧)

当然要让sync保证指令重排的方法其实也有, 那就是让共享变量全部都在代码块中

总结下来就是: sync可以保证原子性, 可见性和有序性

先行发生原则(happens-before)

是什么?

happens-before 规定了对共享变量的写操作对其它线程的读操作可见,它是可见性与有序性的一套规则总结,抛开以下 happens-before 规则,JMM 并不能保证一个线程对共享变量的写,对于其它线程对该共享变量的读可见

详细内容

(1) 线程解锁 m 之前对变量的写,对于接下来对 m 加锁的其它线程对该变量的读可见

static int x;

static Object m = new Object();

new Thread(() -> {

synchronized (m) {

x = 10;

}

},"t1").start();

new Thread(() -> {

synchronized (m) {

System.out.println(x);

}

},"t2").start();

(2) 线程对 volatile 变量的写,对接下来其它线程对该变量的读可见

volatile static int x;

new Thread(() -> {

x = 10;

}, "t1").start();

new Thread(() -> {

System.out.println(x);

}, "t2").start();

(3) 线程 start 前对变量的写,对该线程开始后对该变量的读可见

static int x;

x = 10;

new Thread(() -> {

System.out.println(x);

},"t2").start();

(4) 线程结束前对变量的写,对其它线程得知它结束后的读可见(比如其它线程调用 t1.isAlive() 或 t1.join()等待它结束)

static int x;

Thread t1 = new Thread(() -> {

x = 10;

}, "t1");

t1.start();

t1.join();

System.out.println(x);

(5) 线程打断前的写, 对线程打断后的其他线程可见

static int x;

public static void main (String[]args){

Thread t2 = new Thread(() -> {

while (true) {

if (Thread.currentThread().isInterrupted()) {

System.out.println(x);

break;

}

}

}, "t2");

t2.start();

new Thread(() -> {

sleep(1);

x = 10;

t2.interrupt();

}, "t1").start();

while (!t2.isInterrupted()) {

Thread.yield();

}

System.out.println(x);

}

(6) 对变量默认值(0,false,null)的写,对其它线程对该变量的读可见

(7) 具有传递性,线程1对x的修改在线程2中x是可见的, 并且这种可见也包括y变量

volatile static int x;

static int y;

new Thread(() -> {

y = 10;

x = 20; // x 写前面的所有变量都是有序的

}, "t1").start();

new Thread(() -> {

// x=20 对 t2 可见, 同时 y=10 也对 t2 可见

System.out.println(x);

}, "t2").start();

对加锁范围的理解

public class TestVolatile {

volatile boolean initialized = false;

void init() {

if (initialized) {

return;

}

doInit();

initialized = true;

}

private void doInit() {

}

}

确认 initialized 是共享变量, 并且 doInit 方法只能被执行一次

我们围绕着共享变量来进行加锁

首先发现共享变量存在读写操作所以我们围绕着读写加上锁, 但是要上this锁还是Class锁, 根据出题条件判断, 这里我们上this锁, 保证一个 TestVolatile 对象只能调用一次 doInit 方法

volatile boolean initialized = false;

void init() {

synchronized (this) {

if (initialized) {

return;

}

doInit();

initialized = true;

}

}

这里发现 volatile 其实可加可不加

单例模式

单例模式有很多实现方法,饿汉、懒汉、静态内部类、枚举类,试分析每种实现下获取单例对象(即调用 getInstance)时的线程安全,并思考注释中的问题

实现1:

// 问题1:为什么加 final

// 问题2:如果实现了序列化接口, 还要做什么来防止反序列化破坏单例

public final class Singleton implements Serializable {

// 问题3:为什么设置为私有? 是否能防止反射创建新的实例?

private Singleton() {

}

// 问题4:这样初始化是否能保证单例对象创建时的线程安全?

private static final Singleton INSTANCE = new Singleton();

// 问题5:为什么提供静态方法而不是直接将 INSTANCE 设置为 public, 说出你知道的理由

public static Singleton getInstance() {

return INSTANCE;

}

public Object readResolve() {

return INSTANCE;

}

}

实现2:(推荐)

// 问题1:枚举单例是如何限制实例个数的

// 问题2:枚举单例在创建时是否有并发问题

// 问题3:枚举单例能否被反射破坏单例

// 问题4:枚举单例能否被反序列化破坏单例

// 问题5:枚举单例属于懒汉式还是饿汉式

// 问题6:枚举单例如果希望加入一些单例创建时的初始化逻辑该如何做

enum Singleton {

INSTANCE;

}

实现3:

public final class Singleton {

private Singleton() { }

private static Singleton INSTANCE = null;

// 分析这里的线程安全, 并说明有什么缺点

public static synchronized Singleton getInstance() {

if( INSTANCE != null ){

return INSTANCE;

}

INSTANCE = new Singleton();

return INSTANCE;

}

}

实现4:DCL

public final class Singleton {

private Singleton() { }

// 问题1:解释为什么要加 volatile ?

private static volatile Singleton INSTANCE = null;

// 问题2:对比实现3, 说出这样做的意义

public static Singleton getInstance() {

if (INSTANCE != null) {

return INSTANCE;

}

synchronized (Singleton.class) {

// 问题3:为什么还要在这里加为空判断, 之前不是判断过了吗

if (INSTANCE != null) { // t2

return INSTANCE;

}

INSTANCE = new Singleton();

return INSTANCE;

}

}

}

实现5: (推荐)

public final class Singleton {

private Singleton() { }

// 问题1:属于懒汉式还是饿汉式

private static class LazyHolder {

static final Singleton INSTANCE = new Singleton();

}

// 问题2:在创建时是否有并发问题

public static Singleton getInstance() {

return LazyHolder.INSTANCE;

}

}

无锁 --- 乐观锁(非阻塞)

共享模式之无锁

- CAS 与 volatile

- 原子整数

- 原子引用

- 原子累加器

- Unsafe

CAS无锁方案

CAS无锁主要看重三个变量: 预估值 + 修改值 + 主存值

预估值: 主要用来判断是否等于主存值, 是则将修改值修改到主存值中

修改值: 即将需要修改的新值, 修改到主存中

主存值: 实际值

class AccountSafe implements Account {

// 主存值, 其内部的 value 使用的就是 volatile

private AtomicInteger balance;

public AccountSafe(Integer balance) {

this.balance = new AtomicInteger(balance);

}

@Override