猫狗大战使用CNN分类

一.构造数据集

我们直接下载下来的猫狗数据集是分为训练集和测试集的25000张猫狗图像。

这个数据集太大了而且猫狗没有分类,我们需要创建一个新的数据集。分为每个类别各1000个样本的训练集和每个类别各500个样本的测试集,验证集。

import os,shutil

#解压该目录的文件(训练集照片,25000猫狗图像)

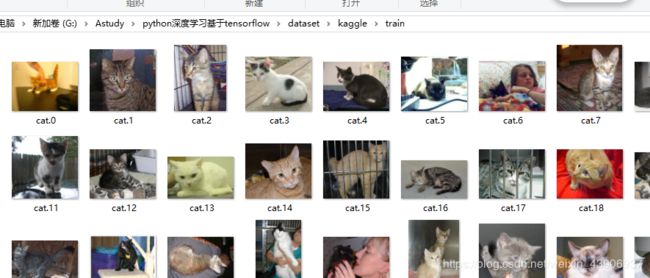

original_dataset_dir = 'G:\\Astudy\\python深度学习基于tensorflow\\dataset\\kaggle\\train'

#在指定路径下创建文件夹

base_dir = 'G:\\Astudy\\python深度学习基于tensorflow\\dataset\\小型猫狗数据集'

os.mkdir(base_dir)#创建目录首先创建出我们数据集的文件夹

![]()

然后分别创建训练集测试机验证集的文件夹。

#创建训练集,验证集,测试集文件夹

train_dir = os.path.join(base_dir,'训练集')#用于拼接文件的路径

os.mkdir(train_dir)#创建目录

validation_dir = os.path.join(base_dir,'验证集')#连接目录与文件名

os.mkdir(validation_dir)#创建目录

test_dir = os.path.join(base_dir,'测试集')

os.mkdir(test_dir)

#在这三个文件夹中分别创建猫,狗文件夹

train_cats_dir = os.path.join(train_dir,'猫')

os.mkdir(train_cats_dir)

train_dogs_dir = os.path.join(train_dir,'狗')

os.mkdir(train_dogs_dir)

validation_cats_dir = os.path.join(validation_dir,'猫')

os.mkdir(validation_cats_dir)

validation_dogs_dir = os.path.join(validation_dir,'狗')

os.mkdir(validation_dogs_dir)

test_cats_dir = os.path.join(test_dir,'猫')

os.mkdir(test_cats_dir)

test_dogs_dir = os.path.join(test_dir,'狗')

os.mkdir(test_dogs_dir)

现在所有的文件夹都已经创建好了,我们把原始数据分类喂进各个文件夹里面

#将前1000张狗的图像复制到train_dogs_dir

fnames = ['dog.{}.jpg'.format(i) for i in range(1000)]

for fname in fnames:

src = os.path.join(original_dataset_dir,fname)#src=原始数据中的dogi.jpg

dst = os.path.join(train_dogs_dir,fname)#dst=小型猫狗数据集\训练集\狗\dogi.jpg

shutil.copyfile(src,dst)#将src复制为dst

#将接下来500张狗的图像复制到validation_dogs_dir

fnames = ['dog.{}.jpg'.format(i) for i in range(1000,1500)]

for fname in fnames:

src = os.path.join(original_dataset_dir,fname)

dst = os.path.join(validation_dogs_dir,fname)

shutil.copyfile(src,dst)

#将接下来500张狗的图像复制到test_dogs_dir

fnames = ['dog.{}.jpg'.format(i) for i in range(1500,2000)]

for fname in fnames:

src = os.path.join(original_dataset_dir,fname)

dst = os.path.join(test_dogs_dir,fname)

shutil.copyfile(src,dst)

#将前1000张猫的图像复制到train_cats_dir

fnames = ['cat.{}.jpg'.format(i) for i in range(1000)]

for fname in fnames:

src = os.path.join(original_dataset_dir,fname)

dst = os.path.join(train_cats_dir,fname)

shutil.copyfile(src,dst)

#将接下来500张猫的图像复制到validation_cats_dir

fnames = ['cat.{}.jpg'.format(i) for i in range(1000,1500)]

for fname in fnames:

src = os.path.join(original_dataset_dir,fname)

dst = os.path.join(validation_cats_dir,fname)

shutil.copyfile(src,dst)

#将接下来500张猫的图像复制到test_cats_dir

fnames = ['cat.{}.jpg'.format(i) for i in range(1500,2000)]

for fname in fnames:

src = os.path.join(original_dataset_dir,fname)

dst = os.path.join(test_cats_dir,fname)

shutil.copyfile(src,dst)打印一下看看:

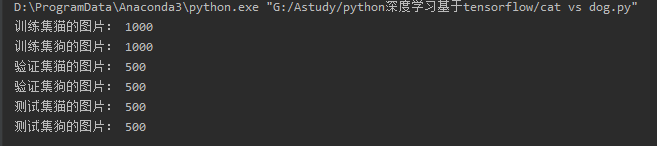

print('训练集猫的图片:',len(os.listdir(train_cats_dir)))

print('训练集狗的图片:',len(os.listdir(train_dogs_dir)))

print('验证集猫的图片:',len(os.listdir(validation_cats_dir)))

print('验证集狗的图片:',len(os.listdir(validation_dogs_dir)))

print('测试集猫的图片:',len(os.listdir(test_cats_dir)))

print('测试集狗的图片:',len(os.listdir(test_dogs_dir)))

所以我们现在已经拥有了2000张训练图像,1000张验证图像和1000张测试图像。

二.构建网络

没啥说的直接上代码:

#构建网络

from keras import layers

from keras import models

model = models.Sequential()

model.add(layers.Conv2D(32,(3,3),activation='relu',

input_shape=(150,150,3)))

model.add(layers.MaxPooling2D((2,2)))

model.add(layers.Conv2D(64,(3,3),activation='relu'))

model.add(layers.MaxPooling2D((2,2)))

model.add(layers.Conv2D(128,(3,3),activation='relu'))

model.add(layers.MaxPooling2D((2,2)))

model.add(layers.Conv2D(128,(3,3),activation='relu'))

model.add(layers.MaxPooling2D((2,2)))

model.add((layers.Flatten()))

model.add(layers.Dense(512,activation='relu'))

model.add(layers.Dense(1,activation='sigmoid'))

from keras import optimizers

model.compile(loss='binary_crossentropy',

optimizer=optimizers.RMSprop(lr=1e-4),

metrics=['acc'])三.数据预处理

数据预处理步骤: 1读取图像文件

2将JPEG文件解码为RGB像素网格

3将这些像素网格转化为浮点数张量

4将像素值缩放到【0,1】区间内

我们可以用ImageDataGenerator类自动完成这一系列步骤,可=。它以快速创建Python生成器。生成了150*150的RGB图像(形状为(20,150,150,3))和二进制标签(形状为(20,)组成的批量,每个批量中包含20个文件。

#数据预处理

#使用ImageDataGenerator从目录中读取图像

from keras.preprocessing.image import ImageDataGenerator

train_dir='G:\\Astudy\\python深度学习基于tensorflow\\dataset\\小型猫狗数据集\\训练集'

validation_dir='G:\\Astudy\\python深度学习基于tensorflow\\dataset\\小型猫狗数据集\\验证集'

#将图像除以225缩放

train_datagen = ImageDataGenerator(rescale=1./255)

test_datagen = ImageDataGenerator(rescale=1./255)

train_generator = train_datagen.flow_from_directory(

train_dir,#读取文件的目录(训练集)

target_size=(150,150),#将所有图像调整为150*150

batch_size=20,#每个批量包含20个样本

class_mode='binary'#使用二进制标签

)

validation_generator = train_datagen.flow_from_directory(

validation_dir,

target_size=(150,150),#将所有图像调整为150*150

batch_size=20,

class_mode='binary'

)

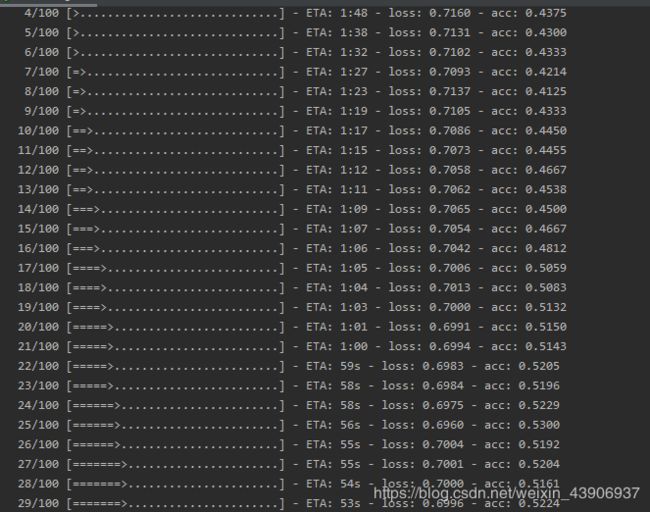

我们使用fit_generator让模型对数据拟合,第一个参数是Python生成器,可以不停地生成输入和目标组成的批量。从生成器中抽取steps_per_epoch个批量后,拟合过程进入下一个轮次,因为有2000个训练样本,故参数取100。

同理,验证集有1000个数据,所以参数取50。

#利用批量生成器拟合模型

history = model.fit_generator(

train_generator,

steps_per_epoch=100,

epochs=30,

validation_data=validation_generator,

validation_steps=50

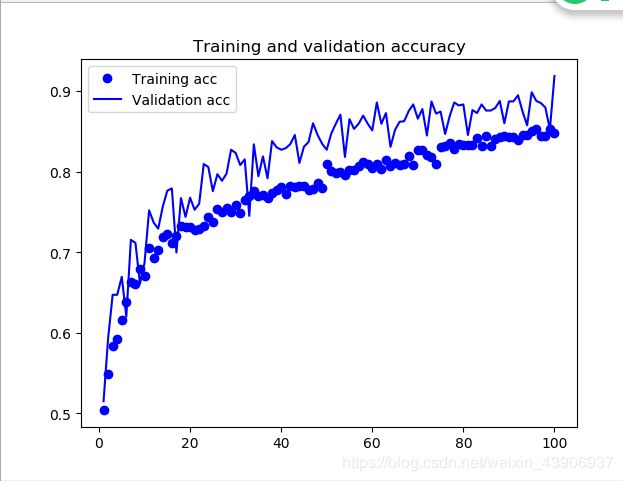

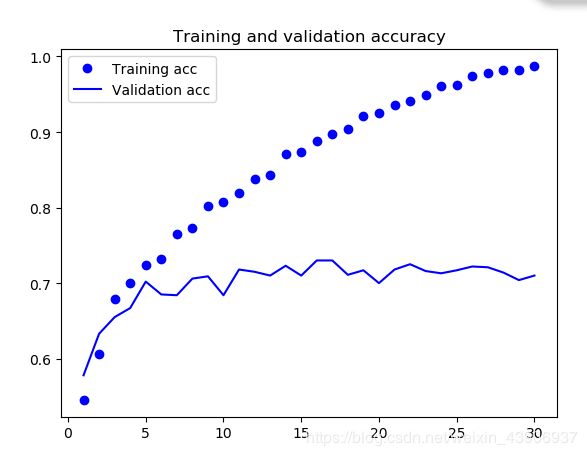

)四.绘制曲线观察训练过程

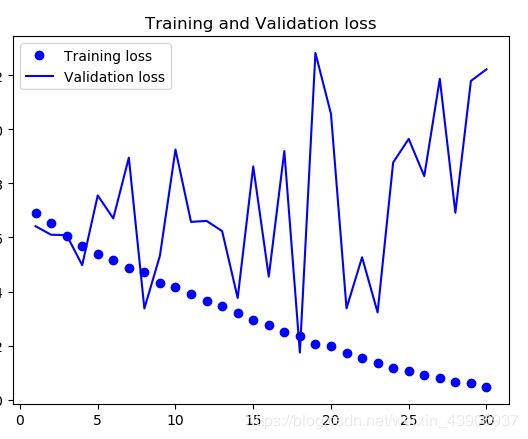

接下来,我们要绘制训练过程中模型在训练数据和验证数据上的损失和精度。(目的是观察训练情况调参,或调整方法)

#绘制训练过程中的损失曲线和精度曲线

import matplotlib.pyplot as plt

acc = history.history['acc']

val_acc = history.history['val_acc']

loss = history.history['loss']

val_loss = history.history['val_loss']

epochs = range(1,len(acc) + 1)

plt.plot(epochs,acc,'bo',label='Training acc')

plt.plot(epochs,val_acc,'b',label='Validation acc')

plt.title('Training and validation accuracy')

plt.legend()

plt.figure()

plt.plot(epochs,loss,'bo',label='Training loss')

plt.plot(epochs,val_loss,'b',label ='Validation loss')

plt.title('Training and Validation loss')

plt.legend()

plt.show()开始训练模型:

可以看到我们的验证集精度到第五轮开始就不变了,而我们验证集的损失更是夸张的乱飞。

可以看到明显发生了过拟合,降低过拟合可以用dropout,和权值衰减。

这里使用处理图像时专用的数据增强。

五.数据增强

数据增强就是利用多种能够生成可信图像的随机变换来增加样本。

举个例子:

#利用ImageDataGenerator来设置数据增强

datagen = ImageDataGenerator(

rotation_range=40,#表示图像随机旋转的角度范围

width_shift_range=0.2,#图像在水平方向上平移的范围

height_shift_range = 0.2,#图像在垂直方向上平移的范围

shear_range=0.2,#随机错切变换的角度

zoom_range=0.2,#图像随机缩放的范围

horizontal_flip=True,#随即将一半图像水平翻转

fill_mode='nerest'#填充新创建像素的方法

)接下来使用数据增强后的数据来训练网络。

代码如下:

#定义一个包含dropout的新卷积神经网络

from keras import layers

from keras import models

model = models.Sequential()

model.add(layers.Conv2D(32,(3,3),activation='relu',

input_shape=(150,150,3)))

model.add(layers.MaxPooling2D((2,2)))

model.add(layers.Conv2D(64,(3,3),activation='relu'))

model.add(layers.MaxPooling2D((2,2)))

model.add(layers.Conv2D(128,(3,3),activation='relu'))

model.add(layers.MaxPooling2D((2,2)))

model.add((layers.Conv2D(128,(3,3),activation='relu')))

model.add(layers.MaxPooling2D((2,2)))

model.add(layers.Flatten())

model.add(layers.Dropout(0.5))

model.add(layers.Dense(512,activation='relu'))

model.add(layers.Dense(1,activation='sigmoid'))

from keras import optimizers

model.compile(loss='binary_crossentropy',

optimizer=optimizers.RMSprop(lr=1e-4),

metrics=['acc'])

#利用数据增强生成器训练卷积神经网络

train_dir='G:\\Astudy\\python深度学习基于tensorflow\\dataset\\小型猫狗数据集\\训练集'

validation_dir='G:\\Astudy\\python深度学习基于tensorflow\\dataset\\小型猫狗数据集\\验证集'

from keras.preprocessing.image import ImageDataGenerator

train_datagen = ImageDataGenerator(

rescale=1./255,

rotation_range=40,

width_shift_range=0.2,

height_shift_range=0.2,

shear_range=0.2,

zoom_range=0.2,

horizontal_flip=True,

)

test_datagen = ImageDataGenerator(rescale=1./255)

train_generator = train_datagen.flow_from_directory(

train_dir,

target_size=(150,150),

batch_size=32,

class_mode='binary'

)

validation_generator=test_datagen.flow_from_directory(

train_dir,

target_size=(150, 150),

batch_size=32,

class_mode='binary'

)

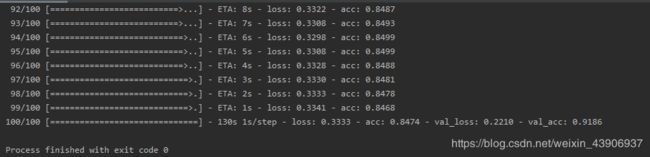

history = model.fit_generator(

train_generator,

steps_per_epoch=100,

epochs=100,

validation_data=validation_generator,

validation_steps=50

)

#保存模型

model.save('cats_and_dogs_small_2.h5')

#绘制训练过程中的损失曲线和精度曲线

import matplotlib.pyplot as plt

acc = history.history['acc']

val_acc = history.history['val_acc']

loss = history.history['loss']

val_loss = history.history['val_loss']

epochs = range(1,len(acc) + 1)

plt.plot(epochs,acc,'bo',label='Training acc')

plt.plot(epochs,val_acc,'b',label='Validation acc')

plt.title('Training and validation accuracy')

plt.legend()

plt.figure()

plt.plot(epochs,loss,'bo',label='Training loss')

plt.plot(epochs,val_loss,'b',label ='Validation loss')

plt.title('Training and Validation loss')

plt.legend()

plt.show()