【sklearn第二十五讲】交叉验证

机器学习训练营——机器学习爱好者的自由交流空间(入群联系qq:2279055353)

学习一个预测函数的参数,在相同的数据集上检验它,这是一个方法学的错误。一个模型能够重复已知的样本标签,但是不能预测任何有用的未知数据,这种现象称过度拟合(overfitting). 为了避免过度拟合,普遍采用的办法是,当做一个有监督的机器学习试验时,拿出一部分数据作为检验集X_test, y_test.

在scikit-learn里,使用train_test_split函数实现训练集和检验集的随机分割。

import numpy as np

from sklearn.model_selection import train_test_split

from sklearn import datasets

from sklearn import svm

iris = datasets.load_iris()

iris.data.shape, iris.target.shape

现在,我们能快速地从一个训练集抽样,而拿出40%的数据检验/评价我们的分类器。

X_train, X_test, y_train, y_test = train_test_split(

iris.data, iris.target, test_size=0.4, random_state=0)

X_train.shape, y_train.shape

X_test.shape, y_test.shape

clf = svm.SVC(kernel='linear', C=1).fit(X_train, y_train)

clf.score(X_test, y_test)

当评价估计量的不同情况时,例如,对于一个SVM的超参数C, 仍然有在训练集上过度拟合的风险,因为参数能被微调,直至估计量达到最优。这种情况,检验集的信息能“漏进”模型,评价测度不再报告一般性的表现。为了解决这个问题,拿出数据集的另外一部分作为评价集。训练继续在训练集上进行,在评价集上做评价,当试验看起来成功的时候,最终的评价在检验集上做。然而,分割数据为三个集,我们减少了学习模型的样本数,结果依赖对评价集、检验集的随机选择。

对于这个问题的解决办法是交叉验证程序(cross-validation, CV). 一个检验集仍然作为最终的评价,但不再需要评价集了。在基本的k-fold CV里,训练集被分割为k个子集,在每一个子集上做下面的程序:

-

在其它k-1个子集组成的训练集上训练模型。

-

在数据的剩余部分验证结果模型,即,子集作为一个检验集,在它上计算表现测度,例如准确率。

k-fold CV报告的表现测度是这些值的平均值。这个方法计算很费时,但没有浪费太多的数据,当样本数很少时,它是一个不错的选择。

交叉验证测度

使用交叉验证最简单的方法是调用cross_val_score函数。下面的例子演示怎样通过分割数据,拟合一个线性核支持向量机模型,计算5个连续次的分数,每次有不同的分割。

from sklearn.model_selection import cross_val_score

clf = svm.SVC(kernel='linear', C=1)

scores = cross_val_score(clf, iris.data, iris.target, cv=5)

scores

分数的平均值和95%的置信区间是

print("Accuracy: %0.2f (+/- %0.2f)" % (scores.mean(), scores.std() * 2))

默认情况,在每一步CV迭代计算的分数是估计量的score方法,可以使用参数scoring改变。

from sklearn import metrics

scores = cross_val_score(

clf, iris.data, iris.target, cv=5, scoring='f1_macro')

scores

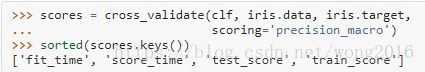

cross_validate函数与多测度评价

cross_validate函数与cross_val_score函数的不同在于:

-

它允许指定多个评价测度。

-

除了检验分数,它还返回字典形式的训练分数、拟合时间、分数次数。

对于一个测度评价,分数参数是一个字符串,键是[‘test_score’, ‘fit_time’, ‘score_time’]. 对于多测度评价,返回值是一个字典。键是

[‘test_scorer1_name’, ‘test_scorer2_name’, ‘test_scorer…’, ‘fit_time’, ‘score_time’].

return_train_score默认设置为True, 它对所有分数增加了训练分数键。如果不需要训练分数,可以将它设为False. 多测度能够指定为列表、元组或预先定义的分数名字集。

获得CV预测

函数cross_val_predict与cross_val_score有相似的接口,但是对于输入的每一个元素,返回的预测是那个元素在检验集获得的。只有分派所有元素到检验集一次的交叉验证能被使用。这些预测能够被用来评价分类器。

from sklearn.model_selection import cross_val_predict

predicted = cross_val_predict(clf, iris.data, iris.target, cv=10)

metrics.accuracy_score(iris.target, predicted)

交叉验证迭代器

下面,我们介绍根据不同的交叉验证策略,产生分割数据集的索引。

i.i.d.数据交叉验证迭代器

假设数据是独立同分布的(Independent and Identically Distributed, i.i.d.), 即,所有样本相互独立且来自相同的分布。注意到,虽然i.i.d.数据是机器学习理论普遍的假设,但实际情况通常不满足。

k-fold

KFold分割所有的样本进入相等大小的k组,称folds. 使用k-1 folds学习预测函数,余下的fold用于检验。下面的例子是一个4样本的2-fold交叉验证。

import numpy as np

from sklearn.model_selection import KFold

X = ["a", "b", "c", "d"]

kf = KFold(n_splits=2)

for train, test in kf.split(X):

print("%s %s" % (train, test))

每个fold由两个数组组成:第一个是训练集,第二个是检验集。这样,使用numpy indexing产生训练/检验集。

X = np.array([[0., 0.], [1., 1.], [-1., -1.], [2., 2.]])

y = np.array([0, 1, 0, 1])

X_train, X_test, y_train, y_test = X[train], X[test], y[train], y[test]

重复的k-fold

RepeatedFold重复k-fold n次,每次产生不同的样本分割。下例是重复2次的2-fold

import numpy as np

from sklearn.model_selection import RepeatedKFold

X = np.array([[1, 2], [3, 4], [1, 2], [3, 4]])

random_state = 12883823

rkf = RepeatedKFold(n_splits=2, n_repeats=2, random_state=random_state)

for train, test in rkf.split(X):

print("%s %s" % (train, test))

Leave One Out (LOO)

LeaveOneOut是一个简单的CV. 每个学习集由除一个样本之外的其余样本组成,留下的一个样本组成检验集。这样,对于 n n n 个样本的数据集,可以组成 n n n 个不同的训练集和 n n n 个不同的检验集。CV没有浪费太多的样本,因为只有一个样本被排除在训练集之外。

from sklearn.model_selection import LeaveOneOut

X = [1, 2, 3, 4]

loo = LeaveOneOut()

for train, test in loo.split(X):

print("%s %s" % (train, test))

Leave P Out (LPO)

LeavePOut与LeaveOneOut类似,它从完整的数据集里删除 p p p 个样本,产生所有可能的训练集和检验集。对于 n n n 个样本,能产生 ( n p ) \binom{n}{p} (pn) 个训练-检验对。下例是4样本数据集的Leave-2-Out CV

from sklearn.model_selection import LeavePOut

X = np.ones(4)

lpo = LeavePOut(p=2)

for train, test in lpo.split(X):

print("%s %s" % (train, test))

随机置换CV

ShuffleSplit迭代器将产生一个用户定义的独立训练/检验集分割数。首先shuffle样本,然后分到训练集和检验集。通过设置伪随机数生成器random_state, 控制随机性使结果可重复。

from sklearn.model_selection import ShuffleSplit

X = np.arange(5)

ss = ShuffleSplit(n_splits=3, test_size=0.25,

random_state=0)

for train_index, test_index in ss.split(X):

print("%s %s" % (train_index, test_index))

ShuffleSplit允许更精细地控制迭代数和训练集/检验集的样本比例,它是KFold CV 的好的替代方法。

阅读更多精彩内容,请关注微信公众号:统计学习与大数据