ANN人工神经网络(Artificial Neuron Network )

原创不易,转载前请注明博主的链接地址:Blessy_Zhu https://blog.csdn.net/weixin_42555080

一、为什么需要神经网络

首先,神经网络应用在分类问题中效果很好。 工业界中分类问题居多。

LR或者linear SVM更适用线性分割。如果数据非线性可分(现实生活中多是非线性的),LR通常需要靠特征工程做特征映射,增加高斯项或者组合项;SVM需要选择核。 而增加高斯项、组合项会产生很多没有用的维度,增加计算量。GBDT可以使用弱的线性分类器组合成强分类器,但维度很高时效果可能并不好。

非线性可分怎么办

如下图是著名的异或线性不可分问题 :

从逻辑回归看,单层感知器只能解决线性问题。要解决非线性问题,需要引入多层感知器(加入隐层)。

这时使用两个线性分类器,再求逻辑与就可以达到分类的效果。 注意,最开始的两个线性分类器都是部分正确的分类器

接下来,让我们来看一个经典的神经网络。这是一个包含三个层次的神经网络。红色的是输入层,绿色的是输出层,紫色的是中间层(也叫隐藏层)。输入层有3个输入单元,隐藏层有4个单元,输出层有2个单元。后文中,我们统一使用这种颜色来表达神经网络的结构。

在开始介绍前,有一些知识可以先记在心里:

- 设计一个神经网络时,输入层与输出层的节点数往往是固定的,中间层则可以自由指定;

- 神经网络结构图中的拓扑与箭头代表着预测过程时数据的流向,跟训练时的数据流有一定的区别;

- 结构图里的关键不是圆圈(代表“神经元”),而是连接线(代表“神经元”之间的连接)。每个连接线对应一个不同的权重(其值称为权值),这是需要训练得到的。

除了从左到右的形式表达的结构图,还有一种常见的表达形式是从下到上来表示一个神经网络。这时候,输入层在图的最下方。输出层则在图的最上方,如下图 :

从左到右的表达形式以Andrew Ng和LeCun的文献使用较多,Caffe里使用的则是从下到上的表达。在本文中使用Andrew Ng代表的从左到右的表达形式。

二、由生物神经元到人工神经元

2.1 生物神经元

人工神经网络(ANN)是由试图去模仿生物神经系统而激发的。如下图所示,人的大脑主要由神经元(neuron)组成,神经元通过轴突(axon)连接在一起。当神经元收到刺激时,神经脉冲(nerve impulses)通过轴突由一个神经元传递到另一个神经元。一个神经元通过树突(dendtrite)连接到其他神经元的轴突,树突是神经元细胞体的延伸物。树突和一个轴突的连接点叫做突触(synapse)。人的大脑通过在同一个脉冲反复刺激下改变神经元之间的突触连接强度来进行学习。神经网络由很多简单的,相互交互的节点构成。信息通过这些节点间的连接的强度来表达,通过在学习过程中调整这些连接来获得。

这样可以概况的说明生物神经网络的假定特点:

- 每个神经元都是一个多输入单输出的信息处理单元;

- 神经元输入分兴奋性输入和抑制性输入两种类型;

- 神经元具有空间整合特性和阈值特性;

- 神经元输入与输出间有固定的时滞,主要取决于突触延搁

2.2 人工神经元

2.2.1 MP神经元模型简介

1943年,心理学家McCulloch和数学家Pitts参考了生物神经元的结构,发表了抽象的神经元模型MP。

神经元模型是一个包含输入,输出与计算功能的模型。输入可以类比为神经元的树突,而输出可以类比为神经元的轴突,计算则可以类比为细胞核。

下图是一个典型的神经元模型:包含有3个输入,1个输出,以及2个计算功能。

注意中间的箭头线。这些线称为“连接”。每个上有一个“权值”。

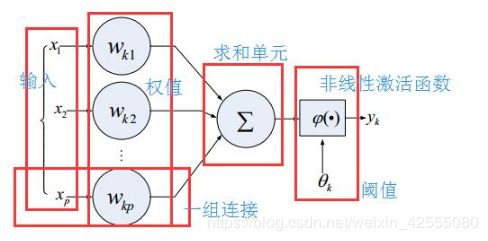

再详细介绍MP神经网络前,先了解神经元的具有的三个基本要素:

1、一组连接,连接的强度由个连接上的权值表示,若为正,则表示是激活,为负,表示,抑制

2、一个求和单元:用于求各个输入信号的加权和

3、一个非线性激活函数:起到非线性映射的作用,并将神经元输出幅度限制在一定的范围内,一般限制在(0,1)或者(-1,1)之间

4、 此外还有一个阈值 θ k \theta_k θk

如下图:

求和部分 :

总和减去阈值:

减去后的值经过线性激活函数:

最终得到 y k y_k yk

将上面这个过程进行简化:

2.2.2 神经元模型效果理解

神经元模型的使用可以这样理解:

我们有一个数据,称之为样本。样本有四个属性,其中三个属性已知,一个属性未知。我们需要做的就是通过三个已知属性预测未知属性。具体办法就是使用神经元的公式进行计算。三个已知属性的值是a1,a2,a3,未知属性的值是z。z可以通过公式计算出来。这里,已知的属性称之为特征,未知的属性称之为目标。假设特征与目标之间确实是线性关系,并且我们已经得到表示这个关系的权值 ω 1 \omega_1 ω1、 ω 2 \omega_2 ω2、 ω 3 \omega_3 ω3 (这一点非常重要,也就是说,这些权值不是通过训练得到的,而是通过先验知识直接给定的)。那么,我们就可以通过神经元模型预测新样本的目标。

2.2.3 MP神经元模型影响

1943年发布的MP模型,虽然简单,但已经建立了神经网络大厦的地基。但是,MP模型中,权重的值都是预先设置的,因此不能学习。1949年心理学家Hebb提出了Hebb学习率,认为人脑神经细胞的突触(也就是连接)上的强度上可以变化的。于是计算科学家们开始考虑用调整权值的方法来让机器学习。这为后面的学习算法奠定了基础。

三、单层神经网络(感知机)

3.1 背景

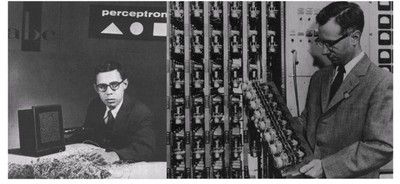

感知器(Perceptron)是一种人工神经元,在 20 世纪五、六年代由科学家Frank Rosenblatt发明。感知器是当时首个可以学习的人工神经网络。Rosenblatt现场演示了其学习识别简单图像的过程,在当时的社会引起了轰动。

人们认为已经发现了智能的奥秘,许多学者和科研机构纷纷投入到神经网络的研究中。美国军方大力资助了神经网络的研究,并认为神经网络比“原子弹工程”更重要。这段时间直到1969年才结束,这个时期可以看作神经网络的第一次高潮。

3.2 单层神经网络结构

单层神经网络结构是在原来MP模型的“输入”位置添加神经元节点,标志其为“输入单元”,这点需要注意。其余不变,于是我们就有了下图:从本图开始,我们将权值 ω 1 \omega_1 ω1、 ω 2 \omega_2 ω2、 ω 3 \omega_3 ω3写到“连接线”的中间。

如上图,在“感知机”中,有两个层次。分别是输入层和输出层。输入层里的“输入单元”只负责传输数据,不做计算。输出层里的“输出单元”则需要对前面一层的输入进行计算。

我们把需要计算的层次称之为“计算层”,并把拥有一个计算层的网络称之为“单层神经网络”。有一些文献会按照网络拥有的层数来命名,例如把“感知机”称为两层神经网络。但在本文里,我们根据计算层的数量来命名。

假如我们要预测的目标不再是一个值,而是一个向量,例如[2,3]。那么可以在输出层再增加一个“输出单元”。

下图显示了带有两个输出单元的单层神经网络,其中输出单元z1、z2的计算公式如下图。

目前的表达公式有一点不让人满意的就是:w4,w5,w6是后来加的,很难表现出跟原先的w1,w2,w3的关系。因此我们改用二维的下标,用wx,y来表达一个权值。下标中的x代表后一层神经元的序号,而y代表前一层神经元的序号(序号的顺序从上到下)。例如,w1,2代表后一层的第1个神经元与前一层的第2个神经元的连接的权值(这种标记方式参照了Andrew Ng的课件)。根据以上方法标记,我们有了下图。

如果我们仔细看输出的计算公式,会发现这两个公式就是线性代数方程组。因此可以如果我们仔细看输出的计算公式,会发现这两个公式就是线性代数方程组。因此可以用矩阵乘法来表达这两个公式。

例如,输入的变量是 [ a 1 , a 2 , a 3 ] T [a1,a2,a3]^T [a1,a2,a3]T(代表由a1,a2,a3组成的列向量),用向量a来表示。方程的左边是 [ z 1 , z 2 ] T [z1,z2]^T [z1,z2]T,用向量z来表示。

系数则是矩阵W(2行3列的矩阵,排列形式与公式中的一样)。

于是,输出公式可以改写成:g(W * a) = z;

这个公式就是神经网络中从前一层计算后一层的矩阵运算。来表达这两个公式。

3.3 效果

与神经元模型不同,感知器中的权值是通过训练得到的。因此,根据以前的知识我们知道,感知机类似一个逻辑回归模型,可以做线性分类任务。

我们可以用决策分界来形象的表达分类的效果。决策分界就是在二维的数据平面中划出一条直线,当数据的维度是3维的时候,就是划出一个平面,当数据的维度是n维时,就是划出一个n-1维的超平面。

下图显示了在二维平面中划出决策分界的效果,也就是感知器的分类效果。

3.4 影响

感知机只能做简单的线性分类任务。但是当时的人们热情太过于高涨,并没有人清醒的认识到这点。于是,当人工智能领域的巨擘Minsky指出这点时,事态就发生了变化。Minsky在1969年出版了一本叫《Perceptron》的书,里面用详细的数学证明了感知器的弱点,尤其是感知机对XOR(异或)这样的简单分类任务都无法解决。Minsky认为,如果将计算层增加到两层,计算量则过大,而且没有有效的学习算法。所以,他认为研究更深层的网络是没有价值的。由于Minsky的巨大影响力以及书中呈现的悲观态度,让很多学者和实验室纷纷放弃了神经网络的研究。神经网络的研究陷入了冰河期。这个时期又被称为“AI winter”。接近10年以后,对于两层神经网络的研究才带来神经网络的复苏。

3.5 感知机与MP神经元模型的不同点

四、两层神经网络(多层感知器)

4.1 背景

Minsky说过单层神经网络无法解决异或问题。但是当增加一个计算层以后,两层神经网络不仅可以解决异或问题,而且具有非常好的非线性分类效果。不过两层神经网络的计算是一个问题,没有一个较好的解法。

1986年,Rumelhar和Hinton等人提出了反向传播(Back Propagation,BP)算法,解决了两层神经网络所需要的复杂计算量问题,从而带动了业界使用两层神经网络研究的热潮。目前,大量的教授神经网络的教材,都是重点介绍两层(带一个隐藏层)神经网络的内容。

4.2 多层感知器结构

两层神经网络除了包含一个输入层,一个输出层以外,还增加了一个中间层。此时,中间层和输出层都是计算层。我们扩展上节的单层神经网络,在右边新加一个层次(只含有一个节点)。

现在,我们的权值矩阵增加到了两个,我们用上标来区分不同层次之间的变量。

例如 a x y a_x^y axy代表第y层的第x个节点。z1,z2变成了a1(2),a2(2)。下图给出了a1(2),a2(2)的计算公式。

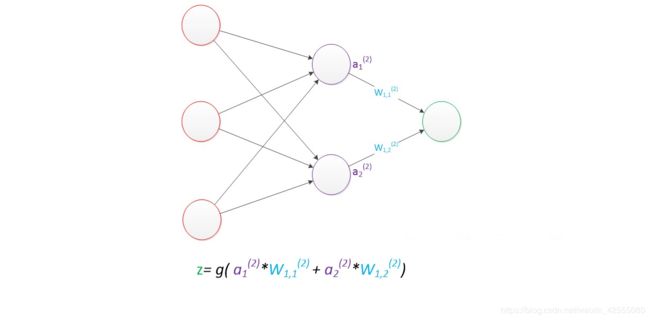

计算最终输出z的方式是利用了中间层的a1(2),a2(2)和第二个权值矩阵计算得到的,如下图。

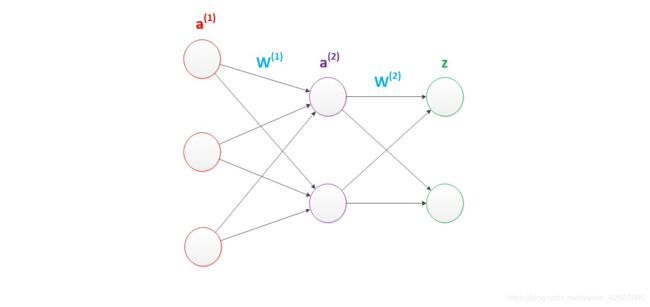

假设我们的预测目标是一个向量,那么与前面类似,只需要在“输出层”再增加节点即可。我们使用向量和矩阵来表示层次中的变量。a(1),a(2),z是网络中传输的向量数据。W(1)和W(2)是网络的矩阵参数。如下图。

使用矩阵运算来表达整个计算公式的话如下:

g(W(1) * a(1)) = a(2);

g(W(2) * a(2)) = z;

由此可见,使用矩阵运算来表达是很简洁的,而且也不会受到节点数增多的影响(无论有多少节点参与运算,乘法两端都只有一个变量)。因此神经网络的教程中大量使用矩阵运算来描述。

接下来考虑偏置的问题:在神经网络的每个层次中,除了输出层以外,都会含有这样一个偏置单元。正如线性回归模型与逻辑回归模型中的一样。

可以看出,偏置节点很好认,因为其没有输入(前一层中没有箭头指向它)。有些神经网络的结构图中会把偏置节点明显画出来,有些不会。一般情况下,我们都不会明确画出偏置节点。

在考虑了偏置以后的一个神经网络的矩阵运算如下:

g(W(1) * a(1) + b(1)) = a(2);

g(W(2) * a(2) + b(2)) = z;

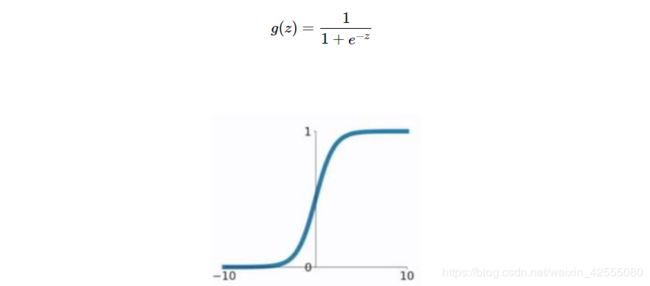

需要说明的是,在两层神经网络中,我们不再使用sgn函数作为函数g,而是使用平滑函数sigmoid作为函数g。我们把函数g也称作激活函数(active function)。

4.3 常见的激活函数

如上图,在神经网络中,我们经常可以看到对于某一个隐藏层的节点,该节点的激活值计算一般分为两步:

(1)输入该节点的值为 x1,x2 时,在进入这个隐藏节点后,会先进行一个线性变换,计算出值 z[1]= ω 1 \omega_1 ω1 x 1 x_1 x1+ ω 2 \omega_2 ω2 x 2 x_2 x2+b[1]=W[1]x+b[1] ,上标 1 表示第 1 层隐藏层。

(2)再进行一个非线性变换,也就是经过非线性激活函数,计算出该节点的输出值(激活值) a(1)=g(z(1)) ,其中 g(z) 为非线性函数。

在深度学习中,常用的激活函数主要有:sigmoid函数,tanh函数,ReLU函数。

4.3.1 sigmoid函数

该函数是将取值为 (−∞,+∞) 的数映射到 (0,1) 之间。sigmoid函数的公式以及图形如下:

4.3.2 tanh函数

tanh函数相较于sigmoid函数要常见一些,该函数是将取值为 (−∞,+∞) 的数映射到 (−1,1) 之间,其公式与图形为:

tanh函数在 0 附近很短一段区域内可看做线性的。由于tanh函数均值为 0 ,因此弥补了sigmoid函数均值为 0.5 的缺点。

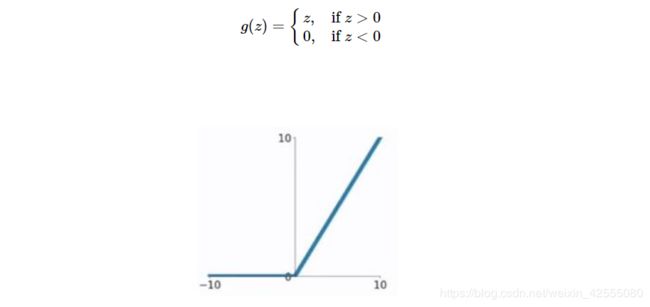

4.3.3 ReLU函数

ReLU函数又称为修正线性单元(Rectified Linear Unit),是一种分段线性函数,其弥补了sigmoid函数以及tanh函数的梯度消失问题。ReLU函数的公式以及图形如下:

4.3.4 Leaky ReLU函数

这是一种对ReLU函数改进的函数,又称为PReLU函数,但其并不常用。其公式与图形如下:

4.4 效果

与单层神经网络不同。理论证明,两层神经网络可以无限逼近任意连续函数。

这是什么意思呢?也就是说,面对复杂的非线性分类任务,两层(带一个隐藏层)神经网络可以分类的很好。

下面就是一个例子,红色的线与蓝色的线代表数据。而红色区域和蓝色区域代表由神经网络划开的区域,两者的分界线就是决策分界。

可以看到,这个两层神经网络的决策分界是非常平滑的曲线,而且分类的很好。有趣的是,前面已经学到过,单层网络只能做线性分类任务。而两层神经网络中的后一层也是线性分类层,应该只能做线性分类任务。为什么两个线性分类任务结合就可以做非线性分类任务?

我们可以把输出层的决策分界单独拿出来看一下,就是下图:

可以看到,输出层的决策分界仍然是直线。关键就是,从输入层到隐藏层时,数据发生了空间变换。也就是说,两层神经网络中,隐藏层对原始的数据进行了一个空间变换,使其可以被线性分类,然后输出层的决策分界划出了一个线性分类分界线,对其进行分类。

这样就导出了两层神经网络可以做非线性分类的关键–隐藏层。联想到我们一开始推导出的矩阵公式,我们知道,矩阵和向量相乘,本质上就是对向量的坐标空间进行一个变换。因此,隐藏层的参数矩阵的作用就是使得数据的原始坐标空间从线性不可分,转换成了线性可分。

两层神经网络通过两层的线性模型模拟了数据内真实的非线性函数。因此,多层的神经网络的本质就是复杂函数拟合。

下面来讨论一下隐藏层的节点数设计。在设计一个神经网络时,输入层的节点数需要与特征的维度匹配,输出层的节点数要与目标的维度匹配。而中间层的节点数,却是由设计者指定的。因此,“自由”把握在设计者的手中。但是,节点数设置的多少,却会影响到整个模型的效果。如何决定这个自由层的节点数呢?目前业界没有完善的理论来指导这个决策。一般是根据经验来设置。较好的方法就是预先设定几个可选值,通过切换这几个值来看整个模型的预测效果,选择效果最好的值作为最终选择。这种方法又叫做Grid Search(网格搜索)。

了解了两层神经网络的结构以后,我们就可以看懂其它类似的结构图。例如EasyPR字符识别网络架构(下图)。

EasyPR使用了字符的图像去进行字符文字的识别。输入是120维的向量。输出是要预测的文字类别,共有65类。根据实验,我们测试了一些隐藏层数目,发现当值为40时,整个网络在测试集上的效果较好,因此选择网络的最终结构就是120,40,65。

4.5 影响

两层神经网络在多个地方的应用说明了其效用与价值。10年前困扰神经网络界的异或问题被轻松解决。神经网络在这个时候,已经可以发力于语音识别,图像识别,自动驾驶等多个领域。

但是神经网络仍然存在若干的问题:尽管使用了BP算法,一次神经网络的训练仍然耗时太久,而且困扰训练优化的一个问题就是局部最优解问题,这使得神经网络的优化较为困难。同时,隐藏层的节点数需要调参,这使得使用不太方便,工程和研究人员对此多有抱怨。

90年代中期,由Vapnik等人发明的SVM(Support Vector Machines,支持向量机)算法诞生,很快就在若干个方面体现出了对比神经网络的优势:无需调参;高效;全局最优解。基于以上种种理由,SVM迅速打败了神经网络算法成为主流。

这篇内容分别介绍了MP神经元模型、单层神经网络、两层神经网络和常见的激活函数,因为时间原因,下篇文章见喽

这篇文章就到这里了,欢迎大佬们多批评指正,也欢迎大家积极评论多多交流。

参考文章

1 (BP进阶1)从M-P模型到BP神经网络

2 神经网络学习 之 M-P模型

3 人工神经网络(ANN)及BP算法

4 机器学习(十二):人工神经网络(ANN)

5 【机器学习】人工神经网络(ANN)浅讲,备注,以上内容,最主要参考的内容就是本篇博文。

6 神经网络中常用的几种激活函数的理解**********