PCA降维原理及其代码实现(附加 sklearn PCA用法参数详解)

学习笔记

本篇博文绝大多数来源于书籍《机器学习实战》

记录自己的学习笔记而已。

降维作用

(1)使得数据集更容易使用

(2)降低很多算法的计算开销

(3)去除噪声

(4)多维数据不容易画图,降低维度容易画图,使结果容易理解。

优点:降低数据的复杂性,识别出最重要的多个特征。

缺点:不一定需要,有可能损失掉有用信息,仅适用于数值数据。

PCA原理

在PCA中,数据从原来的坐标系转换到了新的坐标系。新坐标系的选择是由数据本身决定的。第一个新坐标轴选择的是原始数据中方差最大的方向,第二个新坐标轴的选择和第一个坐标轴正交且具有最大方差的方向。该过程一直重复,重复次数为原始数据中特征的数目。会发现,大部分方差都包含在最前面的几个新坐标轴中。因此我们可以只选择前面几个坐标轴,即对数据进行了降维处理。(大白话讲解:选择坐标轴的依据是尽可能保留原始数据。降维即把数据投影在这个坐标轴上或者几个坐标轴构成的‘平面’上)。

PCA相关算法

前面提到数据的第一个主成分是从数据差异最大(即方差最大)的方向提取出来。第二个主成分是数据差异性次大的方向,并且与第一个主成分正交。通过数据集的协方差矩阵及其特征值分析,我们就可以拿到这些主成分的值。

一旦得到协方差矩阵的特征向量,取出最大的N个值。这些特征向量也给出了N个最重要特征的真实结构。将数据乘上这N个特征向量转换到新的数据空间。

特征值分析

在 AV=aV中,V是特征向量,a是特征值,是简单的标量。等式的含义是:如何特征向量V被某个矩阵A左乘,那么它就等于某个标量a乘以V。

numpy里有特征向量和特征值的模块linalg。其中eig()方法用于求特征向量和特征值。

PCA原理实现

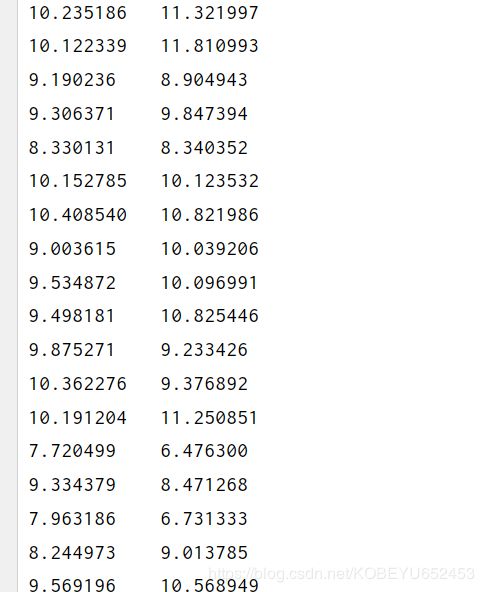

原始数据.txt

数据为两维,将其降维1维。

选用两维是因为可以可视化。

代码

python 3

import numpy as np

import matplotlib.pyplot as plt

"""

函数说明:解析文本数据

Parameters:

filename - 文件名

delim - 每一行不同特征数据之间的分隔方式,默认是tab键‘\t’

Returns:

j将float型数据值列表转化为矩阵返回

"""

def loadDataSet(filename, delim='\t'):

fr = open(filename)

stringArr = [line.strip().split(delim) for line in fr.readlines()]

datArr = [list(map(float, line)) for line in stringArr]

return np.mat(datArr)

"""

函数说明:PCA特征维度压缩函数

Parameters:

dataMat - 数据集数据

topNfeat - 需要保留的特征维度,即要压缩成的维度数,默认4096

Returns:

lowDDataMat - 压缩后的数据矩阵

reconMat - 压缩后的数据矩阵反构出原始数据矩阵

"""

def pca(dataMat, topNfeat=4096):

# 求矩阵每一列的均值

meanVals = np.mean(dataMat, axis=0)

# 数据矩阵每一列特征减去该列特征均值

meanRemoved = dataMat - meanVals

# 计算协方差矩阵,处以n-1是为了得到协方差的无偏估计

# cov(x, 0) = cov(x)除数是n-1(n为样本个数)

# cov(x, 1)除数是n

covMat = np.cov(meanRemoved, rowvar=0)

# 计算协方差矩阵的特征值及对应的特征向量

# 均保存在相应的矩阵中

eigVals, eigVects = np.linalg.eig(np.mat(covMat))

# sort():对特征值矩阵排序(由小到大)

# argsort():对特征矩阵进行由小到大排序,返回对应排序后的索引

eigValInd = np.argsort(eigVals)

# 从排序后的矩阵最后一个开始自下而上选取最大的N个特征值,返回其对应的索引

eigValInd = eigValInd[: -(topNfeat+1): -1]

# 将特征值最大的N个特征值对应索引的特征向量提取出来,组成压缩矩阵

redEigVects = eigVects[:, eigValInd]

# 将去除均值后的矩阵*压缩矩阵,转换到新的空间,使维度降低为N

lowDDataMat = meanRemoved * redEigVects

# 利用降维后的矩阵反构出原数据矩阵(用作测试,可跟未压缩的原矩阵比对)

# 此处用转置和逆的结果一样redEigVects.I

reconMat = (lowDDataMat * redEigVects.T) + meanVals

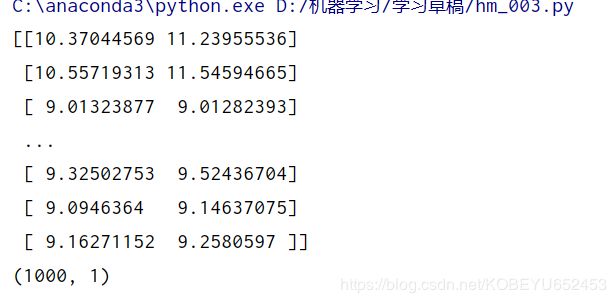

print(reconMat)

# 返回压缩后的数据矩阵及该矩阵反构出原始数据矩阵

return lowDDataMat, reconMat

if __name__ == '__main__':

dataMat = loadDataSet('数据.txt')

lowDmat, reconMat = pca(dataMat, 1)

print(np.shape(lowDmat))

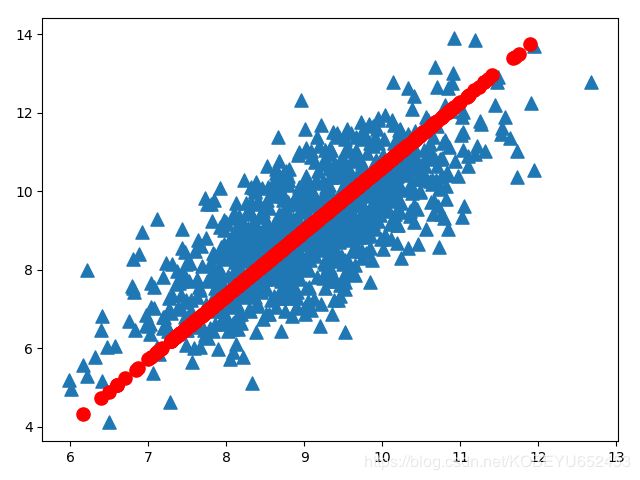

fig = plt.figure()

ax = fig.add_subplot(111)

ax.scatter(dataMat[:, 0].flatten().A[0], dataMat[:, 1].flatten().A[0], marker='^', s=90)

ax.scatter(reconMat[:, 0].flatten().A[0], reconMat[:, 1].flatten().A[0], marker='o', s=90, c='red')

plt.show()

lowDmat, reconMat 一个为降维后的数据,一个为重构后的数据。

(重构为原来的数据格式,去除了一些噪声)

在真实算例中,自己选择要降维后的数据还是重构数据。

如图片数据pca后,肯定要选择重构数据。降维后的数据构不成一张图呀。

解释:

PCA()里有两个参数,第一个参数为数据集,第二个参数为降的维度,降到多少维。

PCA伪代码:

1.去除平均值: meanVals = np.mean(dataMat, axis=0)

2.计算协方差矩阵:covMat = np.cov(meanRemoved, rowvar=0)

3.计算协方差矩阵的特征值和特征向量:covMat = np.cov(meanRemoved, rowvar=0)

4.将特征值从大到小排序: eigValInd = np.argsort(eigVals)

# 从排序后的矩阵最后一个开始自下而上选取最大的N个特征值,返回其对应的索引

eigValInd = eigValInd[: -(topNfeat+1): -1]

5.保留最上面的N个特征向量: # 将特征值最大的N个特征值对应索引的特征向量提取出来,组成压缩矩阵

redEigVects = eigVects[:, eigValInd]

6.将数据转换到上述N个特征向量构建的新空间中,根据公式重构。(逆公式)

PCA调包实现

导入包

from sklearn.decomposition import PCA

用法:

| PCA()参数 | 说明 |

|---|---|

| n_components | int, float, None 或 string,PCA算法中所要保留的主成分个数,也即保留下来的特征个数,如果 n_components = 1,将把原始数据降到一维;如果赋值为string,如n_components=‘mle’,将自动选取特征个数,使得满足所要求的方差百分比;如果没有赋值,默认为None,特征个数不会改变(特征数据本身会改变)。 |

| copy | True 或False,默认为True,即是否需要将原始训练数据复制。 |

| whiten: | True 或False,默认为False,即是否白化,使得每个特征具有相同的方差。 |

| 属性 | 说明 |

|---|---|

| explained_variance_ratio_ | 返回所保留各个特征的方差百分比,如果n_components没有赋值,则所有特征都会返回一个数值且解释方差之和等于1。 |

| n_components_: | 返回所保留的特征个数 |

| 方法 | 说明 |

|---|---|

| fit(X): | 用数据X来训练PCA模型。 |

| fit_transform(X) | 用X来训练PCA模型,同时返回降维后的数据。 |

| inverse_transform(newData) | newData 为降维后的数据。将降维后的数据转换成原始数据,但可能不会完全一样,会有些许差别。 |

| transform(X) | 将数据X转换成降维后的数据,当模型训练好后,对于新输入的数据,也可以用transform方法来降维 |

例子:

import numpy as np

import matplotlib.pyplot as plt

#导入数据

def loadDataSet(filename, delim='\t'):

fr = open(filename)

stringArr = [line.strip().split(delim) for line in fr.readlines()]

datArr = [list(map(float, line)) for line in stringArr]

return np.mat(datArr)

dataMat = loadDataSet('数据.txt')

#导入PCA

from sklearn.decomposition import PCA

pca = PCA(n_components=1)

pca.fit(dataMat)

lowDmat=pca.transform(dataMat)#降维后的数据

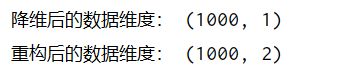

print('降维后的数据维度:',lowDmat.shape)

reconMat=pca.inverse_transform(lowDmat)#s重构数据

print("重构后的数据维度:",reconMat.shape)#重构数据维度

fig = plt.figure()

ax = fig.add_subplot(111)

ax.scatter(dataMat[:, 0].flatten().A[0], dataMat[:, 1].flatten().A[0], marker='^', s=90)

ax.scatter(reconMat[:, 0], reconMat[:, 1], marker='o', s=90, c='red')

plt.show()

注意:重构 输入的是降维后的数据 reconMat=pca.inverse_transform(lowDmat)#s重构数据

结果:

其他专业的计算机小白,写博文不容易。如果你觉得本文对你有用,请点个赞支持下,谢谢!