Scikit-learn API:StratifiedShuffleSplit类 按照数据分层进行抽样

类原型

class sklearn.model_selection.StratifiedShuffleSplit(n_splits=10, test_size=None, train_size=None, random_state=None)

功能

将数据集按照指定的类别特征,分层地拆分为训练集、测试集,保证对于每一个特征值,训练集数量占比均相同;生成的交叉验证对象是StratifiedKFold和ShuffleSplit的合并,返回分层的随机折叠,折叠是通过保留每个类别的样品百分比来进行的。

注意:分层随机拆分并不能保证所有折痕都会不同,也就是说对于可伸缩的数据集,每次获取到的测试集和训练集中的内容都可能是不同的。

参数说明

n_splits int,默认为10

重新改组和拆分迭代的次数。

test_size 浮点数,整数,None,可选(默认值:None)

如果为float,则应在0.0到1.0之间,代表测试集占总数据集的比例。如果为int,则表示测试集中样本的绝对数量。如果为None,则将值设置为train_size的补数。如果train_size也是None,则将其设置为0.1。

train_size 浮点数,整数或None,默认为None

如果为float,则应在0.0到1.0之间,表示训练集占总数据集的比例。如果为int,则表示训练集中样本的绝对数量。如果为None,则该值将自动设置为测试集的补数。

random_state int,RandomState实例或None,可选(默认值:无)

如果int, random_state是随机数生成器使用的种子;如果RandomState实例,random_state是随机数生成器;如果为None,随机数生成器就是np.random使用的RandomState实例。

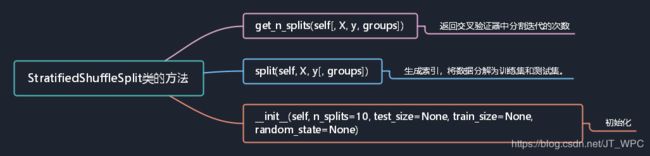

类的常用方法

如图,常用的就两个方法

例子

>>> import numpy as np

>>> from sklearn.model_selection import StratifiedShuffleSplit

>>> X = np.array([[1, 2], [3, 4], [1, 2], [3, 4], [1, 2], [3, 4]])

>>> y = np.array([0, 0, 0, 1, 1, 1])

>>> sss = StratifiedShuffleSplit(n_splits=5, test_size=0.5, random_state=0)

>>> sss.get_n_splits(X, y)

5

>>> print(sss)

StratifiedShuffleSplit(n_splits=5, random_state=0, ...)

>>> for train_index, test_index in sss.split(X, y): # 这里循环的次数由n_splits决定,前面指定的5

... print("TRAIN:", train_index, "TEST:", test_index)

... X_train, X_test = X[train_index], X[test_index]

... y_train, y_test = y[train_index], y[test_index]

TRAIN: [5 2 3] TEST: [4 1 0]

TRAIN: [5 1 4] TEST: [0 2 3]

TRAIN: [5 0 2] TEST: [4 3 1]

TRAIN: [4 1 0] TEST: [2 3 5]

TRAIN: [0 5 1] TEST: [3 4 2]