【学习记录】零基础入门CV之街道字符识别-Task5 模型集成

模型集成这里写目录标题

- 5.1 学习目标

- 5.2 集成学习方法

- 5.3 深度学习中的集成学习

- 5.3.1 Dropout

- 5.3.2 测试集数据扩增

- 5.4 结果后处理

5.1 学习目标

1、学习集成学习方法以及交叉验证情况下的模型集成;

2、学会使用深度学习模型的集成学习。

5.2 集成学习方法

-

集成方法是将几种机器学习技术组合成一个预测模型的元算法,以达到减小方差(bagging,即套袋法有放回的抽样方法)、偏差(boosting)或改进预测(stacking)的效果。

-

集成学习特点

将多个分类方法聚集在一起可以在一定程度上提高预测精度,常见的集成学习方法有Stacking、Bagging和Boosting,同时这些集成学习方法与具体验证集划分联系紧密。 -

数据集比较大的时候可以划分成多个小数据集,学习多个模型进行组合;

数据集比较小的时候可以利用Bootstrap方法(Bootstrap又称自展法,Bootstrap的思想是生成一系列通过又放回的抽样得到bootstrap伪样本。通过对伪样本的计算,获得统计量的分布。)进行抽样,得到多个数据集,分别训练多个模型再进行组合。 -

由于深度学习模型一般需要较长的训练周期,如果硬件设备不允许建议选取留出法,如果需要追求精度可以使用交叉验证的方法。

eg:

-

那么这10个CNN模型可以使用如下方式进行集成:

1、 对预测的结果的概率值进行平均,然后解码为具体字符;

2、 对预测的字符进行投票,得到最终字符。

5.3 深度学习中的集成学习

此外在深度学习中本身还有一些集成学习思路的做法,值得借鉴学习:

5.3.1 Dropout

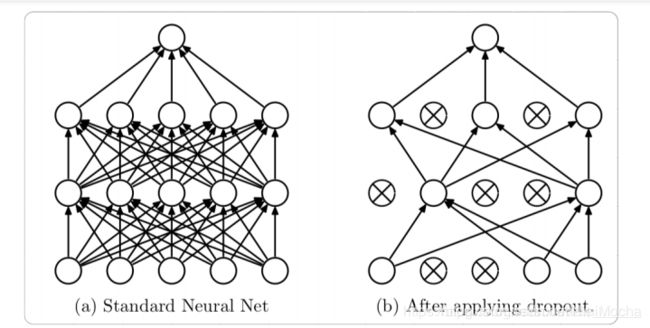

规模大的神经网络中有这样两个缺点:1. 费时2. 容易过拟合

Dropout可以在每个训练的批次中,随机让一部分的节点停止工作。同时在预测的过程中让所有的节点都其作用。Dropout经常出现在在先有的CNN网络中,可以有效的缓解模型过拟合的情况,也可以在预测时增加模型的精度。

加入Dropout后的网络结构如下:

# 定义模型

class SVHN_Model1(nn.Module):

def __init__(self):

super(SVHN_Model1, self).__init__()

# CNN提取特征模块

self.cnn = nn.Sequential(

nn.Conv2d(3, 16, kernel_size=(3, 3), stride=(2, 2)),

nn.ReLU(),

nn.Dropout(0.25),

nn.MaxPool2d(2),

nn.Conv2d(16, 32, kernel_size=(3, 3), stride=(2, 2)),

nn.ReLU(),

nn.Dropout(0.25),

nn.MaxPool2d(2),

)

#

self.fc1 = nn.Linear(32*3*7, 11)

self.fc2 = nn.Linear(32*3*7, 11)

self.fc3 = nn.Linear(32*3*7, 11)

self.fc4 = nn.Linear(32*3*7, 11)

self.fc5 = nn.Linear(32*3*7, 11)

self.fc6 = nn.Linear(32*3*7, 11)

def forward(self, img):

feat = self.cnn(img)

feat = feat.view(feat.shape[0], -1)

c1 = self.fc1(feat)

c2 = self.fc2(feat)

c3 = self.fc3(feat)

c4 = self.fc4(feat)

c5 = self.fc5(feat)

c6 = self.fc6(feat)

return c1, c2, c3, c4, c5, c6

5.3.2 测试集数据扩增

测试集数据扩增(Test Time Augmentation,简称TTA)也是常用的集成学习技巧,数据扩增不仅可以在训练时候用,而且可以同样在预测时候进行数据扩增,对同一个样本预测三次,然后对三次结果进行平均。

def predict(test_loader, model, tta=10):

model.eval()

test_pred_tta = None

# TTA 次数

for _ in range(tta):

test_pred = []

with torch.no_grad():

for i, (input, target) in enumerate(test_loader):

c0, c1, c2, c3, c4, c5 = model(data[0])

output = np.concatenate([c0.data.numpy(), c1.data.numpy(),

c2.data.numpy(), c3.data.numpy(),

c4.data.numpy(), c5.data.numpy()], axis=1)

test_pred.append(output)

test_pred = np.vstack(test_pred)

if test_pred_tta is None:

test_pred_tta = test_pred

else:

test_pred_tta += test_pred

return test_pred_tta

5.4 结果后处理

可以从以下几个思路对预测结果进行后处理:

1、统计图片中每个位置字符出现的频率,使用规则修正结果;

2、单独训练一个字符长度预测模型,用来预测图片中字符个数,并修正结果。