Python爬虫实战| Python爬取英雄联盟高清壁纸

先看一下最终爬取的效果,每个英雄的壁纸都被爬取下来了:

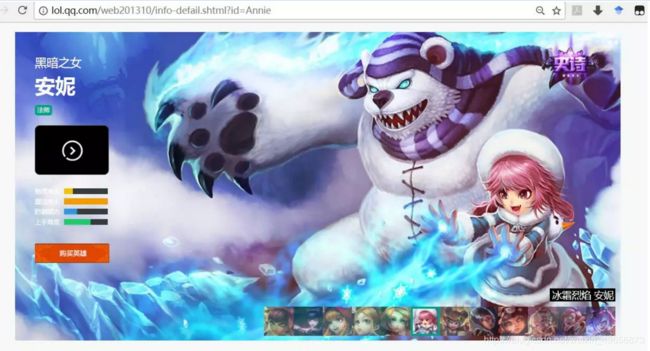

“黑暗之女 安妮”的12张壁纸:

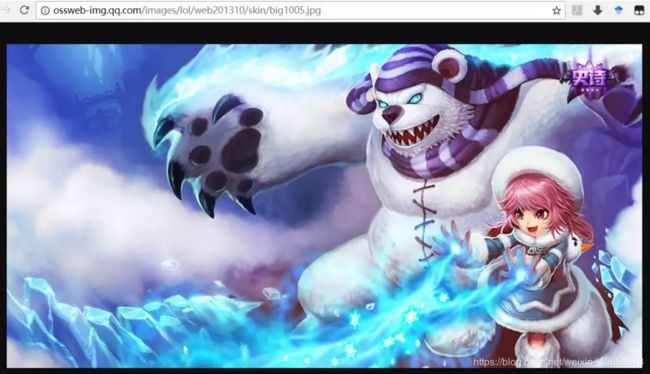

高清大图:

下面开始正式教学!

-

版本:Python 3.5

-

工具:Jupyter notebook实现各个环节,最终整合成LOL_scrawl.py文件

在使用爬虫前,先花一定时间对爬取对象进行了解,是非常有必要的,这样可以帮助我们科学合理地设计爬取流程,以避开爬取难点,节约时间。

打开英雄联盟官网,看到所有英雄的信息:

若要爬取全部英雄,我们先要获取这些英雄的信息,在网页上“右击——检查——Elements”,就能在看到英雄的信息了,如下图所示,包括英雄昵称、英雄名称、英文名等等。由于这些信息是使用JavaScript动态加载的,普通爬取方法无法获取,我们考虑使用虚拟浏览器PhantomJS来获取这些信息。

我们点击进入“暗黑之女 安妮”的页面,页面地址为“http://lol.qq.com/web201310/info-defail.shtml?id=Annie”,地址中的“Annie”是这个英雄的英文名,若要访问其他英雄界面,只需要更改英文名就可以了。

在英雄页面上,通过点击略缩图可以切换到不同的皮肤大图,在大图上“右击——在新标签页中打开图片”,就能打开大图,这就是我们要的高清壁纸:

观察上图的地址信息,再打开其他几张安妮的皮肤壁纸来查看,发现不同壁纸仅在图片编号上有差别:

http://ossweb-img.qq.com/images/lol/web201310/skin/big1000.jpg

http://ossweb-img.qq.com/images/lol/web201310/skin/big1001.jpg

http://ossweb-img.qq.com/images/lol/web201310/skin/big1002.jpg

http://ossweb-img.qq.com/images/lol/web201310/skin/big1003.jpg

再观察英雄“盲僧 李青”的壁纸地址:

http://ossweb-img.qq.com/images/lol/web201310/skin/big64000.jpg

http://ossweb-img.qq.com/images/lol/web201310/skin/big64001.jpg

http://ossweb-img.qq.com/images/lol/web201310/skin/big64002.jpg

再观察英雄“卡牌大师 崔斯特”的壁纸地址:

http://ossweb-img.qq.com/images/lol/web201310/skin/big4000.jpg

http://ossweb-img.qq.com/images/lol/web201310/skin/big4001.jpg

http://ossweb-img.qq.com/images/lol/web201310/skin/big4002.jpg

可以总结出这样一条规则:壁纸地址由三部分组成,固定地址+英雄id+壁纸编号。

-

固定地址:“http://ossweb-img.qq.com/images/lol/web201310/skin/big”以及末尾的“.jpg”

-

英雄id:安妮的id是1,李青的id是64,崔斯特的是40,我们还需要找到所有英雄的id

-

壁纸编号:壁纸编号从000开始,001、002、003...,根据不同英雄的皮肤数量而不同,目前每个英雄壁纸都不超过20个,也就是最多编到020

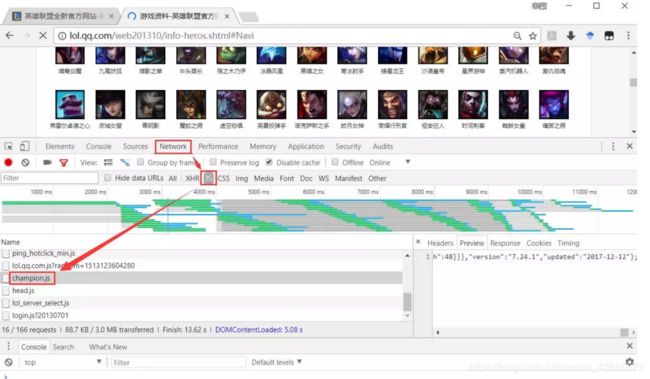

在上面的过程中,我们已经基本了解了要爬取对象的信息了,但每一个英雄的id是多少却还不知道,在网页源代码和用JavaScript加载后都找不到英雄和id的对应信息,猜测这个信息可能是放在某个js文件里,我们来找一找。

在所有英雄信息界面“右键——检查——Network”,再刷新一下界面,可以找到一个champion.js文件:

打开champion.js文件,发现里面就存着我们需要的信息,英雄英文名与英雄id一一对应:

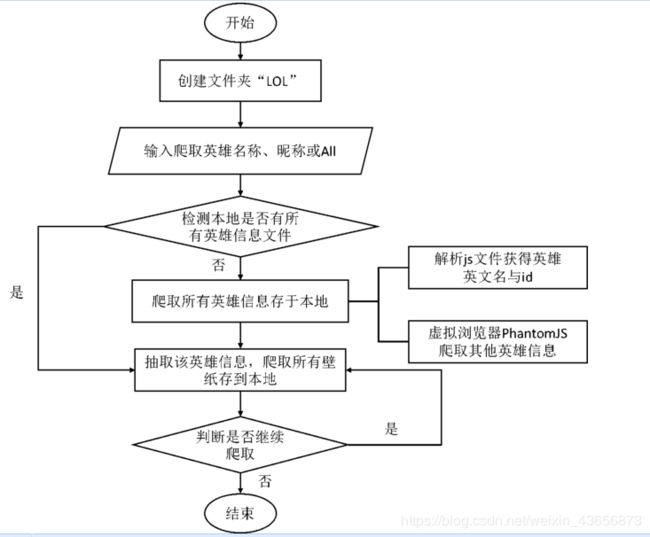

至此对我们要爬取的对象已经有了一定的了解,对于具体爬取方法也有了想法,我们可以设计如下爬虫流程图:

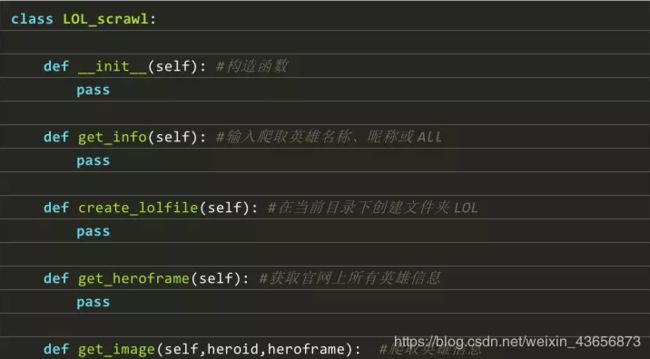

根据爬虫流程图,我们可以设计如下代码框架:

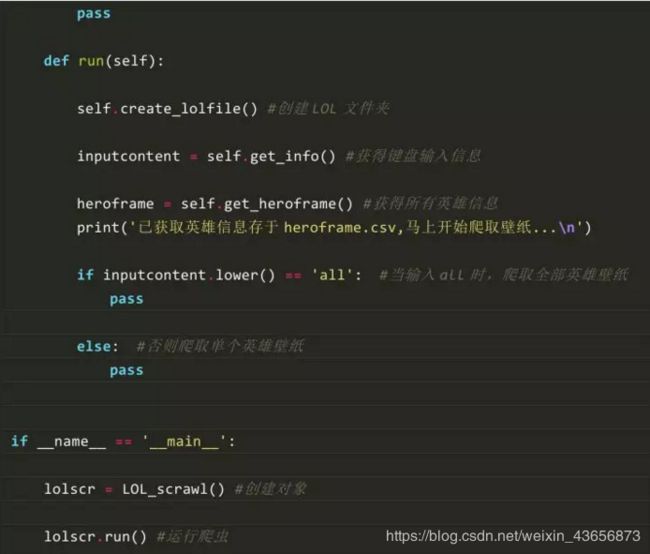

这个代码框架非常容易读懂,主要就是run()函数,run()函数完成了这样一套工作:创建LOL文件夹——获得键盘输入的信息——若信息为“All”则爬取全部英雄壁纸,否则爬取单个英雄壁纸。

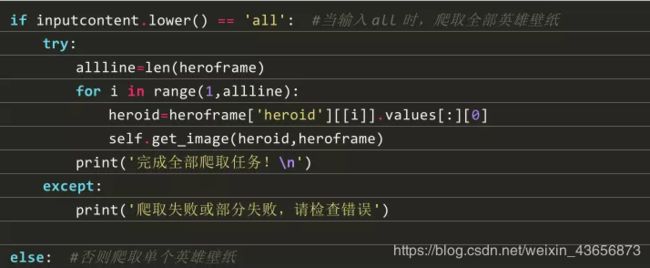

在爬取所有或者单个英雄壁纸时,由于可能因为网络不稳定等因素导致爬取失败,因此我们要使用try-except来处理爬取壁纸时的代码:

至此已经打好了爬虫框架,下面对爬取过程中最核心的两个代码进行解释:get_heroframe()与get_image(heroid,heroframe)。

首先我们要解析champion.js文件,得到英雄英文名与id的一一对应关系。使用urllib.request打开文件地址,读取内容并当做字符串处理,解析内容并转为字典{key:value},key为英文名,value为英雄id:

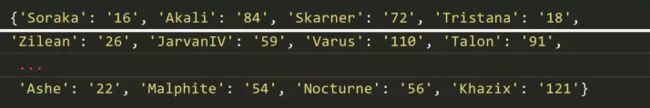

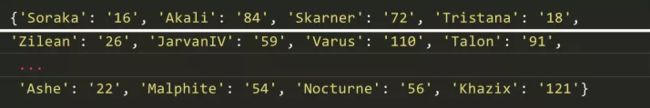

得到字典herodict{Englishname : id}如下:

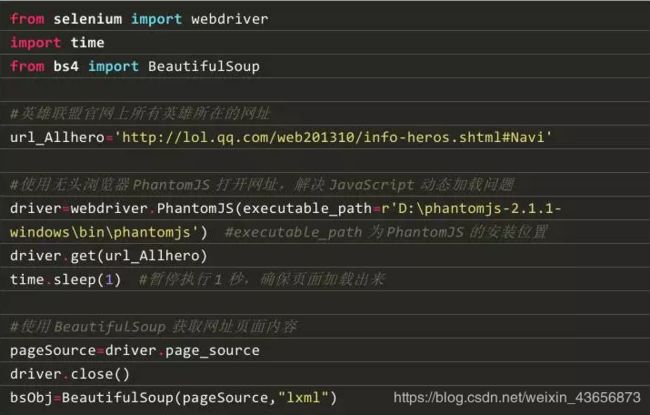

对于官网网站上的所有英雄信息页面,由于是用JavaScript加载出来的,普通方法并不好爬取,我们使用Selenium+PhantomJS的方法来动态加载英雄信息。Selenium 是自动化测试工具,它支持Chrome、Safari、Firefox 等浏览器驱动,在使用前先需要安装selenium模块。而PhantomJS是一个虚拟浏览器,它没有界面,但它的dom渲染、js运行、网络访问、canvas/svg绘制等功能都很完备,在页面抓取、页面输出、自动化测试等方面有广泛的应用。PhantomJS可以在官方网站上下载。

我们使用Selenium+PhantomJS的方法来动态加载英雄信息,使用BeautifulSoup获取网址页面内容:

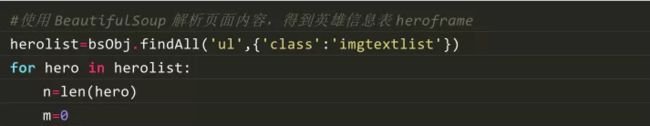

得到页面内容后,使用BeautifulSoup对页面内容进行解析,将英雄昵称、名称、id等信息存入heroframe中:

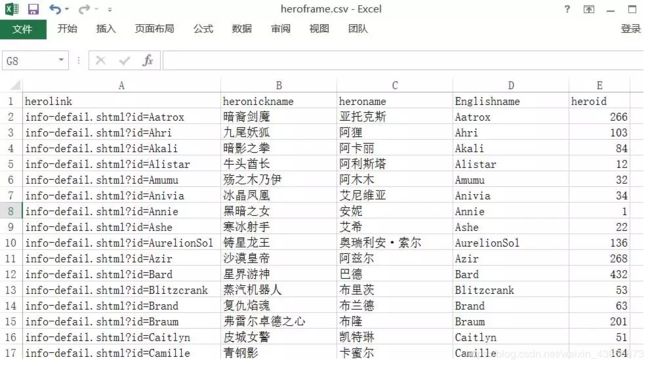

至此,get_heroframe()函数实现了爬取所有英雄的信息,并存放在heroframe.csv文件中,如下所示:

得到每一个英雄的信息后,我们就可以开始愉快的爬取它们的壁纸啦~定义get_image(heroid,heroframe)函数,用于爬取单个英雄的全部壁纸。

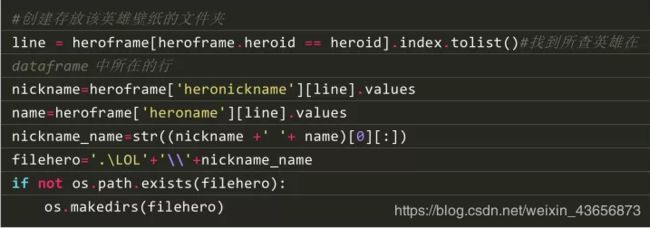

首先在LOL文件夹中建立该英雄的子文件夹:

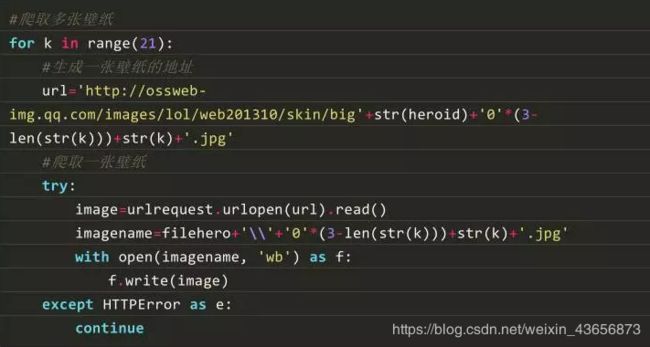

然后就可以爬取这个英雄的壁纸了。由于每个英雄壁纸都不超过20张,我们使用一个20以内的循环就能爬取到所有壁纸了:

爬取完成后输出成功的提示:

到这里就大功告成啦!只要运行一下这个小程序,所有英雄的皮肤壁纸就都收入囊中了,当然也可以爬取单个英雄的所有皮肤,只要根据提示输入英雄的昵称或名称就好。

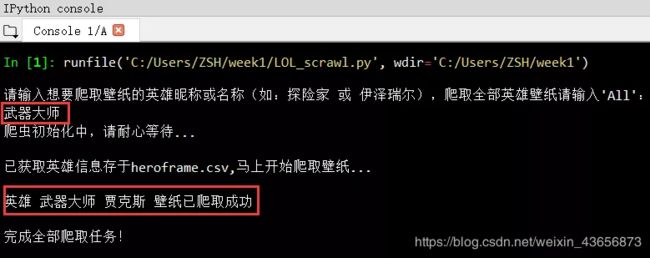

爬取单个英雄皮肤壁纸:

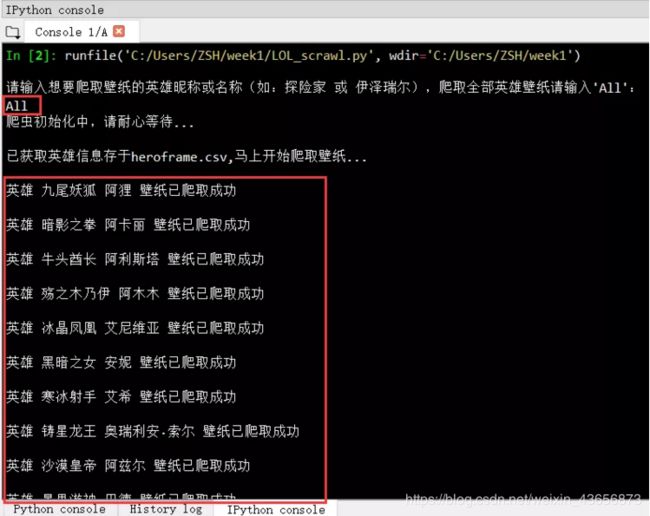

爬取所有英雄皮肤壁纸:

运行代码时注意保持网络畅通,如果网速太慢可能会爬取失败。在3兆有线网的网速下爬取全部139个英雄的全部高清壁纸(约一千张图)大概要3-4分钟。

《王者荣耀》、《阴阳师》、《绝地求生》等其他游戏的壁纸也是同样道理就可以爬取了,据我实践,《英雄联盟》的爬取难度是最高的,因此将上述过程弄懂了,自己再编写代码爬其他游戏就易如反掌了。