实践应用|Python自动化连接FTP批量下载指定文件

文章目录

- 前言

- 需求梳理

- 1、数据处理

- 原始数据长啥样?

- 筛选既定条件数据

- 选择需要用到的列

- 处理过程封装待用

- 2、确定文件及目录

- 3、连接FTP

- 4、批量下载文件

- 5、处理文件

- 6、最后,让脚本运行起来

前言

有个小姐姐要从历史数据日志里根据一定的规则筛选一批数据,这批数据中有对局战场id字段,再根据这些id转化为文件名,连接远程FTP搜索该文件并下载到本地,然后打开文件删除前5行并在第6行行首添加一个字母,最后将改文件后缀名修改。 一天处理50+个这样的文件转化需求,简单算了下,差不多刚好要一天时间吧!!

但是,这怎么可以!!!!!!

于是,我主动提出了救援支持,结果就是现在基本上10分钟以内可以搞定以上操作!!

需求梳理

①数据处理:按照一定规则从历史数据日志筛选一批数据

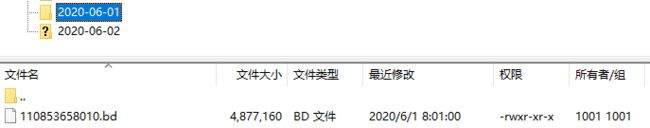

②确定文件及目录:根据一定规则确定文件名及所在FTP子目录(远程FTP按照日期建子目录存储的文件)

③连接FTP:连接远程FTP

④批量下载文件:依据②中文件名及目录循环切换FTP远程目录并下载文件

⑤处理文件:打开文件并删除前5行 在文件第6行行首添加字母,保存时修改文件后缀(格式)

1、数据处理

历史数据日志有多份,存放在同一个文件夹,文件格式是csv

使用pandas进行数据处理操作

处理步骤:

- 读取数据合并的时候同步按照既定条件进行数据筛选

- 选择需要用到的字段

原始数据长啥样?

pandas.csv()读取数据后,我们使用info可以发现原始日志包含了71个字段,同时单个文件200MB+38万条数据。。

>>>df.info()

<class 'pandas.core.frame.DataFrame'>

RangeIndex: 386418 entries, 0 to 386417

Data columns (total 71 columns):

# Column Non-Null Count Dtype

--- ------ -------------- -----

0 @timestamp 386418 non-null object

1 appid 386418 non-null int64

2 assist 386418 non-null int64

3 battle_sum 386418 non-null int64

4 battleid 386418 non-null int64

...

69 usernum 386418 non-null int64

70 victory 386418 non-null int64

dtypes: float64(7), int64(54), object(10)

memory usage: 209.3+ MB

筛选既定条件数据

考虑到我们一次性处理的文件数不止一个,所以在读取原始日志后可以先把条件筛选工作做了再合并。

处理完之后,我们发现文件大小降低为7.9KB,很轻松的感觉有木有~

>>>df = df[df['modetid']>=117 ]

>>>df = df[df['usernum']>=10 ]

>>>df = df[df['pentakill']>=1 ]

>>>df.info()

<class 'pandas.core.frame.DataFrame'>

Int64Index: 14 entries, 117184 to 384421

Data columns (total 71 columns):

# Column Non-Null Count Dtype

--- ------ -------------- -----

0 @timestamp 14 non-null object

1 appid 14 non-null int64

2 assist 14 non-null int64

3 battle_sum 14 non-null int64

4 battleid 14 non-null int64

...

69 usernum 14 non-null int64

70 victory 14 non-null int64

dtypes: float64(7), int64(54), object(10)

memory usage: 7.9+ KB

选择需要用到的列

实际上我们在后续处理中需要用到的列比较少,咱们一并处理了吧

>>>df = df[['@timestamp','battleid','herotid','quadrakill','pentakill']]

>>>df.info()

<class 'pandas.core.frame.DataFrame'>

Int64Index: 14 entries, 117184 to 384421

Data columns (total 5 columns):

# Column Non-Null Count Dtype

--- ------ -------------- -----

0 @timestamp 14 non-null object

1 battleid 14 non-null int64

2 herotid 14 non-null int64

3 quadrakill 14 non-null int64

4 pentakill 14 non-null int64

dtypes: int64(4), object(1)

memory usage: 672.0+ bytes

处理过程封装待用

由于合并多文件的操作在此前介绍过,这里不做更多科普,有兴趣同学可以前往查阅

以下是全部代码:

import os

import pandas as pd

import time

def concatData():

start_time = time.perf_counter()

print('正在读取原始对局日志......')

location = './对局日志'

fileList = []

n = 0

#合并数据

for fileName in os.walk(location):

for table in fileName[2]:

path = fileName[0] + '/' +table

Li = pd.read_csv(path,header=0)

#通过指定规则筛选数据

Li = Li[Li['modetid']>=117 ]

Li = Li[Li['usernum']>=10 ]

Li = Li[Li['pentakill']>=1 ]

n = n+1

fileList.append(Li)

print('第'+str(n)+'个表格已经合并')

print('在该目录下有%d个文件'%len(fileList))

print('正在合并,请稍等......')

res = pd.concat(fileList,ignore_index = True)

print('合并完成......')

#选择需要用到的字段

res = res[['@timestamp','battleid','herotid','quadrakill','pentakill']]

use_time = time.perf_counter() - start_time

print('合并数据消耗时长:{0:.2f} 秒\n'.format(use_time))

return res

2、确定文件及目录

在上一步数据处理后,我们得到的数据长下面这样:

>>>df.head()

@timestamp battleid herotid quadrakill pentakill

117184 2020-05-27 13:05:11 110853427027 14 0 1

130197 2020-05-27 13:49:10 110853428327 27 0 1

151473 2020-05-27 15:18:37 110853430538 17 0 1

185862 2020-05-27 17:39:53 110853434015 14 0 1

194350 2020-05-27 18:01:38 110853434646 22 0 1

在远程FTP里文件存储在二级目录里,二级目录是以日期命令,在历史数据日志里有每个对局发生的时间,因此可以通过这些字段行程 改文件及所在目录关系。

由于时间字段@timestamp是object格式,且形如“2020-05-27 13:05:11”,我们直接采用字符串的**split()**方法即可获得日期目录。

df['@timestamp'] = df['@timestamp'].str.split(' ').str[0]

文件格式为str(df.iloc[i][1])+’.bd’

3、连接FTP

Python中默认安装的ftplib模块,常见的函数列举如下:

参考文档:https://docs.python.org/3/library/ftplib.html

**ftp登录连接**

from ftplib import FTP #加载ftp模块

ftp=FTP() #设置变量

ftp.set_debuglevel(2) #打开调试级别2,显示详细信息

ftp.connect("IP","port") #连接的ftp sever和端口

ftp.login("user","password") #连接的用户名,密码

print ftp.getwelcome() #打印出欢迎信息

ftp.cmd("xxx/xxx") #进入远程目录

bufsize=1024 #设置的缓冲区大小

filename="filename.txt" #需要下载的文件

file_handle=open(filename,"wb").write #以写模式在本地打开文件

ftp.retrbinaly("RETR filename.txt",file_handle,bufsize) #接收服务器上文件并写入本地文件

ftp.set_debuglevel(0) #关闭调试模式

ftp.quit() #退出ftp

**ftp相关命令操作**

ftp.cwd(pathname) #设置FTP当前操作的路径

ftp.dir() #显示目录下所有目录信息

ftp.nlst() #获取目录下的文件

ftp.mkd(pathname) #新建远程目录

ftp.pwd() #返回当前所在位置

ftp.rmd(dirname) #删除远程目录

ftp.delete(filename) #删除远程文件

ftp.rename(fromname, toname)#将fromname修改名称为toname。

ftp.storbinaly("STOR filename.txt",file_handel,bufsize) #上传目标文件

ftp.retrbinary("RETR filename.txt",file_handel,bufsize) #下载FTP文件

获取远程FTP地址端口及账号密码后,即可进行连接

from ftplib import FTP

def ftpConnect():

#实例化一个fto对象

ftp =FTP()

#ftp地址及账号密码

host = 'xxx'

port = xxx

user_name = 'xxx'

password = 'xxx'

#连接ftp

ftp.connect(host ,port)

ftp.login(user_name,password)

#打印欢迎消息

print (ftp.getwelcome())

#设置被动模式(0是主动,1是被动)

ftp.set_pasv(1)

print('ftp连接成功\n')

return ftp

4、批量下载文件

下载文件前需要先切换到该文件所在的文件目录,然后再进行文件下载

切换文件目录:ftp.cwd(pathname) #设置FTP当前操作的路径

下载文件:ftp.retrbinary(“RETR filename.txt”,file_handel,bufsize) ,filename.txt是我们需要下载的文件

下载文件前先以写模式在本地打开文件file_handle=open(filename,“wb”).write

def ftpDownload(ftp,df):#df存放需要下载的文件及其所在目录

start_time = time.perf_counter()

n = 0

m = 0

print('正在下载文件')

for i in range(len(df.index)):

#获取文件所在目录

pathname = df.iloc[i][0]

#切换到文件所在目录

ftp.cwd(pathname)

#打印一级文件目录

#files = ftp.dir()

#获取目录下的所有文件

#file_list = ftp.nlst()

#设置本文件下载存储所在路径(./是当前文件所在路径)

local_path="./录像源文件/"

#为准备下载到本地的文件,创建文件对象

remote_file_name = str(df.iloc[i][1]) +'.bd'

try:

local_file_name=local_path + os.path.basename(remote_file_name)

file = open(local_file_name, 'wb')

#从FTP服务器下载文件到前一步创建的文件对象,其中写对象为file.write,1024是缓冲区大小

ftp.retrbinary('RETR '+remote_file_name,file.write,1024)

#关闭下载到本地的文件

file.close()

except :

m = m+1

print(f'\r共{m}个文件下载失败,共{n}个文件下载完成',end = ' ')

else:

n = n+1

print(f"\r共{m}个文件下载失败,共{n}个文件下载完成",end = ' ')

ftp.cwd('/')

#关闭FTP客户端连接

ftp.close()

print(f'\n共{n}个有效对局文件~')

print('\nftp连接已关闭')

use_time = time.perf_counter() - start_time

print('FTP数据下载消耗时长:{0:.2f} 秒\n'.format(use_time))

5、处理文件

由于需要处理的文件是字符串类型是bytes,在打开的时候需要用“rb”,删除前5行简单用del即可

在第六行行首写入字符时,需要注意以b作为前缀

def fileHandle(df):

print('正在进行数据转化')

m= 0

n= 0

for i in range(len(df.index)):

try:

refile = './录像源文件/' + str(df.iloc[i][1]) + '.bd'

fre = open(refile,'rb')

a = fre.readlines()

fre.close()

del a[0:5]

wrfile = './录像可执行文件/' + f'{str(i)}-' + df.iloc[i][5]+'五杀'+'.rep'

fwr = open(wrfile, 'wb')

a[0]= b'$'+a[0]

fwr.writelines(a)

fwr.close()

except :

m = m+1

print(f'\r共{m}个文件转化失败,共{n}个文件转化完成',end = ' ')

else:

n = n+1

print(f"\r共{m}个文件转化失败,共{n}个文件转化完成",end = ' ')

6、最后,让脚本运行起来

没啥别的,一步一步走,我们发现执行效率还蛮高的

中间遇到过 "error_perm:550 Failed to open file. "的问题,后来发现是远程文件目录不对或者本地文件没有读写权限导致的。

if __name__ == '__main__':

starttime = time.perf_counter()

#合并数据并过滤

res = concatData()

#关联英雄名称并处理日期与ftp目录一致

#df = mergeData(res)

#登录ftp

ftp = ftpConnect()

#下载指定文件

ftpDownload(ftp,df)

#转化数据为可播放文件

fileHandle(df)

usetime = time.perf_counter() - starttime

print('\n本次累积消耗时长:{0:.2f} 秒\n'.format(usetime))

人工处理可能需要一天时间,脚本执行只用了不到7分钟!!

>>>runfile('D:/ftp资源下载/ftp批量下载文件.py', wdir='D:/ftp资源下载')

正在读取原始对局日志......

第1个表格已经合并

第2个表格已经合并

第3个表格已经合并

在该目录下有3个文件

正在合并,请稍等......

合并完成......

合并数据消耗时长:10.29 秒

一共81个可用对局文件

220 (vsFTPd 3.0.2)

ftp连接成功

正在下载文件

共18个文件下载失败,共63个文件下载完成

共63个有效对局文件~

ftp连接已关闭

FTP数据下载消耗时长:395.89 秒

正在进行数据转化

共18个文件转化失败,共63个文件转化完成

本次累积消耗时长:407.21 秒