Hadoop大数据常用组件简介

文章目录

- 1. 分布式文件系统(HDFS)

- 1)NameNode

- 2)SecondaryNode

- 2. 资源管理调度框架Yarn

- 1)ResourceManager

- 2)ApplicationMaster

- 3)NodeManager

- 4)Container

- 3. 分布式协调服务ZooKeeper

- 4. 数据仓库工具Hive

- 1)HiveServer2

- 5. 分布式计算框架Spark

- 1)Spark SQL

- 2)Spark Streaming

- 3)Spark MLib

- 4)Spark GraphX

- 6. Sqoop

- 7. Hue

- 8. 分布式数据库HBase

- 1)行键(RowKey)

- 2)列族(CloumnFamily,CF)和列

- 3)时间戳(TimeStamp)

- 参考

1. 分布式文件系统(HDFS)

HDFS可以分布式地,以数据块的形式,存储大量数据(GB级到TB级甚至PB级),它的高可靠和高容错性主要体现在数据备份上,默认是3,就是两个数据块在同一个机架上,另一个在不同的机架上。

1)NameNode

NameNode主要是用来保存HDFS的元数据信息,比如命名空间信息,块信息等。当它运行的时候,这些信息是存在内存中的。但是这些信息也可以持久化到磁盘上。

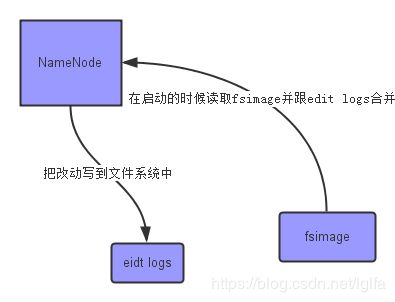

上面的这张图片展示了NameNode怎么把元数据保存到磁盘上的。这里有两个不同的文件:

-

fsimage - 它是在NameNode启动时对整个文件系统的快照

-

edit logs - 它是在NameNode启动后,对文件系统的改动序列

只有在NameNode重启时,edit logs才会合并到fsimage文件中,从而得到一个文件系统的最新快照。但是在产品集群中NameNode是很少重启的,这也意味着当NameNode运行了很长时间后,edit logs文件会变得很大。在这种情况下就会出现下面一些问题:

edit logs文件会变的很大,怎么去管理这个文件是一个挑战。

NameNode的重启会花费很长时间,因为有很多改动[注:在edit logs中]要合并到fsimage文件上。

如果NameNode挂掉了,那我们就丢失了很多改动因为此时的fsimage文件非常旧。[注: 在这个情况下丢失的改动不会很多, 因为丢失的改动应该是还在内存中但是没有写到edit logs的这部分。]

因此为了克服这个问题,才有了SecondaryNode来帮助我们减小edit logs文件的大小和得到一个最新的fsimage文件,这样也会减小在NameNode上的压力。这跟Windows的恢复点是非常像的,Windows的恢复点机制允许我们对OS进行快照,这样当系统发生问题时,我们能够回滚到最新的一次恢复点上。

2)SecondaryNode

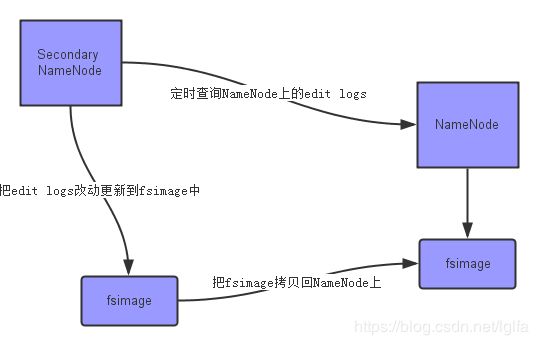

SecondaryNameNode就是来帮助解决上述问题的,它的职责是合并NameNode的edit logs到fsimage文件中。

上面的图片展示了Secondary NameNode是怎么工作的。

-

首先,它定时到NameNode去获取edit logs,并更新到fsimage上。[注:Secondary NameNode自己的fsimage]

-

一旦它有了新的fsimage文件,它将其拷贝回NameNode中。

-

NameNode在下次重启时会使用这个新的fsimage文件,从而减少重启的时间。

所以,Secondary NameNode的整个目的是在HDFS中提供一个检查点。

2. 资源管理调度框架Yarn

YARN(Yet Another Resource Negotiator)取代了Hadoop版本1中MapReduce的资源调度管理,为上层应用(Spark,Hive-MR任务等)提供统一的资源管理调度,Hadoop 2以后MapReduce只是运行在Yarn之上的一个纯粹的计算框架。

在整个Yarn资源管理系统当中, ResourceManager作为Master ,各个节点的NodeManager作为Slave。ResorceManager组件和HDFS的名称节点NameNode部署在一个节点上,Yarn的ApplicationMaster以及NodeManager是和HDFS的数据节点 DataNode部署在一起的,YARN中的Container容器(代表计算资源)也是和HDFS的数据节点DataNode在一起。

1)ResourceManager

简称RM,是Yarn的核心组件,或者说yarn的master,一般分配在主节点上,并做HA(高可用)部署,主要功能是负责集群所有资源(CPU和内存)的管理和分配。

2)ApplicationMaster

简称AM,一个应用程序对应一个AM,这个进程是在其中某一个节点运行的,主要为应用本身向RM申请资源,与NodeManager通信以启动或者停止任务,监控所有任务的运行情况,并在任务失败的情况下重新申请资源并重启任务。

3)NodeManager

简称NM,是每个子节点上的资源和任务管理器,或者说yarn的slave节点,一方面,它会定向通过心跳信息向RM汇报本节点上的资源使用情况和各个Container的运行情况;另一方面,它会接收并处理来自AM的Container启动和停止的各种请求。

4)Container

Container是Yarn对系统资源的抽象,同时它也是系统资源分配的基本单位,它封装节点上多维度资源,其中包括CPU、内存、磁盘、网络等。Yarn会为每个任务分配一个Container,并且该任务只能使用该Container中的描述的资源;注意,Contariner是一个动态的资源划分单位,资源是根据实际应用需求而变化的。挺类似docker container这种概念。

3. 分布式协调服务ZooKeeper

ZooKeeper作为一个高可用的分布式服务框架,主要用来解决分布式集群中应用系统的一致性问题,它可以减轻分布式应用程序所承担的协调任务,在Hadoop、HBase、Kafka等分布式系统中,ZooKeeper都作为核心组件使用的。其典型应用场景有1)实现HDFS的NameNode高可用HA;2)实现HBASE的HMaster高可用。

ZooKeeper的部署节点一般为奇数个。

4. 数据仓库工具Hive

Hive是一个基于Hadoop的强大的数据仓库工具,它可以将结构化的数据文件映射为一张数据库表,并提供简单的sql查询功能,可以将sql语句转换为MapReduce任务进行运行。 其优点是学习成本低,可以通过类SQL语句快速实现简单的MapReduce统计,不必开发专门的MapReduce应用,十分适合数据仓库的统计分析。

1)HiveServer2

HiveServer2(HS2)是一种能使客户端执行Hive查询的服务。其核心是用户可以通过Thrift进行Hive查询,也支持使用jdbc,odbc的方式连接。譬如hue是用thrift的方式连接的hive服务。

5. 分布式计算框架Spark

Spark是一个分布式计算框架,可以批处理和交互式处理,支持多语言(Java,Python,Scala等),具有丰富的API。

1)Spark SQL

Spark中处理结构化数据的一个模块,可以使用类SQL语句进行Spark编程。SparkSQL支持很多种结构化数据源,可以让你跳过复杂的读取过程,轻松从各种数据源读取到Row对象。这些数据源包括Hive表、JSON和Parquet文件。

2)Spark Streaming

为数据流处理而生,类似的还有Storm。其原理是把接收到的数据流分很多小的批次(batches),然后分批处理输出,如下图:

Spark Streaming的数据源可以是Kafka,Flume等,如下:

流处理过程中可以使用MLib库进行一些机器学习方面的建模等工作

3)Spark MLib

Spark的机器学习库

4)Spark GraphX

Spark用来图和分布式图计算的新组件,注意这里的图是一种数据结构(属性图,社交图,有向图无向图等),所以该组件主要是提供数据处理的。

6. Sqoop

主要用于在Hadoop(Hive)与传统的数据库(mysql、postgresql…)间进行数据的传递,可以将一个关系型数据库(例如 : MySQL ,Oracle ,Postgres等)中的数据导进到Hadoop的HDFS中,也可以将HDFS的数据导进到关系型数据库中。

7. Hue

Hue是一个Web前段交互式的工具,可以通过Hue的网页进行Hive查询、Spark跑批和Pig命令执行等,并能可视化查询结果。

8. 分布式数据库HBase

HBase是Hadoop的数据库,HBase是一个分布式的、面向列的开源数据库,它不同于一般的关系数据库,是一个适合非结构化数据存储的数据库。HBase利用Hadoop的HDFS作为其文件存储系统,利用ZooKeeper作为其协调工具,非常适合用来进行大数据的实时读写。

HBase表是一个稀疏多维表,表中的数据是未经解释的字符串,没有数据类型,每一行都有一个行键,表被分组成许多列族集合,列族支持动态扩展,可以很方便地添加一个列族或列,无须事先预定于列的数量和类型,所有列都是以字符串形式存储。

1)行键(RowKey)

HBase一张表中可以有上亿行记录,每一行都由一个行关键字rowkey来标识。HBase保证对所有行按照rowkey进行字典顺序排序存储。RowKey(行键)可以是任意字符串(最大长度是64KB,实际应用中长度一般为10~100字节)。与关系数据库的主键primarykey不同的地方,HBase中的RowKey只能是一个字段而不能是多个字段的组合。

2)列族(CloumnFamily,CF)和列

HBase表中的每个列,都归属于某个列族。列族必须在使用表之前定义(列不需要事先定义),列族数量不能太多,列名都以列族作为前缀。例如courses:english、courses:history都属于courses这个列族。在每个列族中,可以存放很多的列,而每行每列族中的列数量可以不同。

3)时间戳(TimeStamp)

HBase中通过行关键字、列(列族名和列名)和时间戳的三元组确定一个存储单元(cell)。每个cell都保存着同一份数据的多个版本,不同版本的数据按照时间倒序排序,即最新的数据

排在最前面。版本通过时间戳来索引。时间戳的类型是64位整型。时间戳可以由HBase(在数据写入时自动〉赋值,此时时间戳是精确到毫秒的当前系统时间。时间戳也可以由用户自己

赋值。

参考

1.《Cloudera Hadoop大数据平台实战指南》(宋立桓,陈建平)

2. Secondary NameNode:它究竟有什么作用?

3. 维基百科

4. CDH官网