统计学方法&机器学习实战(三) 决策树

目录

一、前言:

二、理论难点:

1、特征选择:

(1)香农熵

(2)信息增益

三、代码实践:

实验一 代码计算信息增益

实验二 决策树的构建

(1)决策树创建

(2)决策树可视化

(3)使用决策树进行分类

(4)决策树的存储

(5) 加载数据

实验三 决策树实战篇之为自己配个隐形眼镜

总结

参考资料:

一、前言:

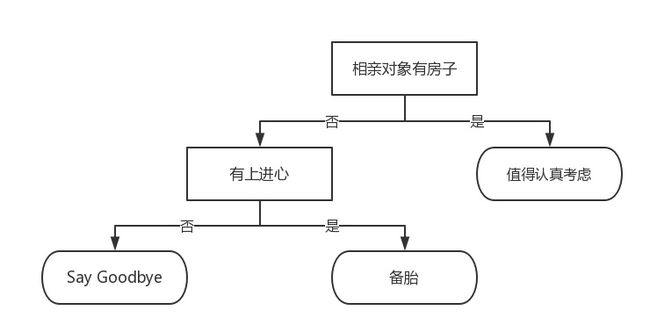

决策树是什么?决策树(decision tree)是一种基本的分类与回归方法。

我们可以把决策树看成一个if-then规则的集合,将决策树转换成if-then规则的过程是这样的

二、理论难点:

1、特征选择:

(1)香农熵

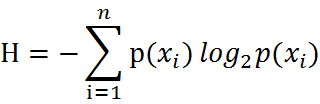

集合信息的度量方式称为香农熵或者简称为熵(entropy),熵定义为信息的期望值。在信息论与概率统计中,熵是表示随机变量不确定性的度量。

如果待分类的事物可能划分在多个分类之中,则符号xi的信息定义为 :

计算熵:

期中n是分类的数目。熵越大,随机变量的不确定性就越大。

当熵中的概率由数据估计(特别是最大似然估计)得到时,所对应的熵称为经验熵(empirical entropy)。

(2)信息增益

如何选择特征,需要看信息增益,信息增益是相对于特征而言的,信息增益越大,特征对最终的分类结果影响也就越大,我们就应该选择对最终分类结果影响最大的那个特征作为我们的分类特征。

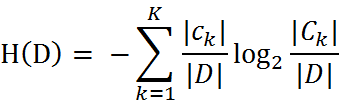

条件熵:

条件熵H(Y|X)表示在已知随机变量X的条件下随机变量Y的不确定性,随机变量X给定的条件下随机变量Y的条件熵(conditional entropy)H(Y|X),定义为X给定条件下Y的条件概率分布的熵对X的数学期望:

当条件熵中的概率由数据估计(特别是极大似然估计)得到时,所对应的条件熵称为条件经验熵(empirical conditional entropy)

经验条件熵公式:

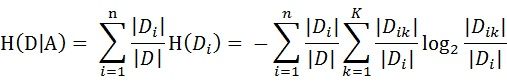

特征A对训练数据集D的信息增益g(D,A),定义为集合D的经验熵H(D)与特征A给定条件下D的经验条件熵H(D|A)之差,即:

熵H(D)与条件熵H(D|A)之差称为互信息(mutual information)

决策树学习中的信息增益等价于训练数据集中类与特征的互信息。

三、代码实践:

实验一 代码计算信息增益

from math import log

"""

函数说明:创建测试数据集

Parameters:

无

Returns:

dataSet - 数据集

labels - 分类属性

Author:

YDLin

Modify:

2020-07-14

"""

def createDataSet():

dataSet = [[0, 0, 0, 0, 'no'], #数据集

[0, 0, 0, 1, 'no'],

[0, 1, 0, 1, 'yes'],

[0, 1, 1, 0, 'yes'],

[0, 0, 0, 0, 'no'],

[1, 0, 0, 0, 'no'],

[1, 0, 0, 1, 'no'],

[1, 1, 1, 1, 'yes'],

[1, 0, 1, 2, 'yes'],

[1, 0, 1, 2, 'yes'],

[2, 0, 1, 2, 'yes'],

[2, 0, 1, 1, 'yes'],

[2, 1, 0, 1, 'yes'],

[2, 1, 0, 2, 'yes'],

[2, 0, 0, 0, 'no']]

labels = ['不放贷', '放贷'] #分类属性

return dataSet, labels #返回数据集和分类属性

"""

函数说明:计算给定数据集的经验熵(香农熵)

Parameters:

dataSet - 数据集

Returns:

shannonEnt - 经验熵(香农熵)

Author:

YDLin

Modify:

2017-03-29

"""

def calcShannonEnt(dataSet):

#返回数据集的行数

numEntires = len(dataSet)

# 保存每一标签(label)出现次数的字典

labelCounts = {}

# 对每组特征向量进行统计

for featVec in dataSet:

# 提取标签(label)信息

currentLabel = featVec[-1]

# 如果标签(label)没有放入统计次数的字典,添加进去

if currentLabel not in labelCounts.keys():

labelCounts[currentLabel] = 0

# Label计算

labelCounts[currentLabel] += 1

# 经验香农熵

shannonEnt = 0.0

# 计算香浓熵

for key in labelCounts:

# 选择该标签(label)的概率

prob = float(labelCounts[key]) / numEntires

# 利用公式计算

shannonEnt -= prob * log(prob, 2)

# 返回经验值(香浓熵)

return shannonEnt

dataSet, features = createDataSet()

print(dataSet)

print(calcShannonEnt(dataSet))

"""

函数说明:按照给定特征划分数据集

Parameters:

dataSet - 待划分的数据集

axis - 划分数据集的特征

value - 需要返回的特征的值

Returns:

无

Modify:

2020-07-15

"""

def splitDataSet(dataSet, axis, value):

retDataSet = [] #创建返回的数据集列表

for featVec in dataSet: #遍历数据集

if featVec[axis] == value:

reducedFeatVec = featVec[:axis] #去掉axis特征

reducedFeatVec.extend(featVec[axis+1:]) #将符合条件的添加到返回的数据集

retDataSet.append(reducedFeatVec)

return retDataSet #返回划分后的数据集

"""

函数说明:选择最优特征

Parameters:

dataSet - 数据集

Returns:

bestFeature - 信息增益最大的(最优)特征的索引值

Modify:

2020-07-15

"""

def chooseBestFeatureToSplit(dataSet):

# 特征数量

numFeatures = len(dataSet[0]) -1

# 计算数据集的香农熵

baseEntropy = calcShannonEnt(dataSet)

# 信息增益

bestInfoGain = 0.0

# 最优特征的索引值

bestFeature = -1

# 遍历所有特征

for i in range(numFeatures):

#获取dataSet的第i个所有特征

featList =[example[i] for example in dataSet]

# 创建set集合{},元素不可重复

uniquerVals = set(featList)

# 经验条件熵

newEntropy = 0.0

# 计算信息增益

for value in uniquerVals:

# syvDataSet划分后的子集

subDataSet = splitDataSet(dataSet, i, value)

# 计算子集的概率

prob = len(subDataSet) / float(len(dataSet))

# 根据公式计算经验条件熵

newEntropy += prob * calcShannonEnt(subDataSet)

# 信息增益

infoGain = baseEntropy - newEntropy

# 打印每个特征值的信息增益

print("第%d个特征的增益为%.3f" % (i, infoGain))

# 更新信息增益,找到最大的信息增益

if (infoGain > bestInfoGain):

bestInfoGain = infoGain

# 记录信息增益最大的特征的索引值

bestFeature = i

# 返回信息增益最大的特征的索引值

return bestFeature

dataSet, features = createDataSet()

print("最优特征索引值:" + str(chooseBestFeatureToSplit(dataSet)))实验二 决策树的构建

- 决策树构建

- 决策树可视化

- 使用决策树进行分类预测

- 决策树的存储和读取

(1)决策树创建

决策树的构建方法有很多种,采用ID3算法。

ID3算法的核心是在决策树各个结点上对应信息增益准则选择特征,递归地构建决策树。

def createDataSet():

dataSet = [[0, 0, 0, 0, 'no'], #数据集

[0, 0, 0, 1, 'no'],

[0, 1, 0, 1, 'yes'],

[0, 1, 1, 0, 'yes'],

[0, 0, 0, 0, 'no'],

[1, 0, 0, 0, 'no'],

[1, 0, 0, 1, 'no'],

[1, 1, 1, 1, 'yes'],

[1, 0, 1, 2, 'yes'],

[1, 0, 1, 2, 'yes'],

[2, 0, 1, 2, 'yes'],

[2, 0, 1, 1, 'yes'],

[2, 1, 0, 1, 'yes'],

[2, 1, 0, 2, 'yes'],

[2, 0, 0, 0, 'no']]

labels = ['年龄', '有工作', '有自己的房子', '信贷情况'] #特征标签

return dataSet, labels

"""

函数说明:统计classList中出现此处最多的元素(类标签)

Parameters:

classList - 类标签列表

Returns:

sortedClassCount[0][0] - 出现此处最多的元素(类标签)

Modify:

2020-07-15

"""

def majorityCnt(classList):

classCount = {}

for vote in clasList:

#统计classList中每个元素出现的次数

if vote not in classCount.keys():classCount[vote] = 0

classCount[vote] += 1

# 根据字典的值降序排序

sortedClassCount = sorted(classCount.items(),key = operator.itemgetter(1),reverse = True)

#返回classList中出现次数最多的元素

return sortedClassCount[0][0]

"""

函数说明:创建决策树

Parameters:

dataSet - 训练数据集

labels - 分类属性标签

featLabels - 存储选择的最优特征标签

Returns:

myTree - 决策树

Modify:

2020-07-15

"""

def createTree(dataSet, labels, featLabels):

# 取分类标签(是否放货: yes or no)

classList = [example[-1] for example in dataSet]

# 如果类别完全相同则停止继续划分

if classList.count(classList[0]) == len(classList):

return classList[0]

#遍历完所有特征时返回出现次数最多的类标签

if len(dataSet[0]) == 1 or len(labels) == 0:

return majorityCnt(classList)

# 选择最优特征

bestFeat = chooseBestFeatureToSplit(dataSet)

# 最优特征的标签

bestFeatLabel = labels[bestFeat]

featLabels.append(bestFeatLabel)

# 根据最优特征的标签生成树

myTree = {bestFeatLabel:{}}

# 删除已经使用特征标签

del(labels[bestFeat])

# 得到训练集中所有最优特征的属性值

featValues = [example[bestFeat] for example in dataSet]

# 去掉重复的属性值

uniqueVals = set(featValues)

# 遍历特征,创建决策树

for value in uniqueVals:

subLabels = labels[:]

myTree[bestFeatLabel][value] = createTree(splitDataSet(dataSet,bestFeat, value),subLabels, featLabels)

return myTree递归创建决策树时,递归有两个终止条件:

- 第一个停止条件是所有的类标签完全相同,则直接返回该类标签;

- 第二个停止条件是使用完了所有特征,仍然不能将数据划分仅包含唯一类别的分组,即决策树构建失败,特征不够用。此时说明数据纬度不够,由于第二个停止条件无法简单地返回唯一的类标签,这里挑选出现数量最多的类别作为返回值。

(2)决策树可视化

这里代码都是关于Matlotlib的

可视化需要用到的函数:

- getNumLeafs:获取决策树叶子结点的数目

- getTreeDepth:获取决策树的层数

- plotNode:绘制结点

- plotMidText:标注有向边属性值

- plotTree:绘制决策树

- createPlot:创建绘制面板

我对可视化决策树的程序进行了详细的注释,直接看代码,调试查看即可。为了显示中文,需要设置FontProperties

from matplotlib.font_manager import FontProperties

import matplotlib.pyplot as plt

from math import log

import operator

"""

函数说明:获取决策树叶子结点的数目

Parameters:

myTree - 决策树

Returns:

numLeafs - 决策树的叶子结点的数目

Modify:

2020-07-15

"""

def getNumLeafs(myTree):

#初始化叶子

numLeafs = 0

#python3中myTree.keys()返回的是dict_keys,不在是list,所以不能使用myTree.keys()[0]的方法获取结点属性,可以使用list(myTree.keys())[0]

firstStr = next(iter(myTree))

#获取下一组字典

secondDict = myTree[firstStr]

for key in secondDict.keys():

if type(secondDict[key]).__name__=='dict':

#测试该结点是否为字典,如果不是字典,代表此结点为叶子结点

numLeafs += getNumLeafs(secondDict[key])

else: numLeafs +=1

return numLeafs

"""

函数说明:获取决策树的层数

Parameters:

myTree - 决策树

Returns:

maxDepth - 决策树的层数

Modify:

2020-07-15

"""

def getTreeDepth(myTree):

#初始化决策树深度

maxDepth = 0

#python3中myTree.keys()返回的是dict_keys,不在是list,所以不能使用myTree.keys()[0]的方法获取结点属性,可以使用list(myTree.keys())[0]

firstStr = next(iter(myTree))

#获取下一个字典

secondDict = myTree[firstStr]

for key in secondDict.keys():

if type(secondDict[key]).__name__=='dict':

#测试该结点是否为字典,如果不是字典,代表此结点为叶子结点

thisDepth = 1 + getTreeDepth(secondDict[key])

else: thisDepth = 1

#更新层数

if thisDepth > maxDepth: maxDepth = thisDepth

return maxDepth

"""

函数说明:绘制结点

Parameters:

nodeTxt - 结点名

centerPt - 文本位置

parentPt - 标注的箭头位置

nodeType - 结点格式

Returns:

无

Modify:

2020-07-15

"""

def plotNode(nodeTxt, centerPt, parentPt, nodeType):

#定义箭头格式

arrow_args = dict(arrowstyle="<-")

#设置中文字体

font = FontProperties(fname=r"c:\windows\fonts\simsun.ttc", size=14)

#绘制结点

createPlot.ax1.annotate(nodeTxt, xy=parentPt, xycoords='axes fraction',

xytext=centerPt, textcoords='axes fraction',

va="center", ha="center", bbox=nodeType, arrowprops=arrow_args, FontProperties=font)

"""

函数说明:标注有向边属性值

Parameters:

cntrPt、parentPt - 用于计算标注位置

txtString - 标注的内容

Returns:

无

Modify:

2020-07-15

"""

def plotMidText(cntrPt, parentPt, txtString):

#计算标注位置

xMid = (parentPt[0]-cntrPt[0]) / 2.0 + cntrPt[0]

yMid = (parentPt[1]-cntrPt[1]) / 2.0 + cntrPt[1]

createPlot.ax1.text(xMid, yMid, txtString, va="center", ha="center", rotation=30)

"""

函数说明:绘制决策树

Parameters:

myTree - 决策树(字典)

parentPt - 标注的内容

nodeTxt - 结点名

Returns:

无

Modify:

2020-07-15

"""

def plotTree(myTree, parentPt, nodeTxt):

#设置结点格式

decisionNode = dict(boxstyle="sawtooth", fc="0.8")

#设置叶结点格式

leafNode = dict(boxstyle="round4", fc="0.8")

#获取决策树叶结点数目,决定了树的宽度

numLeafs = getNumLeafs(myTree)

#获取决策树层数

depth = getTreeDepth(myTree)

#下个字典

firstStr = next(iter(myTree))

#中心位置

cntrPt = (plotTree.xOff + (1.0 + float(numLeafs))/2.0/plotTree.totalW, plotTree.yOff)

#标注有向边属性值

plotMidText(cntrPt, parentPt, nodeTxt)

#绘制结点

plotNode(firstStr, cntrPt, parentPt, decisionNode)

#下一个字典,也就是继续绘制子结点

secondDict = myTree[firstStr]

#y偏移

plotTree.yOff = plotTree.yOff - 1.0/plotTree.totalD

for key in secondDict.keys():

#测试该结点是否为字典,如果不是字典,代表此结点为叶子结点

if type(secondDict[key]).__name__=='dict':

#不是叶结点,递归调用继续绘制

plotTree(secondDict[key],cntrPt,str(key))

else:

#如果是叶结点,绘制叶结点,并标注有向边属性值

plotTree.xOff = plotTree.xOff + 1.0/plotTree.totalW

plotNode(secondDict[key], (plotTree.xOff, plotTree.yOff), cntrPt, leafNode)

plotMidText((plotTree.xOff, plotTree.yOff), cntrPt, str(key))

plotTree.yOff = plotTree.yOff + 1.0/plotTree.totalD

"""

函数说明:创建绘制面板

Parameters:

inTree - 决策树(字典)

Returns:

无

Author:

Jack Cui

Blog:

http://blog.csdn.net/c406495762

Modify:

2017-07-24

"""

def createPlot(inTree):

fig = plt.figure(1, facecolor='white')

fig.clf() #清空fig

axprops = dict(xticks=[], yticks=[])

createPlot.ax1 = plt.subplot(111, frameon=False, **axprops) #去掉x、y轴

plotTree.totalW = float(getNumLeafs(inTree)) #获取决策树叶结点数目

plotTree.totalD = float(getTreeDepth(inTree)) #获取决策树层数

plotTree.xOff = -0.5/plotTree.totalW; plotTree.yOff = 1.0; #x偏移

plotTree(inTree, (0.5,1.0), '') #绘制决策树

plt.show() #显示绘制结果 (3)使用决策树进行分类

在构建决策树的代码,可以看到,有个featLabels参数。它是用来干什么的?它就是用来记录各个分类结点的,在用决策树做预测的时候,我们按顺序输入需要的分类结点的属性值即可。

举个例子,比如我用上述已经训练好的决策树做分类,那么我只需要提供这个人是否有房子,是否有工作这两个信息即可,无需提供冗余的信息。

from math import log

import operator

"""

函数说明:使用决策树分类

Parameters:

inputTree - 已经生成的决策树

featLabels - 存储选择的最优特征标签

testVec - 测试数据列表,顺序对应最优特征标签

Returns:

classLabel - 分类结果

Modify:

2020-07-16

"""

def classify(inputTree, featLabels, testVec):

# 获取决策树节点

firstStr = next(iter(inputTree))

# 下一个字典

secondDict = inputTree[firstStr]

featIndex = featLabels.index(firstStr)

for key in secondDict.keys():

if testVec[featIndex] == key:

if type(secondDict[key]).__name__ == 'dict':

classLabel = classify(secondDict[key],featLabels, testVec)

else: classLabel = secondDict[key]

return classLabel

dataSet, labels = createDataSet()

featLabels = []

myTree = createTree(dataSet, labels, featLabels)

testVec = [0,1]

result = classify(myTree, featLabels, testVec)

if result == 'yes':

print('放贷')

if result == 'no':

print('不放贷')(4)决策树的存储

import pickle

"""

函数说明:读取决策树

Parameters:

filename - 决策树的存储文件名

Returns:

pickle.load(fr) - 决策树字典

Modify:

2020-07-16

"""

def sotreTree(inputTree, filename):

with open(filename, 'wb') as fw:

pickle.dump(inputTree, fw)(5) 加载数据

"""

函数说明:读取决策树

Parameters:

filename - 决策树的存储文件名

Returns:

pickle.load(fr) - 决策树字典

Author:

Jack Cui

Blog:

http://blog.csdn.net/c406495762

Modify:

2020-07-15

"""

def grabTree(filename):

fr = open(filename, 'rb')

return pickle.load(fr)

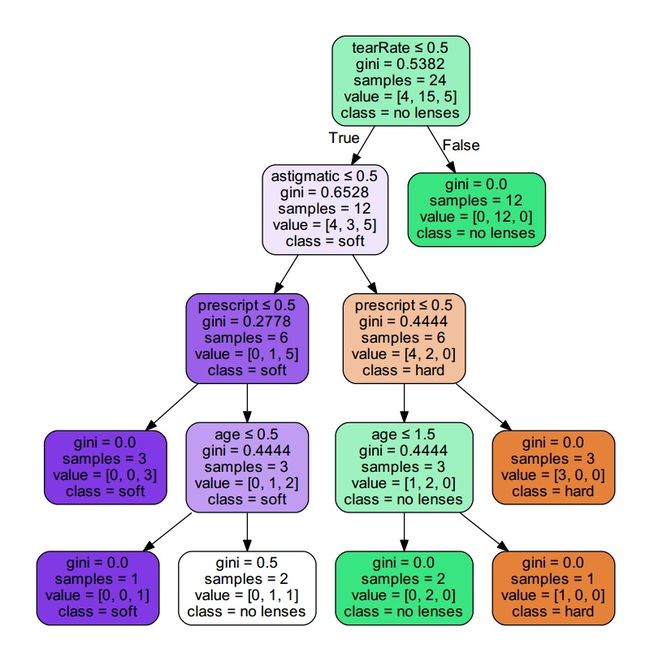

实验三 决策树实战篇之为自己配个隐形眼镜

具体实施步骤参考:

https://cuijiahua.com/blog/2017/11/ml_3_decision_tree_2.html

运行效果:

总结

决策树的一些优点:

- 决策树可以可视化直观。

- 几乎不需要数据预处理。

- 使用树的花费(例如预测数据)是训练数据点(data points)数量的对数。

- 可以同时处理数值变量和分类变量。其他方法大都适用于分析一种变量的集合。

- 可以处理多值输出变量问题。

- 使用白盒模型。如果一个情况被观察到,使用逻辑判断容易表示这种规则。相反,如果是黑盒模型(例如人工神经网络),结果会非常难解释。

- 即使对真实模型来说,假设无效的情况下,也可以较好的适用(选特征值的时候被剔除)。

决策树的一些缺点:

- 决策树学习可能创建一个过于复杂的树,并不能很好的预测数据。也就是过拟合。修剪机制(现在不支持),设置一个叶子节点需要的最小样本数量,或者数的最大深度,可以避免过拟合。

- 决策树可能是不稳定的,因为即使非常小的变异,可能会产生一颗完全不同的树。这个问题通过decision trees with an ensemble来缓解。

- 概念难以学习,因为决策树没有很好的解释他们,例如,XOR, parity or multiplexer problems。

- 如果某些分类占优势,决策树将会创建一棵有偏差的树。因此,建议在训练之前,先抽样使样本均衡。

参考资料:

- https://cuijiahua.com/blog/2017/11/ml_5_bayes_2.html

- 统计学习方法-李航

- 统计学习方法-课后练习

- 机器学习实战

笔记会放在我的Github里面