Spark学习(六)---SparkSQL介绍

这次我们学习SaprkSQL,主要分三个部分

- Spark SQL的原理

- DataFrame数据结构和使用方式

- DataSet数据结构和使用方式

1. Spark SQL

1.1 Spark SQL历史

Shark是一个为Spark设计的大规模数据仓库系统,它与Hive兼容。Shark建立在Hive的代码基础上,并通过将Hive的部分物理执行计划交换出来。这个方法使得Shark的用户可以加速Hive的查询,但是Shark继承了Hive的大且复杂的代码使得Shark很难优化和维护,同时Shark依赖于Spark的版本。随着我们遇到了性能优化的上限,以及集成SQL的一些复杂的分析功能,我们发现Hive的MapReduce设计的框架限制了Shark的发展。在2014年7月1日的Spark Summit上,Databricks宣布终止对Shark的开发,将重点放到Spark SQL上。

1.2 什么是Spark SQL(引用官网内容)

Spark SQL是Spark用来处理结构化数据的一个模块,它提供了一个编程抽象叫做DataFrame并且作为分布式SQL查询引擎的作用。

相比于Spark RDD API,Spark SQL包含了对结构化数据和在其上运算的更多信息,Spark SQL使用这些信息进行了额外的优化,使对结构化数据的操作更加高效和方便。

有多种方式去使用Spark SQL,包括SQL、DataFrames API和Datasets API。但无论是哪种API或者是编程语言,它们都是基于同样的执行引擎,因此你可以在不同的API之间随意切换,它们各有各的特点,看你喜欢那种风格。

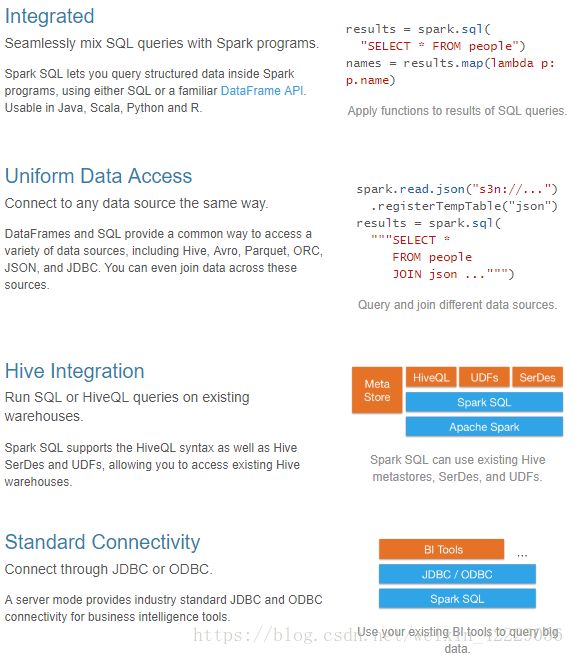

1.3 Spark SQL的优点

我们已经学习了Hive,它是将Hive SQL转换成MapReduce然后提交到集群中去执行,大大简化了编写MapReduce程序的复杂性,由于MapReduce这种计算模型执行效率比较慢,所以Spark SQL应运而生,它是将Spark SQL转换成RDD,然后提交到集群中去运行,执行效率非常快!

- 容易整合,将sql查询与spark程序无缝混合,可以使用java、scala、python、R等语言的API操作。

- 统一的数据访问,以相同的方式连接到任何数据源。

- 兼容Hive,支持HiveQL操作

- 标准的数据连接,可以使用行业标准的JDBC或ODBC连接。

2. DataFrame数据结构

2.1 什么是DataFrame

DataFrame的前身是SchemaRDD,从Spark 1.3.0开始SchemaRDD更名为DataFrame。与SchemaRDD的主要区别是:DataFrame不再直接继承自RDD,而是自己实现了RDD的绝大多数功能。你仍旧可以在DataFrame上调用rdd方法将其转换为一个RDD。

在Spark中,DataFrame是一种以RDD为基础的分布式数据集,类似于传统数据库的二维表格,DataFrame带有Schema元信息,即DataFrame所表示的二维表数据集的每一列都带有名称和类型,但底层做了更多的优化。DataFrame可以从很多数据源构建,比如:已经存在的RDD、结构化文件、外部数据库、Hive表。

2.2 DataFrame和RDD的区别

RDD可看作是分布式的对象的集合,Spark并不知道对象的详细模式信息,DataFrame可看作是分布式的Row对象的集合,其提供了由列组成的详细模式信息,使得Spark SQL可以进行某些形式的执行优化。DataFrame和普通的RDD的逻辑框架区别如下所示:

- 左边的RDD

虽然以Person为类型参数,但Spark框架本身不了解 Person类的内部结构。 - 右边的DataFrame

DataFrame却提供了详细的结构信息,使得Spark SQL可以清楚地知道该数据集中包含哪些列,每列的名称和类型各是什么,DataFrame多了数据的结构信息,即schema。这样看起来就像一张表了,DataFrame还配套了新的操作数据的方法,DataFrame API(如df.select())和SQL(select id, name from xx_table where …)。

2.3 DataFrame的off-heap

- 此外DataFrame还引入了off-heap,意味着JVM堆以外的内存, 这些内存直接受操作系统管理(而不是JVM)。Spark能够以二进制的形式序列化数据(不包括结构)到off-heap中, 当要操作数据时, 就直接操作off-heap内存. 由于Spark理解schema, 所以知道该如何操作。

- RDD是分布式的Java对象的集合。DataFrame是分布式的Row对象的集合。DataFrame除了提供了比RDD更丰富的算子以外,更重要的特点是提升执行效

率、减少数据读取以及执行计划的优化。 - 有了DataFrame这个高一层的抽象后,我们处理数据更加简单了,甚至可以用SQL来处理数据了,对开发者来说,易用性有了很大的提升。

不仅如此,通过DataFrame API或SQL处理数据,会自动经过Spark 优化器(Catalyst)的优化,即使你写的程序或SQL不高效,也可以运行的很快。

2.4 DataFrame与RDD的优缺点

RDD的优缺点:

优点:

(1)编译时类型安全 ,编译时就能检查出类型错误

(2)面向对象的编程风格 ,直接通过对象调用方法的形式来操作数据

缺点:

(1)序列化和反序列化的性能开销 ,无论是集群间的通信, 还是IO操作都需要对对象的结构和数据进行序列化和反序列化。

(2)GC的性能开销 ,频繁的创建和销毁对象, 势必会增加GC

DataFrame的优缺点:

- DataFrame通过引入schema和off-heap(不在堆里面的内存,指的是除了不在堆的内存,使用操作系统上的内存),解决了RDD的缺点, Spark通过schame就能够读懂数据,

- 因此在通信和IO时就只需要序列化和反序列化数据, 而结构的部分就可以省略了;通过off-heap引入,可以快速的操作数据,避免大量的GC。

- 但是却丢了RDD的优点,DataFrame不是类型安全的, API也不是面向对象风格的。

3.DataFrame的操作

3.1 DataFrame读取数据源

DataFrame读取数据有多种方式,我们这里介绍集中主要的读取方式。

在spark2.0版本之前,Spark SQL中SQLContext是创建DataFrame和执行SQL的入口,可以利用hiveContext通过hive sql语句操作hive表数据,兼容hive操作,并且hiveContext继承自SQLContext。在spark2.0之后,这些都统一于SparkSession,SparkSession 封装了 SparkContext,SqlContext,通过SparkSession可以获取到SparkConetxt,SqlContext对象。

方式一:读取本地数据源

- (1)在本地创建一个文件,有三列,分别是id、name、age,用空格分隔,然后上传到hdfs上。person.txt内容为:

//1. 文件信息如下

1 zhangsan 20

2 lisi 29

3 wangwu 25

4 zhaoliu 30

5 tianqi 35

6 kobe 40

//2. 上传文件到HDFS

hdfs dfs -put person.txt /

//3.启动spark-shell

saprk-shell --master local[2]

//4.读取切分文件

val lineRDD= sc.textFile("/person.txt").map(_.split(" "))

//5.创建person对象(相当于表的schema)

case class Person(id:Int, name:String, age:Int)

//6. 将RDD和case class关联

val personRDD = lineRDD.map(x => Person(x(0).toInt, x(1), x(2).toInt))

//7. 将RDD转换成DataFrame

val personDF = personRDD.toDF

//8. 对DataFrame进行处理

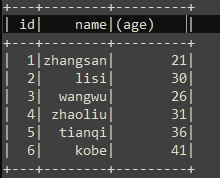

personDF.show

最终的显示结果如下

另一种方式是直接使用是通过SparkSession构建DataFrame

使用spark-shell中已经初始化好的SparkSession对象spark生成DataFrame

val dataFrame=spark.read.text("/person.txt")

方式二:读取json数据文件

数据文件可以在spark中找到,如下位置

使用spark安装包下的

$spark/examples/src/main/resources/people.json文件

1. 加载文件

val jsonDF= spark.read.json("file:///opt/bigdata/spark/examples/src/main/resources/people.json")

2. 显示数据

jsonDF.show

方式三:读取parquet列式存储格式文

数据文件

使用spark安装包下的

// 读取文件

val parquetDF=spark.read.parquet("file:///opt/bigdata/spark/examples/src/main/resources/users.parquet")

3.2 DataFrame常用操作

DataFrame提供了一个领域特定语言(DSL)来操作结构化数据。

下面是一些使用示例

查看DataFrame中的内容,通过调用show方法

personDF.show

查看name字段的数据

personDF.select(personDF.col("name")).show

查看name字段的另一种写法

personDF.select("name").show

查看 name 和age字段数据

personDF.select(col("name"), col("age")).show

打印DataFrame的Schema信息

personDF.printSchema

查询所有的name和age,并将age+1

personDF.select(col("id"), col("name"), col("age") + 1).show

也可以这样:

personDF.select(personDF("id"), personDF("name"), personDF("age") + 1).show

过滤age大于等于25的,使用filter方法过滤

personDF.filter(col("age") >= 25).show

统计年龄大于30的人数

personDF.filter(col("age")>30).count()

按年龄进行分组并统计相同年龄的人数

personDF.groupBy("age").count().show

3.3 SQL语法风格

DataFrame的一个强大之处就是我们可以将它看作是一个关系型数据表,然后可以通过在程序中使用spark.sql() 来执行SQL语句查询,结果返回一个DataFrame。

需要将DataFrame注册成表,采用如下的方式:

personDF.registerTempTable("t_person")

查询年龄最大的前两名

spark.sql("select * from t_person order by age desc limit 2").show

显示表的Schema信息

spark.sql("desc t_person").show

查询年龄大于30的人的信息

spark.sql("select * from t_person where age > 30 ").show

4. DataSet介绍

4.1 概念

DataSet是分布式的数据集合,Dataset提供了强类型支持,也是在RDD的每行数据加了类型约束。DataSet是在Spark1.6中添加的新的接口。它集中了RDD的优点(强类型和可以用强大lambda函数)以及使用了Spark SQL优化的执行引擎。DataSet可以通过JVM的对象进行构建,可以用函数式的转换(map/flatmap/filter)进行多种操作。

4.2DataFrame、DataSet、RDD的区别

假设RDD中的两行数据长这样:

那么DataFrame中的数据长这样:

那么Dataset中的数据长这样:

或者长这样(每行数据是个Object):

DataSet包含了DataFrame的功能,Spark2.0中两者统一,DataFrame表示为DataSet[Row],即DataSet的子集。

(1)DataSet可以在编译时检查类型

(2)并且是面向对象的编程接口

相比DataFrame,Dataset提供了编译时类型检查,对于分布式程序来讲,提交一次作业太费劲了(要编译、打包、上传、运行),到提交到集群运行时才发现错误,这会浪费大量的时间,这也是引入Dataset的一个重要原因。

4.3 DataFrame与DataSet互相转换

DataFrame和DataSet可以相互转化。

(1)DataFrame转为 DataSet

df.as[ElementType]

(2)DataSet转为DataFrame

ds.toDF()

4. 4创建DataSet

//通过spark.createDataset创建

val ds1 = spark.createDataset(1 to 5)

ds1.show

//加载本地文件创建dataSet

val ds2= spark.createDataset(sc.textFile(“people.txt”))

ds2.show

通toDS方法生成DataSet

//创建样例类

case class Person(name:String,age:long)

//创建list集合

val data = List(Person(“zhangsan,20”),(“lisi”,18))

//转换成dataSet

val ds = data.toDS

ds.show

通过DataFrame转化生成,使用as[类型]转换为DataSet

//创建样例类

case class Person(name:String,age:long)

//生成DF文件

val jsonDF= spark.read.json("file:///opt/bigdata/spark/examples/src/main/resources/people.json")

//转化

val DS = jsonDF.as[Person]

//显示数据

DS.show

更多DataSet操作API地址:

http://spark.apache.org/docs/2.0.2/api/scala/index.html#org.apache.spark.sql.Dataset

本次介绍结束