牛顿法及拟牛顿法笔记

牛顿法

二阶优化算法又称为牛顿法,牛顿法是微积分学中, 通过迭代以求解可微函数f的零点的一种算法,而在最优化中,牛顿法通常被运用于求解一个二次可微函数f的一阶导数f’的零点x, 同时也是f的驻点。 因此从另一个角度而言,应用于最优化中的牛顿法是求解函数 f(x)的最小值或最大值的一种算法。

考虑无约束最优化问题

m i n x ∈ R n f ( x ) min _{x \in R^n} f(x) minx∈Rnf(x)

其中$ x^* $是目标函数的最小点

假设f(x)具有二阶连续偏导数,设第k次迭代值是 x ( k ) x^{(k)} x(k),则可以将f(x)在 x ( k ) x^{(k)} x(k)处进行泰勒二次展开:

f ( x ) = f ( x ( k ) ) + g k T ( x − x ( k ) ) + 1 / 2 ( x − x ( k ) ) H ( x ( k ) ) ( x − x ( k ) ) f(x) = f(x^{(k)}) + g_k^T(x - x^{(k)}) + 1/2(x-x^{(k)})H(x^{(k)})(x-x^{(k)}) f(x)=f(x(k))+gkT(x−x(k))+1/2(x−x(k))H(x(k))(x−x(k))

其中 g k T = ∇ f ( x ( k ) ) , H ( x ( k ) ) g_k^T = \nabla f(x^{(k)}), H(x^{(k)}) gkT=∇f(x(k)),H(x(k))是f(x)的Hessain矩阵

H ( x ) = [ ∂ 2 f ( x ) ∂ x i ∂ x j ] H(x) = [\frac {\partial ^2f(x)} { \partial x_i \partial x_j}] H(x)=[∂xi∂xj∂2f(x)]

函数f(x)有极值的必要条件是极值点一阶导数是0

那么对f(x)的泰勒展开求导并令导数为0得到如下,并令 x ( k + 1 ) x^{(k+1)} x(k+1)为下一次迭代的值

g k + H k ( x ( k + 1 ) − x ( k ) ) = 0 g_k + H_k (x^{(k+1)} - x^{(k)}) = 0 gk+Hk(x(k+1)−x(k))=0

那么就可以得到

x ( k + 1 ) = x ( k ) + p k x^{(k+1)} = x^{(k)} + p_k x(k+1)=x(k)+pk

其中, p k p_k pk 包含了这次的迭代方向,他由下面这个式子决定

H k p k = − g k H_k p_k = -g_k Hkpk=−gk

如果 H k H_k Hk可逆,则有

x ( k + 1 ) = x ( k ) − H k − 1 g k x^{(k+1)} = x^{(k)} - H_k ^{-1}g_k x(k+1)=x(k)−Hk−1gk

拟牛顿法

上述牛顿法需要计算Hessain的逆,通常这一计算需要耗费很多时间,而我们需要的只是Hessain里面所包含的曲率信息.所以拟牛顿想法就是构造出一个矩阵包含我们需要的信息

相关的拟牛顿方法有DFP, BFGS, Broyden类算法

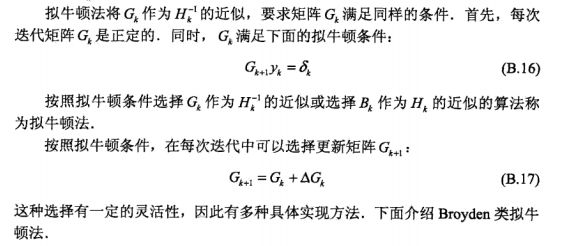

拟牛顿条件

这里我们看牛顿法中需要满足的条件

g k + H k ( x ( k + 1 ) − x ( k ) ) = g k + 1 = > H k ( x ( k + 1 ) − x ( k ) ) = g k + 1 − g k g_k + H_k (x^{(k+1)} - x^{(k)}) = g_{k+1} => H_k (x^{(k+1)} - x^{(k)}) = g_{k+1} - g_k gk+Hk(x(k+1)−x(k))=gk+1=>Hk(x(k+1)−x(k))=gk+1−gk

现在记 y k = g k + 1 − g k , δ k = x ( k + 1 ) − x ( k ) y_k = g_{k+1} - g_{k}, \delta _k = x^{(k+1)} - x^{(k)} yk=gk+1−gk,δk=x(k+1)−x(k),得到如下

y k = H k δ k y_k = H_k \delta _k yk=Hkδk 或者 H k − 1 y k = δ k H _k ^{-1} y_k = \delta _k Hk−1yk=δk

这两个式子就称为拟牛顿条件

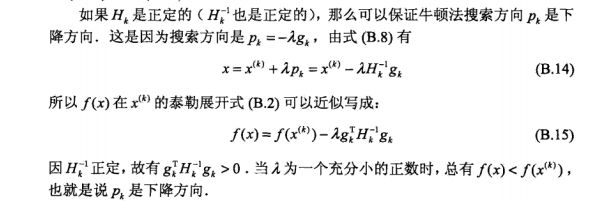

在构造的时候Hessain的逆需要时正定的,因为这样可以保证求出的p是下降方向

拟牛顿法的构造思路

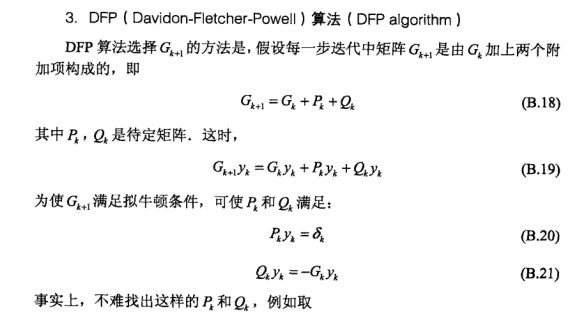

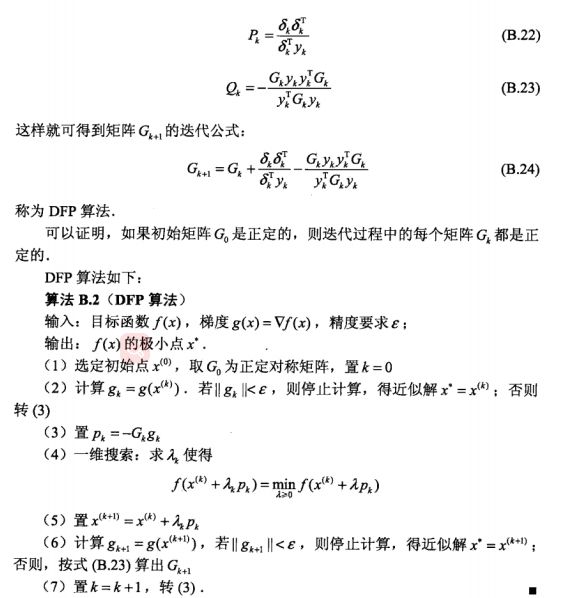

DFP

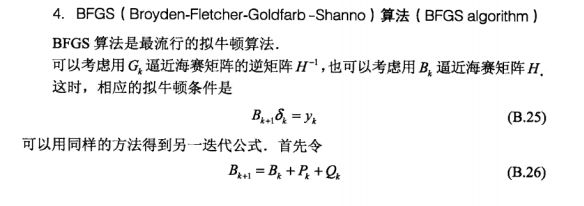

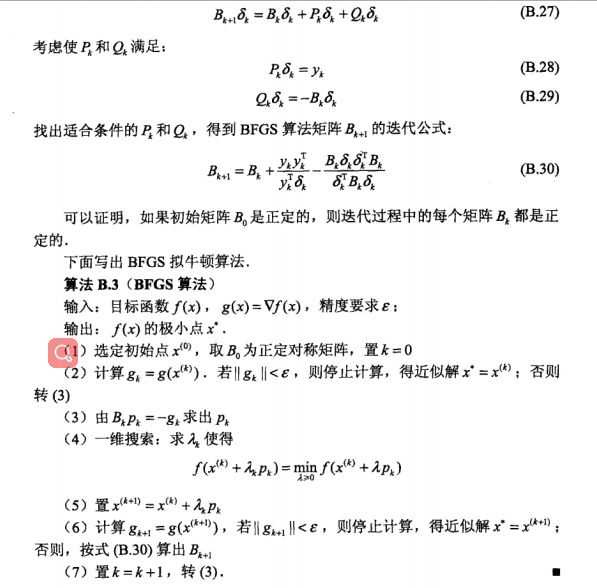

BFGS

详情看《统计学习方法》中的附录B

参考文献

- 《统计学习方法》 -李航