namenode和datanode的工作机制

namenode工作机制

1、namenode职责

(1)负责客户端请求的响应

(2)元数据的管理(查询,修改)

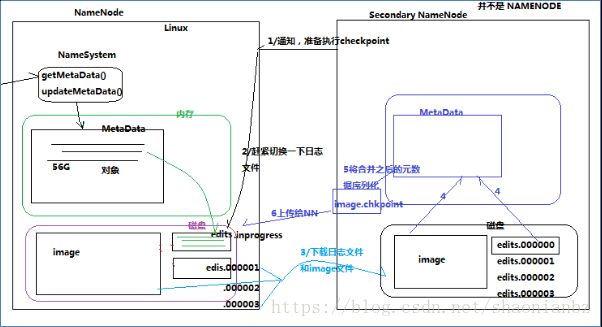

2、元数据管理

namenode对数据的管理采用了三种存储形式:

- 内存元数据(NameSystem)

- 磁盘元数据镜像文件

- 数据操作日志文件(可通过日志运算出元数据)

2.1元数据存储机制

- 内存中有一份完整的元数据(内存meta data)

- 磁盘有一个“准完整”的元数据镜像(fsimage)文件(在namenode的工作目录中)

- 用于衔接内存metadata和持久化元数据镜像fsimage之间的操作日志(edits文件)

注意:

当客户端对hdfs中的文件进行新增或者修改操作,操作记录首先被记入edits日志文件中,当客户端操作成功后,相应的元数据会更新到内存meta.data中

2.2元数据手动查看

可以通过hdfs的一个工具来查看edits中的信息

bin/hdfs oev -i edits -o edits.xml

bin/hdfs oiv -i fsimage_0000000000000000087 -p XML -o fsimage.xml2.3元数据的 checkpoint

(1)概念:

每隔一段时间,会由secondary namenode将namenode上积累的所有edits和一个最新的fsimage下载到本地,并加载到内存进行merge(这个过程称为checkpoint)

(3)checkpoint 操作的触发条件配置参数:

#检查触发条件是否满足的频率,60秒

dfs.namenode.checkpoint.check.period=60

dfs.namenode.checkpoint.dir=file://${hadoop.tmp.dir}/dfs/namesecondary

#以上两个参数做checkpoint操作时,secondary namenode的本地工作目录

dfs.namenode.checkpoint.edits.dir=${dfs.namenode.checkpoint.dir}

#最大重试次数

dfs.namenode.checkpoint.max-retries=3

#两次checkpoint之间的时间间隔3600秒

dfs.namenode.checkpoint.period=3600

#两次checkpoint之间最大的操作记录

dfs.namenode.checkpoint.txns=1000000(4)checkpoint的附带作用:

namenode和secondary namenode的工作目录存储结构完全相同,所以,当namenode故障退出需要重新恢复时,可以从secondary namenode的工作目录中将fsimage拷贝到namenode的工作目录,以恢复namenode的元数据

2.4元数据目录说明

(1)在第一次部署好Hadoop集群的时候,我们需要在NameNode(NN)节点上格式化磁盘:

$HADOOP_HOME/bin/hdfs namenode -format(2)格式化完成之后,将会在$dfs.namenode.name.dir/current目录下如下的文件结构:

current/

|-- VERSION

|-- edits_*

|-- fsimage_0000000000008547077

|-- fsimage_0000000000008547077.md5

`-- seen_txid(3)其中的dfs.name.dir是在hdfs-site.xml文件中配置的,默认值如下:

<property>

<name>dfs.name.dirname>

<value>file://${hadoop.tmp.dir}/dfs/namevalue>

property>

hadoop.tmp.dir是在core-site.xml中配置的,默认值如下

<property>

<name>hadoop.tmp.dirname>

<value>/tmp/hadoop-${user.name}value>

<description>A base for other temporary directories.description>

property>(4)dfs.namenode.name.dir属性可以配置多个目录

如/data1/dfs/name,/data2/dfs/name,/data3/dfs/name,….。各个目录存储的文件结构和内容都完全一样,相当于备份,这样做的好处是当其中一个目录损坏了,也不会影响到Hadoop的元数据,特别是当其中一个目录是NFS(网络文件系统Network File System,NFS)之上,即使你这台机器损坏了,元数据也得到保存。

(5)下面对$dfs.namenode.name.dir/current/目录下的文件进行解释

VERSION文件是Java属性文件,内容大致如下:

#Fri Nov 15 19:47:46 CST 2013

namespaceID=934548976

clusterID=CID-cdff7d73-93cd-4783-9399-0a22e6dce196

cTime=0

storageType=NAME_NODE

blockpoolID=BP-893790215-192.168.24.72-1383809616115

layoutVersion=-47其中

- namespaceID是文件系统的唯一标识符,在文件系统首次格式化之后生成的

- storageType说明这个文件存储的是什么进程的数据结构信息(如果是DataNode,storageType=DATA_NODE)

- cTime表示NameNode存储时间的创建时间,由于我的NameNode没有更新过,所以这里的记录值为0,以后对NameNode升级之后,cTime将会记录更新时间戳

- layoutVersion表示HDFS永久性数据结构的版本信息, 只要数据结构变更,版本号也要递减,此时的HDFS也需要升级,否则磁盘仍旧是使用旧版本的数据结构,这会导致新版本的NameNode无法使用

clusterID是系统生成或手动指定的集群ID,在-clusterid选项中可以使用它;如下说明

- 使用如下命令格式化一个Namenode

$HADOOP_HOME/bin/hdfs namenode -format [-clusterId ]

选择一个唯一的cluster_id,并且这个cluster_id不能与环境中其他集群有冲突。如果没有提供cluster_id,则会自动生成一个唯一的ClusterID - 使用如下命令格式化其他Namenode

$HADOOP_HOME/bin/hdfs namenode -format -clusterId - 升级集群至最新版本。在升级过程中需要提供一个ClusterID,例如:

$HADOOP_PREFIX_HOME/bin/hdfs start namenode –config $HADOOP_CONF_DIR -upgrade -clusterId

如果没有提供ClusterID,则会自动生成一个ClusterID

- 使用如下命令格式化一个Namenode

blockpoolID:是针对每一个Namespace所对应的blockpool的ID,上面的这个BP-893790215-192.168.24.72-1383809616115就是在我的ns1的namespace下的存储块池的ID,这个ID包括了其对应的NameNode节点的ip地址

(6)$dfs.namenode.name.dir/current/seen_txid非常重要,是存放transactionId的文件,format之后是0,它代表的是namenode里面的edits_*文件的尾数,namenode重启的时候,会按照seen_txid的数字,循序从头跑edits_0000001~到seen_txid的数字。所以当你的hdfs发生异常重启的时候,一定要比对seen_txid内的数字是不是你edits最后的尾数,不然会发生建置namenode时metaData的资料有缺少,导致误删Datanode上多余Block的资讯

(7)$dfs.namenode.name.dir/current目录下在format的同时也会生成fsimage和edits文件,及其对应的md5校验文件

补充:seen_txid

文件中记录的是edits滚动的序号,每次重启namenode时,namenode就知道要将哪些edits进行加载edits

datanode工作机制

1、概述

datanode工作职责

- 存储管理用户的文件块数据

- 定期向namenode汇报自身所持有的block信息(通过心跳信息上报)(这点很重要,因为,当集群中发生某些block副本失效时,集群如何恢复block初始副本数量的问题)

<property>

<name>dfs.blockreport.intervalMsecname>

<value>3600000value>

<description>Determines block reporting interval in milliseconds.description>

property>datanode掉线判断时限参数

datanode进程死亡或者网络故障造成datanode无法与namenode通信,namenode不会立即把该节点判定为死亡,要经过一段时间,这段时间暂称作超时时长。HDFS默认的超时时长为10分钟+30秒。如果定义超时时间为timeout,则超时时长的计算公式为:

timeout = 2 * heartbeat.recheck.interval + 10 * dfs.heartbeat.interval。

而默认的heartbeat.recheck.interval 大小为5分钟,dfs.heartbeat.interval默认为3秒。

需要注意的是hdfs-site.xml 配置文件中的heartbeat.recheck.interval的单位为毫秒,dfs.heartbeat.interval的单位为秒。所以,举个例子,如果heartbeat.recheck.interval设置为5000(毫秒),dfs.heartbeat.interval设置为3(秒,默认),则总的超时时间为40秒。

<property>

<name>heartbeat.recheck.intervalname>

<value>2000value>

property>

<property>

<name>dfs.heartbeat.intervalname>

<value>1value>

property>2、观察验证datanode功能

(1)上传一个文件,观察文件的block具体的物理存放情况:

(2)在每一台datanode机器上的这个目录中能找到文件的切块:

/home/hadoop/app/hadoop-2.4.1/tmp/dfs/data/current/BP-193442119-192.168.2.120-1432457733977/current/finalized