1 关于Hive

Hive是基于Hadoop的一个数据仓库工具,可以将结构化的数据文件映射为一张数据库表,并提供完整的sql查询功能,可以将sql语句转换为MapReduce任务进行运行。Hive提供了一系列的工具,可以用来进行数据提取转化加载(ETL),这是一种可以存储、查询和分析存储在 Hadoop 中的大规模数据的机制。Hive 定义了简单的类 SQL 查询语言,称为 HQL,它允许熟悉 SQL 的用户查询数据。同时,这个语言也允许熟悉MapReduce的开发者开发自定义的mapper和reducer 来处理内建的mapper和reducer无法完成的复杂的分析工作。

Hive和关系型数据库的区别

可用下表进行概括:

Hive |

RDBMS |

|

查询语言 |

HQL |

SQL |

数据存储 |

HDFS |

Raw Device or Local FS |

索引 |

无 |

有 |

执行 |

MapReduce |

Excutor |

执行延迟 |

高 |

低 |

处理数据规模 |

大 |

小 |

注解:

1. 查询语言。由于 SQL 被广泛的应用在数据仓库中,因此,专门针对 Hive 的特性设计了类 SQL 的查询语言 HQL。熟悉 SQL 开发的开发者可以很方便的使用 Hive 进行开发。

2. 数据存储位置。Hive 是建立在Hadoop 之上的,所有 Hive 的数据都是存储在HDFS 中的。而数据库则可以将数据保存在块设备或者本地文件系统中。

3. 数据格式。Hive 中没有定义专门的数据格式,数据格式可以由用户指定,用户定义数据格式需要指定三个属性:列分隔符(通常为空格、”\t”、”\x001″)、行分隔符(”\n”)以及读取文件数据的方法(Hive 中默认有三个文件格式 TextFile,SequenceFile 以及 RCFile)。由于在加载数据的过程中,不需要从用户数据格式到 Hive 定义的数据格式的转换,因此,Hive 在加载的过程中不会对数据本身进行任何修改,而只是将数据内容复制或者移动到相应的 HDFS 目录中。而在数据库中,不同的数据库有不同的存储引擎,定义了自己的数据格式。所有数据都会按照一定的组织存储,因此,数据库加载数据的过程会比较耗时。

4. 数据更新。由于 Hive 是针对数据仓库应用设计的,而数据仓库的内容是读多写少的。因此,Hive 中不支持对数据的改写和添加,所有的数据都是在加载的时候中确定好的。而数据库中的数据通常是需要经常进行修改的,因此可以使用 INSERT INTO ... VALUES 添加数据,使用 UPDATE... SET 修改数据。

5. 索引。之前已经说过,Hive 在加载数据的过程中不会对数据进行任何处理,甚至不会对数据进行扫描,因此也没有对数据中的某些 Key 建立索引。Hive 要访问数据中满足条件的特定值时,需要暴力扫描整个数据,因此访问延迟较高。由于 MapReduce 的引入, Hive 可以并行访问数据,因此即使没有索引,对于大数据量的访问,Hive 仍然可以体现出优势。数据库中,通常会针对一个或者几个列建立索引,因此对于少量的特定条件的数据的访问,数据库可以有很高的效率,较低的延迟。由于数据的访问延迟较高,决定了 Hive 不适合在线数据查询。

6. 执行。Hive 中大多数查询的执行是通过 Hadoop 提供的 MapReduce 来实现的(类似 select * from tbl 的查询不需要 MapReduce)。而数据库通常有自己的执行引擎。

7. 执行延迟。之前提到,Hive 在查询数据的时候,由于没有索引,需要扫描整个表,因此延迟较高。另外一个导致 Hive 执行延迟高的因素是 MapReduce 框架。由于 MapReduce 本身具有较高的延迟,因此在利用 MapReduce 执行 Hive 查询时,也会有较高的延迟。相对的,数据库的执行延迟较低。当然,这个低是有条件的,即数据规模较小,当数据规模大到超过数据库的处理能力的时候,Hive 的并行计算显然能体现出优势。

8. 可扩展性。由于 Hive 是建立在 Hadoop 之上的,因此 Hive 的可扩展性是和 Hadoop 的可扩展性是一致的(世界上最大的 Hadoop 集群在 Yahoo!,2009年的规模在4000 台节点左右)。而数据库由于 ACID 语义的严格限制,扩展行非常有限。目前最先进的并行数据库 Oracle 在理论上的扩展能力也只有 100 台左右。

9. 数据规模。由于 Hive 建立在集群上并可以利用 MapReduce 进行并行计算,因此可以支持很大规模的数据;对应的,数据库可以支持的数据规模较小。

2 设计架构

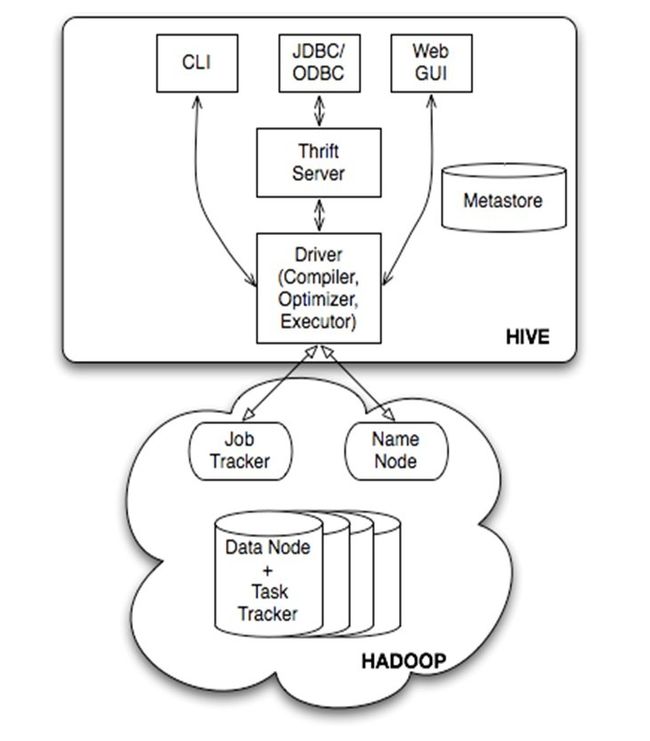

Hive是基于Hadoop和MapReduce的,架构示意图如下,

2.1 架构组成

Hive架构包括如下组件:CLI(command line interface)、JDBC/ODBC、Thrift Server、WEB GUI、metastore和Driver(Complier、Optimizer和Executor)。这些组件大致可以分为两类:服务端组件、客户端组件。

2.1.1 服务端组件

Driver组件:该组件包括Complier、Optimizer和Executor,它的作用是将我们写的HiveQL(类SQL)语句进行解析、编译优化,生成执行计划,然后调用底层的mapreduce计算框架。

Metastore组件:元数据服务组件,这个组件存储hive的元数据,hive的元数据存储在关系数据库里,hive支持的关系数据库有derby、mysql。元数据对于hive十分重要,因此hive支持把metastore服务独立出来,安装到远程的服务器集群里,从而解耦hive服务和metastore服务,保证hive运行的健壮性,这个方面的知识,我会在后面的metastore小节里做详细的讲解。

Thrift服务:thrift是facebook开发的一个软件框架,它用来进行可扩展且跨语言的服务的开发,hive集成了该服务,能让不同的编程语言调用hive的接口。

2.1.2 客户端组件

CLI:command line interface,命令行接口。

Thrift客户端:上面的架构图里没有写上Thrift客户端,但是hive架构的许多客户端接口是建立在thrift客户端之上,包括JDBC和ODBC接口。

WEBGUI:hive客户端提供了一种通过网页的方式访问hive所提供的服务。这个接口对应hive的hwi组件(hive web interface),使用前要启动hwi服务。

2.2 metastore组件

Hive的metastore组件是hive元数据集中存放地。Metastore组件包括两个部分:metastore服务和后台数据的存储。后台数据存储的介质就是关系数据库,例如hive默认的嵌入式磁盘数据库derby,还有mysql数据库。Metastore服务是建立在后台数据存储介质之上,并且可以和hive服务进行交互的服务组件,默认情况下,metastore服务和hive服务是安装在一起的,运行在同一个进程当中。我也可以把metastore服务从hive服务里剥离出来,metastore独立安装在一个集群里,hive远程调用metastore服务,这样我们可以把元数据这一层放到防火墙之后,客户端访问hive服务,就可以连接到元数据这一层,从而提供了更好的管理性和安全保障。使用远程的metastore服务,可以让metastore服务和hive服务运行在不同的进程里,这样也保证了hive的稳定性,提升了hive服务的效率。

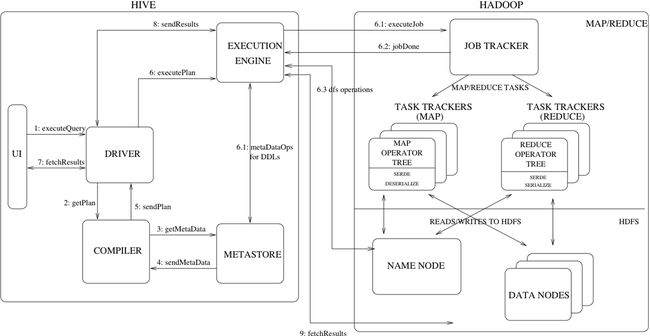

以下为Hive的执行流程图:

3 安装和配置(以MySQL为元数据库)

Hive将元数据存储在RDBMS 中,一般常用的有MYSQL和DERBY,我们这里选用MySQL,并采用Hadoop系列博文所搭建的Hadoop集群。Hive原则上可以安装在集群上的任何一台机器上面,此处安装在namenode(楼主的NameNode为虚拟机集群的主机,性能最佳)上。

3.1 下载安装

从官网下载Hive的稳定版本hive-0.11.0-tar.gz(截止到博文发表之前),解压到/usr目录下,并重命名为hive

tar zxvf hive-0.11.0-tar.gz ;mv hive-0.11.0/ /usr/hive

3.2 设置好环境变量

编辑/etc/profile,加入以下内容:

# set hive path

export HIVE_HOME=/usr/hive

export PATH=$PATH:$HIVE_HOME/bin

使生效:source /etc/profile

3.3 配置MySQL存储metadata

3.3.1 安装、配置好MySQL服务

此处采用CentOS自带的MySQL服务。若是采用自行编译的版本,需要注意修改配置文件,允许远程登录。

3.3.2 创建hive数据库

登录MySQL,创建database: hive:

mysql -u root -pmykey

mysql> create database hive;

3.3.3 修改hive配置文件hive-site.xml

默认这个文件是不存在的,进入hive安装路径,在conf目录下,拷贝hive-default.xml.template得到hive-site.xml文件

cp hive-default.xml.template hive-site.xml

修改以下属性:

注解:

1. 新手修改这四个属性即可。

2. javax.jdo.option.ConnectionURL表示使用的metastore是mysql,该mysql服务搭建在192.168.56.1这个节点上,存储元数据的数据库为hive。

3. javax.jdo.option.ConnectionDriverName:hive中用java来开发与mysql进行交互时,需要用到一个关于mysql的connector,即MySQL的JDBC元数据驱动包。

4. javax.jdo.option.ConnectionUserName:用来设置hive存放的元数据的数据库(这里是mysql数据库)的用户名称

5. javax.jdo.option.ConnectionPassword:用户登录数据库的时候需要输入的密码,可自行修改

3.3.4 复制MySQL的JDBC驱动包到Hive的lib目录下

这里下载的版本是:mysql-connector-java-5.0.8-bin.jar

3.3.5 创建hive用户并赋予权限

mysql -u root -p

mysql> create user [email protected] identified by 'hive';

mysql> grant all privileges on *.* to [email protected] with grant option;

mysql> flush privileges;

执行上述语句后就可以用hive用户登录来检验用户是否添加成功

mysql -u hive -h 192.168.56.1 -p

password:****(hive)

3.4 启动运行

重启MySQL:service mysqld restart

启动hive:

[root@rango conf]# hive

Logging initialized using configuration in jar:file:/usr/hive/lib/hive-common-0.11.0.jar!/hive-log4j.properties

Hive history file=/tmp/root/[email protected]_201403181121_225607025.txt

hive> show tables;

OK

Time taken: 3.755 seconds

hive>

3.5 验证hive

1. 在hive上建立数据表

hive> create table test (id int, name string);

OK

Time taken: 0.88 seconds

2. 登录MySQL查看metadata信息

mysql>use hive;

mysql>show tables;

+---------------------------+

| Tables_in_hive |

+---------------------------+

| BUCKETING_COLS |

| CDS |

| COLUMNS_V2 |

| DATABASE_PARAMS |

| DBS |

| PARTITION_KEYS |

| SDS |

| SD_PARAMS |

| SEQUENCE_TABLE |

| SERDES |

| SERDE_PARAMS |

| SKEWED_COL_NAMES |

| SKEWED_COL_VALUE_LOC_MAP |

| SKEWED_STRING_LIST |

| SKEWED_STRING_LIST_VALUES |

| SKEWED_VALUES |

| SORT_COLS |

| TABLE_PARAMS |

| TBLS |

+---------------------------+

19 rows in set (0.00 sec)

配置完成。

3.6 问题总结

1. hive> show tables;

出现了下面的问题:

FAILED: Error in metadata: java.lang.RuntimeException: Unable to instantiate org.apache.hadoop.hive.metastore.HiveMetaStoreClientFAILED: Execution Error, return code 1 from org.apache.hadoop.hive.ql.exec.DDLTask

一般是mysql用户的权限不够,具体原因可通过以下模式来查看:

hive -hiveconf hive.root.logger=DEBUG,console

2. 启动hive出现log4j:ERROR Could not connect to remote log4j server at [localhost]. We will try again later.

Log4j是Apache的一个开放源代码项目,通过使用Log4j,我们可以控制日志信息输送的目的地是控制台、文件、GUI组件,甚至是套接口服务器、NT的事件记录器、UNIX Syslog守护进程等。此处是因为没有先启动Hadoop和HBase,导致没法连接到log4j日志服务器,不影响正常使用。

4 总结

Hive是基于Hadoop和HDFS的数据仓库工具,同时Hive也可以和HBase集成,HBase可以进行快速查询,但是HBase不支持类SQL的语句,那么此时Hive可以给HBase提供sql语法解析的外壳,可以用类sql语句操作HBase数据库。

——Rango Chen