吴恩达深度学习笔记(55)-Softmax 回归(Softmax regression)

Softmax 回归(Softmax regression)

到目前为止,我们讲到过的分类的例子都使用了二分分类,这种分类只有两种可能的标记0或1,这是一只猫或者不是一只猫,如果我们有多种可能的类型的话呢?

有一种logistic回归的一般形式,叫做Softmax回归,能让你在试图识别某一分类时做出预测,或者说是多种分类中的一个,不只是识别两个分类,我们来一起看一下。

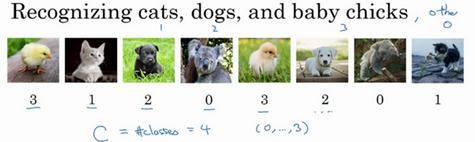

假设你不单需要识别猫,而是想识别猫,狗和小鸡,我把猫加做类1,狗为类2,小鸡是类3,如果不属于以上任何一类,就分到“其它”或者说“以上均不符合”这一类,我把它叫做类0。这里显示的图片及其对应的分类就是一个例子,这幅图片上是一只小鸡,所以是类3,猫是类1,狗是类2,我猜这是一只考拉,所以以上均不符合,那就是类0,下一个类3,以此类推。

我们将会用符号表示,我会用大写的C来表示你的输入会被分入的类别总个数,在这个例子中,我们有4种可能的类别,包括“其它”或“以上均不符合”这一类。当有4个分类时,指示类别的数字,就是从0到C-1,换句话说就是0、1、2、3。

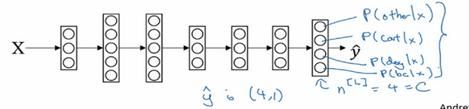

在这个例子中,我们建立一个神经网络,其输出层有4个,在这个例子中,我们将建立一个神经网络,其输出层有4个,或者说C个输出单元,因此n,即输出层也就是L层的单元数量,等于4,或者一般而言等于C。

我们想要输出层单元的数字告诉我们这4种类型中每个的概率有多大,所以这里的第一个节点(最后输出的第1个方格+圆圈)输出的应该是或者说我们希望它输出“其它”类的概率。在输入X的情况下,这个(最后输出的第2个方格+圆圈)会输出猫的概率。在输入X的情况下,这个会输出狗的概率(最后输出的第3个方格+圆圈)。在输入X的情况下,输出小鸡的概率(最后输出的第3个方格+圆圈),我把小鸡缩写为bc(baby chick)。因此这里的^y将是一个4×1维向量,因为它必须输出四个数字,给你这四种概率,因为它们加起来应该等于1,输出中的四个数字加起来应该等于1。

让你的网络做到这一点的标准模型要用到Softmax层,以及输出层来生成输出,让我把式子写下来,然后回过头来,就会对Softmax的作用有一点感觉了。

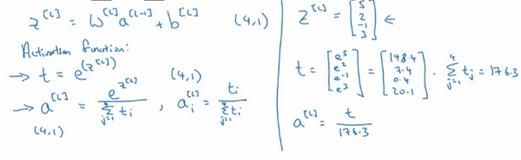

在神经网络的最后一层,你将会像往常一样计算各层的线性部分,z^([l])这是最后一层的z变量,记住这是大写L层,和往常一样,

计算方法是z([l])=W([l]) a([L-1])+b([l])

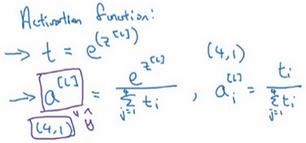

算出了z之后,你需要应用Softmax激活函数,这个激活函数对于Softmax层而言有些不同,它的作用是这样的。

首先,我们要计算一个临时变量,我们把它叫做t,它等于e(z([l]) ),这适用于每个元素,而这里的z([l]),在我们的例子中,z([l])是4×1的,四维向量t=e(z([l]) ),这是对所有元素求幂,t也是一个4×1维向量,然后输出的a^([l]),基本上就是向量t,但是会归一化,使和为1。

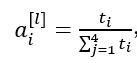

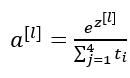

因此

换句话说,a^([l])也是一个4×1维向量,而这个四维向量的第i个元素,我把它写下来,

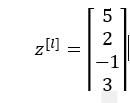

我们来看一个例子,详细解释,假设你算出了z([l]),z([l])是一个四维向量,假设为

我们要做的就是用这个元素取幂方法来计算t,所以

如果你按一下计算器就会得到以下值

我们从向量t得到向量a^([l])就只需要将这些项目归一化,使总和为1。

如果你把t的元素都加起来,把这四个数字加起来,得到176.3,最终

例如这里的第一个节点,它会输出e^5/176.3=0.842,这样说来,对于这张图片,如果这是你得到的z值(

![]()

)]),它是类0的概率就是84.2%。下一个节点输出e2/176.3=0.042,也就是4.2%的几率。下一个是e(-1)/176.3=0.002。最后一个是e^3/176.3=0.114,也就是11.4%的概率属于类3,也就是小鸡组,对吧?这就是它属于类0,类1,类2,类3的可能性。

神经网络的输出a([l]),也就是y,是一个4×1维向量,这个4×1向量的元素就是我们算出来的这四个数字([

4)]),所以这种算法通过向量z^([l])计算出总和为1的四个概率。

整个计算过程,从计算幂到得出临时变量t,再归一化,我们可以将此概括为一个Softmax激活函数。

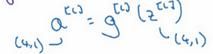

设a([l])=g([l]) (z^([l])),这一激活函数的与众不同之处在于,这个激活函数g 需要输入一个4×1维向量,然后输出一个4×1维向量。

之前,我们的激活函数都是接受单行数值输入,例如Sigmoid和ReLu激活函数,输入一个实数,输出一个实数。Softmax激活函数的特殊之处在于,因为需要将所有可能的输出归一化,就需要输入一个向量,最后输出一个向量。

那么Softmax分类器还可以代表其它的什么东西么?

我来举几个例子,你有两个输入x_1,x_2,它们直接输入到Softmax层,它有三四个或者更多的输出节点,输出y,我将向你展示一个没有隐藏层的神经网络,它所做的就是计算z([1])=W^([1]) x+b([1]),而输出的出a([l]),或者说y,a([l])=y=g(z([1])),就是z([1])的Softmax激活函数,这个没有隐藏层的神经网络应该能让你对Softmax函数能够代表的东西有所了解。

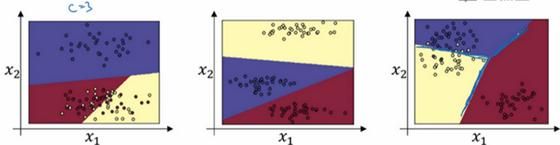

这个例子中(左边图),原始输入只有x_1和x_2,一个C=3个输出分类的Softmax层能够代表这种类型的决策边界,请注意这是几条线性决策边界,但这使得它能够将数据分到3个类别中,在这张图表中,我们所做的是选择这张图中显示的训练集,用数据的3种输出标签来训练Softmax分类器,图中的颜色显示了Softmax分类器的输出的阈值,输入的着色是基于三种输出中概率最高的那种。因此我们可以看到这是logistic回归的一般形式,有类似线性的决策边界,但有超过两个分类,分类不只有0和1,而是可以是0,1或2。

这是(中间图)另一个Softmax分类器可以代表的决策边界的例子,用有三个分类的数据集来训练,这里(右边图)还有一个。对吧,但是直觉告诉我们,任何两个分类之间的决策边界都是线性的,这就是为什么你看到,比如这里黄色和红色分类之间的决策边界是线性边界,紫色和红色之间的也是线性边界,紫色和黄色之间的也是线性决策边界,但它能用这些不同的线性函数来把空间分成三类。

我们来看一下更多分类的例子,这个例子中(左边图)C=4,因此这个绿色分类和Softmax仍旧可以代表多种分类之间的这些类型的线性决策边界。另一个例子(中间图)是C=5类,最后一个例子(右边图)是C=6,这显示了Softmax分类器在没有隐藏层的情况下能够做到的事情,当然更深的神经网络会有x,然后是一些隐藏单元,以及更多隐藏单元等等,你就可以学习更复杂的非线性决策边界,来区分多种不同分类。

我希望你了解了神经网络中的Softmax层或者Softmax激活函数有什么作用,下一个笔记中,我们来看一下你该怎样训练一个使用Softmax层的神经网络。