对Hadoop认识与安装

对Hadoop认识与安装

1.简介

• Hadoop是Apache软件基金会旗下的一个开源分布式计算平台,为用户提供了系统 底层细节透明的分布式基础架构

•Hadoop是基于Java语言开发的,具有很好的跨平台特性,并且可以部署在廉价的计 算机集群中

•Hadoop的核心是分布式文件系统HDFS(Hadoop Distributed File System)和 MapReduce

•Hadoop被公认为行业大数据标准开源软件,在分布式环境下提供了海量数据的处理能力

•几乎所有主流厂商都围绕Hadoop提供开发工具、开源软件、商业化工具和技术服务,

如谷歌、雅虎、微软、思科、淘宝等,都支持Hadoop。

2.发展简史

• Hadoop最初是由Apache Lucene项目的创始人Doug Cutting开发的文 本搜索库。Hadoop源自始于2002年的Apache Nutch项目——一个开源 的网络搜索引擎并且也是Lucene项目的一部分

• 在2004年,Nutch项目也模仿GFS开发了自己的分布式文件系统 NDFS(Nutch Distributed File System),也就是HDFS的前身

• 2004年,谷歌公司又发表了另一篇具有深远影响的论文,阐述了 MapReduce分布式编程思想

• 2005年,Nutch开源实现了谷歌的MapReduce

•到了2006年2月,Nutch中的NDFS和MapReduce开始独立出来,成为Lucene项目的一个子项目,称为Hadoop,同时,Doug Cutting加盟 雅虎

• 2008年1月,Hadoop正式成为Apache顶级项目,Hadoop也逐渐开始被雅虎之外的其他公司使用

• 2008年4月,Hadoop打破世界纪录,成为最快排序1TB数据的系统,

它采用一个由910个节点构成的集群进行运算,排序时间只用了209秒

•在2009年5月,Hadoop更是把1TB数据排序时间缩短到62秒。

Hadoop从此名声大震,迅速发展成为大数据时代最具影响力的开源分布式开发平台,并成为事实上的大数据处理标准。

3.特性

Hadoop是一个能够对大量数据进行分布式处理的软件框架,并且 是以一种可靠、高效、可伸缩的方式进行处理的,它具有以下几个方 面的特性:

• 高可靠性

• 高效性

• 高可扩展性

• 高容错性

• 成本低

• 运行在Linux平台上

• 支持多种编程语言

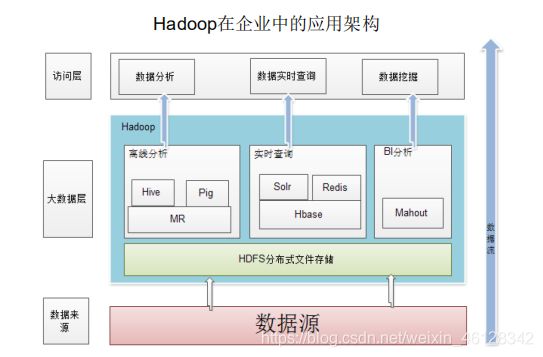

4.应用现状

• Hadoop凭借其突出的优势,已经在各个领域得到了广泛的应用,而 互联网领域是其应用的主阵地

• 2007年,雅虎在Sunnyvale总部建立了M45——一个包含了4000个处 理器和1.5PB容量的Hadoop集群系统

• Facebook作为全球知名的社交网站,Hadoop是非常理想的选择,

Facebook主要将Hadoop平台用于日志处理、推荐系统和数据仓库等 方面

• 国内采用Hadoop的公司主要有百度、淘宝、网易、华为、中国移动等,其中,淘宝的Hadoop集群比较大

5.版本演变

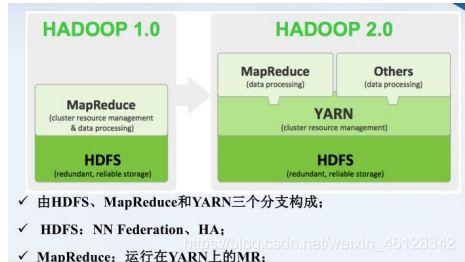

•Apache Hadoop版本分为两代,我们将第一代Hadoop称为Hadoop 1.0,第二代Hadoop称为Hadoop 2.0

•第一代Hadoop包含三个大版本,分别是0.20.x,0.21.x和0.22.x,其 中,0.20.x最后演化成1.0.x,变成了稳定版,而0.21.x和0.22.x则增加 了NameNode HA等新的重大特性

•第二代Hadoop包含两个版本,分别是0.23.x和2.x,它们完全不同于 Hadoop 1.0,是一套全新的架构,均包含HDFS Federation和YARN两 个系统,相比于0.23.x,2.x增加了NameNode HA和Wire-compatibility 两个重大特性

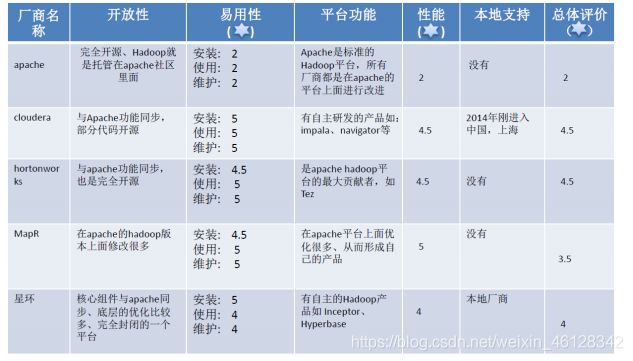

Hadoop的各种版本:

• Apache Hadoop

• Hortonworks

• Cloudera(CDH:Cloudera Distribution Hadoop)

• MapR

• ……

选择 Hadoop版本的考虑因素:

•是否开源(即是否免费)

•是否有稳定版

•是否经实践检验

6.项目结构

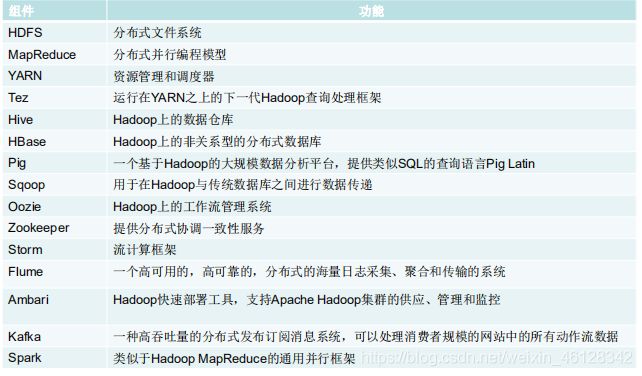

Hadoop的项目结构不断丰富发展,已经形成一个丰富的Hadoop生态系统

7.安装与使用

(1)Linux的选择:建议使用CentOS 或Ubuntu

(2)32位还是64位?

•如果电脑比较老或者内存小于2G,那么建议选择32位系统版本的Linux

•如果内存大于4G,那么建议选择64位系统版本的Linux

(3)虚拟机安装还是双系统安装?

•建议电脑比较新或者配置内存4G以上的电脑可以选择虚拟机安装

•电脑较旧或配置内存小于等于4G的电脑强烈建议选择双系统安装,否则,在配置较低的计算机上运行LInux虚拟机,系统运行速度会非常慢

(4)安装方式

•单机模式:Hadoop 默认模式为非分布式模式(本地模式),无需进行其他配置即可运行。非分布式即单 Java 进程,方便进行调试

•伪分布式模式:Hadoop 可以在单节点上以伪分布式的方式运行,Hadoop 进程以分离的 Java 进程来运行,节点既作为 NameNode 也作为 DataNode,同时,读取的是

HDFS 中的文件

•分布式模式:使用多个节点构成集群环境来运行Hadoop

(4)安装Linux虚拟机

若还没安装虚拟机可参考:VMVMware14虚拟机安装程

安装Ubuntu的可参考:Ubuntu的安装教程

安装CentOS的可参考:CentOS的安装教程

(5)Hadoop的安装与使用(单机/伪分布式)

Hadoop基本安装配置主要包括以下几个步骤:

• 创建Hadoop用户

• SSH登录权限设置

• 安装Java环境

• 单机安装配置

• 伪分布式安装配

创建hadoop用户

如果安装 Ubuntu 的时候不是用的 “hadoop” 用户,那么需要增加一个名为 hadoop 的用户

sudo useradd -m hadoop -s /bin/bash // 创建hadoop 的用户

sudo passwd hadoop //设置密码,可简单设置为hadoop

sudo adduser hadoop sudo //为 hadoop 用户增加管理员权限

更新apt

sudo apt-get update //更新apt

sudo apt-get install vim //安装vim编辑器

安装SSH、配置SSH无密码登陆

sudo apt-get install openssh-server //安装 SSH server

ssh localhost //登陆本机

SSH首次登陆时会有提示,先是输入 yes 。然后按提示输入密码 hadoop,这样就登陆到本机了。 但这样登陆是需要每次输入密码的,我们需要配置成SSH无密码登陆比较方便。 首先退出刚才的

ssh,就回到了我们原先的终端窗口,然后利用 ssh-keygen 生成密钥,并将密钥加入到授权中:

exit # 退出刚才的 ssh localhost

cd ~/.ssh/ # 若没有该目录,请先执行一次ssh localhost

ssh-keygen -t rsa # 会有提示,都按回车就可以

cat ./id_rsa.pub >> ./authorized_keys # 加入授权

~的含义 在 Linux 系统中,~ 代表的是用户的主文件夹,即 “/home/用户名” 这个目录,如你的用户名为 hadoop,则 ~

就代表 “/home/hadoop/”。

此时再用 ssh localhost 命令,无需输入密码就可以直接登陆了

安装Java环境

sudo apt-get install default-jre default-jdk //确保联网状态下进行jdk安装

vim ~/.bashrc //配置环境变量

在文件最前面添加如下单独一行(注意,等号“=”前后不能有空格),然后保存退出:

export JAVA_HOME=/usr/lib/jvm/default-java

执行上述命令后,可以检验一下是否设置正确:

source ~/.bashrc # 使变量设置生效

echo $JAVA_HOME # 检验变量值

java -version

$JAVA_HOME/bin/java -version # 与直接执行java -version一样

安装 Hadoop 2

Hadoop 2 可以通过 http://mirror.bit.edu.cn/apache/hadoop/common/ 或者 http://mirrors.cnnic.cn/apache/hadoop/common/ 下载,一般选择下载最新的稳定版本,即下载 “stable” 下的 hadoop-2.x.y.tar.gz 这个格式的文件,这是编译好的,另一个包含 src 的则是 Hadoop 源代码,需要进行编译才可使用。

如果是使用虚拟机方式安装Ubuntu系统的用户,请用虚拟机中的Ubuntu自带firefox浏览器访问本指南,再点击下面的地址,才能把hadoop文件下载虚拟机ubuntu中。

将 Hadoop 安装至 /usr/local/ 中:

sudo tar -zxf ~/下载/hadoop-2.7.7.tar.gz -C /usr/local # 解压到/usr/local中

cd /usr/local/

sudo mv ./hadoop-2.7.7/ ./hadoop # 将文件夹名改为hadoop

sudo chown -R hadoop ./hadoop # 修改文件权限

Hadoop 解压后即可使用。输入如下命令来检查 Hadoop 是否可用,成功则会显示 Hadoop 版本信息:

cd /usr/local/hadoop

./bin/hadoop version

Hadoop单机配置(非分布式)

Hadoop 默认模式为非分布式模式(本地模式),无需进行其他配置即可运行。非分布式即单 Java 进程,方便进行调试。

现在我们可以执行例子来感受下 Hadoop 的运行。Hadoop 附带了丰富的例子(运行 ./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-2.7.7.jar 可以看到所有例子),包括 wordcount、terasort、join、grep 等。

在此我们选择运行 grep 例子,我们将 input 文件夹中的所有文件作为输入,筛选当中符合正则表达式 dfs[a-z.]+ 的单词并统计出现的次数,最后输出结果到 output 文件夹中。

cd /usr/local/hadoop

mkdir ./input

cp ./etc/hadoop/*.xml ./input # 将配置文件作为输入文件

./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jar grep ./input ./output 'dfs[a-z.]+'

cat ./output/* # 查看运行结果

rm -r ./output //Hadoop 默认不会覆盖结果文件,因此再次运行上面实例会提示出错,需要先将 ./output 删除。

Hadoop伪分布式配置

Hadoop 可以在单节点上以伪分布式的方式运行,Hadoop 进程以分离的 Java 进程来运行,节点既作为 NameNode 也作为 DataNode,同时,读取的是 HDFS 中的文件。

Hadoop 的配置文件位于 /usr/local/hadoop/etc/hadoop/ 中,伪分布式需要修改2个配置文件 core-site.xml 和 hdfs-site.xml 。Hadoop的配置文件是 xml 格式,每个配置以声明 property 的 name 和 value 的方式来实现。

修改配置文件 core-site.xml

hadoop.tmp.dir</name>

file:/usr/local/hadoop/tmp</value>

Abase for other temporary directories.</description>

</property>

fs.defaultFS</name>

hdfs://localhost:9000</value>

</property>

</configuration>

•hadoop.tmp.dir表示存放临时数据的目录,即包括NameNode的数据,也包括 DataNode的数据。该路径任意指定,只要实际存在该文件夹即可

•name为fs.defaultFS的值,表示hdfs路径的逻辑名称

修改配置文件 hdfs-site.xml:

configuration>

dfs.replication</name>

1</value>

</property>

dfs.namenode.name.dir</name>

file:/usr/local/hadoop/tmp/dfs/name</value>

</property>

dfs.datanode.data.dir</name>

file:/usr/local/hadoop/tmp/dfs/data</value>

</property>

</configuration>

•dfs.replication表示副本的数量,伪分布式要设置为1

•dfs.namenode.name.dir表示本地磁盘目录,是存储fsimage文件的地方

•dfs.datanode.data.dir表示本地磁盘目录,HDFS数据存放block的地方Hadoop 的运行方式是由配置文件决定的(运行 Hadoop 时会读取配置文件),因此如果需要从伪分布式模式切换回非分布式模式,需要删除 core-site.xml 中的配置项。

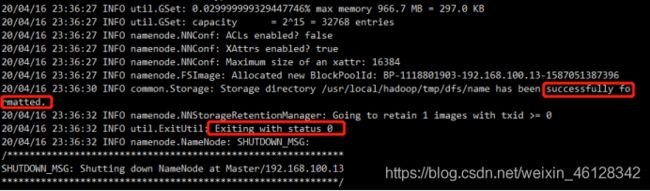

配置完成后,执行 NameNode 的格式化:

cd /usr/local/hadoop

./bin/hdfs namenode -format //只需格式化一次,后续无需再格式化,以免出错

成功的话,会看到 “successfully formatted” 和 “Exitting with status 0” 的提示,若为 “Exitting with status 1” 则是出错

接着开启 NameNode 和 DataNode 守护进程。

cd /usr/local/hadoop

./sbin/start-dfs.sh #start-dfs.sh是个完整的可执行文件,中间没有空格

若出现如下SSH提示,输入yes即可。

启动 Hadoop 时若提示 Could not resolve hostname

这个并不是 ssh 的问题,可通过设置 Hadoop 环境变量来解决:

vi ~/.bashrc //增加如下两行内容(设置过程与 JAVA_HOME 变量一样,其中 HADOOP_HOME 为 Hadoop 的安装目录):

export HADOOP_HOME=/usr/local/hadoop

export HADOOP_COMMON_LIB_NATIVE_DIR=$HADOOP_HOME/lib/native

保存后,务必执行 source ~/.bashrc 使变量设置生效,然后再次执行 ./sbin/start-dfs.sh 启动 Hadoop。

启动完成后,可以通过命令 jps 来判断是否成功启动,若成功启动则会列出如下进程: “NameNode”、”DataNode” 和 “SecondaryNameNode”(如果 SecondaryNameNode 没有启动,请运行 sbin/stop-dfs.sh 关闭进程,然后再次尝试启动尝试)。如果没有 NameNode 或 DataNode ,那就是配置不成功,请仔细检查之前步骤,或通过查看启动日志排查原因。

关于三种Shell命令方式的区别:

- hadoop fs

- hadoop dfs

- hdfs dfs

•hadoop fs适用于任何不同的文件系统,比如本地文件系统和HDFS文件系统

•hadoop dfs只能适用于HDFS文件系统

•hdfs dfs跟hadoop dfs的命令作用一样,也只能适用于HDFS文件系统

(6)Haoop集群的部署与使用

-

Hadoop框架中最核心的设计是为海量数据提供存储的HDFS和对数据进行计算的MapReduce

-

MapReduce的作业主要包括:(1)从磁盘或从网络读取数据,即IO密集工作;(2)计算数据,即CPU密集工作

-

Hadoop集群的整体性能取决于CPU、内存、网络以及存储之间的性能平衡。因此运 营团队在选择机器配置时要针对不同的工作节点选择合适硬件类型 。

-

一个基本的Hadoop集群中的节点主要有

NameNode:负责协调集群中的数据存储

DataNode:存储被拆分的数据块

JobTracker:协调数据计算任务

TaskTracker:负责执行由JobTracker指派的任务

SecondaryNameNode:帮助NameNode -

后续关于Hadoop的集群搭建可以参考以下

在Ubuntu下搭建Hadoop集群

在CentOS下搭建Hadoop集群