OpenVINO安装及环境配置 win10

OpenVINO安装及环境配置 win10

- 1 OpenVINOTM工具包简介

- 1.1 特点

- 1.2 包含的组件

- 1.3 系统要求

- 2 安装步骤

- 2.1 安装所需依赖项

- 2.2 安装OpenVINOTM工具包

- 3 设置环境变量

- 3.1 单次设置环境变量

- 3.2 永久设置环境变量

- 4 配置模型优化器

- 4.1 模型优化器简介

- 4.2 模型优化器配置步骤

- 5 验证脚本

- 5.1 运行图像分类验证脚本

- 5.2 运行推理管道验证脚本

- 6 主要参考链接

1 OpenVINOTM工具包简介

1.1 特点

Intel®OpenVINO™工具包发行版(The Intel® Distribution of OpenVINO™ toolkit)可加快模拟人类视觉的应用程序和解决方案的部署。该工具包基于卷积神经网络(CNN),将计算机视觉(CV)工作负载扩展到了英特尔®硬件上,以实现最佳性能。其具有以下特点:

- 支持从边缘到云的深度学习推理

- 加速AI工作负载,包括计算机视觉,音频,语音,语言和推荐系统

- 使用通用API,支持跨Intel®架构和AI加速器(CPU、iGPU、Intel®Movidius™视觉处理单元(VPU)、FPGA 和 Intel®高斯与神经加速器(Intel®GNA))的异构执行

- 通过功能库和预优化的内核加快上市时间

- 包括对OpenCV,OpenCL™内核以及其他行业工具和库的优化调用

有关详细信息,请参见Intel® Distribution of OpenVINO™ toolkit Overview

1.2 包含的组件

以下为Win 10 OS的OpenVINOTM工具包所包含的组件:

| 组件 | 描述 |

|---|---|

| 模型优化器 | 该工具将在流行框架中训练的模型导入,转换和优化为Intel工具(尤其是推理引擎)可用的格式。注意:流行的框架包括Caffe*,TensorFlow*,MXNet和ONNX等框架 |

| 推理机 | 这是运行深度学习模型的引擎。它包括一组库,可轻松将其推理集成到您的应用程序中 |

| OpenCV | 为Intel®硬件编译的OpenCV*社区版本 |

| 推理机样本 | 一组简单的控制台应用程序,展示了如何在应用程序中使用英特尔的深度学习推理引擎 |

| Demos | 一组控制台应用程序,它们演示了如何在应用程序中使用推理引擎来解决特定的用例 |

| 其他工具 | 一组可用于模型的工具 |

| 预训练模型的文档 | open_model_zoo存储库中提供的预训练模型的文档 |

1.3 系统要求

以下为Win 10 OS的OpenVINOTM工具包的系统要求:

1.3.1 支持的硬件

- 第6至第10代Intel®Core™处理器和Intel®Xeon®处理器

- Intel® Xeon® 处理器E家族(以前的代码分别为Sandy Bridge,Ivy Bridge,Haswell和Broadwell)

- 第3代 Intel® Xeon® 可扩展处理器(以前的代码为Cooper Lake)

- Intel® Xeon® 可扩展处理器(以前为Skylake和Cascade Lake)

- Intel Atom® 处理器,支持Intel® Streaming SIMD扩展4.1((Intel® SSE4.1)

- 具有 Intel® HD Graphics 的 Intel Pentium®处理器N4200/5、N3350/5 或 N3450/5

- Intel®神经计算棒2(Intel® Neural Compute Stick 2)

- 带有 Intel® Movidius™VPU 的 Intel® 视觉加速器设计 (Intel® Vision Accelerator Design)

1.3.2 操作系统

- Microsoft Windows* 10 64-bit

1.3.3 所需软件

- Visual Studio 2019、2017、2015

- CMake3.4或更高版本的64位

- Python 3.6.5 64位

详情见:Install Intel® Distribution of OpenVINO™ toolkit for Windows* 10

2 安装步骤

2.1 安装所需依赖项

- Visual Studio 2019、2017、2015

- CMake3.4或更高版本的64位

- Python 3.6.5 64位

2.1.1 Visual Studio

首先点击链接 Visual Studio 2019、2017、2015 下载Visual Studio安装包。然后在以下界面,搜索并安装以下组件:

2.1.2 Cmake

点击链接 CMake3.4或更高版本的64位,下载安装相应版本即可

2.1.3 Python3.6.5

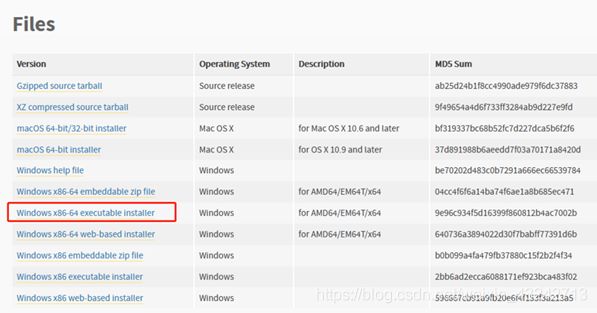

点击链接Python 3.6.5 64位,下载以下安装包

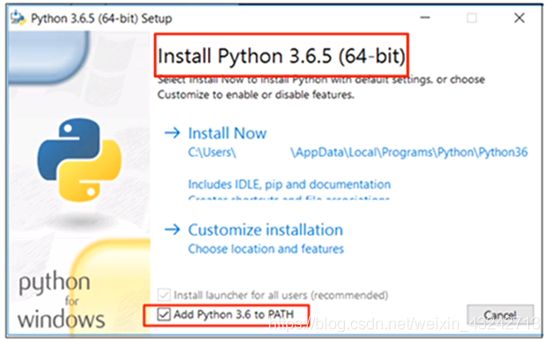

安装时最好选择默认路径,并勾选添加至路径

2.2 安装OpenVINOTM工具包

2.2.1 注册并下载安装包

点击链接Download the Intel® Distribution of OpenVINO™ toolkit today,填写相关信息并下载安装包。注意记下序列号(Serial number)。

2.2.2 安装

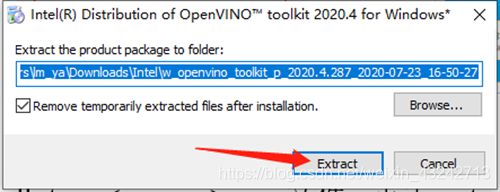

Step1:双击w_openvino_toolkit_p_.exe文件,点击extract,然后在打开的窗口中选择安装目录和组件。我这里选择了默认路径和所有组件。

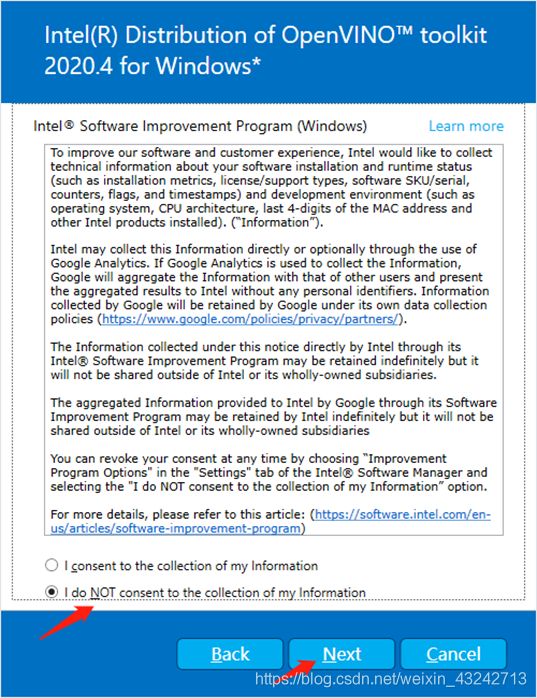

Step2:点击Next进入下一步。询问是否要同意收集信息,我这里选择了不同意。然后单击Next进入下一步。

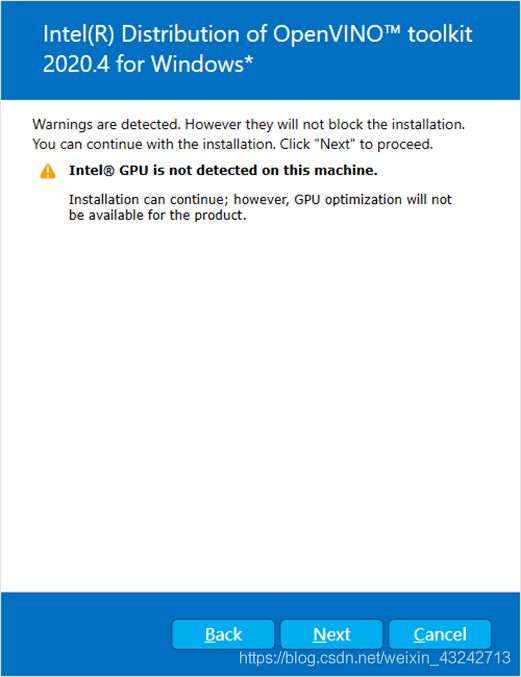

Step3:如果缺少外部依赖项,则会看到警告屏幕。记下缺少的依赖项。此时无需采取其他任何措施。安装完OpenVINO™工具包核心组件后,请安装缺少的依赖项。我的电脑不是Intel的显卡,所以出现了下面的警告

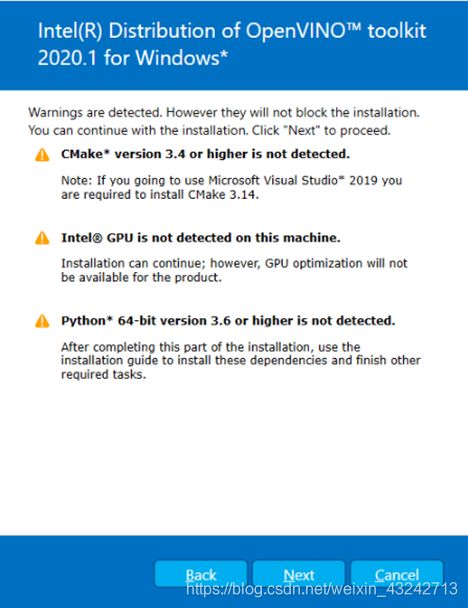

如果缺少前面的依赖项,则可能出现以下警告

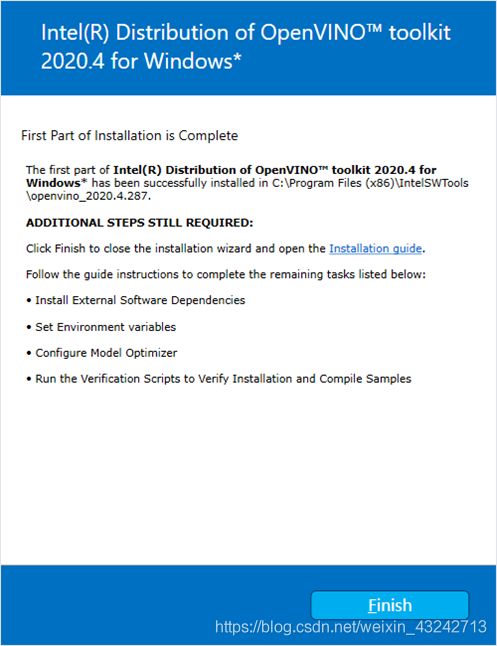

Step4:点击Next进入下一步,等待安装。安装的第一部分完成后,最后一个屏幕将通知您已安装了核心组件,并且仍然需要执行其他步骤:

单击Finish完成以关闭安装向导。一个新的浏览器窗口将打开到安装指南的下一部分,以设置环境变量。

如果安装提示必须安装依赖项,请先安装它们。如果没有缺少的依赖项,则可以继续设置环境变量。

3 设置环境变量

OpenVINO设置环境变量有两种方法:一种是每次使用时都用命令提示符设置一次;另一种手动永久设置环境变量。前者单次设置非常简单,适合偶尔使用OpenVINO的朋友;后者设置相对复杂,但对于经常使用OpenVINO的朋友,一次永久设置效果更好。这里将两种方法都介绍如下:

3.1 单次设置环境变量

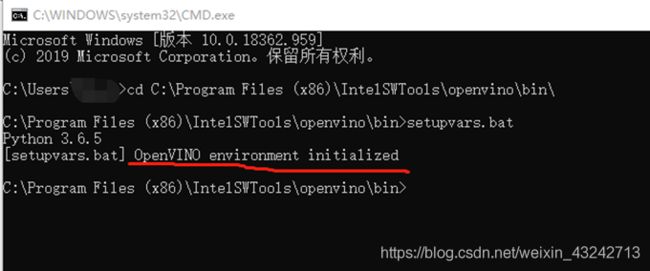

找到之前的OpenVINOTM工具包的安装路径(我的是默认路径),打开命令提示符,并转到相应的路径:

cd C:\Program Files (x86)\IntelSWTools\openvino\bin\

运行setupvars.bat文件:

setupvars.bat

即可成功设置环境变量,如下图所示:

关闭“命令提示符”窗口时,将删除OpenVINOTM工具包的环境变量。下次还需用到OpenVINOTM工具包时,需要重新按此方法进行环境变量的设置,否则将无法编译和运行OpenVINO™应用程序。

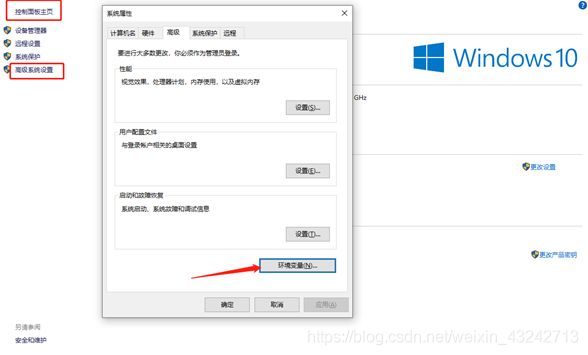

3.2 永久设置环境变量

具体参见 为 Windows®10永久设置 OpenVINO™环境变量。

需要注意的是,对于2020版本的,由于添加了新的模块,所以在系统变量下编辑Path变量时,还需添加以下条目:%INTEL_OPENVINO_DIR%\deployment_tools\ngraph\lib

系统环境变量可在如下窗口中进行设置:

4 配置模型优化器

4.1 模型优化器简介

环境变量设置好以后,就可以进行模型优化器(Model Optimizer)的配置了。

模型优化器是Intel®OpenVINO™工具包发行版的关键组件。如果不通过Model Optimizer运行模型,则无法对训练后的模型进行推断。当通过模型优化器运行经过预训练的模型时,输出是网络的中间表示(IR)。IR是一对描述整个模型的文件,包含.xml文件(描述网络拓扑)和.bin文件(包含权重和偏置二进制数据)。推理引擎使用跨CPU、GPU或VPU硬件的通用API读取,加载和推断IR文件。

4.2 模型优化器配置步骤

可以一次为所有受支持的框架配置模型优化器,也可以一次为一个框架配置模型优化器。

选项1:同时为所有受支持的框架配置模型优化器

打开命令提示符,并转到模型优化器先决条件目录(这里为默认路径):

cd C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\model_optimizer\install_prerequisites

然后运行以下批处理文件以为Caffe *,TensorFlow *,MXNet *,Kaldi *和ONNX *配置模型优化器:

install_prerequisites.bat

选项2:分别为每个框架配置模型优化器

详细请参考:分别为每个框架配置模型优化器

5 验证脚本

此步运行两个脚本来验证OpenVINO™工具包是否安装成功。此处是在CPU上运行产品随附的验证应用程序。首先打开命令提示符窗口,转到推理引擎演示目录(这里为默认路径):

cd C:\Program Files (x86)\IntelSWTools\openvino\deployment_tools\demo\

然后分别运行以下脚本:

5.1 运行图像分类验证脚本

在命令提示符中运行demo_squeezenet_download_convert_run.bat文件。

demo_squeezenet_download_convert_run.bat

该脚本下载一个SqueezeNet模型,使用模型优化器将模型转换为.bin和.xml 中间表示(IR)文件。推理引擎需要此模型转换,因此它可以将IR用作输入并在Intel硬件上实现最佳性能。验证脚本完成后,将获得前十名类别的标签和可信度:

5.2 运行推理管道验证脚本

在命令提示符中运行demo_security_barrier_camera.bat文件。

demo_security_barrier_camera.bat

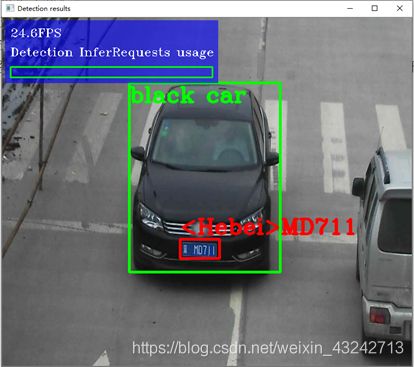

该脚本下载了三个经过预先训练的模型IR,构建了Security Barrier Camera Demo 应用程序,并与下载的模型和demo目录中的car_1.bmp 图像一起运行它,以显示推理管道。验证脚本使用车辆识别,其中车辆属性彼此建立,以缩小特定属性的范围。首先,将物体识别为车辆。该标识用作下一个模型的输入,该模型标识特定的车辆属性,包括车牌。最后,将识别为车牌的属性用作第三种模型的输入,该模型可以识别车牌中的特定字符。

演示完成后将打开两个窗口:

6 主要参考链接

OpenVINO安装for win10 官方文档

OpenVINO™工具套件在Win10上安装及环境配置