使用scala编写一个简单实例到spark集群运行

实际工作上很少在虚拟机上直接使用spark-shell去编写程序,更多的是在IDEA等编辑器上将写好的程序打包,使用spark-submit提交到集群上去执行。

我们使用scala去编写程序,不会的自己百度学下,不解释。

1,安装jdk

因为scala也是运行在jvm上的,所以需要安装jdk。(jdk安装方法不解释,自己百度,建议安装1.7以上版本)

2,安装scala

笔者安装的是scala 2.10.6版本,需要jdk1.7及以上版本支持。

提供一个可参考的scala下载地址 https://www.scala-lang.org/download/2.10.6.html (方便起见建议下载windows msi版直接安装)

设置系统变量,添加一个SCALA_HOME,设置值为SCALA指定的安装目录,

在Path路径的末尾加

;%SCALA_HOME%\bin;%SCALA_HOME%\jre\bin;在CLASSPATH路径末尾添加

;%SCALA_HOME%\bin;%SCALA_HOME%\lib\dt.jar;%SCALA_HOME%\lib\tools.jar.;配置后按 win + R 输入cmd 召唤窗口输入 scala -version ,查看是否配置安装成功。

3,在IDEA上使用编写程序

创建一个maven项目,创建过程不解释,提供一个我的 pom.xml文件

4.0.0

cn.itcast.spark

hello-spark

1.0

1.7

1.7

UTF-8

2.10.6

1.6.1

2.6.4

org.scala-lang

scala-library

${scala.version}

org.apache.spark

spark-core_2.10

${spark.version}

org.apache.hadoop

hadoop-client

${hadoop.version}

src/main/scala

src/test/scala

net.alchim31.maven

scala-maven-plugin

3.2.2

compile

testCompile

-make:transitive

-dependencyfile

${project.build.directory}/.scala_dependencies

org.apache.maven.plugins

maven-shade-plugin

2.4.3

package

shade

*:*

META-INF/*.SF

META-INF/*.DSA

META-INF/*.RSA

编写一个wordCount小程序,代码如下:

package cn.itcast.spark

import org.apache.spark. {SparkConf, SparkContext}

/**

* Created by mrwanghc on 2018/7/17.

*/

object WordCount {

def main(args: Array[String]) {

val conf = new SparkConf().setAppName("WC")

val sc = new SparkContext(conf)

sc.textFile(args(0)).flatMap(_.split(" ")).map((_,1)).reduceByKey(_+_).sortBy(_._2,false).saveAsTextFile(args(1))

sc.stop()

}

}

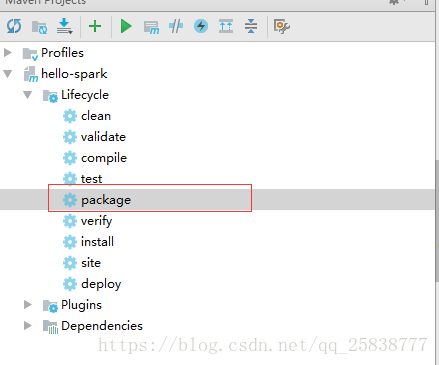

写完后将项目打包:

这里会生成两个包,一个是只包含代码的简洁包,另一个是包含jar包依赖的大包,保险起见我们使用打包即可。

将包上传到spark集群上, spark集群的搭建启动这里不解释,之前文章有详解,请自行查看。

在spark目录下输入命令

bin/spark-submit --master spark://weekend02:7077 --class cn.itcast.spark.WordCount --executor-memory 512m --total-executor-cores 2 /home/bigdata/hello-spark-1.0.jar hdfs://weekend02:9000/wc hdfs://weekend02:9000/out2--master 指定集群master

--class 指定类所在地址

--executor-memory 512m 指定每个work运行内存为512m

--total-executor-cores 2 指定总共提供2个核处理给所有work

/home/bigdata/hello-spark-1.0.jar 提供上传的jar包所在目录

hdfs://weekend02:9000/wc 提供所需分析的文件所在hdfs中的目录

hdfs://weekend02:9000/out2 提供处理完后的文件要放到hdfs中某目录

输入完这条命令回车运行,若不报错,则完活!