DataFrame的基本使用

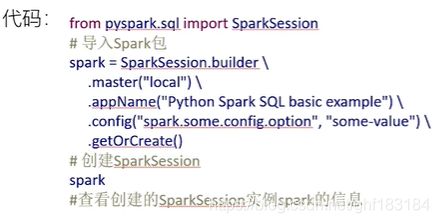

SparkSession

函数及说明 :

创建SparkSession

创建DataFrame

从csv文件中创建DataFrame——sqlContext

代码 :

创建结果 : pyspark.sql.dataframe.DataFrame

从MySQL表中创建DataFrame

代码 :

创建结果 : pyspark.sql.dataframe.DataFrame

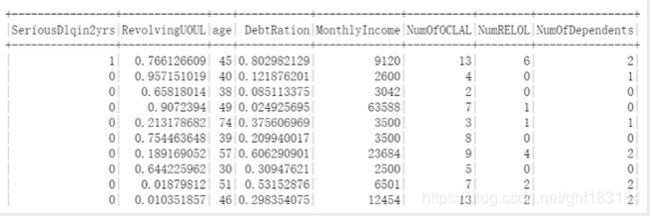

show() : 展示DataFrame

代码 : aa.show()

运行结果 :

printSchema() : 展示DataFrame的所有列名及数据类型

代码 : aa.printSchema()

运行结果 :

DataFrame添加列

withColumn() : DataFrame添加列

代码 : aa.withColumn(“age1”,aa[“age1”].cast(StringType())).show()

运行结果 :

DataFrame删除

drop() : 删除DataFrame某一列

代码 : aa.drop(“age”).show()

DataFrame去重

distinct() : DataFrame去重操作

代码 : aa.distinct().show()

DataFrame切片

Select() : 选择DataFrame某一列

代码 : aa.select(“MonthlyIncome”).show()

Select() : 选择多个DataFrame列并对列进行操作

代码 : aa.select(aa[‘monu’],aa[‘dgds’]+1000).show()

limit() : DataFrame前n行

代码 : aa.limit(10).show()

filter() : 筛选DataFrame符合条件的行

代码 : aa.filter(aa[‘sdsag’]>10000).show()

DataFrame排序

orderBy() : 根据DataFrame某一列的值由升序排序

代码 : aa.orderBy(“niohg”).show()

DataFrame统计

count() : DataFrame行数统计

代码 : aa.count()

运行结果 : 112415

agg() : DataFrame常用统计量计算

代码 : aa.agg({‘age’:’max’}).show()

aa.agg({‘age’:’min’}).show()

aa.agg({‘age’:’average’}).show()

aa.agg({‘age’:’sum’}).show()

运行结果 :

DataFrame数据格式转换

head() : 将DataFrame前n行转化为Row对象列表

代码 : aa.head(10)

运行结果 :

collect() : 将DataFrame转化为Row对象列表

代码 : data=aa.collect()

Print(data)

type(data)

toPandas() : 将SparkSQL——DataFrame转化为Pandas——DataFrame

代码 : aa_a=aa.toPandas()

type(aa_a)

创建结果 : pandas.core.frame.DataFrame

DataFrame导出

Write.save() : 保存DataFrame数据到csv文件

代码 : #选择Age和MonthlyIncome列写入另一个csv文件

a.select(“age”,”month”).write.save(“Ageandmonth.csv”,format=”csv”)

保存DataFrame数据到MySQL表

代码 : aa.write

.format(“jdbc”)

.option(“url”,”jdbc:mysql://localhost:3306/?user=root”) #MySQL服务器地址

.option(“dbtable”,”Credit.aa_new”) #配置图标信息

.option(“user”,”user”) #配置用户名

.option(“password”,”password”) #配置密码

.save()