6.1神经网络算法(Neural Networks)(上)

1.背景:

1.1 以人脑中的的神经网络为启发,历史上出现过很多不同版本

1.2 最著名的算法是1980年的backpropagation

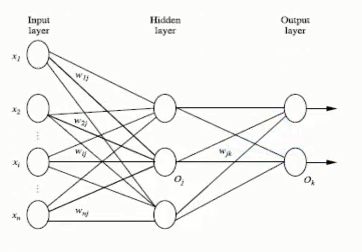

2.多层向前神经网络(Multilayer Feed-Forard Neural Network)

2.1 Backpropagation被使用在多层向前神经网络上

2.2 多层向前神经网络由一下部分组成:

输入层(input layer),隐藏层(hidden layer),输出层(output layers)

2.3 每层由单元(units)组成

2.4 输入层(input layer)是由训练集的实例特征向量传入

2.5 经过连接点的权重(weight)传入下一层,一层的输出是下一层的输入

2.6 隐藏层的个数可以是任意的,输入层有一层,输出层有一层

2.7 每个单元(unit)也可以被称为神经结点,这是根据生物学来源定义的

2.8 以上称为2层的神经网络(输入层不算)

2.9 一层中加权的求和,然后根据非线性方程转化输出

2.10作为多层向前神经网络,理论上,如果有足够多的隐藏层(hidden layers)和足够的大训练集,可以模拟出任何方程

3.设计神经网络结构

3.1 使用神经网络训练数据之前,必须确定神经网络的层数,以及每层单元的个数

3.2 特征向量在被传入输入层时通常被先标准化(normalize)到0和1之间(为了加速学习过程)

3.3 离散型变量可以被编码成每一个输入单元对应一个特征值可能赋的值

比如:特征值A可能取三个值(a0,a1,a2),可以使用三个输入单元来代表A:

如果A=a0,那么代表a0的单元值就取1,其他取0;

如果A=a1,那么代表a1的单元值就取1,其他取0;以此类推

3.4 神经网络既可以用来做分类(classification)问题,也可以解决回归(regretion)问题

3.4.1 对于分类问题,如果是2类,可以用一个输出单元来表示(0和1分别代表1类)

如果多于2类,每一个类别用一个输出单元来表示

所以,输出层的单元数量通常等于类别的数量

3.4.2 没有明确的规则来设计最好有多少个隐藏层

3.4.2.1 根据实验测试和误差,以及准确度来实验并改进

4. 交叉验证方法(Cross-Validation)

K-fold cross validation

5.Backpropagation算法

5.1 通过迭代性来处理训练集中的实例

5.2 对比经过神经网络后输出层预测值(predicted value)与真实值(target value)

5.3 反方向(从输出层 =》隐藏层 =》输入层)以最小化误差(error)来更新每个连接的权重(weight)和偏向

5.4 算法详细介绍

输入:D:数据集;学习率(learning rate); 一个多层向前神经网络

输出:一个训练好的神经网络(a trained neural network)

5.4.1 初始化权重(weights)和偏向(bias):随机初始化在-1到1之间,或者-0.5到0.5之间,每个单元有一个偏向

5.4.2 对于每一个训练实例X,执行以下步骤:

5.4.2.1:由输入层向前传送:

![]()

5.4.2.2 根据误差(error)反向传送:

对于输出层:

对于隐藏层:

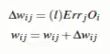

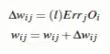

权重更新:

偏向更新:

5.4.3 终止条件

5.4.3.1 权重的更新低于某个阈值

5.4.3.2 预测的错误率低于某个阈值

5.4.3.3 达到预设的循环次数

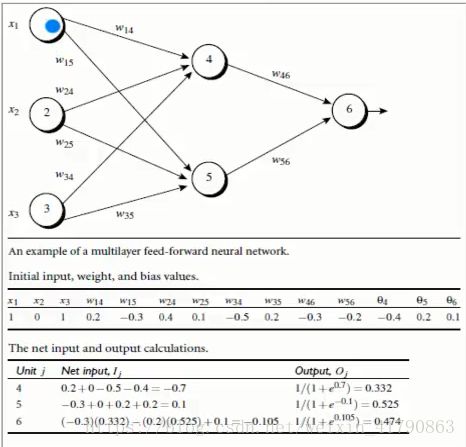

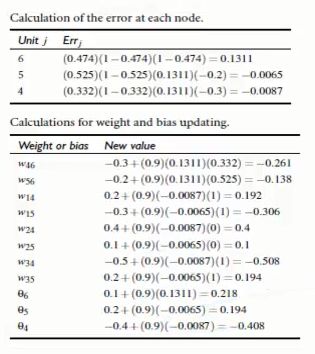

6. Backpropagation 算法举例

对于输出层:

对于隐藏层:

权重更新:

偏向更新:

注:神经网络算法在九十年代达到了一个瓶颈,表现并不是很好,但这二十几年里随着互联网和计算能力的提升,在2012年,由著名学者Hinten的一片paper,就是用神经网络算法来做物体识别,一下突破了所有算法,所以最近几年很多学者都将DL作为重点研究方向。