- scrapy学习笔记0827

github_czy

scrapy学习笔记

1.总之先启动先安装scrapy,pipinstallscrapy创建scrapy项目,生成的项目结构应该如图所示,scrapystartprojectexample选择需要爬取的页面并分析,这里选定的页面是Allproducts|BookstoScrape-Sandbox一个供给爬虫学者练手的网站,我们需要爬取上面的书籍信息,解析我们需要的内容在那一段html标签里可以使用浏览器自带的开发者工具

- scrapy学习笔记0828-下

github_czy

scrapy学习笔记

1.爬取动态页面我们遇见的大多数网站不大可能会是单纯的静态网站,实际中更常见的是JavaScript通过HTTP请求跟网站动态交互获取数据(AJAX),然后使用数据更新HTML页面。爬取此类动态网页需要先执行页面中的JavaScript代码渲染页面,再进行爬取。在这里我们采用scrapy官方推荐的Splash渲染引擎,我们需要通过docker来安装splash并使其运行起来,这里就暂时不展开,安装

- 爬虫框架Scrapy学习笔记-3

friklogff

爬虫python爬虫scrapy学习

Scrapy管道详解:数据存储和图片下载引言在网络爬虫开发中,数据的存储和处理是至关重要的环节。Scrapy作为Python中一款强大的网络爬虫框架,提供了丰富的数据存储和处理功能,其中最重要的概念之一就是管道(Pipeline)。本文将深入探讨Scrapy管道的使用,包括如何将爬取的数据保存到不同的数据存储中,以及如何下载和处理图片数据。摘要本文将围绕以下主题展开讨论:CSV文件写入:介绍如何将

- Scrapy学习笔记(一)——使用Pycharm搭建编写Scrapy项目的环境

DivingKitten

EnvPython

写在前面:Python版本:3.6.1Pycharm版本:2018.1.4第一步:命令行构建Scrapy项目Pycharm中没有直接构建Scrapy项目的模板和指令,所以需要自行在命令行中通过指令进行项目的创建。格式:scrapy[指令][项目名]eg:scrapystartproject[project]第二步:使用Pycharm打开项目并配置编译环境项目创建完成后,便可以通过Pycharm打开

- Scrapy+Selenium自动化获取个人CSDN文章质量分

friklogff

python爬虫scrapyselenium自动化python学习

前言本文将介绍如何使用Scrapy和Selenium这两个强大的Python工具来自动获取个人CSDN文章的质量分数。我们将详细讨论Scrapy爬虫框架的使用,以及如何结合Selenium浏览器自动化工具来实现这一目标。无需手动浏览每篇文章,我们可以轻松地获取并记录文章的质量分数,从而更好地了解我们的博客表现。CSDN文章质量分查询链接Scrapy相关基础知识:爬虫框架Scrapy学习笔记-1爬虫

- 爬虫框架Scrapy学习笔记-2

friklogff

爬虫python爬虫scrapy学习

前言Scrapy是一个功能强大的Python爬虫框架,它被广泛用于抓取和处理互联网上的数据。本文将介绍Scrapy框架的架构概览、工作流程、安装步骤以及一个示例爬虫的详细说明,旨在帮助初学者了解如何使用Scrapy来构建和运行自己的网络爬虫。Scrapy架构概览Scrapy由以下主要组件构成:引擎(Engine):负责控制数据流在各个组件之间的流动,触发事务。调度器(Scheduler):接收引擎

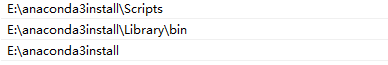

- Scrapy学习笔记-Anaconda下安装

肥叔菌

安装Scrapy参考自Scrapy的官方手册:https://docs.scrapy.org/en/latest/intro/install.htmlScrapy在CPython(默认Python实现)和PyPy(从PyPy5.9开始)下的Python3.5或更高版本上运行。Anaconda下安装如果您使用的是Anaconda或Miniconda,则可以从conda-forge渠道安装该软件包,该

- Scrapy学习笔记(8)-使用signals来监控spider的状态

leeyis

场景介绍有时候我们需要在spider启动或者结束的时候执行一些特定的操作,比如说记录日志之类的,在scrapy中我们可以使用signals来实现。主要实现代码如下:#-*-coding:utf-8-*-fromscrapyimportsignalsfromscrapy.xlib.pydispatchimportdispatcherfromscrapy.linkextractorsimportLin

- 【Python_Scrapy学习笔记(一)】Scrapy框架简介

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy爬虫网络爬虫

Scrapy框架简介前言Scrapy框架是一个用python实现的为了爬取网站数据、提取数据的应用框架,使用Twisted异步网络库来处理网络通讯,可以高效的完成数据爬取。本文主要介绍Scrapy框架的构成与工作原理。正文1、Scrapy安装Windows安装:-m-pipinstallScrapy或使用PyCharm可视化界面安装。2、Scrapy框架构成爬虫文件Spider:负责数据的解析提取

- 【Python_Scrapy学习笔记(十二)】基于Scrapy框架实现POST请求爬虫

禾戊之昂

Python学习笔记#Scrapy学习笔记python爬虫scrapy网络爬虫

基于Scrapy框架实现POST请求爬虫前言本文中介绍如何基于Scrapy框架实现POST请求爬虫,并以抓取指定城市的KFC门店信息为例进行展示正文1、Scrapy框架处理POST请求方法Scrapy框架提供了FormRequest()方法来发送POST请求;FormRequest()方法相比于Request()方法多了formdata参数,接受包含表单数据的字典或者可迭代的元组,并将其转化为请求

- 【Python_Scrapy学习笔记(十三)】基于Scrapy框架的图片管道实现图片抓取

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy网络爬虫爬虫

基于Scrapy框架的图片管道实现图片抓取前言本文中介绍如何基于Scrapy框架的图片管道实现图片抓取,并以抓取360图片为例进行展示。正文1、Scrapy框架抓取图片原理利用Scrapy框架提供的图片管道类ImagesPipeline抓取页面图片,在使用时需要导入,并且重新get_media_requests()方法,如果对保存的文件名有要求,则需要重写file_path()方法,在settin

- 【Python_Scrapy学习笔记(十四)】基于Scrapy框架的文件管道实现文件抓取(基于Scrapy框架实现多级页面的抓取)

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy网络爬虫爬虫

基于Scrapy框架的文件管道实现文件抓取(基于Scrapy框架实现多级页面的抓取)前言本文中介绍如何基于Scrapy框架的文件管道实现文件抓取(基于Scrapy框架实现多级页面的抓取),并以抓取第一PPT网站的PPT模板为例进行展示,同时抓取此网站数据的方式也是对如何使用Scrapy框架实现多级页面的抓取进行详解。正文1、Scrapy框架抓取文件原理Scrapy框架提供了文件管道类FilesPi

- 【Python_Scrapy学习笔记(十一)】基于Scrapy框架的下载器中间件添加Cookie参数

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy中间件网络爬虫爬虫

基于Scrapy框架的下载器中间件添加Cookie参数前言本文中介绍如何基于Scrapy框架的下载器中间件添加Cookie参数。正文1、添加中间件的流程在middlewares.py中新建Cookie参数中间件类在settings.py中添加此下载器中间件,设置优先级并开启2、基于Scrapy框架的下载器中间件添加Cookie参数的流程在middlewares.py中新建Cookie参数中间件类#

- 【Python_Scrapy学习笔记(六)】Scrapy框架基本使用流程

禾戊之昂

#Scrapy学习笔记Python学习笔记pythonscrapy爬虫网络爬虫

Scrapy框架基本使用流程前言本文中介绍Scrapy框架的基本使用流程,并以抓取汽车之家二手车数据为例进行讲解。正文1、Scrapy框架基本使用流程创建爬虫项目:scrapystartprojecct项目名cd到项目文件夹:cd项目名创建爬虫文件:scrapygenspider爬虫文件名浏览器地址栏中的域名定义抓取的数据结构:编写items.py文件importscrapyclass项目名ite

- 【Python_Scrapy学习笔记(七)】基于Scrapy框架实现数据持久化

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy网络爬虫爬虫

基于Scrapy框架实现数据持久化前言本文中介绍如何基于Scrapy框架实现数据持久化,包括Scrapy数据持久化到MySQL数据库、MangoDB数据库和本地csv文件、json文件。正文1、Scrapy数据持久化到MySQL数据库在settings.py中定义MySQL相关变量#定义MySQL数据库的相关变量MYSQL_HOST='xxxxxxxxx'MYSQL_USER='xxxx'MYSQ

- 【Python_Scrapy学习笔记(八)】基于Scrapy框架实现多级页面数据抓取

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy网络爬虫爬虫

基于Scrapy框架实现多级页面数据抓取前言本文中介绍如何基于Scrapy框架实现多级页面数据的抓取,并以抓取汽车之家二手车数据为例进行讲解。正文在介绍如何基于Scrapy框架实现多级页面数据的抓取之前,先介绍下Scrapy框架的请求对象request和响应对象response。1、请求对象request属性及方法request.url:请求的url地址request.headers:请求头-字典

- 【Python_Scrapy学习笔记(二)】创建Scrapy爬虫项目

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy网络爬虫爬虫

创建Scrapy爬虫项目前言本文主要介绍如何创建并运行Scrapy爬虫项目。正文1、创建Scrapy框架Scrapy框架提供了scrapy命令用来建立Scrapy工程,在终端terminal中输入以下命令:scrapystartproject自定义的项目名称创建好爬虫项目文件夹后先cd进入创建的爬虫项目,然后执行下列语句,即可生成一个爬虫文件:cd自定义的项目名称scrapygenspider创建

- 【Python_Scrapy学习笔记(三)】Scrapy框架之全局配置文件settings.py详解

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy网络爬虫爬虫

Scrapy框架之全局配置文件settings.py详解前言settings.py文件是Scrapy框架下,用来进行全局配置的设置文件,可以进行User-Agent、请求头、最大并发数等的设置,本文中介绍settings.py文件下的一些常用配置正文1、爬虫的项目目录名、爬虫文件名BOT_NAME:Scrapy项目实现的bot的名字。用来构造默认User-Agent,同时也用来log。当使用sta

- 【Python_Scrapy学习笔记(四)】Scrapy框架之数据封装文件items.py详解

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy网络爬虫爬虫

Scrapy框架之数据封装文件items.py详解前言items.py文件是Scrapy框架下,用来进行数据封装的文件,可以自定义爬取的字段,本文中介绍items.py文件的基本使用方法。正文1、items介绍Scrapy提供Item类来定义公共输出数据格式,Item对象是用于收集所抓取的数据的简单容器。当使用startproject命令创建项目时,items.py文件自动被创建。2、items定

- 【Python_Scrapy学习笔记(五)】Scrapy框架之管道文件pipelines.py详解

禾戊之昂

Python学习笔记#Scrapy学习笔记pythonscrapy网络爬虫爬虫

Scrapy框架之管道文件pipelines.py详解前言pipelines.py文件是Scrapy框架下,用于接收网络爬虫传过来的数据,以便做进一步处理的文件。例如验证实体的有效性、清除不需要的信息、存入数据库(持久化实体)、存入文本文件等。本文中介绍pipelines.py文件的基本使用方法。正文1、pipelines介绍管道文件pipelines.py主要用来对抓取的数据进行处理:一般一个类

- Scrapy学习笔记(9)-使用scrapy-deltafetch实现增量爬取

leeyis

前言在之前的文章中我们都是对目标站点进行全量爬取,只要爬虫run起来就会对所有的链接都爬取一遍,这其实是很傻的做法,因为很多情况下我们并不需要爬取已经爬过的链接,除非你需要定期更新这个链接对应页面上的数据。好了,回归正题,本文介绍scrapy使用scrapy-deltafetch这个插件来实现增量爬取,这里以爬取【美食杰】上的菜谱信息为例。正文安装scrapy-deltafetch$pipinst

- Python Scrapy 学习笔记

python

title:PythonScrapy学习笔记summary:在慕课网学习Scrapy时所作的笔记author:小Kdatetime:2021-08-1716:442021-08-2812:09tags:PythonScrapy笔记webcrawlingseleniumCSSselectorXPath[TOC]PythonScrapy学习笔记Scrapy爬虫编码一般过程创建项目。这个项目可用包含爬取

- Python爬虫框架Scrapy学习笔记

梦幻python

pygamepython爬虫爬虫python数据挖掘

scrapy.png本文主要内容针对Scrapy有初步了解的同学。结合作者的实际项目中遇到的一些问题,汇成本文。之后会写一些具体的爬虫demo,放到https://github.com/hanguangchao/scrapy_awesome鉴于作者接触爬虫不久,水平有限,文章难免出现纰漏,还请各位达人留言指导。内容提要Scrapy问题记录Scrapy问题示例代码Scrapy常用代码片段Scrapy

- Scrapy学习笔记(1)

啊啊啊海@

python

Scrapy学习笔记(1)介绍什么是Scrapy框架?Scrapy是用纯Python实现一个为了爬取网站数据、提取结构性数据而编写的应用框架,用途非常广泛。多用于抓取大量静态页面。框架的力量:用户只需要定制开发几个模块就可以轻松的实现一个爬虫,用来抓取网页内容以及各种图片,非常之方便。Scrapy使用了Twisted['twɪstɪd](其主要对手是Tornado)异步网络框架来处理网络通讯,可以

- Python爬虫框架Scrapy学习笔记原创

wxystyle

python

scrapy[TOC]开始scrapy安装首先手动安装windows版本的Twistedhttps://www.lfd.uci.edu/~gohlke/pythonlibs/#twistedpipinstallTwisted-18.4.0-cp36-cp36m-win_amd64.whl安装scrapypipinstall-ihttps://pypi.douban.com/simple/scrap

- Scrapy学习笔记(3)爬取知乎首页问题及答案

浅零半泣

Scrapy爬虫

目标:爬取知乎首页前x个问题的详情及问题指定范围内的答案的摘要powerby:Python3.6Scrapy1.4jsonpymysql项目地址:https://github.com/Dengqlbq/ZhiHuSpider.gitStep1——相关简介本文将注意力放在代码实现上,代码思路的描述将另开一文代码思路:http://blog.csdn.net/sinat_34200786/articl

- scrapy学习笔记(〇)

ATangYaaaa

人若无名,便可潜心练剑。本篇补冲基础知识:scrapy架构安装和shell用法。安装顺序:1.Python3.62.python-mpipinstallpywin323.python-mpipinstalllxml4.python-mpipinstallsetuptools5.python-mpipinstallzope.interface6.下载对应已编译版本:https://www.lfd.u

- Python爬虫框架Scrapy学习笔记

codefine

scrapy.png本文主要内容针对Scrapy有初步了解的同学。结合作者的实际项目中遇到的一些问题,汇成本文。之后会写一些具体的爬虫demo,放到https://github.com/hanguangchao/scrapy_awesome鉴于作者接触爬虫不久,水平有限,文章难免出现纰漏,还请各位达人留言指导。内容提要Scrapy问题记录Scrapy问题示例代码Scrapy常用代码片段Scrapy

- 西山小菜鸟之Scrapy学习笔记---splash简介

依然关注

Scrapy爬虫

前言 本文主要介绍scrapy-splash的理论知识。文中如有不正确的地方望大家指正。本文的主要内容出自书:《精通Scrapy网络爬虫》《虫术——Python绝技》背景 近几年随着前端技术和手机端App的飞速发展,互联网架构也发生了巨大的变化,尤其是一些前端框架的大面积应用,过去基于纯后端的Web结构已经明显过时了。越来越多的网站采用前后端分离的架构。 所谓前后端分离,就是指一

- 西山小菜鸟之Scrapy学习笔记---在Scrapy中使用代理

依然关注

Scrapy爬虫

前言本文中如有错误,请各位指正。背景 在爬取各大网页信息时,通过会遇到各种各样的反爬措施:很多网站会检测某一段时间某个IP的访问次数,如果访问频率太快以至于看起来不像正常的访客,那么它就可能就会禁止此IP的访问(有兴趣的小伙伴可以试试天眼查这个网站)。所以我们需要设置一些代理服务器,每隔一段时间换一个代理,就算IP被禁止,依然可以换个IP继续爬取,同时也不会暴露自己。 虽然网上有各在代

- java类加载顺序

3213213333332132

java

package com.demo;

/**

* @Description 类加载顺序

* @author FuJianyong

* 2015-2-6上午11:21:37

*/

public class ClassLoaderSequence {

String s1 = "成员属性";

static String s2 = "

- Hibernate与mybitas的比较

BlueSkator

sqlHibernate框架ibatisorm

第一章 Hibernate与MyBatis

Hibernate 是当前最流行的O/R mapping框架,它出身于sf.net,现在已经成为Jboss的一部分。 Mybatis 是另外一种优秀的O/R mapping框架。目前属于apache的一个子项目。

MyBatis 参考资料官网:http:

- php多维数组排序以及实际工作中的应用

dcj3sjt126com

PHPusortuasort

自定义排序函数返回false或负数意味着第一个参数应该排在第二个参数的前面, 正数或true反之, 0相等usort不保存键名uasort 键名会保存下来uksort 排序是对键名进行的

<!doctype html>

<html lang="en">

<head>

<meta charset="utf-8&q

- DOM改变字体大小

周华华

前端

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/1999/xhtml&q

- c3p0的配置

g21121

c3p0

c3p0是一个开源的JDBC连接池,它实现了数据源和JNDI绑定,支持JDBC3规范和JDBC2的标准扩展。c3p0的下载地址是:http://sourceforge.net/projects/c3p0/这里可以下载到c3p0最新版本。

以在spring中配置dataSource为例:

<!-- spring加载资源文件 -->

<bean name="prope

- Java获取工程路径的几种方法

510888780

java

第一种:

File f = new File(this.getClass().getResource("/").getPath());

System.out.println(f);

结果:

C:\Documents%20and%20Settings\Administrator\workspace\projectName\bin

获取当前类的所在工程路径;

如果不加“

- 在类Unix系统下实现SSH免密码登录服务器

Harry642

免密ssh

1.客户机

(1)执行ssh-keygen -t rsa -C "xxxxx@xxxxx.com"生成公钥,xxx为自定义大email地址

(2)执行scp ~/.ssh/id_rsa.pub root@xxxxxxxxx:/tmp将公钥拷贝到服务器上,xxx为服务器地址

(3)执行cat

- Java新手入门的30个基本概念一

aijuans

javajava 入门新手

在我们学习Java的过程中,掌握其中的基本概念对我们的学习无论是J2SE,J2EE,J2ME都是很重要的,J2SE是Java的基础,所以有必要对其中的基本概念做以归纳,以便大家在以后的学习过程中更好的理解java的精髓,在此我总结了30条基本的概念。 Java概述: 目前Java主要应用于中间件的开发(middleware)---处理客户机于服务器之间的通信技术,早期的实践证明,Java不适合

- Memcached for windows 简单介绍

antlove

javaWebwindowscachememcached

1. 安装memcached server

a. 下载memcached-1.2.6-win32-bin.zip

b. 解压缩,dos 窗口切换到 memcached.exe所在目录,运行memcached.exe -d install

c.启动memcached Server,直接在dos窗口键入 net start "memcached Server&quo

- 数据库对象的视图和索引

百合不是茶

索引oeacle数据库视图

视图

视图是从一个表或视图导出的表,也可以是从多个表或视图导出的表。视图是一个虚表,数据库不对视图所对应的数据进行实际存储,只存储视图的定义,对视图的数据进行操作时,只能将字段定义为视图,不能将具体的数据定义为视图

为什么oracle需要视图;

&

- Mockito(一) --入门篇

bijian1013

持续集成mockito单元测试

Mockito是一个针对Java的mocking框架,它与EasyMock和jMock很相似,但是通过在执行后校验什么已经被调用,它消除了对期望 行为(expectations)的需要。其它的mocking库需要你在执行前记录期望行为(expectations),而这导致了丑陋的初始化代码。

&nb

- 精通Oracle10编程SQL(5)SQL函数

bijian1013

oracle数据库plsql

/*

* SQL函数

*/

--数字函数

--ABS(n):返回数字n的绝对值

declare

v_abs number(6,2);

begin

v_abs:=abs(&no);

dbms_output.put_line('绝对值:'||v_abs);

end;

--ACOS(n):返回数字n的反余弦值,输入值的范围是-1~1,输出值的单位为弧度

- 【Log4j一】Log4j总体介绍

bit1129

log4j

Log4j组件:Logger、Appender、Layout

Log4j核心包含三个组件:logger、appender和layout。这三个组件协作提供日志功能:

日志的输出目标

日志的输出格式

日志的输出级别(是否抑制日志的输出)

logger继承特性

A logger is said to be an ancestor of anothe

- Java IO笔记

白糖_

java

public static void main(String[] args) throws IOException {

//输入流

InputStream in = Test.class.getResourceAsStream("/test");

InputStreamReader isr = new InputStreamReader(in);

Bu

- Docker 监控

ronin47

docker监控

目前项目内部署了docker,于是涉及到关于监控的事情,参考一些经典实例以及一些自己的想法,总结一下思路。 1、关于监控的内容 监控宿主机本身

监控宿主机本身还是比较简单的,同其他服务器监控类似,对cpu、network、io、disk等做通用的检查,这里不再细说。

额外的,因为是docker的

- java-顺时针打印图形

bylijinnan

java

一个画图程序 要求打印出:

1.int i=5;

2.1 2 3 4 5

3.16 17 18 19 6

4.15 24 25 20 7

5.14 23 22 21 8

6.13 12 11 10 9

7.

8.int i=6

9.1 2 3 4 5 6

10.20 21 22 23 24 7

11.19

- 关于iReport汉化版强制使用英文的配置方法

Kai_Ge

iReport汉化英文版

对于那些具有强迫症的工程师来说,软件汉化固然好用,但是汉化不完整却极为头疼,本方法针对iReport汉化不完整的情况,强制使用英文版,方法如下:

在 iReport 安装路径下的 etc/ireport.conf 里增加红色部分启动参数,即可变为英文版。

# ${HOME} will be replaced by user home directory accordin

- [并行计算]论宇宙的可计算性

comsci

并行计算

现在我们知道,一个涡旋系统具有并行计算能力.按照自然运动理论,这个系统也同时具有存储能力,同时具备计算和存储能力的系统,在某种条件下一般都会产生意识......

那么,这种概念让我们推论出一个结论

&nb

- 用OpenGL实现无限循环的coverflow

dai_lm

androidcoverflow

网上找了很久,都是用Gallery实现的,效果不是很满意,结果发现这个用OpenGL实现的,稍微修改了一下源码,实现了无限循环功能

源码地址:

https://github.com/jackfengji/glcoverflow

public class CoverFlowOpenGL extends GLSurfaceView implements

GLSurfaceV

- JAVA数据计算的几个解决方案1

datamachine

javaHibernate计算

老大丢过来的软件跑了10天,摸到点门道,正好跟以前攒的私房有关联,整理存档。

-----------------------------华丽的分割线-------------------------------------

数据计算层是指介于数据存储和应用程序之间,负责计算数据存储层的数据,并将计算结果返回应用程序的层次。J

&nbs

- 简单的用户授权系统,利用给user表添加一个字段标识管理员的方式

dcj3sjt126com

yii

怎么创建一个简单的(非 RBAC)用户授权系统

通过查看论坛,我发现这是一个常见的问题,所以我决定写这篇文章。

本文只包括授权系统.假设你已经知道怎么创建身份验证系统(登录)。 数据库

首先在 user 表创建一个新的字段(integer 类型),字段名 'accessLevel',它定义了用户的访问权限 扩展 CWebUser 类

在配置文件(一般为 protecte

- 未选之路

dcj3sjt126com

诗

作者:罗伯特*费罗斯特

黄色的树林里分出两条路,

可惜我不能同时去涉足,

我在那路口久久伫立,

我向着一条路极目望去,

直到它消失在丛林深处.

但我却选了另外一条路,

它荒草萋萋,十分幽寂;

显得更诱人,更美丽,

虽然在这两条小路上,

都很少留下旅人的足迹.

那天清晨落叶满地,

两条路都未见脚印痕迹.

呵,留下一条路等改日再

- Java处理15位身份证变18位

蕃薯耀

18位身份证变15位15位身份证变18位身份证转换

15位身份证变18位,18位身份证变15位

>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>>

蕃薯耀 201

- SpringMVC4零配置--应用上下文配置【AppConfig】

hanqunfeng

springmvc4

从spring3.0开始,Spring将JavaConfig整合到核心模块,普通的POJO只需要标注@Configuration注解,就可以成为spring配置类,并通过在方法上标注@Bean注解的方式注入bean。

Xml配置和Java类配置对比如下:

applicationContext-AppConfig.xml

<!-- 激活自动代理功能 参看:

- Android中webview跟JAVASCRIPT中的交互

jackyrong

JavaScripthtmlandroid脚本

在android的应用程序中,可以直接调用webview中的javascript代码,而webview中的javascript代码,也可以去调用ANDROID应用程序(也就是JAVA部分的代码).下面举例说明之:

1 JAVASCRIPT脚本调用android程序

要在webview中,调用addJavascriptInterface(OBJ,int

- 8个最佳Web开发资源推荐

lampcy

编程Web程序员

Web开发对程序员来说是一项较为复杂的工作,程序员需要快速地满足用户需求。如今很多的在线资源可以给程序员提供帮助,比如指导手册、在线课程和一些参考资料,而且这些资源基本都是免费和适合初学者的。无论你是需要选择一门新的编程语言,或是了解最新的标准,还是需要从其他地方找到一些灵感,我们这里为你整理了一些很好的Web开发资源,帮助你更成功地进行Web开发。

这里列出10个最佳Web开发资源,它们都是受

- 架构师之面试------jdk的hashMap实现

nannan408

HashMap

1.前言。

如题。

2.详述。

(1)hashMap算法就是数组链表。数组存放的元素是键值对。jdk通过移位算法(其实也就是简单的加乘算法),如下代码来生成数组下标(生成后indexFor一下就成下标了)。

static int hash(int h)

{

h ^= (h >>> 20) ^ (h >>>

- html禁止清除input文本输入缓存

Rainbow702

html缓存input输入框change

多数浏览器默认会缓存input的值,只有使用ctl+F5强制刷新的才可以清除缓存记录。

如果不想让浏览器缓存input的值,有2种方法:

方法一: 在不想使用缓存的input中添加 autocomplete="off";

<input type="text" autocomplete="off" n

- POJO和JavaBean的区别和联系

tjmljw

POJOjava beans

POJO 和JavaBean是我们常见的两个关键字,一般容易混淆,POJO全称是Plain Ordinary Java Object / Pure Old Java Object,中文可以翻译成:普通Java类,具有一部分getter/setter方法的那种类就可以称作POJO,但是JavaBean则比 POJO复杂很多, Java Bean 是可复用的组件,对 Java Bean 并没有严格的规

- java中单例的五种写法

liuxiaoling

java单例

/**

* 单例模式的五种写法:

* 1、懒汉

* 2、恶汉

* 3、静态内部类

* 4、枚举

* 5、双重校验锁

*/

/**

* 五、 双重校验锁,在当前的内存模型中无效

*/

class LockSingleton

{

private volatile static LockSingleton singleton;

pri