Kafka API和监控

API

Producer API

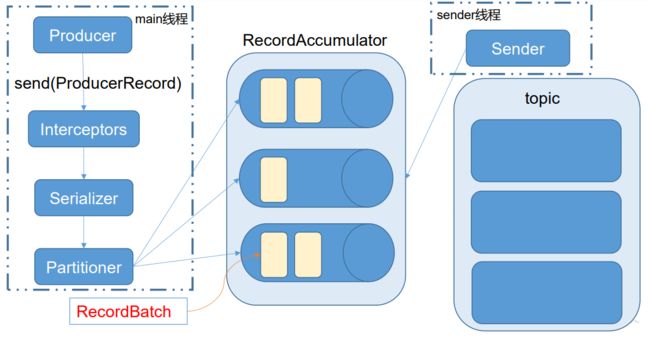

消息发送流程

Kafka 的 Producer 发送消息采用的是异步发送的方式。在消息发送的过程中,涉及到了两个线程——main 线程和 Sender 线程,以及一个线程共享变量——RecordAccumulator。main 线程将消息发送给 RecordAccumulator,Sender 线程不断从 RecordAccumulator 中拉取消息发送到 Kafka broker。

相关参数:

batch.size:只有数据积累到 batch.size 之后,sender 才会发送数据。

linger.ms:如果数据迟迟未达到 batch.size,sender 等待 linger.time 之后就会发送数据。

异步发送 API

1)导入依赖

<dependency>

<groupId>org.apache.kafkagroupId>

<artifactId>kafka-clientsartifactId>

<version>0.11.0.0version>

dependency>

2)编写代码

需要用到的类:

KafkaProducer:需要创建一个生产者对象,用来发送数据

ProducerConfig:获取所需的一系列配置参数

ProducerRecord:每条数据都要封装成一个 ProducerRecord 对象

1.不带回调函数的 API

package kafka.producer;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.Producer;

import org.apache.kafka.clients.producer.ProducerRecord;

import java.util.Properties;

public class MyProducer {

public static void main(String[] args) {

// 1. 创建kafka生产者的配置信息

Properties properties = new Properties();

// 2. 指定连接的kafka集群

properties.put("bootstrap.servers", "h1:9092");

// 3. ACK应答级别

properties.put("acks", "all");

// 4.重试次数

properties.put ("retries", 1);

// 5. 批次大小 16k

properties.put ("batch.size", 16384);

// 6. 等待时间 1毫秒

properties.put ("linger.ms", 1);

// 7. RecordAccumulator缓冲区大小 32M

properties.put ("buffer.memory", 33554432);

// 8. Key,Value的序列化类

properties.put("key.serializer","org.apache.kafka.common.serialization.StringSerializer");

properties .put ("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

// 9. 创建生产者对象

Producer<String, String> producer = new KafkaProducer<String, String>(properties);

// 10. 发送数据

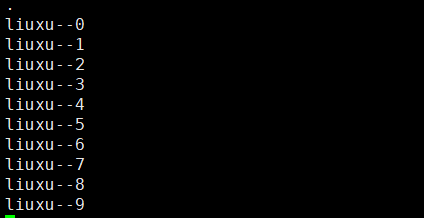

for (int i = 0; i < 10; i++){

producer.send(new ProducerRecord<String, String>("first","liuxu--"+i));

}

// 11. 关闭资源

producer.close();

}

}

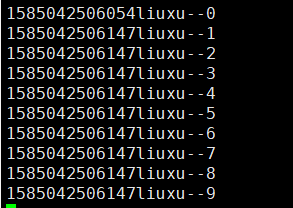

运行结果:

2.带回调函数的API

package kafka.producer;

import org.apache.kafka.clients.producer.*;

import org.apache.kafka.clients.producer.ProducerConfig;

import java.util.Properties;

public class CallBackProducer {

public static void main(String[] args) {

// 创建配置信息

Properties properties = new Properties();

properties.put(ProducerConfig.BOOTSTRAP_SERVERS_CONFIG,"h1:9092");

// 序列化类

properties.put(ProducerConfig.KEY_SERIALIZER_CLASS_CONFIG,"org.apache.kafka.common.serialization.StringSerializer");

properties.put(ProducerConfig.VALUE_SERIALIZER_CLASS_CONFIG,"org.apache.kafka.common.serialization.StringSerializer");

// 创建生产者对象

KafkaProducer<String, String> producer = new KafkaProducer<String, String>(properties);

// 发送数据

for (int i = 0; i<10; i++){

producer.send(new ProducerRecord<String, String>("first", "liuxu-" + i), new Callback() {

public void onCompletion(RecordMetadata recordMetadata, Exception e) {

if(e == null){

System.out.println(recordMetadata.partition()+"--"+recordMetadata.offset());

} else {

e.printStackTrace();

}

}

});

}

// 关闭资源

producer.close();

}

}

3.自定义分区

编写一个MyPartitoner类

package kafka.partitioner;

import org.apache.kafka.clients.producer.Partitioner;

import org.apache.kafka.common.Cluster;

import java.util.Map;

public class MyPartitioner implements Partitioner {

public int partition(String s, Object o, byte[] bytes, Object o1, byte[] bytes1, Cluster cluster) {

// 这里写相应的逻辑

return 0;

}

public void close() {

}

public void configure(Map<String, ?> map) {

}

}

调用方法

// 引号里面是全类名

properties.put(ProducerConfig.PARTITIONER_CLASS_CONFIG,"kafka.partitioner.MyPartitioner");

同步发送 API

同步发送的意思就是,一条消息发送之后,会阻塞当前线程,直至返回 ack。

由于 send 方法返回的是一个 Future 对象,根据 Futrue 对象的特点,我们也可以实现同步发送的效果,只需在调用 Future 对象的 get 方发即可。

producer.send(new ProducerRecord<String, String>("first","liuxu--"+i)).get();

Consumer API

Consumer 消费数据时的可靠性是很容易保证的,因为数据在 Kafka 中是持久化的,故不用担心数据丢失问题。

由于 consumer 在消费过程中可能会出现断电宕机等故障,consumer 恢复后,需要从故障前的位置的继续消费,所以 consumer 需要实时记录自己消费到了哪个 offset,以便故障恢复后继续消费。

所以 offset 的维护是 Consumer 消费数据是必须考虑的问题。

获取订阅数据

自动提交offset

package kafka.consumer;

import org.apache.kafka.clients.consumer.ConsumerConfig;

import org.apache.kafka.clients.consumer.ConsumerRecord;

import org.apache.kafka.clients.consumer.ConsumerRecords;

import org.apache.kafka.clients.consumer.KafkaConsumer;

import java.util.Arrays;

import java.util.Properties;

public class MyConsumer {

public static void main(String[] args) {

// 创建消费者配置信息

Properties properties = new Properties();

// 给配置信息赋值

// 连接的集群

properties.put(ConsumerConfig.BOOTSTRAP_SERVERS_CONFIG,"h1:9092");

// 开启自动提交

// 如果不自动提交,则不会保留offset,那么每一次启动都会拉取之前的数据

properties.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG,true);

// 自动提交的延迟

properties.put(ConsumerConfig.AUTO_COMMIT_INTERVAL_MS_CONFIG,"1000");

// Key,Value的反序列化

properties.put(ConsumerConfig.KEY_DESERIALIZER_CLASS_CONFIG,"org.apache.kafka.common.serialization.StringDeserializer");

properties.put(ConsumerConfig.VALUE_DESERIALIZER_CLASS_CONFIG,"org.apache.kafka.common.serialization.StringDeserializer");

// 消费者组

properties.put(ConsumerConfig.GROUP_ID_CONFIG,"bigdata");

// 创建消费者

KafkaConsumer<String, String> consumer = new KafkaConsumer<String, String>(properties);

// 订阅主题

consumer.subscribe(Arrays.asList("first","second"));

while (true){

// 获取数据

ConsumerRecords<String, String> consumerRecords = consumer.poll(100);

// 解析并打印consumerRecords

for (ConsumerRecord<String,String> consumerRecord: consumerRecords) {

System.out.println(consumerRecord.topic() + "--" + consumerRecord.key() + "--" + consumerRecord.value());

}

}

}

}

重置offset

这只在两种情况下生效,更换消费者组和之前保留的数据过期

// 重置消费者的offset

properties.put(ConsumerConfig.AUTO_OFFSET_RESET_CONFIG,"earliest");

手动提交offset

虽然自动提交 offset 十分简介便利,但由于其是基于时间提交的,开发人员难以把握offset 提交的时机。因此 Kafka 还提供了手动提交 offset 的 API。

手动提交 offset 的方法有两种:分别是 commitSync(同步提交)和 commitAsync(异步提交)。两者的相同点是,都会将**本次 poll 的一批数据最高的偏移量提交**;不同点是,commitSync 阻塞当前线程,一直到提交成功,并且会自动失败重试(由不可控因素导致,也会出现提交失败);而 commitAsync 则没有失败重试机制,故有可能提交失败。手动提交offset

同步提交

// 关闭自动提交

properties.put(ConsumerConfig.ENABLE_AUTO_COMMIT_CONFIG,false);

// 在拉取完数据之后写

// 同步提交,当前线程会阻塞知道offset提交成功

consumer.commitSync();

异步提交

虽然同步提交 offset 更可靠一些,但是由于其会阻塞当前线程,直到提交成功。因此吞

吐量会收到很大的影响。因此更多的情况下,会选用异步提交 offset 的方式。

consumer.commitAsync();

无论是手动提交offset还是自动提交offset,都是在获取完数据之后进行的。所以一定不会丢数据,但是万一在提交offset的时候宕机了,则再次启动的时候会造成数据重复。

自定义Interceptor

拦截器原理

Producer 拦截器(interceptor)是在 Kafka 0.10 版本被引入的,主要用于实现 clients 端的定制化控制逻辑。

对于 producer 而言,interceptor 使得用户在消息发送前以及 producer 回调逻辑前有机会对消息做一些定制化需求,比如修改消息等。同时,producer 允许用户指定多个 interceptor按序作用于同一条消息从而形成一个拦截链(interceptor chain)。Intercetpor 的实现接口是org.apache.kafka.clients.producer.ProducerInterceptor,其定义的方法包括:

(1)configure(configs)

获取配置信息和初始化数据时调用。

(2)onSend(ProducerRecord):

该方法封装进 KafkaProducer.send 方法中,即它运行在用户主线程中。Producer 确保在消息被序列化以及计算分区前调用该方法。用户可以在该方法中对消息做任何操作,但最好保证不要修改消息所属的 topic 和分区,否则会影响目标分区的计算。

(3)onAcknowledgement(RecordMetadata, Exception):

该方法会在消息从 RecordAccumulator 成功发送到 Kafka Broker 之后,或者在发送过程中失败时调用。并且通常都是在 producer 回调逻辑触发之前。onAcknowledgement 运行在producer 的 IO 线程中,因此不要在该方法中放入很重的逻辑,否则会拖慢 producer 的消息发送效率。

(4)close:

关闭 interceptor,主要用于执行一些资源清理工作

如前所述,interceptor 可能被运行在多个线程中,因此在具体实现时用户需要自行确保线程安全。另外倘若指定了多个 interceptor,则 producer 将按照指定顺序调用它们,并仅仅是捕获每个 interceptor 可能抛出的异常记录到错误日志中而非在向上传递。这在使用过程中要特别留意。

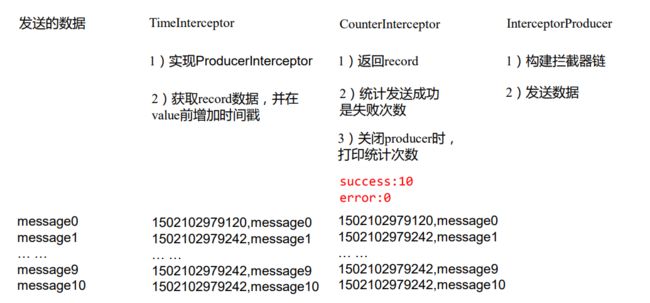

拦截器案例

1)需求:

实现一个简单的双 interceptor 组成的拦截链。第一个 interceptor 会在消息发送前将时间戳信息加到消息 value 的最前部;第二个 interceptor 会在消息发送后更新成功发送消息数或失败发送消息数。

2)案例实操

(1)增加时间戳拦截器

package kafka.interceptor;

import org.apache.kafka.clients.producer.ProducerInterceptor;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.clients.producer.RecordMetadata;

import java.util.Map;

public class TimeInterceptor implements ProducerInterceptor {

public void configure(Map<String, ?> map) {

}

public ProducerRecord<String,String> onSend(ProducerRecord producerRecord) {

// 取出数据

String value = (String) producerRecord.value();

// 创建一个新的对象并返回

return new ProducerRecord<String, String>(producerRecord.topic(),

producerRecord.partition(), (String) producerRecord.key(),System.currentTimeMillis()+','+value);

}

public void onAcknowledgement(RecordMetadata recordMetadata, Exception e) {

}

public void close() {

}

}

(2)统计发送消息成功和发送失败消息数,并在 producer 关闭时打印这两个计数器

package kafka.interceptor;

import org.apache.kafka.clients.producer.ProducerInterceptor;

import org.apache.kafka.clients.producer.ProducerRecord;

import org.apache.kafka.clients.producer.RecordMetadata;

import java.util.Map;

public class CounterInterceptor implements ProducerInterceptor<String,String> {

int success;

int error;

public ProducerRecord<String, String> onSend(ProducerRecord<String, String> producerRecord) {

return producerRecord;

}

public void onAcknowledgement(RecordMetadata recordMetadata, Exception e) {

if(recordMetadata != null){

success++;

}else {

error++;

}

}

public void close() {

System.out.println("success:" + success);

System.out.println("error:" + error);

}

public void configure(Map<String, ?> map) {

}

}

(3)producer 主程序

package kafka.producer;

import org.apache.kafka.clients.producer.KafkaProducer;

import org.apache.kafka.clients.producer.Producer;

import org.apache.kafka.clients.producer.ProducerConfig;

import org.apache.kafka.clients.producer.ProducerRecord;

import java.util.ArrayList;

import java.util.Properties;

public class InterceptorProducer {

public static void main(String[] args) {

// 1. 创建kafka生产者的配置信息

Properties properties = new Properties();

// 2. 指定连接的kafka集群

properties.put("bootstrap.servers", "h1:9092");

// 3. ACK应答级别

properties.put("acks", "all");

// 4.重试次数

properties.put ("retries", 1);

// 5. 批次大小 16k

properties.put ("batch.size", 16384);

// 6. 等待时间 1毫秒

properties.put ("linger.ms", 1);

// 7. RecordAccumulator缓冲区大小 32M

properties.put ("buffer.memory", 33554432);

// 8. Key,Value的序列化类

properties.put("key.serializer","org.apache.kafka.common.serialization.StringSerializer");

properties .put ("value.serializer", "org.apache.kafka.common.serialization.StringSerializer");

// 添加拦截器

ArrayList<String> interceptors = new ArrayList<String>();

interceptors.add("kafka.interceptor.TimeInterceptor");

interceptors.add("kafka.interceptor.CounterInterceptor");

properties.put(ProducerConfig.INTERCEPTOR_CLASSES_CONFIG,interceptors);

// 9. 创建生产者对象

Producer<String, String> producer = new KafkaProducer<String, String>(properties);

// 10. 发送数据

for (int i = 0; i < 10; i++){

producer.send(new ProducerRecord<String, String>("first","bigdata","liuxu--"+i));

}

// 11. 关闭资源

producer.close();

}

}

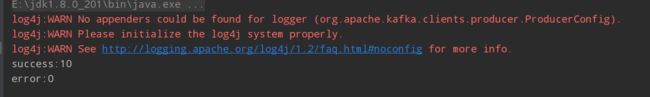

3)测试

(1)在 kafka 上启动消费者,然后运行客户端 java 程序。

Kafka 监控

Kafka Eagle

1.修改 kafka 启动命令

将 kafka-server-start.sh 命令中

if [ "x$KAFKA_HEAP_OPTS" = "x" ]; then

export KAFKA_HEAP_OPTS="-Xmx1G -Xms1G"

fi

改为

if [ "x$KAFKA_HEAP_OPTS" = "x" ]; then

export KAFKA_HEAP_OPTS="-server -Xms2G -Xmx2G -XX:PermSize=128m -XX:+UseG1GC -XX:MaxGCPauseMillis=200 -XX:ParallelGCThreads=8 -XX:ConcGCThreads=5 -XX:InitiatingHeapOccupancyPercent=70"

export JMX_PORT="9999"

#export KAFKA_HEAP_OPTS="-Xmx1G -Xms1G"

fi

注意:修改之后在启动 Kafka 之前要分发之其他节点

2.上传压缩包 kafka-eagle-bin-1.3.7.tar.gz 到集群/root/app目录

3.解压到本地

[root@h1 app]# tar -zxvf kafka-eagle-bin-1.3.7.tar.gz

4.进入目录

[root@h1 app]# cd kafka-eagle-bin-1.3.7/

5.再次解压

root@h1 kafka-eagle-bin-1.3.7]# tar -zxvf kafka-eagle-web-1.3.7-bin.tar.gz

6.改名

[root@h1 kafka-eagle-bin-1.3.7]# mv kafka-eagle-web-1.3.7 eagle

7.给启动文件执行权限

[root@h1 kafka-eagle-bin-1.3.7]# cd eagle/bin/

[root@h1 bin]# chmod 777 ke.sh

8.修改配置文件

conf目录下的system-config.properties

######################################

# multi zookeeper&kafka cluster list

######################################

kafka.eagle.zk.cluster.alias=cluster1

cluster1.zk.list=h:2181,h2:2181,h3:2181

######################################

# zk client thread limit

######################################

kafka.zk.limit.size=25

######################################

# kafka eagle webui port

######################################

kafka.eagle.webui.port=8048

######################################

# kafka offset storage

######################################

cluster1.kafka.eagle.offset.storage=kafka

######################################

# enable kafka metrics

######################################

kafka.eagle.metrics.charts=true

kafka.eagle.sql.fix.error=false

######################################

# kafka sql topic records max

######################################

kafka.eagle.sql.topic.records.max=5000

######################################

# delete kafka topic token

######################################

kafka.eagle.topic.token=keadmin

######################################

# kafka sasl authenticate

######################################

cluster1.kafka.eagle.sasl.enable=false

cluster1.kafka.eagle.sasl.protocol=SASL_PLAINTEXT

cluster1.kafka.eagle.sasl.mechanism=PLAIN

cluster1.kafka.eagle.sasl.jaas.config=org.apache.kafka.common.security.plain.PlainLoginModule required username="admin" password="kafka-eagle";

cluster2.kafka.eagle.sasl.enable=false

cluster2.kafka.eagle.sasl.protocol=SASL_PLAINTEXT

cluster2.kafka.eagle.sasl.mechanism=PLAIN

cluster2.kafka.eagle.sasl.jaas.config=org.apache.kafka.common.security.plain.PlainLoginModule required username="admin" password="kafka-eagle";

######################################

# kafka jdbc driver address

######################################

kafka.eagle.driver=com.mysql.jdbc.Driver

kafka.eagle.url=jdbc:mysql://h1:3306/ke?useUnicode=true&ch

aracterEncoding=UTF-8&zeroDateTimeBehavior=convertToNull

kafka.eagle.username=root

kafka.eagle.password=centos

9.配置环境变量

export KE_HOME=/root/app/kafka-eagle-bin-1.3.7/eagle

export PATH=$PATH:$KE_HOME/bin

注意别忘了source /etc/profile

10.启动

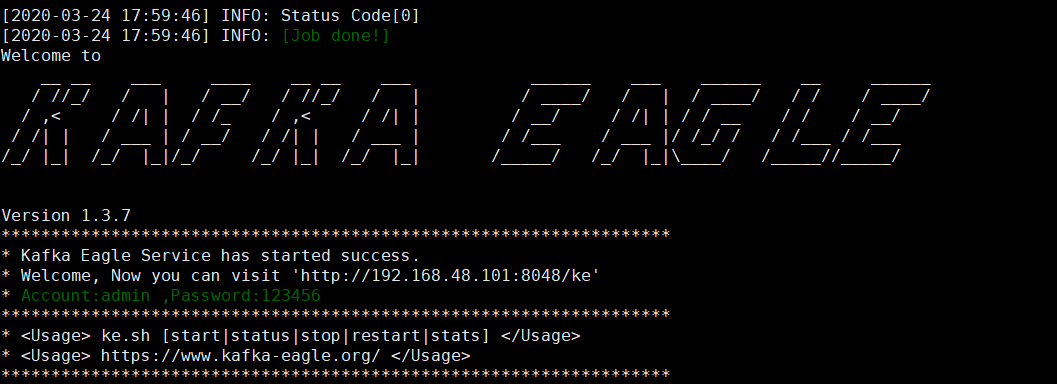

ke.sh start

注意:启动之前需要先启动 ZK 以及 KAFKA

11.登录页面查看监控数据

http://192.168.48.101:8048/ke

默认用户名密码是上面写的admin和123456