Hadoop学习(7)——Hive高级应用(1)

一、Hive案例

1.1、统计出掉线率最高的前10基站

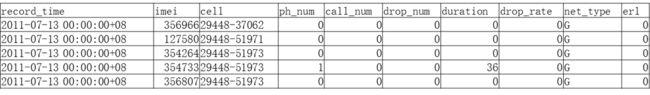

数据:

record_time:通话时间

imei:基站编号

cell:手机编号

drop_num:掉话的秒数

duration:通话持续总秒数(1)建表

create table cell_monitor(

record_time string,

imei string,

cell string,

ph_num int,

call_num int,

drop_num int,

duration int,

drop_rate DOUBLE,

net_type string,

erl string

)

ROW FORMAT DELIMITED FIELDS TERMINATED BY ','

STORED AS TEXTFILE;

结果表:

create table cell_drop_monitor(

imei string,

total_call_num int,

total_drop_num int,

d_rate DOUBLE

)

ROW FORMAT DELIMITED FIELDS TERMINATED BY '\t'

STORED AS TEXTFILE;

(2)load数据

LOAD DATA LOCAL INPATH '/opt/data/cdr_summ_imei_cell_info.csv' OVERWRITE INTO TABLE cell_monitor;

(3)找出掉线率最高的基站

from cell_monitor cm

insert overwrite table cell_drop_monitor

select cm.imei ,sum(cm.drop_num),sum(cm.duration),sum(cm.drop_num)/sum(cm.duration) d_rate

group by cm.imei

sort by d_rate desc;

1.2、统计字个数:WordCount

(1)建表

create table docs(line string);

create table wc(word string, totalword int);

(2)加载数据

load data local inpath '/tmp/wc' into table docs;

(3)统计

from (select explode(split(line, ' ')) as word from docs) w

insert into table wc

select word, count(1) as totalword

group by word

order by word;

(4)查询结果

select * from wc;

二、Hive 参数

2.1、hive 参数、变量命名

hive当中的参数、变量,都是以命名空间开头:

| 命名空间 |

读写权限 |

含义 |

| hiveconf |

可读写 |

hive-site.xml当中的各配置变量 例:hive --hiveconf hive.cli.print.header=true |

| system |

可读写 |

系统变量,包含JVM运行参数等 例:system:user.name=root |

| env |

只读 |

环境变量 例:env:JAVA_HOME |

| hivevar |

可读写 |

例:hive -d val=key |

通过${}方式进行引用,其中system、env下的变量必须以前缀开头

2.2、hive 参数设置方式

1、修改配置文件 ${HIVE_HOME}/conf/hive-site.xml

2、启动hive cli时,通过--hiveconf key=value的方式进行设置

例:hive --hiveconf hive.cli.print.header=true

3、进入cli之后,通过使用set命令设置

2.3、hive set命令

在hive CLI控制台可以通过set对hive中的参数进行查询、设置

set设置:

set hive.cli.print.header=true;

set查看

set hive.cli.print.header

hive参数初始化配置

当前用户家目录下的.hiverc文件

如: ~/.hiverc

如果没有,可直接创建该文件,将需要设置的参数写到该文件中,hive启动运行时,会加载改文件中的配置。

hive历史操作命令集

~/.hivehistory

三、Hive 分桶

3.1、什么是Hive分桶

分桶表是对列值取哈希值的方式,将不同数据放到不同文件中存储。

对于hive中每一个表、分区都可以进一步进行分桶。

由列的哈希值除以桶的个数来决定每条数据划分在哪个桶中适用场景:数据抽样( sampling )

3.2、分桶设置

(1)开启支持分桶

set hive.enforce.bucketing=true;默认:false;设置为true之后,mr运行时会根据bucket的个数自动分配reduce task个数。(用户也可以通过mapred.reduce.tasks自己设置reduce任务个数,但分桶时不推荐使用)

注意:一次作业产生的桶(文件数量)和reduce task个数一致。

(2)往分桶表中加载数据

insert into table bucket_table select columns from tbl;

insert overwrite table bucket_table select columns from tbl;

(3)桶表 抽样查询

select * from bucket_table tablesample(bucket 1 out of 4 on columns);

(4)TABLESAMPLE语法:

TABLESAMPLE(BUCKET x OUT OF y)

x:表示从哪个bucket开始抽取数据

y:必须为该表总bucket数的倍数或因子

3.3、分桶案例

(1)

当表总bucket数为32时

TABLESAMPLE(BUCKET 3 OUT OF 8),抽取哪些数据?

共抽取2(32/16)个bucket的数据,抽取第2、第18(16+2)个bucket的数据

TABLESAMPLE(BUCKET 3 OUT OF 256),抽取哪些数据?

(2)

CREATE TABLE psn31( id INT, name STRING, age INT)

ROW FORMAT DELIMITED FIELDS TERMINATED BY ',';

测试数据:

1,tom,11

2,cat,22

3,dog,33

4,hive,44

5,hbase,55

6,mr,66

7,alice,77

8,scala,88

(3)

创建分桶表

CREATE TABLE psnbucket( id INT, name STRING, age INT)

CLUSTERED BY (age) INTO 4 BUCKETS

ROW FORMAT DELIMITED FIELDS TERMINATED BY ',';

加载数据:

insert into table psnbucket select id, name, age from psn31;

抽样

select id, name, age from psnbucket tablesample(bucket 2 out of 4 on age);