- PostgreSQL - pgvector 插件构建向量数据库并进行相似度查询

花千树-010

RAG数据库postgresqlAI编程

在现代的机器学习和人工智能应用中,向量相似度检索是一个非常重要的技术,尤其是在文本、图像或其他类型的嵌入向量的操作中。本文将介绍如何在PostgreSQL中安装pgvector插件,用于存储和检索向量数据,并展示如何通过Python脚本向数据库插入向量并执行相似度查询。一、安装PostgreSQL并配置pgvector插件1.安装PostgreSQL首先,确保你已经安装了PostgreSQL。可以

- 全面解析NVIDIA显卡:从入门级到旗舰级显卡详解

花千树-010

大模型人工智能算法智能电视

在选择显卡时,了解不同显卡的性能和适用场景是非常重要的。无论你是预算有限的入门用户,还是追求极致性能的游戏玩家,亦或是专业的内容创作者和深度学习研究人员,NVIDIA都有适合你的显卡。本篇博文将详细列举NVIDIA显卡的各项配置,从低到高逐一整理,并给出适用的使用场景。入门级显卡NVIDIAGeForceGT1030CUDA核心数:384基础频率:1227MHz加速频率:1468MHz显存:2GB

- 直播预告丨精度优于AlphaFold,基于深度学习实现生物大分子及其互作的三维结构预测

「MeetAI4S」系列直播第6期将于1月15日19:00准时开播,HyperAI超神经有幸邀请到了南开大学统计与数据科学学院教授郑伟,他本次分享的主题是「AlphaFold3王座未稳,来自学术界的反超:基于深度学习的生物大分子及其互作的三维结构预测」。蛋白质的功能取决于其独特的三维结构,近年来,基于深度学习等人工智能技术的蛋白质结构预测发展迅猛,AlphaFold甚至获得了2024年诺贝尔化学奖

- AI代码生成工具的未来:杨立昆的洞见与AI革命

前端

近年来,人工智能(AI)领域取得了令人瞩目的进展,特别是以大型语言模型为代表的AI技术,在自然语言处理、图像生成等领域展现出强大的能力。然而,深度学习先驱杨立昆(YannLeCun)却对现有的AI系统提出了尖锐的批评,他认为目前的AI系统“理解能力远不如猫”,缺乏对真实世界的理解和常识。这引发了人们对AI未来发展方向的思考,也为我们探讨AI代码生成工具,以及AI技术对人类社会的影响提供了新的视角。

- 未来教育:AI知识库如何重塑学习体验

知识管理知识库知识库软件

在科技日新月异的今天,教育领域正经历着前所未有的变革。人工智能(AI)技术的快速发展,特别是AI知识库的广泛应用,正在重塑我们的学习体验,使之变得更加高效、个性化和智能化。本文将深入探讨AI知识库如何影响未来教育,以及它如何为学习者提供前所未有的学习体验。一、AI知识库:教育领域的智能助手AI知识库,作为结合了人工智能技术的知识管理系统,不仅能够存储和处理海量信息,还能通过自然语言处理、机器学习等

- 【TVM 教程】内联及数学函数

ApacheTVM是一个端到端的深度学习编译框架,适用于CPU、GPU和各种机器学习加速芯片。更多TVM中文文档可访问→https://tvm.hyper.ai/作者:TianqiChen尽管TVM支持基本的算术运算,但很多时候,也需要复杂的内置函数,例如exp取指函数。这些函数是依赖target系统的,并且在不同target平台中可能具有不同的名称。本教程会学习到如何调用这些target-spe

- mindspore编译报错

小乐快乐

深度学习神经网络

1、重新创建个工程后无法正常运行,2、使用代码为:华为提供的机器学习监督学习中的代码[quote][size=2][url=forum.php?mod=redirect&goto=findpost&pid=1364937&ptid=165780][color=#999999]回复:HS12发表于2021-10-3018:16[/color][/url][/size]报错信息

- ai照片放大python源码_AI新时代-大牛教你使用python+Opencv完成人脸解锁(附源码)...

weixin_39639505

ai照片放大python源码

好吧,伙计们,我回来了。说我拖更不写文章的可以过来用你的小拳拳狠命地捶我胸口....那么今天我们来讲关于使用python+opencv+face++来实现人脸验证及人脸解锁。代码量同样不多,你可以将这些代码运用在其它一些智能领域,如智能家居,进门的时候判断你是谁,也可以加入机器学习判断来的人是客人还是熟人。在讲之前我们会先适当的拓扑一下关于人脸识别的知识点。OK废话少说下面开始正是话题。解锁原理:

- 线性回归:从基础到进阶的全面解析

tester Jeffky

大模型线性回归机器学习算法

线性回归:从基础到进阶的全面解析线性回归是机器学习中最基本的算法之一,广泛应用于预测和分析。本文将详细介绍线性回归的基本概念、数学原理、实现方法以及在实际应用中的注意事项。我们将通过丰富的代码示例来展示如何从头开始构建一个简单的线性回归模型,并逐步深入到更复杂的场景。1.线性回归的基本概念1.1什么是线性回归?线性回归是一种用于建模两个或多个变量之间关系的统计方法。它假设因变量(目标变量)与一个或

- 基于YOLOv5、YOLOv8和YOLOv10的自助售货机商品检测:深度学习实践与应用

2025年数学建模美赛

YOLO深度学习人工智能目标跟踪目标检测

引言自助售货机已经成为现代零售和自动化销售领域的重要组成部分。在自助售货机中,商品的检测与管理至关重要。通过精准的商品检测技术,售货机可以在商品售出后自动更新库存,并提供准确的商品信息反馈。然而,在复杂的环境下进行商品检测是一个具有挑战性的问题,尤其是在商品种类繁多、摆放方式多样以及光照条件变化较大的情况下。近年来,基于深度学习的目标检测算法,特别是YOLO(YouOnlyLookOnce)系列模

- 【分类】【损失函数】处理类别不平衡:CEFL 和 CEFL2 损失函数的实现与应用

丶2136

AI分类人工智能损失函数

引言在深度学习中的分类问题中,类别不平衡问题是常见的挑战之一。尤其在面部表情分类任务中,不同表情类别的样本数量可能差异较大,比如“开心”表情的样本远远多于“生气”表情。面对这种情况,普通的交叉熵损失函数容易导致模型过拟合到大类样本,忽略少数类样本。为了有效解决类别不平衡问题,Class-balancedExponentialFocalLoss(CEFL)和Class-balancedExponen

- 交叉熵损失函数(Cross-Entropy Loss)

我叫罗泽南

深度学习人工智能

原理交叉熵损失函数是深度学习中分类问题常用的损失函数,特别适用于多分类问题。它通过度量预测分布与真实分布之间的差异,来衡量模型输出的准确性。交叉熵的数学公式交叉熵的定义如下:CrossEntroyLoss=−∑i=1Nyi⋅log(y^i)\begin{equation}CrossEntroyLoss=-\sum_{i=1}^{N}y_i\cdotlog(\hat{y}_i)\end{equati

- 什么是多模态机器学习:跨感知融合的智能前沿

非凡暖阳

人工智能神经网络

在人工智能的广阔天地里,多模态机器学习(MultimodalMachineLearning)作为一项前沿技术,正逐步解锁人机交互和信息理解的新境界。它超越了单一感官输入的限制,通过整合视觉、听觉、文本等多种数据类型,构建了一个更加丰富、立体的认知模型,为机器赋予了接近人类的综合感知与理解能力。本文将深入探讨多模态机器学习的定义、核心原理、关键技术、面临的挑战以及未来的应用前景,旨在为读者勾勒出这一

- AI大模型如何赋能电商行业,引领变革

虞书欣的C

人工智能开发语言

•个性化推荐:利用机器学习算法分析用户的历史购买记录、浏览行为和喜好,生成个性化的产品推荐列表,提升用户的购买意愿和满意度。•优化用户体验:•智能搜索引擎:运用自然语言处理技术,优化搜索引擎,让用户能够通过自然语言进行搜索。•虚拟客服:通过聊天机器人和语音助手,提供24/7的客户支持,快速解答用户咨询。•图像识别:利用计算机视觉技术,用户可以通过拍照识别商品,快速找到相似商品或进行排版搭配推荐。•

- AI大模型引领医疗变革:十大创新应用场景塑造智慧医疗新时代

和老莫一起学AI

人工智能自动化数据库学习语言模型大模型

前言在人工智能技术的迅猛发展中,AI大模型以其无与伦比的数据处理能力和深度学习能力,正逐步成为医疗健康领域变革的引领者。本文旨在深入探讨AI大模型在医疗领域的十大创新应用场景,展示其如何显著提升医疗服务效率、赋能临床决策,并推动整个行业向智能化转型。一、智能化诊疗:精准辅助,提升诊断效率AI大模型凭借对海量医疗数据的深度分析,能够协助医生进行更为精准的诊断。例如,百度灵医大模型凭借强大的数据处理能

- 技术文档的精髓:规划布局、语言表达与更新维护

重庆钢铁侠

经验分享

本文将从技术文档的规划布局、语言表达以及更新与维护三个方面入手,探讨如何打造一份出色的技术文档,确保信息的系统性、连贯性以及时效性。一:技术文档的规划布局1.1确定文档的整体架构技术文档的规划布局是确保信息呈现系统性和连贯性的关键。首先,需要确定文档的整体架构,这包括章节设置和逻辑顺序。一个好的架构应该能够清晰地指导读者从入门到精通。章节设置:根据文档的目的和受众,合理设置章节。例如,对于深度学习

- 数学:机器学习的理论基石

每天五分钟玩转人工智能

机器学习人工智能

一、数学:机器学习的理论基石机器学习是一种通过数据学习模式和规律的科学。其核心目标是从数据中提取有用的信息,以便对未知数据进行预测和分类。为了实现这一目标,机器学习需要一种数学框架来描述和解决问题。数学在机器学习中起着至关重要的作用,它提供了一种数学模型来描述数据和模式,以及一种数学方法来优化模型。数学在机器学习中的应用非常广泛,涵盖了线性代数、概率论、统计学、微积分、优化等多个领域。这些数学方法

- 【机器学习:二十六、决策树】

KeyPan

机器学习机器学习决策树人工智能算法深度学习数据挖掘

1.决策树概述决策树是一种基于树状结构的监督学习算法,既可以用于分类任务,也可以用于回归任务。其主要通过递归地将数据划分为子集,从而生成一个具有条件结构的树模型。核心概念节点(Node):每个节点表示一个特定的决策条件。根节点(RootNode):树的起点,包含所有样本。分支(Branch):每个分支代表一个条件划分的结果。叶节点(LeafNode):终止节点,表示最终的决策结果。优点直观可解释:

- 基于深度学习的推荐系统构建:Movielens 数据集

fresh的转码之路

深度学习人工智能机器学习推荐算法

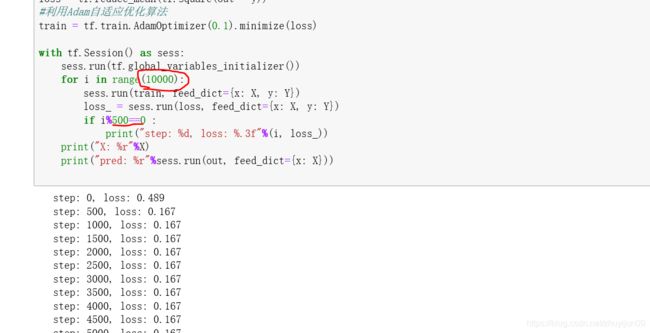

基于深度学习的推荐系统构建:Movielens数据集依赖环境代码语言:python3.11.5开发平台:pycharmtensorflow版本:2.18.0MovieLen1M数据及简介MovieLens1M数据集包含包含6000个用户在近4000部电影上的100万条评分,也包括电影元数据信息和用户属性信息。下载地址为:http://files.grouplens.org/datasets/mov

- 机器学习数学基础-极值和最值

华东算法王(原聪明的小孩子

小孩哥解析宋浩微积分机器学习算法人工智能

极值和最值极值和最值是数学中关于函数变化的重要概念,它们描述了函数在某些点附近或在整个定义域内的“最大”或“最小”行为。理解极值和最值对优化问题、函数分析、物理建模等领域有重要的应用。1.极值(LocalExtrema)极值是指函数在某个区间内的某一点取得的局部最大值或最小值。(1)局部最大值(LocalMaximum)一个函数在某点(x=c)取得局部最大值,意味着存在一个包含(c)的小区间,使得

- 17-7 向量数据库之野望7 - PostgreSQL 和pgvector

拉达曼迪斯II

AIGC学习数据库管理工具AI创业数据库postgresql人工智能机器学习AIGC搜索引擎

PostgreSQL是一款功能强大的开源对象关系数据库系统,它已将其功能扩展到传统数据管理之外,通过pgvector扩展支持矢量数据。这一新增功能满足了对高效处理高维矢量数据日益增长的需求,这些数据通常用于机器学习、自然语言处理(NLP)和推荐系统等应用。https://github.com/mazzasaverio/find-your-opensource-project什么是pgvector?

- 海外抖音技术深度解析:算法、AI与全球化的挑战

神探阿航

计算机产业科普与思考算法人工智能机器学习数据挖掘深度学习

引言2025年1月19日,在美国宣布暂停服务,这一事件引发了全球用户的广泛关注。作为全球最受欢迎的短视频平台之一,其成功离不开其强大的技术支撑,尤其是其个性化推荐算法和AI驱动的创作工具。然而,随着全球市场环境的变化,它面临的技术与运营挑战也日益凸显。本文将深入分析其技术核心、全球化运营中的挑战及其未来发展方向。核心:个性化推荐引擎其算法是其成功的关键,其核心在于个性化推荐引擎。该引擎采用深度学习

- YOLOv8与Transformer:探索目标检测的新架构

AI架构设计之禅

AI大模型应用入门实战与进阶大数据AI人工智能计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

YOLOv8与Transformer:探索目标检测的新架构关键词:目标检测,深度学习,YOLOv8,Transformer,计算机视觉,卷积神经网络摘要:目标检测是计算机视觉领域的一项重要任务,其目标是从图像或视频中识别和定位特定对象。近年来,YOLO(YouOnlyLookOnce)系列算法以其高精度和高速度成为目标检测领域的佼佼者。最新版本的YOLOv8引入了Transformer架构,进一步

- 图像生成大模型:Imagen 详解

转角再相遇

imagenpython深度学习计算机视觉

近年来,图像生成技术取得了显著进展,推动了计算机视觉和生成对抗网络(GAN)等领域的发展。Imagen是一个新兴的图像生成大模型,其在生成高质量、逼真图像方面表现出色。本文将详细讲解Imagen的基本原理、架构、训练流程及应用场景。1.Imagen的基本原理1.1什么是Imagen?Imagen是一种基于深度学习的图像生成模型,结合了自注意力机制(Self-attentionMechanism)和

- 【MySQL】Mysql数据库导入导出sql文件、备份数据库、迁移数据库

程序员洲洲

数据库数据库mysql导入导出sqlsql文件备份迁移

本文摘要:本文提出了xxx的实用开发小技巧。作者介绍:我是程序员洲洲,一个热爱写作的非著名程序员。CSDN全栈优质领域创作者、华为云博客社区云享专家、阿里云博客社区专家博主。同时欢迎大家关注其他专栏,我将分享Web前后端开发、人工智能、机器学习、深度学习从0到1系列文章。同时洲洲已经建立了程序员技术交流群,如果您感兴趣,可以私信我加入我的社群,也可以直接vx联系(文末有名片)v:bdizztt随时

- 实战千问2大模型第五天——VLLM 运行 Qwen2-VL-7B(多模态)

学术菜鸟小晨

千问多模型qwen2vl

一、简介VLLM是一种高效的深度学习推理库,通过PagedAttention算法有效管理大语言模型的注意力内存,其特点包括24倍的吞吐提升和3.5倍的TGI性能,无需修改模型结构,专门设计用于加速大规模语言模型(LLM)的推理过程。它通过优化显存管理、支持大模型的批处理推理以及减少不必要的内存占用,来提高多GPU环境下的推理速度和效率。VLLM的核心特点包括:显存高效性:VLLM能够动态管理显存,

- qwenvl 代码中的attention pool 注意力池如何理解,attention pool注意力池是什么?

OpenSani

AI大模型计算机视觉语言模型qwenvlLLM

qwenvl中的attentionpool如何理解,其实这就是一个概念的问题看qwenvl的huggingface的代码的时候,发现代码里有一个Resampler以及attn_pool,这和之前理解的连接池线程池表示资源复用的意思不太一样,查了一下:注意这里的pool和线程池连接池里面的pool不一样:深度学习中的池化:池化在深度学习中主要指通过滑动窗口对特征图进行下采样,提取最重要的特征,减少计

- tf.function-> AttributeError: ‘double‘ object has no attribute ‘shape‘

乔宇同学

学习tensorflow

跑tensorflow时出现的bug,不使用tf.function没问题,一旦挂上装饰符,就报错,报错内容如下:Traceback(mostrecentcalllast):File"D:\Anaconda3\envs\tensorflow2\lib\site-packages\tensorflow_core\python\eager\function.py",line111,in_make_inp

- 计算机视觉与深度学习:使用深度学习训练基于视觉的车辆检测器(MATLAB源码-Faster R-CNN)

ZhShy23

javascript深度学习

在人工智能领域,计算机视觉是一个重要且充满活力的研究方向。它使计算机能够理解和分析图像和视频数据,从而做出有意义的决策。其中,目标检测是计算机视觉中的一项关键技术,它旨在识别并定位图像中的多个目标对象。车辆检测作为目标检测的一个重要应用,在自动驾驶、智能交通系统等领域有着广泛的应用前景。本文将介绍如何使用MATLAB和深度学习技术,特别是FasterR-CNN模型,来训练一个车辆检测器。文章目录一

- GAN在图像增强中的应用实战指南

码字仙子

本文还有配套的精品资源,点击获取简介:图像增强技术通过算法改善图像质量,GAN作为一种生成对抗网络,在此领域具有重要应用。通过生成器和判别器的对抗性训练,GAN可以生成逼真图像、修复低质量图像、扩增数据集并进行风格迁移。本项目将介绍如何使用Python及其相关库实现GAN图像增强,包括模型的构建、训练和评估。通过项目案例学习,你可以掌握GAN在图像增强中的实际应用,提高图像处理和深度学习的技能。1

- 枚举的构造函数中抛出异常会怎样

bylijinnan

javaenum单例

首先从使用enum实现单例说起。

为什么要用enum来实现单例?

这篇文章(

http://javarevisited.blogspot.sg/2012/07/why-enum-singleton-are-better-in-java.html)阐述了三个理由:

1.enum单例简单、容易,只需几行代码:

public enum Singleton {

INSTANCE;

- CMake 教程

aigo

C++

转自:http://xiang.lf.blog.163.com/blog/static/127733322201481114456136/

CMake是一个跨平台的程序构建工具,比如起自己编写Makefile方便很多。

介绍:http://baike.baidu.com/view/1126160.htm

本文件不介绍CMake的基本语法,下面是篇不错的入门教程:

http:

- cvc-complex-type.2.3: Element 'beans' cannot have character

Cb123456

springWebgis

cvc-complex-type.2.3: Element 'beans' cannot have character

Line 33 in XML document from ServletContext resource [/WEB-INF/backend-servlet.xml] is i

- jquery实例:随页面滚动条滚动而自动加载内容

120153216

jquery

<script language="javascript">

$(function (){

var i = 4;$(window).bind("scroll", function (event){

//滚动条到网页头部的 高度,兼容ie,ff,chrome

var top = document.documentElement.s

- 将数据库中的数据转换成dbs文件

何必如此

sqldbs

旗正规则引擎通过数据库配置器(DataBuilder)来管理数据库,无论是Oracle,还是其他主流的数据都支持,操作方式是一样的。旗正规则引擎的数据库配置器是用于编辑数据库结构信息以及管理数据库表数据,并且可以执行SQL 语句,主要功能如下。

1)数据库生成表结构信息:

主要生成数据库配置文件(.conf文

- 在IBATIS中配置SQL语句的IN方式

357029540

ibatis

在使用IBATIS进行SQL语句配置查询时,我们一定会遇到通过IN查询的地方,在使用IN查询时我们可以有两种方式进行配置参数:String和List。具体使用方式如下:

1.String:定义一个String的参数userIds,把这个参数传入IBATIS的sql配置文件,sql语句就可以这样写:

<select id="getForms" param

- Spring3 MVC 笔记(一)

7454103

springmvcbeanRESTJSF

自从 MVC 这个概念提出来之后 struts1.X struts2.X jsf 。。。。。

这个view 层的技术一个接一个! 都用过!不敢说哪个绝对的强悍!

要看业务,和整体的设计!

最近公司要求开发个新系统!

- Timer与Spring Quartz 定时执行程序

darkranger

springbean工作quartz

有时候需要定时触发某一项任务。其实在jdk1.3,java sdk就通过java.util.Timer提供相应的功能。一个简单的例子说明如何使用,很简单: 1、第一步,我们需要建立一项任务,我们的任务需要继承java.util.TimerTask package com.test; import java.text.SimpleDateFormat; import java.util.Date;

- 大端小端转换,le32_to_cpu 和cpu_to_le32

aijuans

C语言相关

大端小端转换,le32_to_cpu 和cpu_to_le32 字节序

http://oss.org.cn/kernel-book/ldd3/ch11s04.html

小心不要假设字节序. PC 存储多字节值是低字节为先(小端为先, 因此是小端), 一些高级的平台以另一种方式(大端)

- Nginx负载均衡配置实例详解

avords

[导读] 负载均衡是我们大流量网站要做的一个东西,下面我来给大家介绍在Nginx服务器上进行负载均衡配置方法,希望对有需要的同学有所帮助哦。负载均衡先来简单了解一下什么是负载均衡,单从字面上的意思来理解就可以解 负载均衡是我们大流量网站要做的一个东西,下面我来给大家介绍在Nginx服务器上进行负载均衡配置方法,希望对有需要的同学有所帮助哦。

负载均衡

先来简单了解一下什么是负载均衡

- 乱说的

houxinyou

框架敏捷开发软件测试

从很久以前,大家就研究框架,开发方法,软件工程,好多!反正我是搞不明白!

这两天看好多人研究敏捷模型,瀑布模型!也没太搞明白.

不过感觉和程序开发语言差不多,

瀑布就是顺序,敏捷就是循环.

瀑布就是需求、分析、设计、编码、测试一步一步走下来。而敏捷就是按摸块或者说迭代做个循环,第个循环中也一样是需求、分析、设计、编码、测试一步一步走下来。

也可以把软件开发理

- 欣赏的价值——一个小故事

bijian1013

有效辅导欣赏欣赏的价值

第一次参加家长会,幼儿园的老师说:"您的儿子有多动症,在板凳上连三分钟都坐不了,你最好带他去医院看一看。" 回家的路上,儿子问她老师都说了些什么,她鼻子一酸,差点流下泪来。因为全班30位小朋友,惟有他表现最差;惟有对他,老师表现出不屑,然而她还在告诉她的儿子:"老师表扬你了,说宝宝原来在板凳上坐不了一分钟,现在能坐三分钟。其他妈妈都非常羡慕妈妈,因为全班只有宝宝

- 包冲突问题的解决方法

bingyingao

eclipsemavenexclusions包冲突

包冲突是开发过程中很常见的问题:

其表现有:

1.明明在eclipse中能够索引到某个类,运行时却报出找不到类。

2.明明在eclipse中能够索引到某个类的方法,运行时却报出找不到方法。

3.类及方法都有,以正确编译成了.class文件,在本机跑的好好的,发到测试或者正式环境就

抛如下异常:

java.lang.NoClassDefFoundError: Could not in

- 【Spark七十五】Spark Streaming整合Flume-NG三之接入log4j

bit1129

Stream

先来一段废话:

实际工作中,业务系统的日志基本上是使用Log4j写入到日志文件中的,问题的关键之处在于业务日志的格式混乱,这给对日志文件中的日志进行统计分析带来了极大的困难,或者说,基本上无法进行分析,每个人写日志的习惯不同,导致日志行的格式五花八门,最后只能通过grep来查找特定的关键词缩小范围,但是在集群环境下,每个机器去grep一遍,分析一遍,这个效率如何可想之二,大好光阴都浪费在这上面了

- sudoku solver in Haskell

bookjovi

sudokuhaskell

这几天没太多的事做,想着用函数式语言来写点实用的程序,像fib和prime之类的就不想提了(就一行代码的事),写什么程序呢?在网上闲逛时发现sudoku游戏,sudoku十几年前就知道了,学生生涯时也想过用C/Java来实现个智能求解,但到最后往往没写成,主要是用C/Java写的话会很麻烦。

现在写程序,本人总是有一种思维惯性,总是想把程序写的更紧凑,更精致,代码行数最少,所以现

- java apache ftpClient

bro_feng

java

最近使用apache的ftpclient插件实现ftp下载,遇见几个问题,做如下总结。

1. 上传阻塞,一连串的上传,其中一个就阻塞了,或是用storeFile上传时返回false。查了点资料,说是FTP有主动模式和被动模式。将传出模式修改为被动模式ftp.enterLocalPassiveMode();然后就好了。

看了网上相关介绍,对主动模式和被动模式区别还是比较的模糊,不太了解被动模

- 读《研磨设计模式》-代码笔记-工厂方法模式

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

package design.pattern;

/*

* 工厂方法模式:使一个类的实例化延迟到子类

* 某次,我在工作不知不觉中就用到了工厂方法模式(称为模板方法模式更恰当。2012-10-29):

* 有很多不同的产品,它

- 面试记录语

chenyu19891124

招聘

或许真的在一个平台上成长成什么样,都必须靠自己去努力。有了好的平台让自己展示,就该好好努力。今天是自己单独一次去面试别人,感觉有点小紧张,说话有点打结。在面试完后写面试情况表,下笔真的好难,尤其是要对面试人的情况说明真的好难。

今天面试的是自己同事的同事,现在的这个同事要离职了,介绍了我现在这位同事以前的同事来面试。今天这位求职者面试的是配置管理,期初看了简历觉得应该很适合做配置管理,但是今天面

- Fire Workflow 1.0正式版终于发布了

comsci

工作workflowGoogle

Fire Workflow 是国内另外一款开源工作流,作者是著名的非也同志,哈哈....

官方网站是 http://www.fireflow.org

经过大家努力,Fire Workflow 1.0正式版终于发布了

正式版主要变化:

1、增加IWorkItem.jumpToEx(...)方法,取消了当前环节和目标环节必须在同一条执行线的限制,使得自由流更加自由

2、增加IT

- Python向脚本传参

daizj

python脚本传参

如果想对python脚本传参数,python中对应的argc, argv(c语言的命令行参数)是什么呢?

需要模块:sys

参数个数:len(sys.argv)

脚本名: sys.argv[0]

参数1: sys.argv[1]

参数2: sys.argv[

- 管理用户分组的命令gpasswd

dongwei_6688

passwd

NAME: gpasswd - administer the /etc/group file

SYNOPSIS:

gpasswd group

gpasswd -a user group

gpasswd -d user group

gpasswd -R group

gpasswd -r group

gpasswd [-A user,...] [-M user,...] g

- 郝斌老师数据结构课程笔记

dcj3sjt126com

数据结构与算法

<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<<

- yii2 cgridview加上选择框进行操作

dcj3sjt126com

GridView

页面代码

<?=Html::beginForm(['controller/bulk'],'post');?>

<?=Html::dropDownList('action','',[''=>'Mark selected as: ','c'=>'Confirmed','nc'=>'No Confirmed'],['class'=>'dropdown',])

- linux mysql

fypop

linux

enquiry mysql version in centos linux

yum list installed | grep mysql

yum -y remove mysql-libs.x86_64

enquiry mysql version in yum repositoryyum list | grep mysql oryum -y list mysql*

install mysq

- Scramble String

hcx2013

String

Given a string s1, we may represent it as a binary tree by partitioning it to two non-empty substrings recursively.

Below is one possible representation of s1 = "great":

- 跟我学Shiro目录贴

jinnianshilongnian

跟我学shiro

历经三个月左右时间,《跟我学Shiro》系列教程已经完结,暂时没有需要补充的内容,因此生成PDF版供大家下载。最近项目比较紧,没有时间解答一些疑问,暂时无法回复一些问题,很抱歉,不过可以加群(334194438/348194195)一起讨论问题。

----广告-----------------------------------------------------

- nginx日志切割并使用flume-ng收集日志

liyonghui160com

nginx的日志文件没有rotate功能。如果你不处理,日志文件将变得越来越大,还好我们可以写一个nginx日志切割脚本来自动切割日志文件。第一步就是重命名日志文件,不用担心重命名后nginx找不到日志文件而丢失日志。在你未重新打开原名字的日志文件前,nginx还是会向你重命名的文件写日志,linux是靠文件描述符而不是文件名定位文件。第二步向nginx主

- Oracle死锁解决方法

pda158

oracle

select p.spid,c.object_name,b.session_id,b.oracle_username,b.os_user_name from v$process p,v$session a, v$locked_object b,all_objects c where p.addr=a.paddr and a.process=b.process and c.object_id=b.

- java之List排序

shiguanghui

list排序

在Java Collection Framework中定义的List实现有Vector,ArrayList和LinkedList。这些集合提供了对对象组的索引访问。他们提供了元素的添加与删除支持。然而,它们并没有内置的元素排序支持。 你能够使用java.util.Collections类中的sort()方法对List元素进行排序。你既可以给方法传递

- servlet单例多线程

utopialxw

单例多线程servlet

转自http://www.cnblogs.com/yjhrem/articles/3160864.html

和 http://blog.chinaunix.net/uid-7374279-id-3687149.html

Servlet 单例多线程

Servlet如何处理多个请求访问?Servlet容器默认是采用单实例多线程的方式处理多个请求的:1.当web服务器启动的