- 动态规划之背包问题的Python实现

名侦探debug

Python数据结构python数据结构动态规划求解

目录1.问题描述2.动态规划之网格法3.python实现1.问题描述题目来源于《算法图解》第9章练习题9.2,如下图所示。对于背包问题,通常的做法有列举法、贪婪算法和动态规划(1)列举法:列举出所有的可能情况,再选择最优解,但当情况很多时,这种算法复杂度很高(2)贪婪算法:在容量允许范围内,每次都拿剩余物品中价值最高的,贪婪算法能够快速解决复杂度很高的问题,但通常得到的是次优解,但就对这个题目而言

- 总结10个Python赚钱的接单平台 兼职月入5000+

begefefsef

面试学习路线阿里巴巴android前端后端

前言“如果说当下什么编程语言最靠谱或者比较适合搞副业?”答案肯定100%是:Pythonpython是所有语法中最简单易上手的语言,不需要特别的的英语词汇量,逻辑思维也不需要很差就能上手。而且学会了之后就能编写代码爬取各种数据,制作各种图表,提升工作效率。而且还能利用业余时间接点私活,一个月轻松收入过万不是问题,这样的生活他不香吗?今天就给大家盘点几个基本入门接私活的资源,让你轻松学python,

- 大学生学完python靠几个接单网站兼职,实现经济独立

「已注销」

python开发语言

大学生学完python靠几个接单网站兼职,实现经济独立程序员就是当今时代的手艺人,程序员可以通过个人的技术来谋生。而在工作之余接私单可以作为一种创富的途径,受到程序员的广泛认可。说句实在话,现在这个时代,很多人仅靠主业顶多维持基本生活,想让自己、家人生活好一点很难。我接的私活并不算多,加起来也就几万左右,只能算一半,我想把一些经验分享出来,毕竟现在生活都不容易,能赚一点是一点。一、程序员接活、新手

- Python wifi 安装手机app

yichengace

python

目的当测试机数量越来越多时,测试包的安装会成为一个问题,用wifi安装来解决这个问题,并且用脚本语言来批量控制思路思路就是py调用pc端的adb命令,向手机发送请求,无线是因为,如果未来测试机越来越多,一台电脑的usb接口数量肯定不够准备工具python,adb,pycharm,测试用app,这里选择qq(https://qd.myapp.com/myapp/qqteam/AndroidQQ/mo

- 深度学习之目标检测的常用标注工具

铭瑾熙

人工智能机器学习深度学习深度学习目标检测目标跟踪

1LabelImgLabelImg是一款开源的图像标注工具,标签可用于分类和目标检测,它是用Python编写的,并使用Qt作为其图形界面,简单好用。注释以PASCALVOC格式保存为XML文件,这是ImageNet使用的格式。此外,它还支持COCO数据集格式。2labelmelabelme是一款开源的图像/视频标注工具,标签可用于目标检测、分割和分类。灵感是来自于MIT开源的一款标注工具Label

- Python 舆论风向分析爬虫:全流程数据获取、清洗与情感剖析

西攻城狮北

python爬虫开发语言实战案例

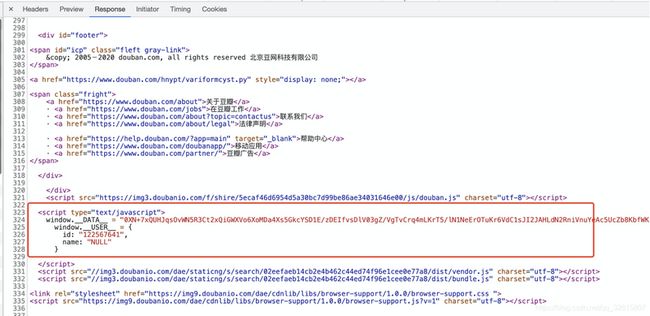

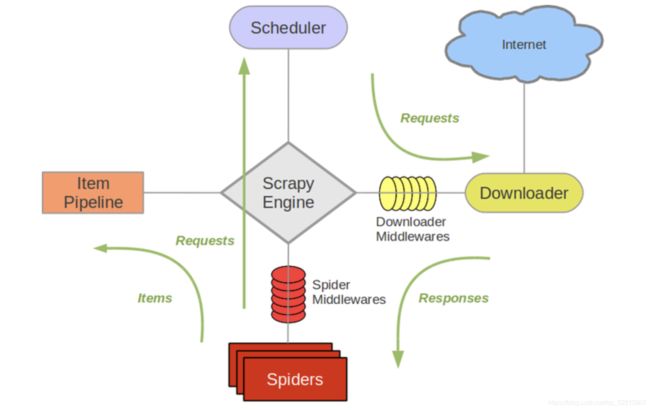

引言在当今信息爆炸的时代,互联网上充斥着海量的用户言论和观点。了解舆论风向对于企业、政府机构以及研究者等具有重要的意义,可以帮助他们及时把握公众情绪、调整策略与决策。Python作为一种强大的编程语言,在数据爬取与分析方面具有得天独厚的优势,能够助力我们高效地实现舆情监测与深入剖析。一、环境搭建与目标确定1.环境搭建为了顺利完成爬虫与数据分析任务,首先需要确保你的开发环境已经安装了以下Python

- PyCharm 集成 DeepSeek:本地运行 or API 直连?打造你的 AI 编程神器!

AI云极

【AI智能系列】pycharm人工智能idedeepseek

在AI赋能编程的时代,如何让AI辅助写代码,提升开发效率?DeepSeek作为一款开源、强大、免费的AI编程助手,结合PyCharm,能够大幅提升Python编程体验。今天,我们就来详细讲解如何在PyCharm中接入DeepSeek,无论你想使用本地部署的DeepSeek,还是官方API版本,都能轻松实现!为什么选择DeepSeek+PyCharm?DeepSeekR1采用6710亿参数的MoE(

- Python3.5源码分析-sys模块及site模块导入

小屋子大侠

pythonPython分析python源码

Python3源码分析本文环境python3.5.2。参考书籍>python官网Python3的sys模块初始化根据分析完成builtins初始化后,继续分析sys模块的初始化,继续分析_Py_InitializeEx_Private函数的执行,void_Py_InitializeEx_Private(intinstall_sigs,intinstall_importlib){...sysmod=

- 【CUDA】Pytorch_Extensions

joker D888

深度学习pytorchpythoncudac++深度学习

【CUDA】Pytorch_Extensions为什么要开发CUDA扩展?当我们在PyTorch中实现自定义算子时,通常有两种选择:使用纯Python实现(简单但效率低)使用C++/CUDA扩展(高效但需要编译)对于计算密集型的操作(如神经网络中的自定义激活函数),使用CUDA扩展可以获得接近硬件极限的性能。本文将以实现一个多项式激活函数x²+x+1为例,展示完整的开发流程。完整CUDA扩展代码解

- Labelbox:引领AI与人类协作的未来

魏兴雄Milburn

Labelbox:引领AI与人类协作的未来labelbox-pythonLabelboxPythonClient项目地址:https://gitcode.com/gh_mirrors/la/labelbox-python项目介绍Labelbox是一款专为企业和学术研究社区设计的开源工具,旨在简化数据标注、生成高质量的人类反馈数据、评估和提升模型性能,并通过无缝结合AI与人类工作流程来自动化任务。无

- 基于python使用scanpy分析单细胞转录组数据

探序基因

单细胞分析python开发语言

探序基因肿瘤研究院整理相关后缀的格式介绍:.h5ad:是一种用于存储单细胞数据的文件格式,可以通过anndata库在Python中处理.loom:高效的数据存储格式(.loom文件),使得用户可以轻松地存储、查询和分析大规模的单细胞数据集。Loompy的设计目标是提供一个快速、灵活且易于使用的工具,以支持生物信息学家和研究人员在单细胞水平上进行数据分析。python的单细胞转录组数据结构说明:da

- 本地搭建小型 DeepSeek 并进行微调

非著名架构师

大模型知识文档智能硬件人工智能大数据大模型deepseek

本文将指导您在本地搭建一个小型的DeepSeek模型,并进行微调,以处理您的特定数据。1.环境准备Python3.7或更高版本PyTorch1.8或更高版本CUDA(可选,用于GPU加速)Git2.克隆DeepSeek仓库bash复制gitclonehttps://github.com/deepseek-ai/deepseek.gitcddeepseek3.安装依赖bash复制pipinstall

- 使用Python和OpenCV实现图像像素压缩与解压

东方佑

量子变法pythonopencv开发语言

在本文中,我们将探讨如何使用Python和OpenCV库来实现一种简单的图像像素压缩算法。我们将详细讨论代码的工作原理,并提供一个具体的示例来演示该过程。1.引言随着数字媒体的普及,图像处理成为了一个重要的领域。无论是为了减少存储空间还是加快网络传输速度,图像压缩技术都扮演着至关重要的角色。这里,我们提出了一种基于像素重复模式的简单压缩算法,它适用于具有大量连续相同像素值的图像。2.技术栈介绍2.

- 【Python系列】Python 解释器的站点配置

Kwan的解忧杂货铺@新空间代码工作室

s1Pythonpython开发语言

欢迎来到我的博客,很高兴能够在这里和您见面!希望您在这里可以感受到一份轻松愉快的氛围,不仅可以获得有趣的内容和知识,也可以畅所欲言、分享您的想法和见解。推荐:kwan的首页,持续学习,不断总结,共同进步,活到老学到老导航檀越剑指大厂系列:全面总结java核心技术点,如集合,jvm,并发编程redis,kafka,Spring,微服务,Netty等常用开发工具系列:罗列常用的开发工具,如IDEA,M

- 利用Beautiful Soup和Pandas进行网页数据抓取与清洗处理实战

傻啦嘿哟

pandas

目录一、准备工作二、抓取网页数据三、数据清洗四、数据处理五、保存数据六、完整代码示例七、总结在数据分析和机器学习的项目中,数据的获取、清洗和处理是非常关键的步骤。今天,我们将通过一个实战案例,演示如何利用Python中的BeautifulSoup库进行网页数据抓取,并使用Pandas库进行数据清洗和处理。这个案例不仅适合初学者,也能帮助有一定经验的朋友快速掌握这两个强大的工具。一、准备工作在开始之

- python做一个注册界面_python如何做一个登录注册界面

weixin_39824033

python做一个注册界面

python做一个登录注册界面的方法:首先初始化一个window界面,并使用画布实现欢迎的logo;然后用代码实现登录和注册按钮;接着并进行登录判断代码;最后完成注册界面即可。【相关学习推荐:python视频教程】python做一个登录注册界面的方法:一、登录界面1、首先初始化一个window界面window=tk.Tk()window.title('WelcometoMofanPython')w

- python读取zip包内文件_Python模块学习:zipfile zip文件操作

weixin_40001634

python读取zip包内文件

最近在写一个网络客户端下载程序,用于下载服务器上的数据。有些数据(如文本,office文档)如果直接传输的话,将会增加通信的数据量,使下载时间变长。服务器在传输这些数据之前先对其进行压缩,客户端接收到数据之后进行解压,这样可以减小网通传输数据的通信量,缩短下载的时间,从而增加客户体验。以前用C#做类似应用程序的时候,我会用SharpZipLib这个开源组件,现在用Python做类似的工作,只要使用

- python制作登陆窗口_python登陆界面

weixin_39758494

python制作登陆窗口

广告关闭腾讯云11.11云上盛惠,精选热门产品助力上云,云服务器首年88元起,买的越多返的越多,最高返5000元!print(账号密码错误!请重试。)returnfalsebutton(master,text=登陆,width=10,command=test).grid(row=3,column=0,sticky=w,padx=10,pady=5)button(master,text=退出,wid

- 如何使用零配置的Sphinx生成Python文档?

潮易

sphinx全文检索搜索引擎

如何使用零配置的Sphinx生成Python文档?在Python编程中,编写文档是非常重要的。一个好的文档可以帮助其他开发者理解和使用你的代码。Sphinx是一个用于生成Python项目的文档的静态网页生成器,它支持多种文档格式,包括ReStructuredText和Markdown。以下是使用零配置的方式来使用Sphinx生成Python文档的详细步骤:1.首先,确保你已经安装了Sphinx。打

- 如何订阅&q;/扫描&q;主题、修改消息并发布到新主题?

潮易

python开发语言

如何订阅&q;/扫描&q;主题、修改消息并发布到新主题?这个问题涉及到Python编程中的MQTT(MessageQueuingTelemetryTransport)库的使用,该库允许我们创建客户端订阅和发布消息到MQTT服务器。以下是一个简单的步骤:1.安装MQTT库:可以使用pip安装`paho-mqtt`库。```pythonpipinstallpaho-mqtt```2.创建一个MQTT客

- Python-tkinter自制登录界面(含注册)

GCHEK

python开发语言

简单的用户登录、注册界面importtkinterastkimporttimeimportsubprocessimportsysimportosimporttkinter.messageboxwindow=tk.Tk()window.title('GCHEK')window.geometry('400x300')#设置储存用户信息的容器,这里用的txt。ifnotos.path.exists('U

- Python爬虫requests(详细)

dme.

Python爬虫零基础入门爬虫python

本文来学爬虫使用requests模块的常见操作。1.URL参数无论是在发送GET/POST请求时,网址URL都可能会携带参数,例如:http://www.5xclass.cn?age=19&name=dengres=requests.get(url="https://www.5xclass.cn?age=19&name=deng")res=requests.get(url="https://www

- 使用python计算等比数列求和的方法

HAMYHF

windows

在python中,计算Sum=m+mm+mmm+mmmm+.....+mmmmm.....,输入两个数m,n。m的位数累加到n的值,列出算式并计算出结果:#为了打印出算式,并计算出结果,将m,mm这些放入到列表中#定义列表中的m初始值为0,用Ele来代表m,mm....Ele=0#定义总和为0Sum=0#定义一个空列表List=[]#输入两个值n=int(input("inputadigit:")

- Python+Playwright常用元素定位方法

HAMYHF

python功能测试

CSSselector选择器在CSS中,定位元素主要通过选择器完成,以下是几种常见的CSS选择器定位方法:标签选择器(element):直接使用HTML元素名称来定位,例如p会选择所有段落元素。属性选择器(attribute):选择所有具有指定属性的元素,无论该属性的值是什么。例如,[title]会选择所有包含title属性的元素。选择具有指定属性,并且该属性值完全等于给定值的元素。例如,[typ

- Python中的 redis keyspace 通知_python 操作redis psubscribe(‘__keyspace@0__ ‘)

2301_82243733

程序员python学习面试

最后Python崛起并且风靡,因为优点多、应用领域广、被大牛们认可。学习Python门槛很低,但它的晋级路线很多,通过它你能进入机器学习、数据挖掘、大数据,CS等更加高级的领域。Python可以做网络应用,可以做科学计算,数据分析,可以做网络爬虫,可以做机器学习、自然语言处理、可以写游戏、可以做桌面应用…Python可以做的很多,你需要学好基础,再选择明确的方向。这里给大家分享一份全套的Pytho

- Python数据分析与可视化

程序媛小果

pythonpython数据分析开发语言

Python数据分析与可视化在数据驱动的商业世界中,数据分析和可视化成为了理解复杂数据集、做出明智决策的关键工具。Python,作为一种功能强大且易于学习的编程语言,提供了丰富的库和框架,使得数据分析和可视化变得简单高效。本文将探讨Python在数据分析和可视化中的应用,包括数据预处理、分析、以及如何通过可视化工具将数据洞察转化为可操作的策略。1.数据分析的重要性数据分析是提取数据中有用信息的过程

- 【Python 学习 / 7】模块与文件操作

卜及中

Python基础python学习数据库

文章目录前言一、导入模块1.导入整个模块2.导入模块中的特定函数3.给模块或函数起别名二、常用模块1.`math`模块2.`random`模块3.`os`模块4.`sys`模块三、文件处理1.打开文件2.读取文件3.写入文件4.关闭文件5.使用`with`语句管理文件四、日期时间1.`datetime`模块获取当前日期和时间创建日期和时间对象格式化日期和时间解析字符串为日期对象2.`time`模块

- 经销商管理系统架构设计方案(附 Java版本和Python版本源代码详解)

AI天才研究院

DeepSeekR1&大数据AI人工智能大模型AI大模型企业级应用开发实战AI大模型应用入门实战与进阶计算科学神经计算深度学习神经网络大数据人工智能大型语言模型AIAGILLMJavaPython架构设计AgentRPA

经销商管理系统架构设计方案(Java实现源代码详解)关键词:经销商管理系统,Java,SpringBoot,MyBatis,MySQL,架构设计,源代码1.背景介绍随着市场竞争的日益激烈,企业对经销商的管理越来越重视。传统的经销商管理方式效率低下,信息滞后,难以适应现代企业的发展需求。为了提高经销商管理效率,降低运营成本,越来越多的企业开始采用信息化的手段来管理经销商,而经销商管理系统应运而生。经

- Python:数据从Excel表格链接到Word文档 更新Excel即可自动更新Word

一个花生米生花

pythonexcelword

要使用Python来创建或更新一个Word文档,并将数据从Excel表格链接到Word文档中,你可以使用python-docx库来操作Word文档和openpyxl或pandas库来读取Excel文件。不过,需要注意的是,python-docx库并不支持将外部文件链接到Word文档的功能。你可以在Word文档中插入Excel数据的快照,但它们不会自动更新。如果你想要在Word文档中插入Excel数

- 使用Odoo Shell卸载模块

odoo中国

odooodoo开源软件erp

使用OdooShell卸载模块我们在Odoo使用过程中,因为模块安装错误或者前端错误等导致odoo无法通过界面登录,这时候你可以使用OdooShell来卸载模块。OdooShell是一个交互式Pythonshell,允许你直接与Odoo数据库和模型进行交互。以下是使用OdooShell卸载模块的详细步骤:步骤1:启动OdooShell要启动OdooShell,你需要在终端中运行以下命令。确保你已经

- scala的option和some

矮蛋蛋

编程scala

原文地址:

http://blog.sina.com.cn/s/blog_68af3f090100qkt8.html

对于学习 Scala 的 Java™ 开发人员来说,对象是一个比较自然、简单的入口点。在 本系列 前几期文章中,我介绍了 Scala 中一些面向对象的编程方法,这些方法实际上与 Java 编程的区别不是很大。我还向您展示了 Scala 如何重新应用传统的面向对象概念,找到其缺点

- NullPointerException

Cb123456

androidBaseAdapter

java.lang.NullPointerException: Attempt to invoke virtual method 'int android.view.View.getImportantForAccessibility()' on a null object reference

出现以上异常.然后就在baidu上

- PHP使用文件和目录

天子之骄

php文件和目录读取和写入php验证文件php锁定文件

PHP使用文件和目录

1.使用include()包含文件

(1):使用include()从一个被包含文档返回一个值

(2):在控制结构中使用include()

include_once()函数需要一个包含文件的路径,此外,第一次调用它的情况和include()一样,如果在脚本执行中再次对同一个文件调用,那么这个文件不会再次包含。

在php.ini文件中设置

- SQL SELECT DISTINCT 语句

何必如此

sql

SELECT DISTINCT 语句用于返回唯一不同的值。

SQL SELECT DISTINCT 语句

在表中,一个列可能会包含多个重复值,有时您也许希望仅仅列出不同(distinct)的值。

DISTINCT 关键词用于返回唯一不同的值。

SQL SELECT DISTINCT 语法

SELECT DISTINCT column_name,column_name

F

- java冒泡排序

3213213333332132

java冒泡排序

package com.algorithm;

/**

* @Description 冒泡

* @author FuJianyong

* 2015-1-22上午09:58:39

*/

public class MaoPao {

public static void main(String[] args) {

int[] mao = {17,50,26,18,9,10

- struts2.18 +json,struts2-json-plugin-2.1.8.1.jar配置及问题!

7454103

DAOspringAjaxjsonqq

struts2.18 出来有段时间了! (貌似是 稳定版)

闲时研究下下! 貌似 sruts2 搭配 json 做 ajax 很吃香!

实践了下下! 不当之处请绕过! 呵呵

网上一大堆 struts2+json 不过大多的json 插件 都是 jsonplugin.34.jar

strut

- struts2 数据标签说明

darkranger

jspbeanstrutsservletScheme

数据标签主要用于提供各种数据访问相关的功能,包括显示一个Action里的属性,以及生成国际化输出等功能

数据标签主要包括:

action :该标签用于在JSP页面中直接调用一个Action,通过指定executeResult参数,还可将该Action的处理结果包含到本页面来。

bean :该标签用于创建一个javabean实例。如果指定了id属性,则可以将创建的javabean实例放入Sta

- 链表.简单的链表节点构建

aijuans

编程技巧

/*编程环境WIN-TC*/ #include "stdio.h" #include "conio.h"

#define NODE(name, key_word, help) \ Node name[1]={{NULL, NULL, NULL, key_word, help}}

typedef struct node { &nbs

- tomcat下jndi的三种配置方式

avords

tomcat

jndi(Java Naming and Directory Interface,Java命名和目录接口)是一组在Java应用中访问命名和目录服务的API。命名服务将名称和对象联系起来,使得我们可以用名称

访问对象。目录服务是一种命名服务,在这种服务里,对象不但有名称,还有属性。

tomcat配置

- 关于敏捷的一些想法

houxinyou

敏捷

从网上看到这样一句话:“敏捷开发的最重要目标就是:满足用户多变的需求,说白了就是最大程度的让客户满意。”

感觉表达的不太清楚。

感觉容易被人误解的地方主要在“用户多变的需求”上。

第一种多变,实际上就是没有从根本上了解了用户的需求。用户的需求实际是稳定的,只是比较多,也比较混乱,用户一般只能了解自己的那一小部分,所以没有用户能清楚的表达出整体需求。而由于各种条件的,用户表达自己那一部分时也有

- 富养还是穷养,决定孩子的一生

bijian1013

教育人生

是什么决定孩子未来物质能否丰盛?为什么说寒门很难出贵子,三代才能出贵族?真的是父母必须有钱,才能大概率保证孩子未来富有吗?-----作者:@李雪爱与自由

事实并非由物质决定,而是由心灵决定。一朋友富有而且修养气质很好,兄弟姐妹也都如此。她的童年时代,物质上大家都很贫乏,但妈妈总是保持生活中的美感,时不时给孩子们带回一些美好小玩意,从来不对孩子传递生活艰辛、金钱来之不易、要懂得珍惜

- oracle 日期时间格式转化

征客丶

oracle

oracle 系统时间有 SYSDATE 与 SYSTIMESTAMP;

SYSDATE:不支持毫秒,取的是系统时间;

SYSTIMESTAMP:支持毫秒,日期,时间是给时区转换的,秒和毫秒是取的系统的。

日期转字符窜:

一、不取毫秒:

TO_CHAR(SYSDATE, 'YYYY-MM-DD HH24:MI:SS')

简要说明,

YYYY 年

MM 月

- 【Scala六】分析Spark源代码总结的Scala语法四

bit1129

scala

1. apply语法

FileShuffleBlockManager中定义的类ShuffleFileGroup,定义:

private class ShuffleFileGroup(val shuffleId: Int, val fileId: Int, val files: Array[File]) {

...

def apply(bucketId

- Erlang中有意思的bug

bookjovi

erlang

代码中常有一些很搞笑的bug,如下面的一行代码被调用两次(Erlang beam)

commit f667e4a47b07b07ed035073b94d699ff5fe0ba9b

Author: Jovi Zhang <

[email protected]>

Date: Fri Dec 2 16:19:22 2011 +0100

erts:

- 移位打印10进制数转16进制-2008-08-18

ljy325

java基础

/**

* Description 移位打印10进制的16进制形式

* Creation Date 15-08-2008 9:00

* @author 卢俊宇

* @version 1.0

*

*/

public class PrintHex {

// 备选字符

static final char di

- 读《研磨设计模式》-代码笔记-组合模式

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

import java.util.ArrayList;

import java.util.List;

abstract class Component {

public abstract void printStruct(Str

- 利用cmd命令将.class文件打包成jar

chenyu19891124

cmdjar

cmd命令打jar是如下实现:

在运行里输入cmd,利用cmd命令进入到本地的工作盘符。(如我的是D盘下的文件有此路径 D:\workspace\prpall\WEB-INF\classes)

现在是想把D:\workspace\prpall\WEB-INF\classes路径下所有的文件打包成prpall.jar。然后继续如下操作:

cd D: 回车

cd workspace/prpal

- [原创]JWFD v0.96 工作流系统二次开发包 for Eclipse 简要说明

comsci

eclipse设计模式算法工作swing

JWFD v0.96 工作流系统二次开发包 for Eclipse 简要说明

&nb

- SecureCRT右键粘贴的设置

daizj

secureCRT右键粘贴

一般都习惯鼠标右键自动粘贴的功能,对于SecureCRT6.7.5 ,这个功能也已经是默认配置了。

老版本的SecureCRT其实也有这个功能,只是不是默认设置,很多人不知道罢了。

菜单:

Options->Global Options ...->Terminal

右边有个Mouse的选项块。

Copy on Select

Paste on Right/Middle

- Linux 软链接和硬链接

dongwei_6688

linux

1.Linux链接概念Linux链接分两种,一种被称为硬链接(Hard Link),另一种被称为符号链接(Symbolic Link)。默认情况下,ln命令产生硬链接。

【硬连接】硬连接指通过索引节点来进行连接。在Linux的文件系统中,保存在磁盘分区中的文件不管是什么类型都给它分配一个编号,称为索引节点号(Inode Index)。在Linux中,多个文件名指向同一索引节点是存在的。一般这种连

- DIV底部自适应

dcj3sjt126com

JavaScript

<!DOCTYPE html PUBLIC "-//W3C//DTD XHTML 1.0 Transitional//EN" "http://www.w3.org/TR/xhtml1/DTD/xhtml1-transitional.dtd">

<html xmlns="http://www.w3.org/1999/xhtml&q

- Centos6.5使用yum安装mysql——快速上手必备

dcj3sjt126com

mysql

第1步、yum安装mysql

[root@stonex ~]# yum -y install mysql-server

安装结果:

Installed:

mysql-server.x86_64 0:5.1.73-3.el6_5 &nb

- 如何调试JDK源码

frank1234

jdk

相信各位小伙伴们跟我一样,想通过JDK源码来学习Java,比如collections包,java.util.concurrent包。

可惜的是sun提供的jdk并不能查看运行中的局部变量,需要重新编译一下rt.jar。

下面是编译jdk的具体步骤:

1.把C:\java\jdk1.6.0_26\sr

- Maximal Rectangle

hcx2013

max

Given a 2D binary matrix filled with 0's and 1's, find the largest rectangle containing all ones and return its area.

public class Solution {

public int maximalRectangle(char[][] matrix)

- Spring MVC测试框架详解——服务端测试

jinnianshilongnian

spring mvc test

随着RESTful Web Service的流行,测试对外的Service是否满足期望也变的必要的。从Spring 3.2开始Spring了Spring Web测试框架,如果版本低于3.2,请使用spring-test-mvc项目(合并到spring3.2中了)。

Spring MVC测试框架提供了对服务器端和客户端(基于RestTemplate的客户端)提供了支持。

&nbs

- Linux64位操作系统(CentOS6.6)上如何编译hadoop2.4.0

liyong0802

hadoop

一、准备编译软件

1.在官网下载jdk1.7、maven3.2.1、ant1.9.4,解压设置好环境变量就可以用。

环境变量设置如下:

(1)执行vim /etc/profile

(2)在文件尾部加入:

export JAVA_HOME=/home/spark/jdk1.7

export MAVEN_HOME=/ho

- StatusBar 字体白色

pangyulei

status

[[UIApplication sharedApplication] setStatusBarStyle:UIStatusBarStyleLightContent];

/*you'll also need to set UIViewControllerBasedStatusBarAppearance to NO in the plist file if you use this method

- 如何分析Java虚拟机死锁

sesame

javathreadoracle虚拟机jdbc

英文资料:

Thread Dump and Concurrency Locks

Thread dumps are very useful for diagnosing synchronization related problems such as deadlocks on object monitors. Ctrl-\ on Solaris/Linux or Ctrl-B

- 位运算简介及实用技巧(一):基础篇

tw_wangzhengquan

位运算

http://www.matrix67.com/blog/archives/263

去年年底写的关于位运算的日志是这个Blog里少数大受欢迎的文章之一,很多人都希望我能不断完善那篇文章。后来我看到了不少其它的资料,学习到了更多关于位运算的知识,有了重新整理位运算技巧的想法。从今天起我就开始写这一系列位运算讲解文章,与其说是原来那篇文章的follow-up,不如说是一个r

- jsearch的索引文件结构

yangshangchuan

搜索引擎jsearch全文检索信息检索word分词

jsearch是一个高性能的全文检索工具包,基于倒排索引,基于java8,类似于lucene,但更轻量级。

jsearch的索引文件结构定义如下:

1、一个词的索引由=分割的三部分组成: 第一部分是词 第二部分是这个词在多少