Python爬虫 实现豆瓣电影Top250信息的爬取

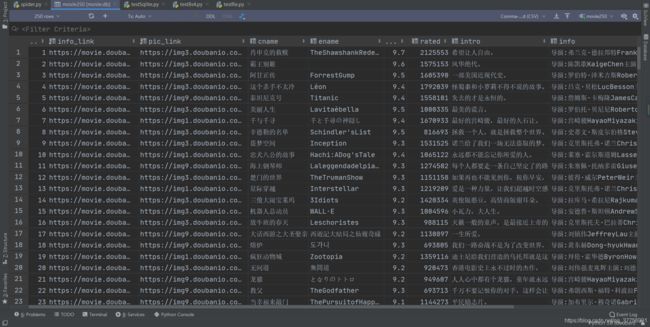

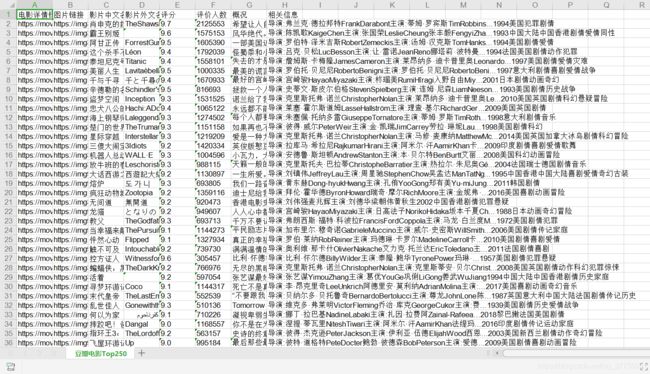

导语:疫情在家学习python,琢磨着写一个爬虫程序,实现豆瓣网站的信息爬取,并以Excel表格和SQLite数据库的方式保存,运行效果如下:

运行python文件后生成数据库文件和表格文件

经过多次调试,已排除全部Bug,python文件具体代码如下:

1.头文件默认模板

依次点击:File -> Settings -> Editor -> File and Code Templates

在Files栏选择Python Script,添加以下代码

# -*- coding = utf-8 -*-

# @Time: ${DATE} ${TIME}

# @Author: xxx

# @File: ${NAME}.py

# @Software: ${PRODUCT_NAME}

2.导入相关类库

from bs4 import BeautifulSoup # 网页解析,获取数据

import re # 正则表达式,进行文字匹配

import urllib.request,urllib.error # 制定URL,获取网页数据

import xlwt # 进行excel操作

import sqlite3 # 进行SQLite数据库操作

3.制定正则表达式的规则

# 1.获取影片超链接的规则

findLink = re.compile(r'') # 生成正则表达式对象,表示规则(字符串的模式)

# 2.影片图片

findImgSrc = re.compile(r',re.S) # S忽略换行

# 3.影片片名

findTitle = re.compile(r'(.*)')

# 4.影片评分

findRating = re.compile(r'')

# 5.影片评价人数

findJudge = re.compile(r'(\d*)人评价')

# 6.影片概况

findInq = re.compile(r'(.*)')

# 7.影片相关信息

findBd = re.compile(r'(.*?)

',re.S)

4.主程序功能模块

# Step0.程序执行时

def main():

print("开始爬取...")

baseurl = "https://movie.douban.com/top250?start="

# Step1.爬取网页;Step2.逐一解析数据

datalist = getData(baseurl)

savepath = ".\\豆瓣电影Top250.xls"

dbpath = "movie.db"

# Step3.保存数据

saveData(datalist,savepath) # 保存数据到Excel

saveData2DB(datalist,dbpath) # 保存数据到SQLite

可以实现两种保存方式

5.爬取网页数据,逐一解析

tips:爬取网页时,由于是好几个网页,需要逐页解析,否则只会解析最后一页

# Step1.爬取网页

def getData(baseurl):

print("getData...")

datalist = [] # 创建电影列表

for i in range(0,10): # 调用获取页面信息的函数,10次,25条/页

url = baseurl + str(i*25)

askURL(url)

html = askURL(url) # 保存获取到的网页源码

# Step2.逐一解析数据

soup = BeautifulSoup(html,"html.parser") # 对象,解析器

for item in soup.find_all('div',class_="item"): # 查找符合要求的字符串,形成列表

data =[] # 保存一部电影的所有信息

item = str(item)

# print(item) # 测试:查看电影Item全部信息

# break

# 1.获取影片超链接

link = re.findall(findLink,item)[0] # re库通过正则表达式查找指定的字符串

data.append(link)

# 2.影片图片

imgSrc = re.findall(findImgSrc,item)[0]

data.append(imgSrc)

# 3.影片片名

titles = re.findall(findTitle,item)

if len(titles) == 2:

ctitle = titles[0] # 添加中文名

data.append(ctitle)

otitle = titles[1].replace("/","") # 去掉无关符号

otitle = re.sub(' ', "", otitle) # 替换,去除空格

otitle = re.sub('( )+', "", otitle) # 替换,去除空格

data.append(otitle) # 添加外文名

else:

data.append(titles[0])

data.append(' ') # 外文名空

# 4.影片评分

rating = re.findall(findRating,item)[0]

data.append(rating)

# 5.影片评价人数

judgeNum = re.findall(findJudge,item)[0]

data.append(judgeNum)

# 6.影片概况

inq = re.findall(findInq,item)

if len(inq)!=0:

inq = inq[0].replace(".","")

data.append(inq)

else:

data.append(" ")

# 7.影片相关信息

bd = re.findall(findBd, item)[0]

bd = re.sub('6.获得豆瓣URL内容的方法

# 得到指定一个URL的网页内容

def askURL(url):

head = {

# 模拟浏览器头部信息,向服务器发送消息

"User-Agent": "Mozilla/5.0 (Windows NT 10.0; Win64;x64) AppleWebKit / 537.36(KHTML, likeGecko) Chrome / 85.0.4183.76Safari / 537.36Edg / 85.0.564.40"

}

# 用户代理:通过头部伪装,告诉服务器我们的机器类型:是浏览器而不是爬虫(采用字典类型),我们可以接收什么水平的文件内容

request = urllib.request.Request(url=url,headers=head)

html = ""

try:

response = urllib.request.urlopen(request)

html = response.read().decode('utf-8')

# 打印网页

# print(html)

except urllib.error.URLError as e:

if hasattr(e,"code"): # 标签

print(e.code)

if hasattr(e,"reason"): # 标签

print(e.reason)

return html

7.保存数据到Excel

# Step3.保存数据

def saveData(datalist,savepath):

print("saveData...")

book = xlwt.Workbook(encoding="utf-8",style_compression=0) # 创建Workbook对象

sheet = book.add_sheet('豆瓣电影Top250',cell_overwrite_ok=True) # 创建工作表

col = ("电影详情链接","图片链接","影片中文名","影片外文名","评分","评价人数","概况","相关信息")

for i in range(0,8):

sheet.write(0,i,col[i]) # 列名

for i in range(0,250):

print("第%d条"%(i+1))

data = datalist[i]

for j in range(0,8):

sheet.write(i+1,j,data[j]) # 数据

book.save(savepath) # 保存

8.保存数据到SQLite

def saveData2DB(datalist,dbpath):

print("saveData...")

init_db(dbpath) # 创建数据表

conn = sqlite3.connect(dbpath)

cur = conn.cursor() # 获取游标

for data in datalist: # 遍历数据表datalist中的数据

for index in range(len(data)): # 遍历每一条数据data中的元素

if index == 4 or index == 5:

continue

data[index] = '"'+data[index]+'"' # 逐一添加双引号

sql = '''

insert into movie250

(info_link,pic_link,cname,ename,score,rated,intro,info)

values(%s);

'''%",".join(data)

# 将data列表元素用逗号连接,拼接成sql语句

# print(sql) # sql调试

cur.execute(sql) # 执行sql语句

conn.commit() # 提交数据库操作

cur.close() # 关闭游标

conn.close() # 关闭数据库连接

# 创建初始化

def init_db(dbpath):

# 创建数据表

sql = '''

create table movie250

(

id integer primary key autoincrement,

info_link text not null,

pic_link int not null,

cname varchar ,

ename varchar ,

score numeric ,

rated numeric ,

intro text,

info text

);

'''

conn = sqlite3.connect(dbpath) # 打开或创建数据库文件

print("数据库连接成功")

c = conn.cursor() # 获取游标

c.execute(sql) # 执行sql语句

conn.commit() # 提交数据库操作

conn.close() # 关闭数据库连接

print("建表成功")

print("数据库关闭")

9.主程序入口(必须写)

# 程序入口(主方法)

if __name__ == "__main__":

# 调用函数

main()

# init_db("movieTest.db") # 测试数据库建立

print("爬取完毕")

以上是python文件的全部代码,如有疑问,欢迎关注讨论

附:源码文件

欢迎访问我的博客