hadoop高可用集群环境搭建(ntp的时间同步配置+有zookeeper安装包,完整的高可用配置文件步骤)

没有完成hadoop 3台虚拟机集群搭建的可以先看以下两篇博客

hadoop学习——伪分布式环境搭建(有安装包 非常详细)

hadoop学习——完全分布式集群环境搭建(有完整的文件配置步骤)

友情提醒:搭建好HA环境后 不要强制关机 否则下次就启动进程不正常了

先使用:

stop-all.sh

再关机!!!

hadoop高可用集群环境搭建

- 1、ntp时间同步设置

- 2、zokeeper安装配置

- 3、hadoop相关文件配置

- 4、启动hadoop集群

- 5、hadoop HA 模式测试

1、ntp时间同步设置

当搭建完成hadoop的集群搭建之后,我们先来做时区同步

在三台虚拟机上都使用以下命令安装 ntp

yum -y install ntp

chkconfig ntpd on

下面修改主机的ntp.conf文件

vi /etc/ntp.conf

如图取消注释 restrict 192.168.1.0 mask 255.255.255.0 nomodify notrap

如图注释掉四行 server 然后在下面添加:

server 127.127.1.0

fudge 127.127.1.0 stratum 10

另外两台的ntp.conf 的修改是一样的 如下操作

如图取消注释 restrict 192.168.1.0 mask 255.255.255.0 nomodify notrap

同样注释掉四行 server 然后在下面添加:

server 127.127.1.0

fudge 127.127.1.0 stratum 10

server hadoop001

restrict hadoop001 nomodify notrap noquery

其中hadoop001是你的主机名或者IP地址

启动 ntp 服务:

service ntpd start

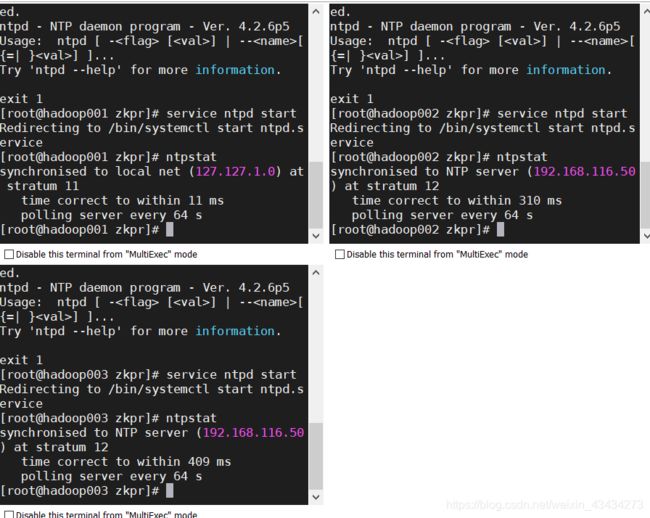

三台虚拟机分别输入以下命令查看时间同步结果:

ntpstat

三台虚拟机执行完命令后都出现上图 synchronised to NTP server 即为时间同步成功

2、zokeeper安装配置

先解压zookeeper 安装包可下载:

链接: https://pan.baidu.com/s/1L71MOd4niUEl3LAcksxZdg

提取码: 2ige

解压到/opt 方便查找,先在一台机器解压,后面用scp命令传输到另外两台机器上面

tar -xvf zookeeper-3.4.6.tar.gz -C /opt

解压完成之后去把文件夹改名 方便后续使用

cd /opt

mv zookeeper-3.4.6/ zkpr

接下来配置环境变量

vi /etc/profile

export ZK_HOME=/opt/zkpr

export PATH=$JAVA_HOME/bin:$JAVA_HOME/jre/bin:$HADOOP_HOME/bin:$HADOOP_HOME/sbin:$ZK_HOME/bin:$PATH

退出保存,别忘了source

source /etc/profile

cd zkpr/conf/

将zoo_sample.cfg 改名 zoo.cfg 方便使用

mv zoo_sample.cfg zoo.cfg

到zkpr下面创建zkdata和zklogs 等会配置 zoo.cfg 会用到

cd /opt/zkpr

mkdir zkdata

mkdir zklogs

修改 zoo.cfg

vi zoo.cfg

找到原有的 dataDir 那一行 进行修改并添加 如下:

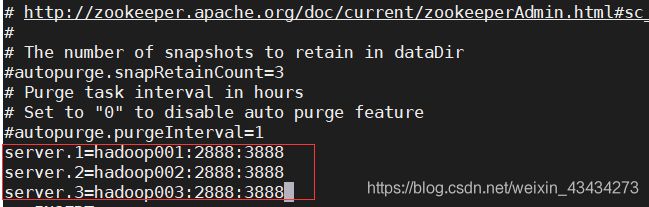

在末尾添加:

maxClientCnxns=0

initLimit=50

dataDir=/opt/zkpr/zkdata

dataLogDir=/opt/zkpr/zklogs

server.1=hadoop001:2888:3888

server.2=hadoop002:2888:3888

server.3=hadoop003:2888:3888

其中hadoop001 / 002 / 003 是你的三台机器名

下面把包和修改过的文件都发给另外两台机器

scp /etc/profile root@hadoop002:/etc/profile

scp /etc/profile root@hadoop003:/etc/profile

scp -r /opt/zkpr/ root@hadoop002:/opt

scp -r /opt/zkpr/ root@hadoop003:/opt

发送完成之后,千万别忘了另外两台虚拟机 也执行 source /etc/profile ,因为环境变量也发过去了 !!!

三台虚拟机都直接 vi 创建并编辑 zkdata/myid 文件

vi zkdata/myid

第一台写入: 1

第二台写入: 2

第三台写入: 3

分别退出保存

下面来启动 zookeeper

三台分别输入以下命令进行启动

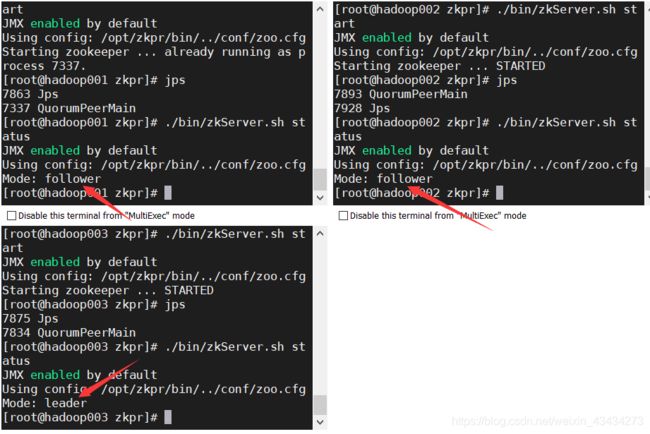

./bin/zkServer.sh start

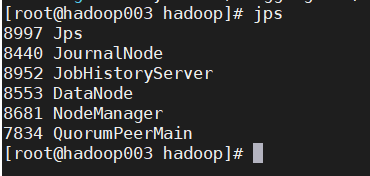

同时 jps 看一下 QuorumPeerMain 是否启动,如下图即为启动成功

再查看一下主从关系输入./bin/zkServer.sh status

其中主节点一定为 follower ,另外两台随机产生一个 leader

3、hadoop相关文件配置

cd /opt/hadoop/etc/hadoop

修改core-site.xml

vi core-site.xml

这里配置name集群的名称 这里取名称为 ns

zookeeper 2181地址

这里的hadoop安装路径是在 /opt 下 hadoop001:2181,hadoop002:2181,hadoop003:2181中的

hadoop001 /002 / 003 是三台虚拟机的主机名 其余可以不变

完整配置文件如下:

<configuration>

<property>

<name>fs.defaultFS</name>

<value>hdfs://ns</value>

</property>

<property>

<name>hadoop.tmp.dir</name>

<value>/opt/hadoop/tmp</value>

</property>

<!-- 指定zookeeper地址 -->

<property>

<name>ha.zookeeper.quorum</name>

<value>hadoop001:2181,hadoop002:2181,hadoop003:2181</value>

</property>

<property>

<name>hadoop.proxyuser.root.hosts</name>

<value>*</value>

</property>

<property>

<name>hadoop.proxyuser.root.groups</name>

<value>*</value>

</property>

<property>

<name>hadoop.native.lib</name>

<value>false</value>

<description>Should native hadoop libraries, if present, be used.

</description>

</property>

</configuration>

修改hdfs.site.xml

vi hdfs-site.xml

这里主要配置

nameservices集群下面的各个nameservice服务对应的映射

rpc-address 的地址9000

http-address的地址50070

journalnode的共享地址(各个datanode)

qjournal://datanode:8485;列表/集群名

出错处理,切换方式及隔离机制的设置

完整配置文件如下:

<configuration>

<!--节点数,ha中可不配置-->

<property>

<name>dfs.replication</name>

<value>3</value>

</property>

<!--指定名称服务,ns要与core-site.xml中的ns一致-->

<property>

<name>dfs.nameservices</name>

<value>ns</value>

</property>

<!--指定名称服务下的namenode节点-->

<property>

<name>dfs.ha.namenodes.ns</name>

<value>hadoop001,hadoop002</value>

</property>

<!--rpc地址,9000端口-->

<property>

<name>dfs.namenode.rpc-address.ns.hadoop001</name>

<value>hadoop001:9000</value>

</property>

<property>

<name>dfs.namenode.rpc-address.ns.hadoop002</name>

<value>hadoop002:9000</value>

</property>

<!--rpc地址,9000端口-->

<property>

<name>dfs.namenode.rpc-address.ns.hadoop001</name>

<value>hadoop001:9000</value>

</property>

<property>

<name>dfs.namenode.rpc-address.ns.hadoop002</name>

<value>hadoop002:9000</value>

</property>

<!--http地址,50070端口,即页面地址-->

<property>

<name>dfs.namenode.http-address.ns.hadoop001</name>

<value>hadoop001:50070</value>

</property>

<property>

<name>dfs.namenode.http-address.ns.hadoop002</name>

<value>hadoop002:50070</value>

</property>

<!--namenode在journalnode(datanode)上存放数据的端口8485-->

<property>

<name>dfs.namenode.shared.edits.dir</name>

<value>qjournal://hadoop001:8485;hadoop002:8485;hadoop003:8485/ns</value>

</property>

<!-- 开启NameNode失败自动切换 -->

<property>

<name>dfs.ha.automatic-failover.enabled</name>

<value>true</value>

</property>

<!-- 配置失败自动切换实现方式 -->

<property>

<name>dfs.client.failover.proxy.provider.ns</name>

<value>org.apache.hadoop.hdfs.server.namenode.ha.ConfiguredFailoverProxyProvider</value>

</property>

<!--设置隔离机制,多个机制换行分割,每个机制占用一行 -->

<property>

<name>dfs.ha.fencing.methods</name>

<value>sshfence

shell(/bin/true)

</value>

</property>

<!-- 配置sshfence隔离机制超时时间 -->

<property>

<name>dfs.ha.fencing.ssh.connect-timeout</name>

<value>30000</value>

</property>

<property>

<name>dfs.webhdfs.enabled</name>

<value>true</value>

</property>

</configuration>

修改yarn-site.xml

vi yarn-site.xml

这里主要配置

允许ha高可用

resourcemanager集群配置

rm-ids:rm1,rm2

rm1:nm1 及端口配置8088

rm2:nm2 及端口配置8088

zookeeper配置

完整配置文件如下:

<configuration>

<!--HA配置-->

<!--开启HA-->

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!--指定resourcemanager(rm)集群id-->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>cluster_id</value>

</property>

<!--resourcemanager(rm)集群的名称服务-->

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<!--指定rm映射关系-->

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>hadoop001</value>

</property>

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>hadoop002</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address.rm1</name>

<value>hadoop001:8088</value>

</property>

<property>

<name>yarn.resourcemanager.webapp.address.rm2</name>

<value>hadoop002:8088</value>

</property>

<!--配置zookeeper集群-->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>hadoop001:2181,hadoop002:2181,hadoop003:2181</value>

</property>

<!-- Site specific YARN configuration properties -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<property>

<name>yarn.nodemanager.aux-services.mapreduce.shuffle.class</name>

<value>org.apache.hadoop.mapred.ShuffleHandler</value>

</property>

<!-- 日志聚集功能使用 -->

<property>

<name>yarn.log-aggregation-enable</name>

<value>true</value>

</property>

<!-- 日志保留时间设置7天 -->

<property>

<name>yarn.log-aggretion.retain-seconds</name>

<value>604800</value>

</property>

</configuration>

修改mapred-site.xml

vi mapred-site.xml

以下为完整配置文件:

其中IP地址根据自己IP改一下

jobhistory我都选用了第二台虚拟机来承担

<configuration>

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

<property>

<name>mapreduce.jobhistory.address</name>

<value>192.168.116.41:10020</value>

</property>

<property>

<name>mapreduce.jobhistory.webapp.address</name>

<value>192.168.116.41:19888</value>

</property>

</configuration>

4、启动hadoop集群

再启动之前一定要保证

三台集群一致

确保集群处于关闭状态

zookeeper要启动 zkServer.sh start

三台机器一起删除tmp文件夹

rm -rf tmp/

hadoop-daemon.sh start journalnode

选择主节点重新format

hadoop namenode -format

很重要:把主节点新生成的tmp文件夹复制到备用节点(hadoop002)

scp -r tmp hadoop002:$PWD

启动整个集群 start-all.sh

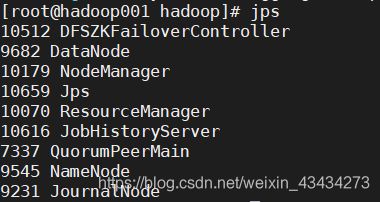

输入 jps 查看服务启动情况

主节点:

副节点1:

副节点2:

启动 zkfc

首先我们要明确ZKFC 是什么,有什么作用:

zkfc是什么? ZooKeeperFailoverController

它是什么?是Hadoop中通过ZK实现FC功能的一个实用工具。

主要作用:作为一个ZK集群的客户端,用来监控NN的状态信息。

谁会用它?每个运行NN的节点必须要运行一个zkfc

启动之前要先在两个备用节点上启动备用 resourcemanager

yarn-daemon.sh start resourcemanager

在主节点格式化zkfc:

hdfs zkfc -formatZK

主备节点都要启动zkfc:

hadoop-daemon.sh start zkfc

最后启动历史服务:

我这里是第一台和第二台承担了历史服务

mr-jobhistory-daemon.sh start historyserver

jps三台查看服务开启情况

最终的服务启动情况如下

主节点(hadoop001):

备用节点1(hadoop002):

节点2(hadoop003):

5、hadoop HA 模式测试

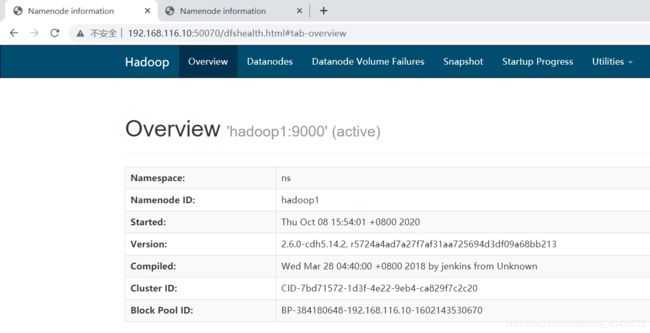

1、打开50070端口查看namenode 状态

hadoop001: active

hadoop002: standby

2、kill掉hadoop001的namenode进程号,看hadoop002的namenode是否能够由standby转为active状态

kill -9 9545

如图所示即为测试成功!

再次启动hadoop001的namenode

hadoop-daemon.sh start namenode