机器学习实战(一)——K邻近算法及其python实现

目录

1.k-邻近算法介绍

2.python实现

2.1从文件中读取数据

2.2 数据归一化

2.3 使用KNN算法对待分类的数据进行预测

2.4 测试数据

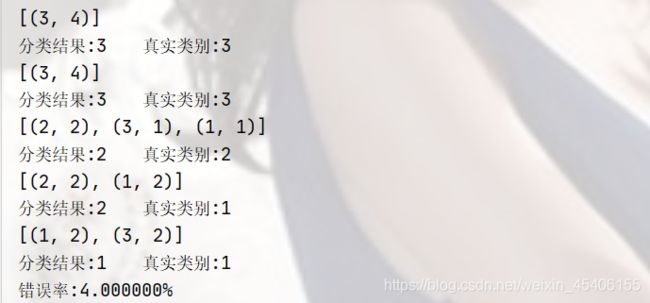

2.5测试结果

3.参考文献

1. k-邻近算法介绍

k邻近算法思想简单,但其错误率与最优贝叶斯判别器差距不超过2倍。

基本思想:给定带有标签的训练集,给定一个没有标签的数据(也就是待分类的数据),将这个数据的样本特征和训练集的样本特征进行对比,然后选择出训练集中最相近的k个训练样本,待分类的数据的标签就是这k个训练样本中出现次数最多的标签。

k邻近法最大的优点就是简单,其不具有显示的学习过程,是无参数学习算法。缺点就是计算复杂度高(计算距离),样本空间复杂度高(需要保存所有的训练样本),训练数据较小时泛化能力很差,容易陷入过拟合。

k邻近算法最重要是需要选择合适的距离度量和合适的k值,k值一般不超过20。

2. python实现

2.1 从文件中读取数据

文件集样例如下:需要将训练数据的样本特征矩阵和标签提取出来

数据集下载

"""

Parameters:

filename - 文件名

Returns:

returnMat - 特征矩阵

classLabelVector - 分类Label向量

"""

def Readfile(filename = 'file.txt'):

file = open(filename,'r',encoding='utf-8')

lines = file.readlines()

# 针对有BOM的UTF-8文本,应该去掉BOM,否则后面会引发错误。

lines[0] = lines[0].lstrip('\ufeff')

numberOflines = len(lines)

Mat = np.zeros((numberOflines,3))#解析文件,返回样本矩阵

label = [] #样本的标签

idx = 0

for line in lines:

line = line.strip()

line = line.split("\t")

Mat[idx,:] = line[0:3]

label.append(int(line[-1]))

idx += 1

return Mat,label2.2 数据归一化

数据归一化:只需要将每一维度的特征减去该维度特征的最小值,然后再除以该维度样本特征的最大值-最小值

"""

函数说明:对数据进行归一化

Parameters:

dataSet - 特征矩阵

Returns:

normData - 归一化后的特征矩阵

ranges - 数据范围

minVals - 数据最小值

"""

def Norm(dataSet):

min = dataSet.min(0)

max = dataSet.max(0)

ranges = max - min

normData = np.zeros(np.shape(dataSet))

m = dataSet.shape[0]

normData = dataSet - np.tile(min, (m,1))#每个维度减去该维度的最小值,然后再除以最大值-最小值

normData = normData / np.tile(ranges, (m, 1))

# 返回归一化数据结果,数据范围,最小值

return normData, ranges, min2.3 使用KNN算法对待分类的数据进行预测

1.计算出训练集中所有样本和待预测的数据之间的距离

2.然后将距离进行降序排序

3.选出距离最近的k个样本

4.这k个样本中出现次数最多的标签即为待预测的数据的标签

"""

函数说明:kNN算法,分类器

Parameters:

data - 用于分类的数据(测试集)

dataSet - 用于训练的数据(训练集)

labes - 分类标签

k - kNN算法参数,选择距离最小的k个点

Returns:

sortedClassCount[0][0] - 分类结果

"""

def classif(data, dataSet, labels, k):

# numpy函数shape[0]返回dataSet的行数

dataSetSize = dataSet.shape[0]

# 在列向量方向上重复inX共1次(横向),行向量方向上重复inX共dataSetSize次(纵向)

diffMat = np.tile(data, (dataSetSize, 1)) - dataSet

# 二维特征相减后平方

sqDiffMat = diffMat ** 2

# sum()所有元素相加,sum(0)列相加,sum(1)行相加

sqDistances = sqDiffMat.sum(axis=1)

# 开方,计算出距离

distances = sqDistances ** 0.5

# 返回distances中元素从小到大排序后的索引值

sortedDistIndices = distances.argsort()

# 定一个记录类别次数的字典

classCount = {}

for i in range(k):

# 取出前k个元素的类别

voteIlabel = labels[sortedDistIndices[i]]

# dict.get(key,default=None),字典的get()方法,返回指定键的值,如果值不在字典中返回默认值。

# 计算类别次数

classCount[voteIlabel] = classCount.get(voteIlabel, 0) + 1

# python3中用items()替换python2中的iteritems()

# key=lambda item:item[0]根据字典的值进行排序

# key=lambda item:item[1]根据字典的键进行排序

# reverse = True 降序排序字典

sortedClassCount = sorted(classCount.items(), key=lambda item:item[1], reverse=True)

print(sortedClassCount)

# 返回次数最多的类别,即所要分类的类别

return sortedClassCount[0][0]2.4 测试数据

将数据集中10%的数据作为测试数据,使用KNN分类器进行分类,计算出分类错误的概率

"""

函数说明:分类器测试函数

取百分之十的数据作为测试数据,检测分类器的正确性

Parameters:

无

Returns:

无

"""

def datingClassTest():

# 打开的文件名

filename = "file.txt"

# 将返回的特征矩阵和分类向量分别存储到datingDataMat和datingLabels中

datingDataMat, datingLabels = Readfile(filename)

# 取所有数据的百分之十

hoRatio = 0.10

# 数据归一化,返回归一化后的矩阵,数据范围,数据最小值

normMat, ranges, minVals = Norm(datingDataMat)

# 获得normMat的行数

m = normMat.shape[0]

# 百分之十的测试数据的个数

numTestVecs = int(m * hoRatio)

# 分类错误计数

errorCount = 0.0

for i in range(numTestVecs):

# 前numTestVecs个数据作为测试集,后m-numTestVecs个数据作为训练集

classifierResult = classif(normMat[i, :], normMat[numTestVecs:m, :],

datingLabels[numTestVecs:m], 4)

print("分类结果:%s\t真实类别:%d" % (classifierResult, datingLabels[i]))

if classifierResult != datingLabels[i]:

errorCount += 1.0

print("错误率:%f%%" % (errorCount / float(numTestVecs) * 100))2.5 测试结果

3. 参考文献

https://cuijiahua.com/blog/2017/11/ml_1_knn.html