5.1神经元模型

神经网络是由具有适应性的简单单元组成的广泛并行互连的网络。神经网络中最基本的成分是神经元模型,即“简单单元”。

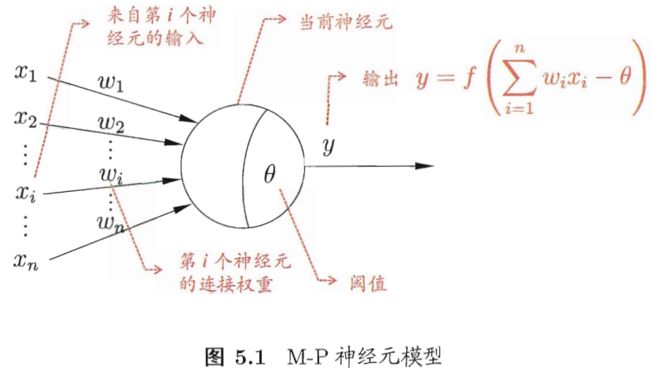

在生物神经网络中,一个神经元“兴奋”时,会向相连的神经元发送化学物质,改变它们的电位,如果电位超过一个阈值,会被激活,即“兴奋”起来。抽象为M-P神经元模型:神经元接收来自n个其他神经元传递过来的输入信号,输入信号通过带权重的连接进行传递,神经元收到的总输入值与阈值比较,然后通过“激活函数”产生神经元的输出。

理想的激活函数是图5.2(a)所示的阶跃函数,输出值1对应神经元兴奋,0对应神经元抑制,缺点是不连续,不光滑。常用的激活函数是Sigmoid函数,输出值挤压在(0,1)内,又称挤压函数,如图5.2(b)所示

将神经网络视为包含了许多参数的数学模型,这个模型是若干个函数。

5.2感知机与多层网络

感知机由两层神经元组成,输入层接收外界输入信号后传递给输出层,输出层是M-P神经元,也称“阈值逻辑单元”

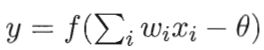

感知机能够实现逻辑与、或、非运算。假定激活函数f是阶跃函数,利用

可得到

感知机的学习规则:对训练样例(x,y),若当前感知机的输出为,则调整感知机权重:

机器学习笔记 - 线性可分问题 - 闲敲棋子落灯花 - CSDN博客

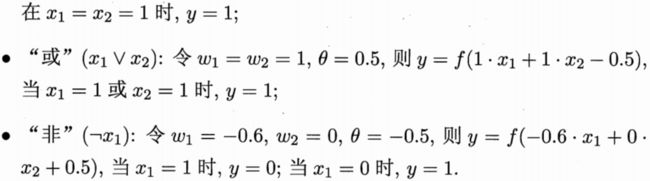

上述与、或、非问题都是线性可分的问题,即存在一个线性超平面将它们分开开,如图5.4(a)-(c)所示,感知机的学习过程会收敛,否则学习过程中会发生震荡。感知机不能解决如图5.4(d)所示的非线性可分问题

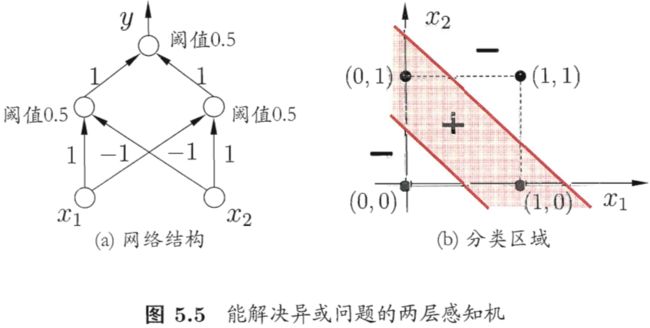

要解决非线性可分问题,要使用多层功能神经元,如图5.5所示的两层感知机能解决异或问题。在图5.5(a)中,输入层与输出层之间的一层神经元之间的一层神经元称为隐层或隐含层,隐含层和输出层神经元都是有激活函数的功能神经元。

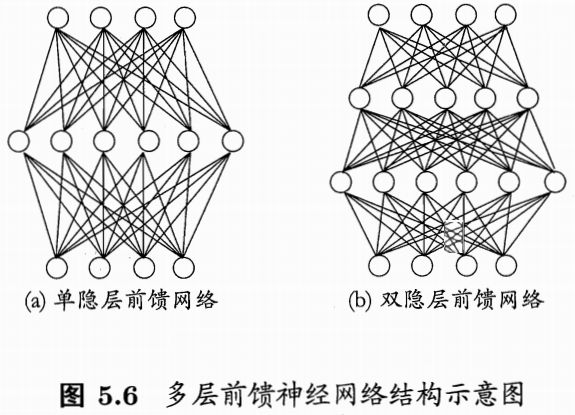

多层前馈神经网络:每层神经元与下一层神经元全互连,神经元之间不存在同层连接和跨层连接。其中输入层神经元接收外界输入,隐层与输出层神经元对信号加工,由输出神经元输出结果,如图5.6所示

5.3误差逆传播算法

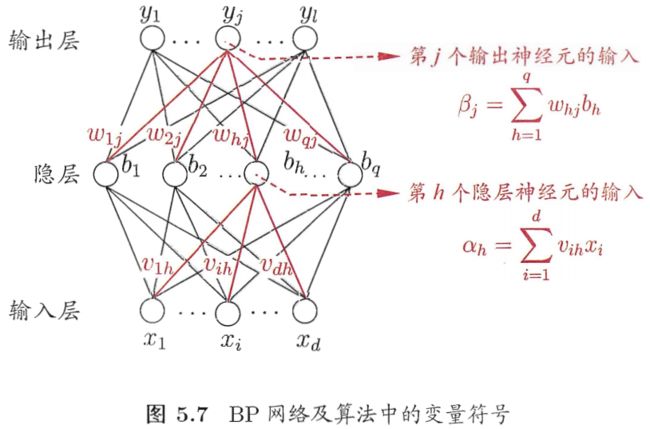

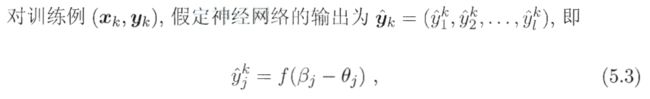

误差逆传播(简称BP)算法,可训练多层网络。通常说“BP网络”是指用BP算法训练的多层前馈神经网络。图5.7是一个由d个输入神经元、l个输出神经元、q个隐层神经元的多层前馈网络结构。假设隐层和输出层神经元使用的激活函数是Sigmoid函数。所示的网络有几个参数要确定:输入层到隐层的dq个权值、隐层到输出层的ql个权值,q个隐层神经元的阈值、l个输出层神经元的阈值。

学习率控制算法每一轮迭代中的更新步长,太大容易震荡,太小收敛速度过慢

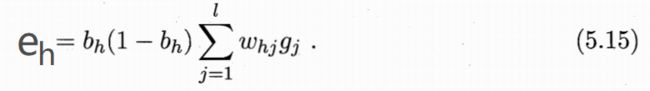

上述算法的一些公式定义如下:

表示输出层第j个神经元的阈值。

BP算法关于的更新公式:

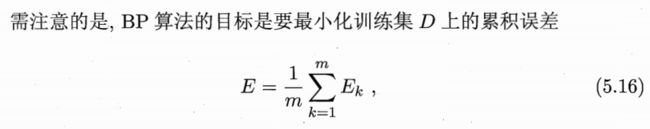

累计误差逆传播算法:推导基于累积误差最小化的更新规则。

为了达到同样的累计误差极小点,标准BP算法需进行更多次的迭代,累计BP算法在读取整个训练集D一遍后才对参数进行更新,参数更新频率低。但累计误差下降到一定程度后再下降会非常缓慢,这时标准BP会更快获得较好的解。

用“试错法”设置隐含神经元的个数

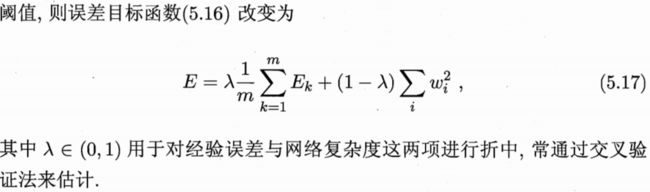

两种策略来环节BP网络的过拟合:1、“早停”:将数据分为训练集和验证集,训练集计算梯度、更新连接权和阈值,验证集估计误差,若训练集误差降低但验证集误2差升高,则停止训练,同时返回据具有最小验证集误差的连接权和阈值 2、“正则化”:在误差目标函数中增加一个用于描述网络复杂度的部分,例如连接权与阈值的平方和。如下所示:

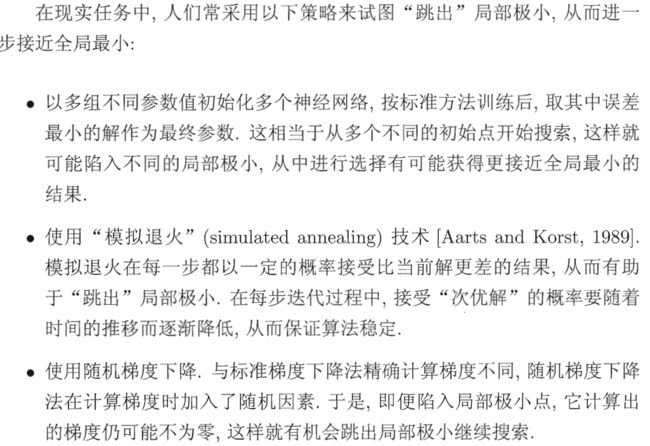

5.4全局最小与局部极小

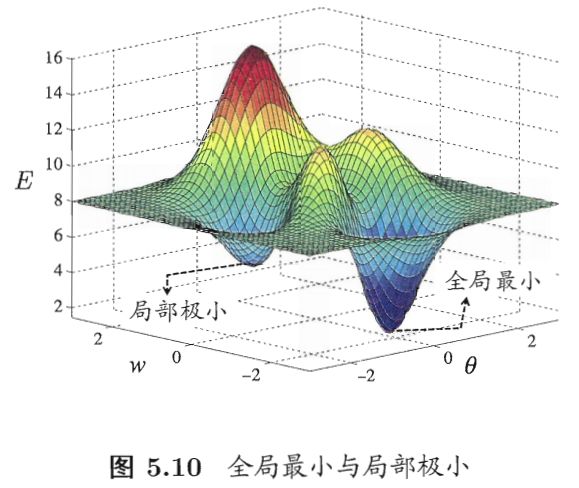

神经网络在训练集上的误差E是连接权w和阈值的函数。神经网络的训练过程可看作一个参数寻优过程,使得E最小。

两种“最优”:局部极小解是参数空间的某个点,其邻域点的误差函数值均不小于该点的函数值。全局最小解是参数空间中所有点的误差函数值均不小于该点的函数误差值。如图5.10所示,有两个局部最小,但只有一个是全局最小,在参数寻优过程希望找到全局最小

5.5其他常见神经网络

5.5.1RBF网络

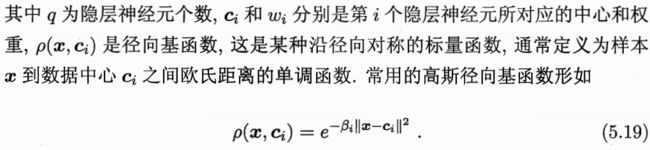

RBF(径向基函数)网络是一种单隐层前馈神经网络,使用径向基函数作为隐层神经元激活函数,而输出层是对隐层神经元输出的线性组合。假设输入为d维向量x,输出为实值,则RBF网络定义为

5.5.2ART网络

竞争性学习是神经网络中一种常用的无监督学习策略,网络的输出神经元相互竞争,每一时刻仅有一个竞争胜利的神经元被激活,其他神经元被抑制,称为“胜者通吃”原则。

ART(自适应谐振理论)网络是竞争性学习的重要代表,该网络由比较层、识别层、识别阈值和重置模块构成。比较层负责接收输入样本,传递给识别层神经元。识别层每个神经元对应一个模式类,识别层神经元之间相互竞争产生获胜神经元。

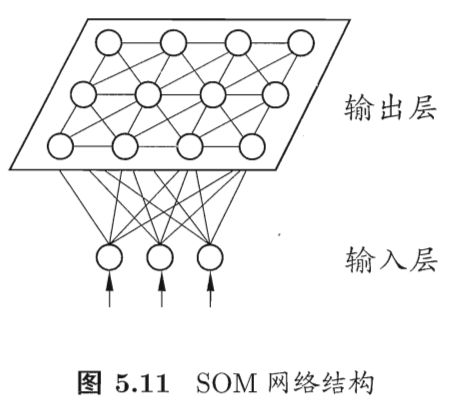

5.5.3SOM网络

SOM(自组织映射)网络将高维输入数据映射到低维空间(通常为二维),同时保持输入数据在高维空间的拓扑结构,即将高维空间中相似的样本点映射到网络输出层中的邻近神经元。

训练目标:为每个输出层神经元找到合适的权向量,达到保持拓扑结构的目的

训练过程:每个输出层神经元计算接收的训练样本与自身携带的权向量的距离。距离最近的神经元竞争获胜,称最佳匹配单元。最佳匹配单元与邻近神经元的权向量会被调整使得权向量与当前输入样本距离减小,过程不断迭代直至收敛

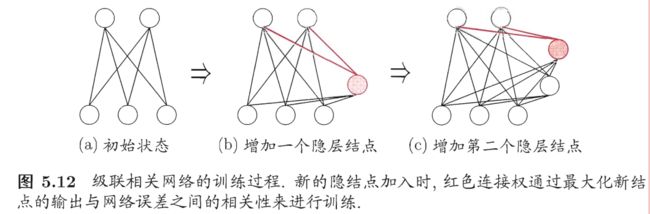

5.5.4级联相关网络

级联相关网络是结构自适应网络的代表

级联是指建立层次连接的层级结构,刚开始训练时网络只有输入层和输出层,是最小拓扑结构,随着训练的进行,加入新的隐层神经元,其输入端连接权值是固定的。相关是指通过最大化新神经元的输出与网络误差之间的相关性来训练相关的参数

5.5.5 Elman网络

递归神经网络允许网络中出现环形结构,从而使神经元的输出反馈可作为输入信号。Elman网络是常用的递归神经网络。

如图5.14,隐层神经元的输出被反馈回来,与下一时刻输入层神经元提供的信号一起作为隐层神经元在下一刻的输入。隐层神经元常使用Sigmoid激活函数

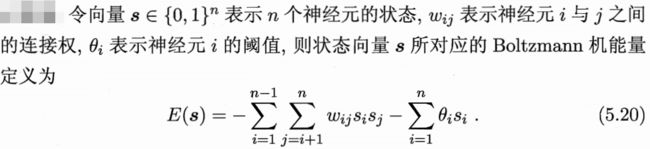

5.5.6 Boltzmann机

如图5.14(a)所示,Boltzmann机的神经元分为显层和隐层,显层用于数据的输入与输出,隐层是数据的内在表达。其神经元是布尔型的,状态1表示激活,0表示抑制。受限Boltzmann机仅保留显层和隐层的连接,将Boltzmann机结构由完全图简化为二部图

5.6深度学习

理论上,参数越多的模型复杂度越高、“容量”越大,能完成更复杂的学习任务

典型的深度学习模型是很深层的神经网络,对神经网络模型,从增加模型复杂度的角度看,增加隐层数比增加隐层神经元数更有效,因为前者不仅增加拥有激活函数的神经元数目,还增加了激活函数嵌套的层数。

无监督逐层训练是多隐层网络训练的手段。每次训练一层隐结点,训练时将上一层隐结点的输出作为输入,本层隐结点的输出作为下一层隐结点的输入,称"预训练”,在预训练全部完成后,对整个网络进行“微调”。运用于深度信念网络(简称DBN)

节省训练开销:1、预训练+微调:可视为大量参数分组,对每组先找到局部看来较好的设置,基于这些局部较优的结果联合起来进行全局寻优 2、权共享:一组神经元使用相同的连接权,这在卷积神经网络(简称CNN)中有很大作用。

深度学习可看作是对输入信号进行逐层加工,将输入表示转化为与输出目标联系更密切的表示。即通过多层处理,逐渐把初始的“低层”特征转化为“高层”特征表示后,用“简单模型”即可完成复杂的学习任务,可将深度学习理解为进行“特征学习”或“表示学习”