Impala概述及其安装部署

文章目录

- 一、概述

-

- 1.基本概念

- 2.Impala与Hive关系

- 3.Impala与Hive异同

- 4.Impala架构

- 二、安装部署(以Node01节点为例)

-

- 1.安装前提

- 2.下载安装包、依赖包

- 3.配置本地yum源

- 4.安装Impala

- 5.修改Hadoop、Hive配置

- 7.修改impala配置

- 8.启动关闭impala服务

一、概述

1.基本概念

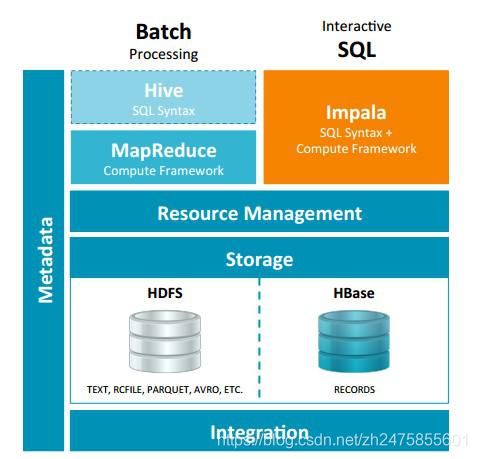

impala是cloudera提供的一款高效率的sql查询工具,提供实时的查询效果,官方测试性能比hive快10到100倍,其sql查询比sparkSQL还要更加快速,号称是当前大数据领域最快的查询sql工具。

impala是参照谷歌的新三篇论文(Caffeine–网络搜索引擎、Pregel–分布式图计算、Dremel–交互式分析工具)当中的Dremel实现而来,其中旧三篇论文分别是(BigTable,GFS,MapReduce)分别对应我们即将学的HBase和已经学过的HDFS以及MapReduce。

impala是基于hive并使用内存进行计算,兼顾数据仓库,具有实时,批处理,多并发等优点。

2.Impala与Hive关系

-

impala是基于hive的大数据分析查询引擎,直接使用hive的元数据库metadata,意味着impala元数据都存储在hive的metastore当中,并且impala兼容hive的绝大多数sql语法。所以需要安装impala的话,必须先安装hive,保证hive安装成功,并且还需要启动hive的metastore服务。

-

Hive元数据包含用Hive创建的database、table等元信息。元数据存储在关系型数据库中,如Derby、MySQL等。

-

客户端连接metastore服务,metastore再去连接MySQL数据库来存取元数据。有了metastore服务,就可以有多个客户端同时连接,而且这些客户端不需要知道MySQL数据库的用户名和密码,只需要连接metastore 服务即可。

-

Hive适合于长时间的批处理查询分析,而Impala适合于实时交互式SQL查询。可以先使用hive进行数据转换处理,之后使用Impala在Hive处理后的结果数据集上进行快速的数据分析。

3.Impala与Hive异同

-

相同点

Impala 与Hive都是构建在Hadoop之上的数据查询工具各有不同的侧重适应面,但从客户端使用来看Impala与Hive有很多的共同之处,如数据表元数据、ODBC/JDBC驱动、SQL语法、灵活的文件格式、存储资源池等。 -

不同点

-

Impala使用的优化技术不同

使用LLVM产生运行代码,针对特定查询生成特定代码,同时使用Inline的方式减少函数调用的开销,加快执行效率。(C++特性)充分利用可用的硬件指令(SSE4.2)。

更好的IO调度,Impala知道数据块所在的磁盘位置能够更好的利用多磁盘的优势,同时Impala支持直接数据块读取和本地代码计算checksum。

通过选择合适数据存储格式可以得到最好性能(Impala支持多种存储格式)。

最大使用内存,中间结果不写磁盘,及时通过网络以stream的方式传递。

-

架构不同:

没有使用 MapReduce进行并行计算,虽然MapReduce是非常好的并行计算框架,但它更多的面向批处理模式,而不是面向交互式的SQL执行。与 MapReduce相比,Impala把整个查询分成一执行计划树,而不是一连串的MapReduce任务,在分发执行计划后,Impala使用拉式获取数据的方式获取结果,把结果数据组成按执行树流式传递汇集,减少的了把中间结果写入磁盘的步骤,再从磁盘读取数据的开销。Impala使用服务的方式避免每次执行查询都需要启动的开销,即相比Hive没了MapReduce启动时间。 -

执行计划不同:

Hive: 依赖于MapReduce执行框架,执行计划分成 map->shuffle->reduce->map->shuffle->reduce…的模型。如果一个Query会 被编译成多轮MapReduce,则会有更多的写中间结果。由于MapReduce执行框架本身的特点,过多的中间过程会增加整个Query的执行时间。Impala: 把执行计划表现为一棵完整的执行计划树,可以更自然地分发执行计划到各个Impalad执行查询,而不用像Hive那样把它组合成管道型的 map->reduce模式,以此保证Impala有更好的并发性和避免不必要的中间sort与shuffle。

执行计划:数据库内部对SQL语句分析后决定的执行路径和执行步骤。

4. 获取数据流方式不同:

Hive: 采用推的方式,每一个计算节点计算完成后将数据主动推给后续节点。

Impala: 采用拉的方式,后续节点通过getNext主动向前面节点要数据,以此方式数据可以流式的返回给客户端,且只要有1条数据被处理完,就可以立即展现出来,而不用等到全部处理完成,更符合SQL交互式查询使用。

-

内存使用方式不同:

Hive: 在执行过程中如果内存放不下所有数据,则会使用外存,以保证Query能顺序执行完。每一轮MapReduce结束,中间结果也会写入HDFS中,同样由于MapReduce执行架构的特性,shuffle过程也会有写本地磁盘的操作。Impala: 在遇到内存放不下数据时,版本1.0.1是直接返回错误,而不会利用外存,以后版本应该会进行改进。这使用得Impala目前处理Query会受到一定的限制,最好还是与Hive配合使用。

-

调度方式不同:

Hive: 任务调度依赖于Hadoop的调度策略。Impala: 调度由自己完成,目前只有一种调度器simple-schedule,它会尽量满足数据的局部性,扫描数据的进程尽量靠近数据本身所在的物理机器。调度器 目前还比较简单,在SimpleScheduler::GetBackend中可以看到,现在还没有考虑负载,网络IO状况等因素进行调度。但目前 Impala已经有对执行过程的性能统计分析,应该以后版本会利用这些统计信息进行调度。

-

应用场景不同:

Hive: 复杂的批处理查询任务,数据转换任务。Impala:实时数据分析,因为不支持UDF,能处理的问题域有一定的限制,与Hive配合使用,对Hive的结果数据集进行实时分析。

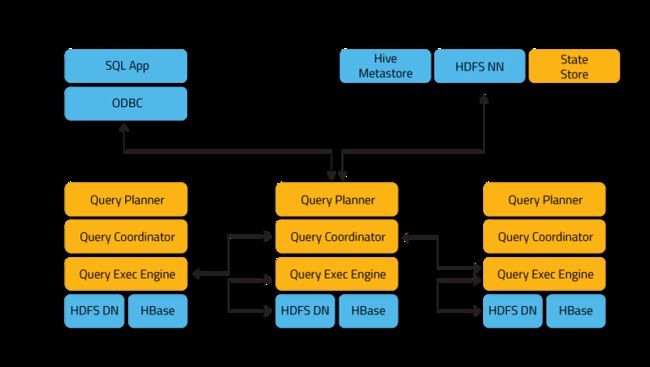

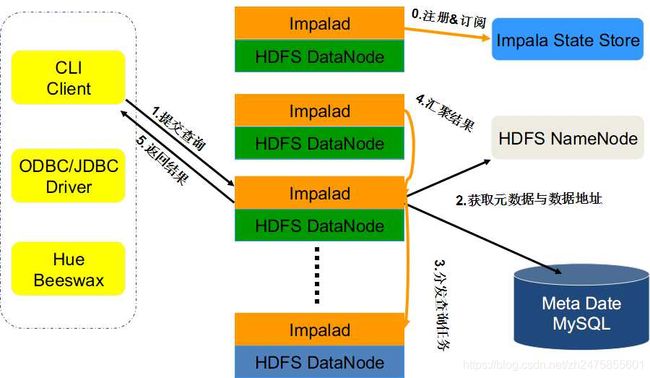

4.Impala架构

-

Impalad

与DataNode运行在同一节点上,由Impalad进程表示,它接收客户端的查询请求(接收查询请求的Impalad为Coordinator(协调器),Coordinator通过JNI调用java前端解释SQL查询语句,生成查询计划树,再通过调度器把执行计划分发给具有相应数据的其它Impalad进行执行),读写数据,并行执行查询,并把结果通过网络流式的传送回给Coordinator,由Coordinator返回给客户端。同时Impalad也与State Store保持连接,用于确定哪个Impalad是健康和可以接受新的工作。在Impalad中启动三个ThriftServer: beeswax_server(连接客户端),hs2_server(借用Hive元数据), be_server(Impalad内部使用)和一个ImpalaServer服务。

-

State Store

State Store: 跟踪集群中的Impalad的健康状态及位置信息,由statestored进程表示,它通过创建多个线程来处理Impalad的注册订阅和与各Impalad保持心跳连接,各Impalad都会缓存一份State Store中的信息,当State Store离线后(Impalad发现State Store处于离线时,会进入recovery模式,反复注册,当State Store重新加入集群后,自动恢复正常,更新缓存数据)因为Impalad有State Store的缓存仍然可以工作,但会因为有些Impalad失效了,而已缓存数据无法更新,导致把执行计划分配给了失效的Impalad,导致查询失败。 -

CLI

CLI: 提供给用户查询使用的命令行工具(Impala Shell使用python实现),同时Impala还提供了Hue,JDBC, ODBC使用接口。 -

Catalogd(目录)

Catalogd:作为metadata访问网关,从Hive Metastore等外部catalog中获取元数据信息,放到impala自己的catalog结构中。impalad执行ddl命令时通过catalogd由其代为执行,该更新则由statestored广播。 -

Impala查询处理过程

Impalad分为Java前端与C++处理后端,接受客户端连接的Impalad即作为这次查询的Coordinator,Coordinator通过JNI调用Java前端对用户的查询SQL进行分析生成执行计划树。

Java前端产生的执行计划树以Thrift数据格式返回给C++后端(Coordinator)(执行计划分为多个阶段,每一个阶段叫做一个PlanFragment,每一个PlanFragment在执行时可以由多个Impalad实例并行执行(有些PlanFragment只能由一个Impalad实例执行,如聚合操作),整个执行计划为一执行计划树)。

Coordinator根据执行计划,数据存储信息(Impala通过libhdfs与HDFS进行交互。通过hdfsGetHosts方法获得文件数据块所在节点的位置信息),通过调度器(现在只有simple-scheduler, 使用round-robin算法)Coordinator::Exec对生成的执行计划树分配给相应的后端执行器Impalad执行(查询会使用LLVM进行代码生成,编译,执行),通过调用GetNext()方法获取计算结果。

如果是insert语句,则将计算结果通过libhdfs写回HDFS当所有输入数据被消耗光,执行结束,之后注销此次查询服务。

二、安装部署(以Node01节点为例)

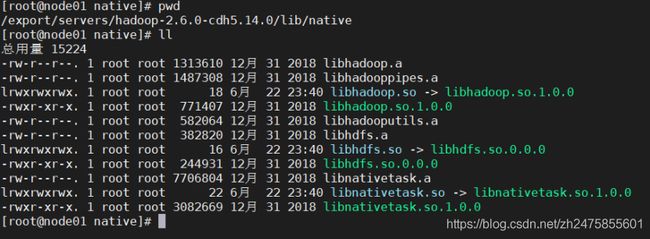

1.安装前提

- 集群提前安装好hadoop,hive。

- hive安装包scp在所有需要安装impala的节点上,因为impala需要引用hive的依赖包。

- hadoop框架需要支持C程序访问接口,查看下图,如果有该路径下有这么文件,就证明支持C接口。

- 同步linux系统时间

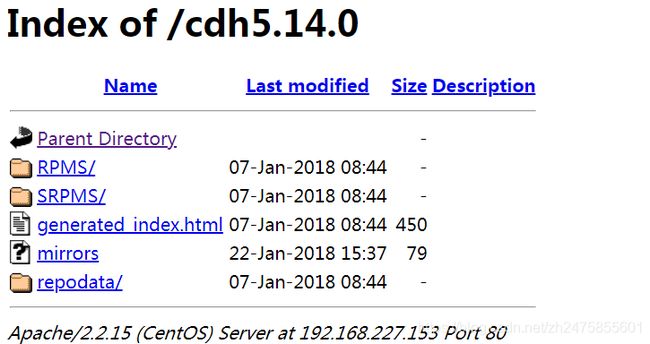

2.下载安装包、依赖包

需要下载到所有的rpm包,下载地址:

http://archive.cloudera.com/cdh5/repo-as-tarball/5.14.0/cdh5.14.0-centos6.tar.gz

3.配置本地yum源

- 上传安装包并解压

cd /export/soft

tar -zxvf cdh5.14.0-centos6.tar.gz -C ../servers

- 配置本地Yum源

-

安装Apache Server服务器:

yum -y install httpd

service httpd start

chkconfig httpd on -

配置本地yum源的文件:

cd /etc/yum.repos.d

vim CentOS-Media.repo

修改成以下内容:

[c6-media]

name=CentOS-$releasever - Media

baseurl=file:///export/servers/impala/5.14.0

gpgcheck=0

enabled=1

gpgkey=file:///etc/pki/rpm-gpg/RPM-GPG-KEY-CentOS-6

-

创建httpd读取的软连接:

ln -s /export/servers/impala/5.14.0 /var/www/html/5.14.0 -

配置node02、node03节点的网络yum源

cd /etc/yum.repos.d

vi CentOS-Media.repo

修改成以下内容:

[c6-media]

name=CentOS-$releasever - Media

baseurl=http://node01/5.14.0

gpgcheck=1

enabled=0

gpgkey=file:///etc/pki/rpm-gpg/RPM-GPG-KEY-CentOS-6

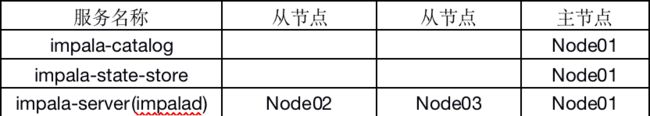

4.安装Impala

yum install -y impala impala-server impala-state-store impala-catalog impala-shell

- 从节点安装

在规划的从节点node02、node03执行以下命令进行安装:.

yum install -y impala-server

5.修改Hadoop、Hive配置

- 修改hive配置(在node01机器上进行配置,然后分发给其他2台机器)

vim /export/servers/hive/conf/hive-site.xml

添加以下内容:

<configuration>

<property>

<name>javax.jdo.option.ConnectionURL</name>

<value>jdbc:mysql://node-1:3306/hive?createDatabaseIfNotExist=true</value>

</property>

<property>

<name>javax.jdo.option.ConnectionDriverName</name>

<value>com.mysql.jdbc.Driver</value>

</property>

<property>

<name>javax.jdo.option.ConnectionUserName</name>

<value>root</value>

</property>

<property>

<name>javax.jdo.option.ConnectionPassword</name>

<value>hadoop</value>

</property>

<property>

<name>hive.cli.print.current.db</name>

<value>true</value>

</property>

<property>

<name>hive.cli.print.header</name>

<value>true</value>

</property>

<!-- 绑定运行hiveServer2的主机host,默认localhost -->

<property>

<name>hive.server2.thrift.bind.host</name>

<value>node-1</value>

</property>

<!-- 指定hive metastore服务请求的uri地址 -->

<property>

<name>hive.metastore.uris</name>

<value>thrift://node-1:9083</value>

</property>

<property>

<name>hive.metastore.client.socket.timeout</name>

<value>3600</value>

</property>

</configuration>

将hive-site.xml文件分发给其他两个机器:

cd /export/servers/hive/conf

scp -r hive-site.xml root@node02:$PWD

scp -r hive-site.xml root@node03:$PWD

- 修改hadoop配置

- 所有节点创建下述文件夹:

mkdir -p /var/run/hdfs-sockets

- 修改所有节点的hdfs-site.xml添加以下配置,修改完之后重启hdfs集群生效:

vim etc/hadoop/hdfs-site.xml

添加以下内容:

<property>

<name>dfs.client.read.shortcircuit</name>

<value>true</value>

</property>

<property>

<name>dfs.domain.socket.path</name>

<value>/var/run/hdfs-sockets/dn</value>

</property>

<property>

<name>dfs.client.file-block-storage-locations.timeout.millis</name>

<value>10000</value>

</property>

<property>

<name>dfs.datanode.hdfs-blocks-metadata.enabled</name>

<value>true</value>

</property>

其中:

dfs.client.read.shortcircuit 打开DFSClient本地读取数据的控制。

dfs.domain.socket.path是Datanode和DFSClient之间沟通的Socket的本地路径。

- 把更新hadoop的配置文件,scp给其他机器:

cd /export/servers/hadoop-2.7.5/etc/hadoop

scp -r hdfs-site.xml node-2:$PWD

scp -r hdfs-site.xml node-3:$PWD

-

给/var/run/hdfs-sockets赋予权限,如果用的是普通用户hadoop,那就直接赋予普通用户的权限,例如:

chown -R hadoop:hadoop /var/run/hdfs-sockets/

注意:root用户不需要该操作,普通用户需要这一步操作。 -

重启hadoop、hive

在node-1上执行下述命令分别启动hive metastore服务和hadoop

cd /export/servers/hive

nohup bin/hive --service metastore &

nohup bin/hive --service hiveserver2 &

cd /export/servers/hadoop-2.7.5/

sbin/stop-dfs.sh | sbin/start-dfs.sh

- 复制hadoop、hive配置文件

impala的配置目录为/etc/impala/conf,这个路径下面需要把core-site.xml,hdfs-site.xml以及hive-site.xml:

所有节点执行以下命令

cp -r /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/core-site.xml /etc/impala/conf/core-site.xml

cp -r /export/servers/hadoop-2.6.0-cdh5.14.0/etc/hadoop/hdfs-site.xml /etc/impala/conf/hdfs-site.xml

cp -r /export/servers/hive-1.1.0-cdh5.14.0/conf/hive-site.xml /etc/impala/conf/hive-site.xml

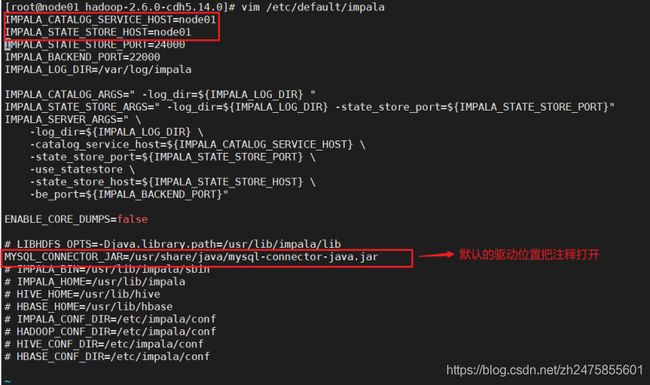

7.修改impala配置

- 修改impala默认配置

所有节点更改impala默认配置文件:

vim /etc/default/impala

IMPALA_CATALOG_SERVICE_HOST=node01

IMPALA_STATE_STORE_HOST=node01

ln -s /export/servers/hive-1.1.0-cdh5.14.0/lib/mysql-connector-java

5.1.38.jar/usr/share/java/mysql-connector-java.jar

- 修改bigtop配置

修改bigtop的java_home路径(3台机器):

vim /etc/default/bigtop-utils

export JAVA_HOME=/export/servers/jdk1.8.0_65

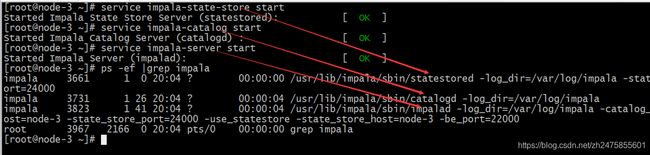

8.启动关闭impala服务

- 主节点node01启动以下三个服务进程

启动:

service impala-state-store start

service impala-catalog start

service impala-server start

关闭:

service impala-state-store start

service impala-catalog start

service impala-server start

- 从节点启动node02与node03impala-server

service impala-server start

- 查看impala进程是否存在

ps -ef | grep impala

- 启动之后所有关于impala的日志默认都在/var/log/impala

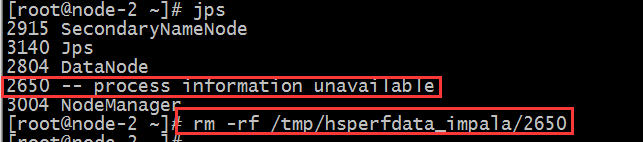

- 如果需要关闭impala服务 把命令中的start该成stop即可。注意如果关闭之后进程依然驻留,可以采取下述方式删况下除。正常情是随着关闭消失的。

解决方式:

4.impala Web Ui

访问impalad的管理界面:

http://node01:25000/

访问statestored的管理界面:

http://node01:25010/