一 为什么读这篇

大名鼎鼎的FCN,第一个去全连接层的全卷积网络,虽然最初是用于图像分割领域,但是对后来的网络也有不少启发。属于CV领域必读之一。

二 截止阅读时这篇论文的引用次数

2019.3.7 8197次。引用次数很多了。

三 相关背景介绍

UC伯克利出品,14年11月挂到arXiv上,中了2015年的CVPR,也在17年的TPAMI上出版。一作Jonathan Long是伯克利的PHD,毕业后去了Symbio Robotics,也是caffe的共同作者,神奇的是个人主页上就两篇paper。。二作Evan Shelhamer也是伯克利的PHD,也是caffe的作者,不过文章就很多了,三作Trevor Darrell是一作的老板。后来大名鼎鼎的ResNet,VGG,Faster R-CNN,U-Net,Inception v3,SSD,DenseNet,SegNet,DeepLab,Image-to-Image,STN都引用过此文。。

一作Jonathan Long个人主页:http://people.eecs.berkeley.edu/~jonlong/

官方实现:https://github.com/shelhamer/fcn.berkeleyvision.org

四 关键词

FCN

Semantic Segmentation

shift-and-stitch

patchwise training

五 论文的主要贡献

1 全卷积网络在分割任务上的第一个里程碑

2 提出skip net来用多尺度信息做精细预测

六 详细解读

0 摘要

本文的关键insight是构建"全卷积"网络,它能接收任意大小的输入并能在预测和学习时产生相应大小的输出。通过微调,将现代分类网络(AlexNet, VGG, GoogLeNet)迁移到分割任务上。也定义了一个全新的架构,将来自深的,粗糙的层的语义信息与来自浅的,精细的层的表面信息相结合,以生成准确且详细的分割。在PASCAL VOC,NYUDv2和SIFT Flow上都达到了SOTA,同时预测时间只有不到200ms。

1 介绍

本文工作是第一个端到端训练FCN来做像素级预测。网络通过上采样进行像素级预测,通过下采样进行学习。

patchwise训练很常见,但是与全卷积网络训练相比,缺乏效率。本文方法没有使用复杂的预处理和后处理,包括超像素,候选,或通过随机场或局部分类器进行post-hoc校正。

语义分割面临语义和位置之间的固有问题:全局信息解决是什么,局部信息解决在哪里。深度层次特征在局部到全局金字塔中联合编码位置和语义。本文定义了一种新的"skip"架构,将深的,粗糙的语义信息和浅的,精细的相结合,详见4.2节及图3。

2 相关工作

全卷积网络

最早使用任意输入的卷积网络应该是始于1991年。。

用卷积网络进行密集预测

最近各种方法的共同点如下:

1 小模型限制了容量和感受野

2 patchwise训练

3 通过超像素投影,随机场正则,过滤和局部分类进行后处理

4 由OverFeat引入的输入移位和输出交错用于密集输出

5 多尺度金字塔处理

6 用tanh做非线性以及Ensemble

而本文方法不用这些机制。

3 全卷积网络

FCN天生就可以对任意大小的输入进行操作,并产生相应(可能重新采样的)空间维度的输出。

当感受野明显重叠时,前向传播和反向传播在整个图像上逐层运算比独立的patch-by-patch运算更有效。

3.1 调整分类器以进行密集预测

典型的识别网络表面上采用固定输入,生成非空间输出。这些网络的全连接层是固定维度的,同时抛弃了空间坐标。然而,这些全连接层也可以视为内核为覆盖其整个输入区域的卷积。

3.2 Shift-and-stitch是滤波器稀疏的

输入移位和输出交错是一种由OverFeat提出的技巧,可以在没有插值的情况下从粗糙的输出中产生密集预测。 如果输出通过因子进行下采样,输入往右偏移x像素,往下偏移y像素,这些输入分别通过卷积网络,输出是交错的,因此预测对应于感受野中心的像素。

尽管在初步实验中用了shift-and-stitch,但最终模型没有用它(合着把OverFeat提出的这个东西当靶子了)。。。本文发现通过下采样学习,效果更好,效率更高,当与跳跃层融合时更是如此。

3.3 上采样是后向步幅的卷积

将粗糙输出连接到密集像素的另一种方法是差值。举个例子,简单的双线性插值通过线性映射计算来自最近的四个输入的每个输出,该线性映射仅取决于输入和输出单元的相对位置。

某种意义上,使用因子的上采样是输入步幅为的卷积。因此上采样称为输出步幅为的后向卷积(有时也称为反卷积)。

注意反卷积滤波器不需要固定(例如双线性上采样),而是可以学习的。一组反卷积层和激活函数的堆叠甚至可以学习非线性上采样。

本文实验发现网络中的上采样对于学习密集预测快速且有效。

3.4 Patchwise训练是有损采样

全卷积训练比patch的均匀采样更有效,因为它减少了大量潜在的batches。

4 分割架构

本文将ILSVRC分类器转化为FCNs并通过网络内的上采样和逐像素损失来增强它们用于密集预测。通过微调训练分割,接着构建创新的跳跃架构来结合粗糙的,语义信息和局部的,表面信息做精细预测。

实验对象为VOC2011分割挑战赛。用每个像素的多项逻辑损失训练,用考虑了所有类(包括背景)的平均像素交并比作为衡量标准。

4.1 从分类器到密集FCN

用VGG16,将最后的全连接层去掉换上卷积层。用通道数为21的1x1卷积预测每个PASCAL类(包括背景)的分数,在每个粗糙的输出位置上,跟着反卷积层用于双线性上采样粗糙输出到像素密集的输出(3.3节描述的)

值得注意的是GoogLeNet不实用于这种分割结果。

4.2 结合what和where

如图4所示,最终预测层的32像素步幅限制了上采样输出中的细节尺度。本文通过添加link来解决这个问题,这些link将最终预测层与较低层相结合。通过精细层和粗糙层的结合使模型可以进行符合全局结构的局部预测。

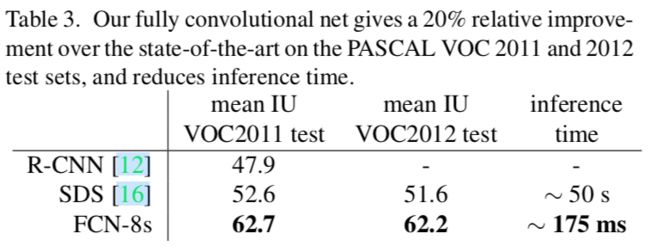

通过这种skip net架构,平均IOU提升到了62.4,再提升到了62.7。

通过其他方式进行细化

减少池化层的步幅是获取更精细预测的最直接方法。然而,用基于VGG16的网络这样做是有问题的。会导致要学习的filter大小过大。还有一种方式是3.2节提到的shift-and-stitch技巧。

4.3 实验框架

优化

用带动量的SGD,batch size为20。固定的学习率。对于类分数卷积层用全零初始化而不是随机初始化(神奇。。)

微调

微调提升还是很明显的,在单卡GPU上微调FCN-32s用了3天,FCN-16s和FCN-8s分别用了1天。

Patch Sampling

与训练整个图像相比,本文发现采样对于收敛速度并没有显著影响,而且由于每个batch需要考虑的图像数量较多,所以采用的时间要长得多。

类平衡

可以通过重新赋权或采样损失来平衡类。尽管标签是相当不平衡的(大于3/4为背景),但本文发现类平衡不是必须的。

密集预测

没有使用Shift-and-stitch,或者是等效的稀疏滤波器。

增强

通过随机镜像和"jittering"图像做增强,但是没有显著提升。

更多的训练数据

VOC2011有1112张标记图像,增加了一个8498的数据集,平均IOU从56提升到59.4。

实现

用单卡K40c,在Caffe上训练。源码已公布(良心)

5 结果

指标

定义为预测属于类的类的像素数量,有个不同的类,定义为类的像素总数,计算4个指标:

像素准确率:

平均准确率:

平均IOU:

frequency weighted IU:

PASCAL VOC

NYUDv2

这个是由Kinect收集的RGB-D数据集。有1449张图,40类。

SIFT Flow

2688张图,33类。

七 读后感

本文不太容易读。图像分割这个领域还是比较难的,也可能跟第一次接触有关系,还有不少专业术语需要搞清楚。感觉思想上倒是没有什么复杂的地方,就是将网络头的地方从分类换成分割。本文受OverFeat影响也很大,文中有多次出现OverFeat的身影。

素质四连

要解决什么问题

用CNN来解决图像分割。

用了什么方法解决

提出FCN,skip net做更精细的检测。

效果如何

当时的SOTA,也算是深度学习在图像分割里的鼻祖,后面的很多工作都有参考它。

还存在什么问题

效果上虽然提升了一截,不过还不是很好。

八 补充

https://towardsdatascience.com/review-fcn-semantic-segmentation-eb8c9b50d2d1

https://zhuanlan.zhihu.com/p/22976342

patchwise training的解释:https://www.zhihu.com/question/279541529/answer/424397665

栈爆上关于shift-and-stitch的解释:视为多个(shift)低分辨率图像并组合(stitch)它们以获得高分辨率图像。

关于FCN 论文中的 Shift-and-stitch 的详尽解释