机器学习:异常检测和高斯混合模型 Anomaly Detection

目录

问题背景

算法

开发和评价一个异常检测系统

异常检测与监督学习对比

选择特征

误差分析

多元高斯分布

使用多元高斯分布进行异常检测

参考文献

问题背景

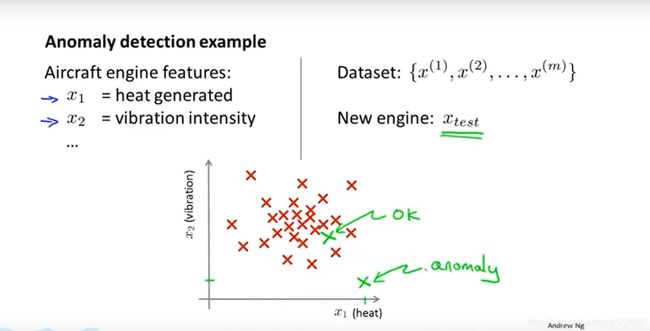

异常检测:假如你要进行一个飞机引擎异常检测,需要检测新生产的发动机是否正常。使用的feature为产热,震动程度等等。如下图,我们可以很直观的看出异常检测的思想:那些远离主体分布的点,我们就把它们当作异常点来处理。

在蓝色圈内的数据属于该组数据的可能性较高,而越是偏远的数据,其属于该组数据的可能性就越低。这种方法称为密度估计,表达如下:

在实际应用中,例如在线采集而来的有关用户的数据,一个特征向量中可能会包含如:用户多久登录一次,访问过的页面,在论坛发布的帖子数量,甚至是打字速度等。尝试根据这些特征构建一个模型,可以用这个模型来识别那些不符合该模式的用户。

再一个例子是检测一个数据中心,特征可能包含:内存使用情况,被访问的磁盘数量,CPU的负载,网络的通信量等。根据这些特征可以构建一个模型,用来判断某些计算机是不是有可能出错了。

算法

对于给定的数据集![]() ,我们要针对每一个特征计算

,我们要针对每一个特征计算![]() 和

和 ![]() 的估计值。

的估计值。

一旦我们获得了平均值和方差的估计值,给定新的一个训练实例,根据模型计算![]() :

:

当![]() 时,为异常。

时,为异常。

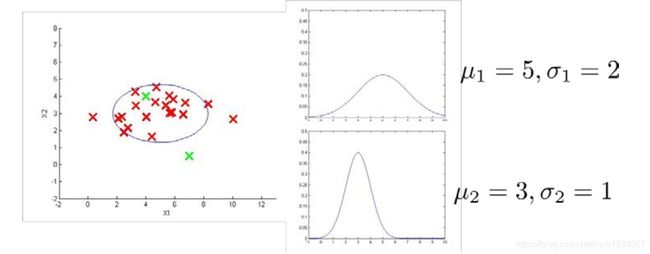

下图是一个由两个特征的训练集,以及特征的分布情况:

下面的三维图表表示的是密度估计函数,![]() 轴为根据两个特征的值所估计

轴为根据两个特征的值所估计![]() 值:

值:

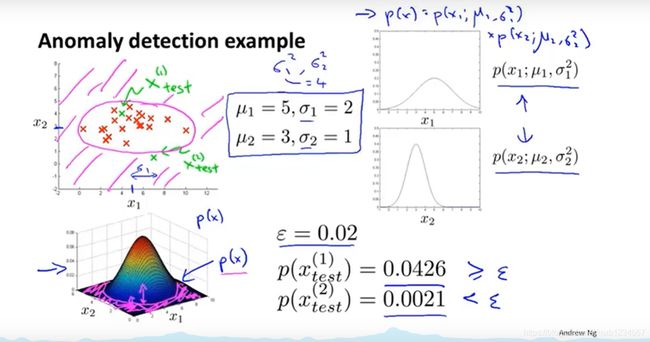

我们选择一个![]() ,将

,将![]() 作为我们的判定边界,当

作为我们的判定边界,当![]() 时预测数据为正常数据,否则为异常。

时预测数据为正常数据,否则为异常。

上图中,左上角左下角图像中,粉色阴影代表异常的区域。如果取![]() 的话,

的话,![]() 是正常的而

是正常的而![]() 是异常的。

是异常的。

开发和评价一个异常检测系统

异常检测算法是一个非监督学习算法,意味着我们无法根据结果变量 ![]() 的值来告诉我们数据是否真的是异常的。我们需要另一种方法来帮助检验算法是否有效。当我们开发一个异常检测系统时,我们从带标记(异常或正常)的数据着手,我们从其中选择一部分正常数据用于构建训练集,然后用剩下的正常数据和异常数据混合的数据构成交叉检验集和测试集。

的值来告诉我们数据是否真的是异常的。我们需要另一种方法来帮助检验算法是否有效。当我们开发一个异常检测系统时,我们从带标记(异常或正常)的数据着手,我们从其中选择一部分正常数据用于构建训练集,然后用剩下的正常数据和异常数据混合的数据构成交叉检验集和测试集。

具体的评价方法:

- 根据测试集数据,我们估计特征的平均值和方差并构建

函数

函数 - 对交叉检验集,我们尝试使用不同的

值作为阀值,并预测数据是否异常,根据F1值或者查准率与查全率的比例来选择

值作为阀值,并预测数据是否异常,根据F1值或者查准率与查全率的比例来选择

- 选出

后,针对测试集进行预测,计算异常检验系统的F1值,或者查准率与查全率之比

后,针对测试集进行预测,计算异常检验系统的F1值,或者查准率与查全率之比

异常检测与监督学习对比

之前我们构建的异常检测系统也使用了带标记的数据,与监督学习有些相似,下面的对比有助于选择采用监督学习还是异常检测:

| 异常检测 Anomaly Detection | 监督学习 Supervised Learning |

| 非常少量的正向类(异常数据 |

同时有大量的正向类和负向类 |

| 许多不同种类的异常,非常难。根据非常 少量的正向类数据来训练算法。 | 有足够多的正向类实例,足够用于训练算法,未来遇到的正向类实例可能与训练集中的非常近似。 |

| 未来遇到的异常可能与已掌握的异常、非常的不同。 | |

| 例如:欺诈行为检测 生产(例如飞机引擎)检测数据中心的计算机运行状况 | 例如:邮件过滤器 天气预报 肿瘤分类 |

选择特征

异常检测假设特征符合高斯分布,如果数据的分布不是高斯分布,异常检测算法也能够工作,但是最好还是将数据转换成高斯分布,例如使用对数函数:![]() ,其中

,其中![]() 为非负常数;或者

为非负常数;或者![]() ,

,![]() 为 0-1 之间的一个分数。

为 0-1 之间的一个分数。

误差分析

一个常见的问题是一些异常的数据可能也会有较高的![]() 值,因而被算法认为是正常的。这种情况下误差分析能够帮助我们,我们可以分析那些被算法错误预测为正常的数据,观察能否找出一些问题。我们可能能从问题中发现我们需要增加一些新的特征,增加这些新特征后获得的新算法能够帮助我们更好地进行异常检测。

值,因而被算法认为是正常的。这种情况下误差分析能够帮助我们,我们可以分析那些被算法错误预测为正常的数据,观察能否找出一些问题。我们可能能从问题中发现我们需要增加一些新的特征,增加这些新特征后获得的新算法能够帮助我们更好地进行异常检测。

我们通常可以通过将一些相关的特征进行组合,来获得一些新的更好的特征(异常数据的该特征值异常地大或小)。

例如,在检测数据中心的计算机状况的例子中,我们可以用CPU负载与网络通信量的比例作为一个新的特征,如果该值异常地大,便有可能意味着该服务器是陷入了一些问题中。

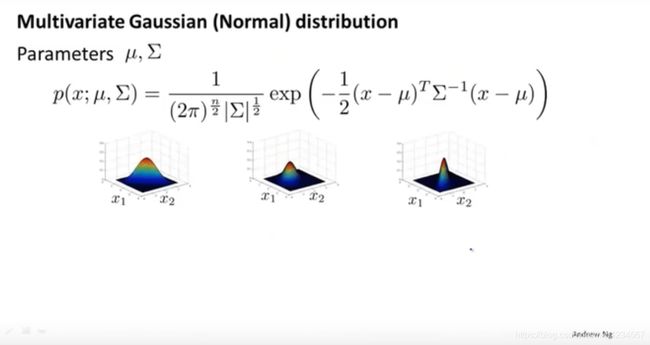

多元高斯分布

假使我们有两个相关的特征,而且这两个特征的值域范围比较宽,这种情况下,一般的高斯分布模型可能不能很好地识别异常数据。其原因在于,一般的高斯分布模型尝试的是去同时抓住两个特征的偏差,因此创造出一个比较大的判定边界。

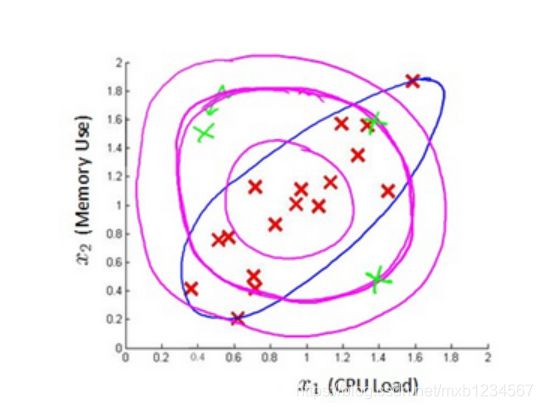

例如上图两个相关特征,红色的线是一般的高斯分布模型获得的判定边界,很明显绿色的![]() 所代表的数据点很可能是异常值,但是其

所代表的数据点很可能是异常值,但是其![]() 值却仍然在正常范围内。多元高斯分布将创建像图中蓝色曲线所示的判定边界。

值却仍然在正常范围内。多元高斯分布将创建像图中蓝色曲线所示的判定边界。

在一般的高斯分布模型中,我们计算 的方法是: 通过分别计算![]() 每个特征对应的几率然后将其累乘起来,在多元高斯分布模型中,我们将构建特征的协方差矩阵,用所有的特征一起来计算

每个特征对应的几率然后将其累乘起来,在多元高斯分布模型中,我们将构建特征的协方差矩阵,用所有的特征一起来计算![]() 。

。

我们首先计算所有特征的平均值,然后再计算协方差矩阵:

注:其中![]() 是一个向量,其每一个单元都是原特征矩阵中一行数据的均值。最后我们计算多元高斯分布的

是一个向量,其每一个单元都是原特征矩阵中一行数据的均值。最后我们计算多元高斯分布的![]() :

:

协方差矩阵是如何影响模型的?

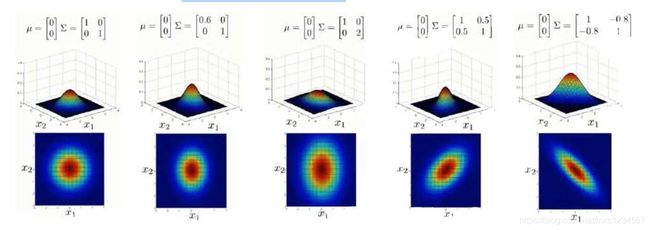

上图是5个不同的模型,从左往右依次分析:

- 是一个一般的高斯分布模型

- 通过协方差矩阵,令特征1拥有较小的偏差,同时保持特征2的偏差

- 通过协方差矩阵,令特征2拥有较大的偏差,同时保持特征1的偏差

- 通过协方差矩阵,在不改变两个特征的原有偏差的基础上,增加两者之间的正相关性

- 通过协方差矩阵,在不改变两个特征的原有偏差的基础上,增加两者之间的负相关性

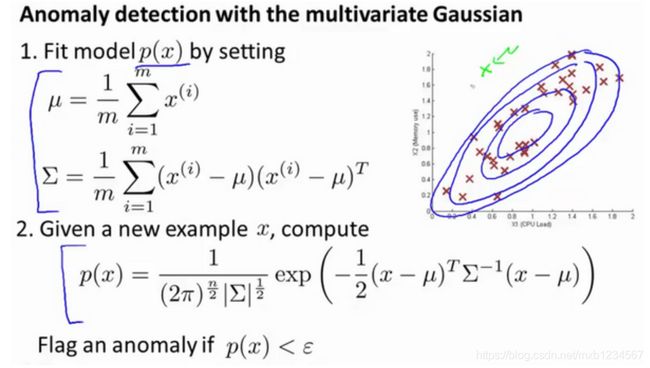

使用多元高斯分布进行异常检测

首先,我们把我们的训练集,和我们的拟合模型,我们计算![]() ,要知道,设定

,要知道,设定![]() 和描述的一样

和描述的一样![]() 。

。

如图,该分布在中央最多,越到外面的圈的范围越小。

并在该点是出路这里的概率非常低。

原始模型与多元高斯模型的关系如图:![]()

其中:协方差矩阵![]() 为:

为:

多元高斯分布模型与原高斯分布模型相比:

| 原高斯分布模型 | 多元高斯分布模型 |

|---|---|

| 不能捕捉特征之间的相关性 但可以通过将特征进行组合的方法来解决 | 自动捕捉特征之间的相关性 |

| 计算代价低,能适应大规模的特征 | 计算代价较高训练集较小时也同样适用,例如数据5000-10000条非常适用 |

| 训练集小也ok | 必须要有数据远大于标签(行数远大于列数 |

参考文献

EM算法-高斯混合模型GMM详细代码实现

斯坦福机器学习视频笔记 Week9 异常检测和高斯混合模型 Anomaly Detection