- Three.js实现海洋与天空

Three.js实现海洋与天空https://threehub.cn/#/codeMirror?navigation=ThreeJS&classify=shader&id=waterSkyimport*asTHREEfrom"three";import{OrbitControls}from'three/examples/jsm/controls/OrbitControls.js'constDOM=

- Python面试题:Python中的异步编程:详细讲解asyncio库的使用

超哥同学

Python系列python开发语言面试编程

Python的异步编程是实现高效并发处理的一种方法,它使得程序能够在等待I/O操作时继续执行其他任务。在Python中,asyncio库是实现异步编程的主要工具。asyncio提供了一种机制来编写可以在单线程内并发执行的代码,适用于I/O密集型任务。以下是对asyncio库的详细讲解,包括基本概念、用法、示例以及注意事项。1.基本概念1.1协程(Coroutines)协程是一个特殊的函数,它可以被

- 嵌入式学习-Day6

不想学习\??!

学习

c语言day6模拟获取co2,pm2.5的数值,并对co2的浓度,pm2.5的浓度做出划分,详情划分在代码注释首先写写出模拟获取数值的函数,但是由于要对浓度划分,所以先枚举出来等级划分typedefenum{Excellent,//默认0往下递增Good,Average,Poor}QualityLevel;接着写出模拟获取co2函数(在这里用到了static关键字,静态函数能够确保只在co2的c文

- 如何让AI真正理解你的意图(自适应Prompt实战指南)

nine是个工程师

大语言模型人工智能prompt

目前的LLM模型,在理解用户意图方面,正在使用自适应Prompt技术,来提升模型的理解能力。目前使用deepseek推理模型能明显看到自适应的一个过程。前言:为什么你的AI总是"答非所问"?相信很多人都遇到过这样的情况:你问:“帮我写一个Python爬虫”AI答:给你一堆理论知识和完整教程(你只想要简单代码)你问:“推荐一部电影”AI答:推荐了《教父》(你想看轻松喜剧)你问:“解释一下机器学习”A

- 从单体脚本到模块化设计:Python工程师的架构思维跃迁

引言:从“一团乱麻”到“乐高积木”你是否曾经打开一个Python脚本,里面密密麻麻挤着上千行代码?函数相互缠绕,全局变量随处可见,想改一个小功能却心惊胆战,生怕牵一发而动全身?这就是典型的“单体脚本”(MonolithicScript)困境。作为过来人,我深知这种痛苦。本文将手把手带你跳出这个泥潭,掌握模块化设计的核心思想,并初步建立宝贵的架构设计思维,让你的代码从“勉强运行”跃迁到“优雅可维护”

- python json 反序列化-V1

CATTLECODE

pythonjson开发语言

在编程中,反序列化函数用于将序列化后的数据(如JSON、XML等格式)重新转换为程序可操作的对象或数据结构。以下是不同语言和场景下的实现方式及特点:1.Python中的反序列化(1)标准库json模块json.loads():将JSON字符串反序列化为Python对象(如字典、列表)。importjsonjson_str='{"name":"Alice","age":25}'dat

- AI人工智能与机器学习的大数据融合应用

AI智能探索者

人工智能机器学习大数据ai

AI人工智能与机器学习的大数据融合应用关键词:AI人工智能、机器学习、大数据、融合应用、数据挖掘摘要:本文深入探讨了AI人工智能与机器学习在大数据融合应用方面的相关内容。首先介绍了研究的背景、目的、预期读者和文档结构,对核心术语进行了清晰定义。接着阐述了AI、机器学习和大数据的核心概念及相互联系,给出了形象的文本示意图和Mermaid流程图。详细讲解了核心算法原理,并通过Python源代码进行说明

- AI人工智能遇上TensorFlow:技术融合新趋势

AI大模型应用之禅

人工智能tensorflowpythonai

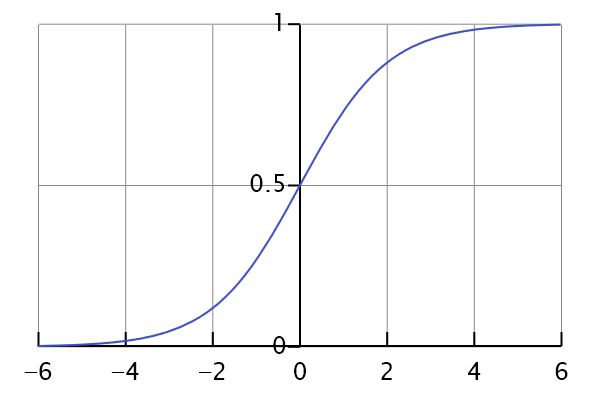

AI人工智能遇上TensorFlow:技术融合新趋势关键词:人工智能、TensorFlow、深度学习、神经网络、机器学习、技术融合、AI开发摘要:本文深入探讨了人工智能技术与TensorFlow框架的融合发展趋势。我们将从基础概念出发,详细分析TensorFlow在AI领域的核心优势,包括其架构设计、算法实现和实际应用。文章包含丰富的技术细节,如神经网络原理、TensorFlow核心算法实现、数学

- 大模型之Spring AI实战系列(三十二):Spring Boot + DeepSeek 实战指南:工具函数(Function Call)实战应用

系列篇章No.文章1大模型之SpringAI实战系列(一):基础认知篇-开启智能应用开发之旅2大模型之SpringAI实战系列(二):SpringBoot+OpenAI打造聊天应用全攻略3大模型之SpringAI实战系列(三):SpringBoot+OpenAI实现聊天应用上下文记忆功能4大模型之SpringAI实战系列(四):SpringBoot+OpenAI使用OpenAIEmbedding实

- 408考研逐题详解:2010年第23题——系统调用

2010年第23题下列选项中,操作系统提供给应用程序的接口是()A.系统调用\qquadB.中断\qquadC.库函数\qquadD.原语解析本题考查对操作系统接口机制的理解,特别是应用程序如何与操作系统内核交互以请求服务(如文件操作、进程管理等)。系统调用:是操作系统内核为应用程序提供的一组预定义接口,允许应用程序请求内核服务(如I/O操作、进程控制、内存分配等)。应用程序通过特定的指令(如in

- Hive适用语法

`whyYa

hivehadoop数据仓库

一、日期处理函数总结1.trunc()–取日期中当月第一天trunc(‘2022-12-05’,‘MM’)--取当月第一天2022-12-01trunc(‘2022-12-05’,‘Q’)--季度中的第一天2022-10-01trunc(‘2022-12-03’,‘YEAR’)–取当年第一天20222.last_day()–取当月最后一天last_day(‘2022-12-03’)3.month(

- STM32F103C8T6标准库对SD卡读取数据的详细步骤

GC_June07

stm32嵌入式硬件单片机

一、准备工作模块:STM32F103C8T6核心板、ST-LINK下载器、CH340、SD卡、SD卡模块、SD卡读卡器二、代码编写(标准库)①主函数:main说明:用串口1打印信息charSD_FileName[]="hello.txt";uint8_twrite_buf[]="WBQ牛逼!!!\r\n";intmain(void){ uint8_tres; uart_init(960

- 共享内存的创建和使用

Ring__Rain

C++c++

以下是对ShareMemoryPubManager::CreateShm函数的详细解读,结合代码逻辑和Windows共享内存机制分析:1.函数功能概述该函数用于创建并映射一个共享内存区域,将其封装到自定义结构体SwathShareMemory中,并存储到成员变量m_shmQueue中。核心步骤包括:构造共享内存名称:基于shm_prefix和shm_id生成唯一标识。创建文件映射对象:调用Crea

- Java 数据清洗 List集合去重

Dolphin_Home

生产环境_场景抽象私有_案例分析代码规范javalistpython

Java数据清洗List集合去重Java8列表去重实用指南(多属性去重)方法1:最优性能方案(自定义循环+Key包装器)importjava.util.*;publicclassDistinctUtil{//高性能去重工具(预分配内存/避免装箱)publicstaticListdistinctByKeys(Listlist,FunctionkeyExtractor){//预分配足够空间防止扩容Se

- 让 Python 代码飙升330倍:从入门到精通的四种性能优化实践

python

花下猫语:性能优化是每个程序员的必修课,但你是否想过,除了更换算法,还有哪些“大招”?这篇文章堪称典范,它将一个普通的函数,通过四套组合拳,硬生生把性能提升了330倍!作者不仅展示了“术”,更传授了“道”。让我们一起跟随作者的思路,体验一次酣畅淋漓的优化之旅。PS.本文选自最新一期Python潮流周刊,如果你对优质文章感兴趣,诚心推荐你订阅我们的专栏。作者:ItamarTurner-Traurin

- Golang中的panic

后端go

前言Golang中当程序发生致命异常时(比如数组下标越界,注意这里的异常并不是error),Golang程序会panic(运行时恐慌)。当程序发生panic时,程序会执行当前栈中的defer函数列表。然后打印引发panic的具体信息,最后进程退出,本篇文章我们一起探讨Golang中的panic以及如何利用defer和recover来恢复这种致命的异常分析造成panic堆栈信息go体验AI代码助手代

- React源码2 React中的工厂函数:createRoot()

gzzeason

ReactV18.2源码react.jsjavascript前端

#ReactV18.2源码前置基础知识:工厂函数工厂函数是一种设计模式,用于动态创建对象或函数实例。其核心思想是通过封装对象创建的细节,提供统一的接口,从而增强代码的灵活性和可维护性,有一些核心作用:解耦创建逻辑:将对象的实例化过程与使用分离,调用方无需关心具体实现细节。动态生成:根据输入参数返回不同类型的对象或函数。统一接口:通过单一入口点管理多种创建场景。工厂函数由构造函数进阶而来,都是用来创

- 深度学习核心知识简介和模型调参

研术工坊

深度学习知识和技巧深度学习人工智能python

深度学习模型调优就像调制一道复杂的菜肴,需要掌握多种"调料"的用法。本文将为您详解这些关键"调料",帮助您烹饪出高性能的模型。###核心参数及其影响####1️⃣Loss(损失函数)**基本介绍**:衡量模型预测与真实值差距的指标,是模型优化的指南针。**生活类比**:想象你在教小孩认识动物:-**完美情况**:小孩看到猫说"猫",看到狗说"狗"→Loss=0-**有错误**:小孩看到猫说"狗"→

- C语言—-数据的输入输出,printf,putchar,puts,scanf,getchar函数的使用及区别

老虎0627

C语言c语言开发语言

数据的输入C程序中实现输入的函数很多,下面逐个来进行介绍用printf函数输出数据printf函数的一般格式printf(“格式控制”,输出列表);例如#includeintmain(){inta=1;printf("a=%d\n"

- EMQX 入门教程⑪——通过 ExHook 使用 gRPC 服务接收 EMQX 回调事件(已连接/已断开/已订阅/已发布...)

小康师兄

EMQX入门教程EMQXgRPCExHook钩子java

文章目录一、前文二、钩子函数介绍三、EMQX4.x的hook实现方法四、EMQX5.x的hook实现方法五、下载emqx-extension-examples六、修改Demo代码七、编译Demo代码八、运行Demo程序九、ExHook设置和启用十、更多日志十一、文档参考一、前文EMQX入门教程——导读二、钩子函数介绍exhook钩子函数可以理解成可挂载函数的点(HookPoint)。因为MQTT运

- Outcome 使用教程

Outcome使用教程outcomeProvidesverylightweightoutcomeandresult(non-Boostedition)项目地址:https://gitcode.com/gh_mirrors/ou/outcome1.项目介绍Outcome是一个C++14库,用于报告和处理函数失败。它可以作为异常处理机制的替代或补充。在某些场景下,使用C++的异常处理可能不合适,例如异

- 蓝桥杯C++组算法知识点整理 · 考前突击(上)【小白适用】

南星六月雪

C++学习笔记南星六月雪的手札c++蓝桥杯开发语言算法数据结构

【背景说明】本文的作者是一名算法竞赛小白,在第一次参加蓝桥杯之前希望整理一下自己会了哪些算法,于是有了本文的诞生。分享在这里也希望与众多学子共勉。如果时间允许的话,这一系列会分为上中下三部分和大家见面,祝大家竞赛顺利!【文风说明】本文主要会用代码+注释的方式来解释内容。相信学过编程的人都会发现程序比长篇大论更易理解!目录一、语言基础1.1编程基础1.2竞赛常用库函数1.2.1sort函数1.2.2

- 解决DevEco Studio预览器实时预览崩溃与超时问题的实用指南

以下是一些解决DevEcoStudio预览器实时预览崩溃、超时问题的方法:检查代码错误语法和引用错误:仔细检查代码中是否存在拼写错误、缺少分号等语法问题,以及是否引用了不存在的变量、函数或组件。例如,如果在使用findComponentById方法时,传入的组件ID不正确,就会导致预览器加载失败。逻辑错误:检查循环、条件判断等逻辑是否正确,确保代码能够正常执行,避免因逻辑错误导致预览器无法正确渲染

- 【C语言入门】函数返回局部变量指针的底层原理与实践陷阱

第一章内存管理基础:C语言的内存布局与生命周期1.1C程序的内存分区C程序运行时,内存通常分为五个区域(以典型的32位系统为例):栈(Stack):自动分配和释放,用于存储函数参数、局部变量等临时数据由编译器管理,遵循“后进先出”原则,空间大小有限(通常几MB)变量生命周期:从声明处开始,到函数/代码块结束时自动销毁堆(Heap):手动分配(malloc/calloc/realloc)和释放(fr

- 如何使用Python控制笔记本电脑屏幕亮度?

很酷的站长

编程笔记电脑python开发语言

Python已成为世界上最受欢迎的编程语言之一,这要归功于它的简单性、多功能性和广泛的应用程序。凭借其广泛的库和框架,Python可用于从Web开发到机器学习以及介于两者之间的任何内容。在Python中,最流行的数据分析和操作库之一是Pandas,它提供了处理表格数据的强大工具。在本教程中,我们将使用Python和屏幕亮度控制库来探索如何控制笔记本电脑屏幕亮度。我们将向您展示如何使用Python通

- Java字段比较工具类设计

萧曵 丶

JAVAjavapython开发语言

以下是一个设计用于比较两个同类型对象字段变化的工具类,它使用Java反射机制检查每个字段是否有变化(不考虑递归深度比较):importjava.lang.reflect.Field;importjava.util.HashMap;importjava.util.Map;importjava.util.Objects;publicclassFieldChangeComparator{/***比较两个

- Kafka生产者的初始化

夏日彩虹

kafkakafka分布式

创作内容丰富的干货文章很费心力,感谢点过此文章的读者,点一个关注鼓励一下作者,激励他分享更多的精彩好文,谢谢大家!把用户配置的KafkaProducer参数,赋值给KafkaProducer构造函数中userProvidedConfigs变量。获取clientId。获取用户配置的分区器。获取用户配置的retry.backoff.ms,默认值100毫秒,该参数的意思是设置在重试发送消息之前等待的时间

- 基于多设计模式的同步&异步日志系统--代码设计(六)

久念祈

日志系统设计模式

目录日志器管理模块(单例)设计思想成员属性提供的接口代码实现:全局的日志器建造者代码实现全局接口的设计获取日志器的全局接口使用宏函数代理日志器的输出接口日志器管理模块(单例)用户可能会创建多个日志器,然后从中选取一个输出日志,那我们就需要将这些日志器管理起来,因此我们需要设计一个日志器管理模块。设计思想以日志器的名称作为唯一关键字将创建的日志器保存起来,允许用户通过日志器名称获取对应日志器,如果日

- 10、 量子神经网络:从理论到实践

安检

量子神经网络PennyLaneQiskit

量子神经网络:从理论到实践1.量子神经网络简介量子神经网络(QuantumNeuralNetworks,QNNs)是量子计算与经典机器学习相

- maven运行javafx报错:ԭ��: java.lang.ClassNotFoundException: ����jump

楚门留香

javamaven开发语言

之前学了maven后来上课用javafx,只会用maven运行给我害惨了,针对小白。先说结果,不能用maven运行,直接上方功能栏-运行-运行(那个绿色的运行)即可如果运行是黑的,我这边的解决办法是下载插件并且重新创建项目,我一开始创建新项目给我显示:`JavaFX为模块生成源时出错:D:\AAACodeJava\javaf,mvn\wrapper\maven-wrapper.properties

- Spring4.1新特性——Spring MVC增强

jinnianshilongnian

spring 4.1

目录

Spring4.1新特性——综述

Spring4.1新特性——Spring核心部分及其他

Spring4.1新特性——Spring缓存框架增强

Spring4.1新特性——异步调用和事件机制的异常处理

Spring4.1新特性——数据库集成测试脚本初始化

Spring4.1新特性——Spring MVC增强

Spring4.1新特性——页面自动化测试框架Spring MVC T

- mysql 性能查询优化

annan211

javasql优化mysql应用服务器

1 时间到底花在哪了?

mysql在执行查询的时候需要执行一系列的子任务,这些子任务包含了整个查询周期最重要的阶段,这其中包含了大量为了

检索数据列到存储引擎的调用以及调用后的数据处理,包括排序、分组等。在完成这些任务的时候,查询需要在不同的地方

花费时间,包括网络、cpu计算、生成统计信息和执行计划、锁等待等。尤其是向底层存储引擎检索数据的调用操作。这些调用需要在内存操

- windows系统配置

cherishLC

windows

删除Hiberfil.sys :使用命令powercfg -h off 关闭休眠功能即可:

http://jingyan.baidu.com/article/f3ad7d0fc0992e09c2345b51.html

类似的还有pagefile.sys

msconfig 配置启动项

shutdown 定时关机

ipconfig 查看网络配置

ipconfig /flushdns

- 人体的排毒时间

Array_06

工作

========================

|| 人体的排毒时间是什么时候?||

========================

转载于:

http://zhidao.baidu.com/link?url=ibaGlicVslAQhVdWWVevU4TMjhiKaNBWCpZ1NS6igCQ78EkNJZFsEjCjl3T5EdXU9SaPg04bh8MbY1bR

- ZooKeeper

cugfy

zookeeper

Zookeeper是一个高性能,分布式的,开源分布式应用协调服务。它提供了简单原始的功能,分布式应用可以基于它实现更高级的服务,比如同步, 配置管理,集群管理,名空间。它被设计为易于编程,使用文件系统目录树作为数据模型。服务端跑在java上,提供java和C的客户端API。 Zookeeper是Google的Chubby一个开源的实现,是高有效和可靠的协同工作系统,Zookeeper能够用来lea

- 网络爬虫的乱码处理

随意而生

爬虫网络

下边简单总结下关于网络爬虫的乱码处理。注意,这里不仅是中文乱码,还包括一些如日文、韩文 、俄文、藏文之类的乱码处理,因为他们的解决方式 是一致的,故在此统一说明。 网络爬虫,有两种选择,一是选择nutch、hetriex,二是自写爬虫,两者在处理乱码时,原理是一致的,但前者处理乱码时,要看懂源码后进行修改才可以,所以要废劲一些;而后者更自由方便,可以在编码处理

- Xcode常用快捷键

张亚雄

xcode

一、总结的常用命令:

隐藏xcode command+h

退出xcode command+q

关闭窗口 command+w

关闭所有窗口 command+option+w

关闭当前

- mongoDB索引操作

adminjun

mongodb索引

一、索引基础: MongoDB的索引几乎与传统的关系型数据库一模一样,这其中也包括一些基本的优化技巧。下面是创建索引的命令: > db.test.ensureIndex({"username":1}) 可以通过下面的名称查看索引是否已经成功建立: &nbs

- 成都软件园实习那些话

aijuans

成都 软件园 实习

无聊之中,翻了一下日志,发现上一篇经历是很久以前的事了,悔过~~

断断续续离开了学校快一年了,习惯了那里一天天的幼稚、成长的环境,到这里有点与世隔绝的感觉。不过还好,那是刚到这里时的想法,现在感觉在这挺好,不管怎么样,最要感谢的还是老师能给这么好的一次催化成长的机会,在这里确实看到了好多好多能想到或想不到的东西。

都说在外面和学校相比最明显的差距就是与人相处比较困难,因为在外面每个人都

- Linux下FTP服务器安装及配置

ayaoxinchao

linuxFTP服务器vsftp

检测是否安装了FTP

[root@localhost ~]# rpm -q vsftpd

如果未安装:package vsftpd is not installed 安装了则显示:vsftpd-2.0.5-28.el5累死的版本信息

安装FTP

运行yum install vsftpd命令,如[root@localhost ~]# yum install vsf

- 使用mongo-java-driver获取文档id和查找文档

BigBird2012

driver

注:本文所有代码都使用的mongo-java-driver实现。

在MongoDB中,一个集合(collection)在概念上就类似我们SQL数据库中的表(Table),这个集合包含了一系列文档(document)。一个DBObject对象表示我们想添加到集合(collection)中的一个文档(document),MongoDB会自动为我们创建的每个文档添加一个id,这个id在

- JSONObject以及json串

bijian1013

jsonJSONObject

一.JAR包简介

要使程序可以运行必须引入JSON-lib包,JSON-lib包同时依赖于以下的JAR包:

1.commons-lang-2.0.jar

2.commons-beanutils-1.7.0.jar

3.commons-collections-3.1.jar

&n

- [Zookeeper学习笔记之三]Zookeeper实例创建和会话建立的异步特性

bit1129

zookeeper

为了说明问题,看个简单的代码,

import org.apache.zookeeper.*;

import java.io.IOException;

import java.util.concurrent.CountDownLatch;

import java.util.concurrent.ThreadLocal

- 【Scala十二】Scala核心六:Trait

bit1129

scala

Traits are a fundamental unit of code reuse in Scala. A trait encapsulates method and field definitions, which can then be reused by mixing them into classes. Unlike class inheritance, in which each c

- weblogic version 10.3破解

ronin47

weblogic

版本:WebLogic Server 10.3

说明:%DOMAIN_HOME%:指WebLogic Server 域(Domain)目录

例如我的做测试的域的根目录 DOMAIN_HOME=D:/Weblogic/Middleware/user_projects/domains/base_domain

1.为了保证操作安全,备份%DOMAIN_HOME%/security/Defa

- 求第n个斐波那契数

BrokenDreams

今天看到群友发的一个问题:写一个小程序打印第n个斐波那契数。

自己试了下,搞了好久。。。基础要加强了。

&nbs

- 读《研磨设计模式》-代码笔记-访问者模式-Visitor

bylijinnan

java设计模式

声明: 本文只为方便我个人查阅和理解,详细的分析以及源代码请移步 原作者的博客http://chjavach.iteye.com/

import java.util.ArrayList;

import java.util.List;

interface IVisitor {

//第二次分派,Visitor调用Element

void visitConcret

- MatConvNet的excise 3改为网络配置文件形式

cherishLC

matlab

MatConvNet为vlFeat作者写的matlab下的卷积神经网络工具包,可以使用GPU。

主页:

http://www.vlfeat.org/matconvnet/

教程:

http://www.robots.ox.ac.uk/~vgg/practicals/cnn/index.html

注意:需要下载新版的MatConvNet替换掉教程中工具包中的matconvnet:

http

- ZK Timeout再讨论

chenchao051

zookeepertimeouthbase

http://crazyjvm.iteye.com/blog/1693757 文中提到相关超时问题,但是又出现了一个问题,我把min和max都设置成了180000,但是仍然出现了以下的异常信息:

Client session timed out, have not heard from server in 154339ms for sessionid 0x13a3f7732340003

- CASE WHEN 用法介绍

daizj

sqlgroup bycase when

CASE WHEN 用法介绍

1. CASE WHEN 表达式有两种形式

--简单Case函数

CASE sex

WHEN '1' THEN '男'

WHEN '2' THEN '女'

ELSE '其他' END

--Case搜索函数

CASE

WHEN sex = '1' THEN

- PHP技巧汇总:提高PHP性能的53个技巧

dcj3sjt126com

PHP

PHP技巧汇总:提高PHP性能的53个技巧 用单引号代替双引号来包含字符串,这样做会更快一些。因为PHP会在双引号包围的字符串中搜寻变量, 单引号则不会,注意:只有echo能这么做,它是一种可以把多个字符串当作参数的函数译注: PHP手册中说echo是语言结构,不是真正的函数,故把函数加上了双引号)。 1、如果能将类的方法定义成static,就尽量定义成static,它的速度会提升将近4倍

- Yii框架中CGridView的使用方法以及详细示例

dcj3sjt126com

yii

CGridView显示一个数据项的列表中的一个表。

表中的每一行代表一个数据项的数据,和一个列通常代表一个属性的物品(一些列可能对应于复杂的表达式的属性或静态文本)。 CGridView既支持排序和分页的数据项。排序和分页可以在AJAX模式或正常的页面请求。使用CGridView的一个好处是,当用户浏览器禁用JavaScript,排序和分页自动退化普通页面请求和仍然正常运行。

实例代码如下:

- Maven项目打包成可执行Jar文件

dyy_gusi

assembly

Maven项目打包成可执行Jar文件

在使用Maven完成项目以后,如果是需要打包成可执行的Jar文件,我们通过eclipse的导出很麻烦,还得指定入口文件的位置,还得说明依赖的jar包,既然都使用Maven了,很重要的一个目的就是让这些繁琐的操作简单。我们可以通过插件完成这项工作,使用assembly插件。具体使用方式如下:

1、在项目中加入插件的依赖:

<plugin>

- php常见错误

geeksun

PHP

1. kevent() reported that connect() failed (61: Connection refused) while connecting to upstream, client: 127.0.0.1, server: localhost, request: "GET / HTTP/1.1", upstream: "fastc

- 修改linux的用户名

hongtoushizi

linuxchange password

Change Linux Username

更改Linux用户名,需要修改4个系统的文件:

/etc/passwd

/etc/shadow

/etc/group

/etc/gshadow

古老/传统的方法是使用vi去直接修改,但是这有安全隐患(具体可自己搜一下),所以后来改成使用这些命令去代替:

vipw

vipw -s

vigr

vigr -s

具体的操作顺

- 第五章 常用Lua开发库1-redis、mysql、http客户端

jinnianshilongnian

nginxlua

对于开发来说需要有好的生态开发库来辅助我们快速开发,而Lua中也有大多数我们需要的第三方开发库如Redis、Memcached、Mysql、Http客户端、JSON、模板引擎等。

一些常见的Lua库可以在github上搜索,https://github.com/search?utf8=%E2%9C%93&q=lua+resty。

Redis客户端

lua-resty-r

- zkClient 监控机制实现

liyonghui160com

zkClient 监控机制实现

直接使用zk的api实现业务功能比较繁琐。因为要处理session loss,session expire等异常,在发生这些异常后进行重连。又因为ZK的watcher是一次性的,如果要基于wather实现发布/订阅模式,还要自己包装一下,将一次性订阅包装成持久订阅。另外如果要使用抽象级别更高的功能,比如分布式锁,leader选举

- 在Mysql 众多表中查找一个表名或者字段名的 SQL 语句

pda158

mysql

在Mysql 众多表中查找一个表名或者字段名的 SQL 语句:

方法一:SELECT table_name, column_name from information_schema.columns WHERE column_name LIKE 'Name';

方法二:SELECT column_name from information_schema.colum

- 程序员对英语的依赖

Smile.zeng

英语程序猿

1、程序员最基本的技能,至少要能写得出代码,当我们还在为建立类的时候思考用什么单词发牢骚的时候,英语与别人的差距就直接表现出来咯。

2、程序员最起码能认识开发工具里的英语单词,不然怎么知道使用这些开发工具。

3、进阶一点,就是能读懂别人的代码,有利于我们学习人家的思路和技术。

4、写的程序至少能有一定的可读性,至少要人别人能懂吧...

以上一些问题,充分说明了英语对程序猿的重要性。骚年

- Oracle学习笔记(8) 使用PLSQL编写触发器

vipbooks

oraclesql编程活动Access

时间过得真快啊,转眼就到了Oracle学习笔记的最后个章节了,通过前面七章的学习大家应该对Oracle编程有了一定了了解了吧,这东东如果一段时间不用很快就会忘记了,所以我会把自己学习过的东西做好详细的笔记,用到的时候可以随时查找,马上上手!希望这些笔记能对大家有些帮助!

这是第八章的学习笔记,学习完第七章的子程序和包之后